Взаимная информация. Основные свойства. Собственная информация.

Рассмотрим дискретное множество некоторых элементов

![]()

![]()

Декартово произведение множеств –

совокупность упорядоченных пар ![]() ,

причем

,

причем ![]() даже, если X=Y.

даже, если X=Y.

З

XY

Y

…

![]()

![]()

![]()

![]() ,

где

,

где

![]()

![]()

![]()

![]()

![]() …

… ![]()

![]() X

X

система

…

…

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

В какой степени

какой степени ![]() определяет

определяет ![]() ?

(Какое количество информации содержится

в событии

?

(Какое количество информации содержится

в событии ![]() о событии

о событии ![]() или какова мера количества информации,

которая передается по этой системе?

или какова мера количества информации,

которая передается по этой системе?

Пример.

![]() (D=2)

(D=2)

|

|

(априорная вероятность) |

код |

|

||

|

1символ – «1» |

2,3й – «11» |

1,2,3 – «110» |

|||

|

|

|

001 |

0 |

0 |

0 |

|

|

|

010 |

0 |

0 |

0 |

|

|

|

011 |

0 |

0 |

0 |

|

|

|

100 |

|

0 |

0 |

|

|

|

101 |

|

0 |

0 |

|

|

|

110 |

|

|

1 |

|

|

|

111 |

|

|

0 |

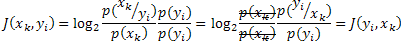

Взаимная информация

![]()

a=2 =>бит , 1 нат (a=e)=1,44бита, 1 дит (a=10)= 2,3 нат=3,32 бита

Свойства взаимной информации:

-

Свойство симметричности

Если статистическая связь отсутствует, то J=0.

-

Взаимная информация принимает положительные значения, если апостериорная (

))

вероятность больше априорной (

))

вероятность больше априорной ( ),

и наоборот.

),

и наоборот.

![]() → заблуждение с абсолютной определённостью

→ заблуждение с абсолютной определённостью

Д

екартово

произведение 3х множеств XYZ=

екартово

произведение 3х множеств XYZ=![]()

кодер

![]()

![]()

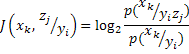

-

Условная взаимная информация

-

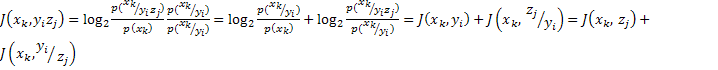

Аддитивность. Какое количество информации несет в себе пара

по отношению к

по отношению к  ?

?

![]()

Пример.

кодер

![]()

![]()

|

|

(априорная вероятность) |

код |

|

||

|

|

|

|

|||

|

|

|

001 |

|

0 |

0 |

|

|

|

010 |

|

|

1 |

|

|

|

011 |

|

|

0 |

|

|

|

100 |

0 |

0 |

0 |

|

|

|

101 |

0 |

0 |

0 |

|

|

|

110 |

0 |

0 |

0 |

|

|

|

111 |

0 |

0 |

0 |

Какое количество информации несет в себе код относительно сообщения 2?

![]()

Каков посимвольный вклад?

![]()

![]()

![]()

Собственная информация. Количество информации, которое необходимо для однозначного определения сообщения данного множества. Оценка, если заменить апостериорную вероятность на 1.

![]()

![]()

![]()

![]()

1![]()

![]()

𝑝,,,𝑥-𝑘.-,𝑦-𝑖...≤1, 𝑝,,,𝑦-𝑖.-,𝑥-𝑘...≤1

![]()

![]()

Чем меньше вероятность наступления события, тем больше информации оно в себе несёт.

Условие собственной информации

![]()

![]()

![]() ,

,

![]()

Собственная вероятность упорядоченной пары

![]()