Экзамен 2021 / Билеты с ответами / 13 билет

.docx1.Дискретизация непрерывных сигналов.

Непрерывные сигналы описывают непрерывную функцию времени. Они изменяются плавно, без резких скачков.

Дискретизация – это преобразование непрерывного сигнала в последовательность чисел (отсчетов) соответствующих определенным моментам времени kt.

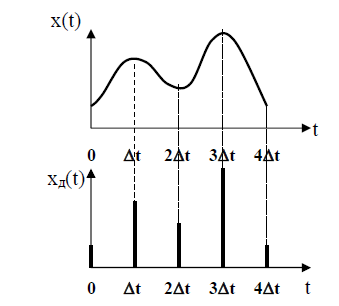

Временные диаграммы непрерывного сигнала x(t) и дискретизированного

x д(t) имеют вид:

Для дискретизации сигналов применяют теорему Котельникова.

Из теоремы Котельникова следует что : Любая непрерывная функция, спектр которой не содержит частот выше в в , полностью определяется своими отсчетами, взятыми через интервал времени в t /в .

А дальше про теорему Котельникова

2. Энтропия. Способы её увеличить

Сообщения источника информации принимают различные значения с

разными вероятностями, которым соответствует различное количество

информации. Для характеристики источника информации вводят среднюю

меру, которая называется ≪энтропия источника информации≫.

Энтропия (H) - это среднее количество информации, приходящееся на

одно сообщение, символ, слово источника информации.

Энтропия характеризует также среднюю неопределенность ситуации. Чем

больше энтропия, тем больше неопределенность ситуации и, следовательно,

тем больше информации мы получаем, когда принимаем некоторое сообщение, которое устраняет неопределенность.

Предположим, что символы в кодовом слове – независимы и могут принимать одно из m возможных значений. В этом случае энтропия дискретного источника независимых символов равна:

pk - вероятность к-го символа.

m - основание кода,т.е. общее количество разных символов.

Энтропия дискретного источника независимых сообщений максимальна, если все сообщения равновероятны т.е.:

![]()

так как сумма всех вероятностей равна 1: p1 + p2 + … + pm = 1.

Сформулируем качественно основные способы увеличения энтропии.

1)Наличие корреляционных связей между сообщениями, символами

уменьшает энтропию. Для увеличения энтропии осуществляют операцию

декорреляции символов, сообщений. Один из способов декорреляции символов- укрупнение сообщений, т.е. символами нового кода будут не отдельные буквы, а целые слова. Корреляционные связи между словами гораздо меньше, чем между символами. Следовательно, укрупненные символы нового кода, соответствующие словам старого кода будут практически некоррелированы, т.е. энтропия нового кода увеличится.

Например, сообщение ≪удовлетворительно≫, состоящее из 17 букв, можно

закодировать одной цифрой ≪3≫. Т.о. скорость передачи информации для этого частного случая увеличится в 17 раз, так как одно и то же количество информации будет передано не 17-ю символами, а только одним символом. Однако, при этом падает помехоустойчивость приема, так как ошибку при приеме символа ≪3≫ исправить невозможно, а ошибка в одном из 17 символов слова ≪удовлетворительно≫ практически не изменяет смысла всего сообщения благодаря корреляционным связям между буквами.

2)Неравновероятность сообщений уменьшает энтропию. Для увеличения

энтропии надо перекодировать сообщения так, чтобы символы нового кода были практически равновероятны. При этом наиболее вероятные сообщения кодируются наиболее короткими кодовыми комбинациями.

3) Для дальнейшего увеличения энтропии необходимо увеличивать основание кода m, так как для источника (кода) с равновероятными символами максимальное значение энтропии равно Нmax =logm.