- •Оглавление

- •Аналитические технологии

- •Формализация нейронных сетей

- •Принцип обучения искусственных нейронных сетей

- •Концепция обучения нейронной сети, предложенная Хэбом

- •Сбор данных для нейронной сети

- •Прикладные возможности нейронных сетей

- •Переобучение и обобщение

- •Персептрон

- •Алгоритм обратного распространения ошибки

- •Сигмоидальный нейрон

- •Нейрон типа «адалайн»

- •Инстар и оутстар Гроссберга

- •Нейрон типа wta (Winner Takes All)

- •08.10.2011 Модель нейрона Хэбба

- •Стохастическая модель нейрона

- •Стохастические алгоритмы обучения

- •Настройка числа нейронов в скрытых слоях многослойных сетей в процессе обучения

- •Алгоритмы сокращения

- •Конструктивные алгоритмы

- •Упрощенные алгоритмы расщепления

- •Радиальная базисная сеть

- •Вероятностные нейронные сети

- •Линейные нейронные сети

- •Обучение

- •Сети с самоорганизацией на основе конкуренции

- •12.11.2011 Модели ассоциативной памяти. Сети Хопфилда

- •Когнитивные карты

- •19.11.2011 Генетические алгоритмы Естественный отбор и генетическое наследование

- •Модель эволюции в природе, реализованная программно

- •Символьная модель простого генетического алгоритма

- •Работа простого генетического алгоритма

- •26.11.2011 Шима (Schema)

- •Применение аналитических технологий

- •03.12.2011

- •Бизнес-приложения

- •Программные реализации аналитических технологий

- •Список литературы

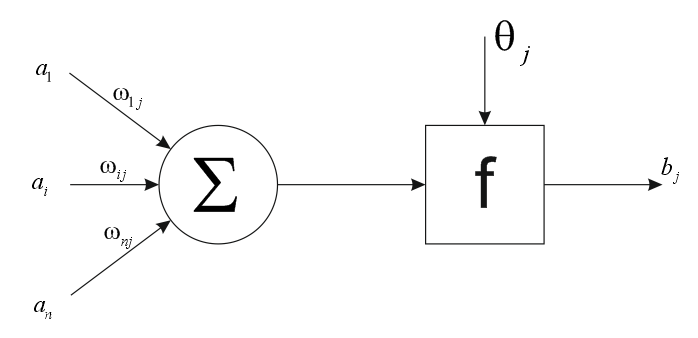

Формализация нейронных сетей

Рисунок 1 Формализация нейронных сетей

На

входы нейрона поступает номер сигнала

ai

с выходом других нейронов, образуют

вектор входных сигналов. Все сигналы,

умноженные на соответствующие весовые

коэффициенты

суммируются.

Коэффициенты образуют весовой вектор,

где коэффициент

суммируются.

Коэффициенты образуют весовой вектор,

где коэффициент вес

связи отi-ого

нейрона к j-ому

нейрону. Результат суммирования поступает

на пороговый элемент, характеризуемый

величиной порога и некоторой функции

активации. Таким образом сигнал bj

на выходе нейрона j

может быть представлен в следующем

виде:

вес

связи отi-ого

нейрона к j-ому

нейрону. Результат суммирования поступает

на пороговый элемент, характеризуемый

величиной порога и некоторой функции

активации. Таким образом сигнал bj

на выходе нейрона j

может быть представлен в следующем

виде:

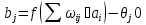

В качестве функции активации могут использоваться следующие:

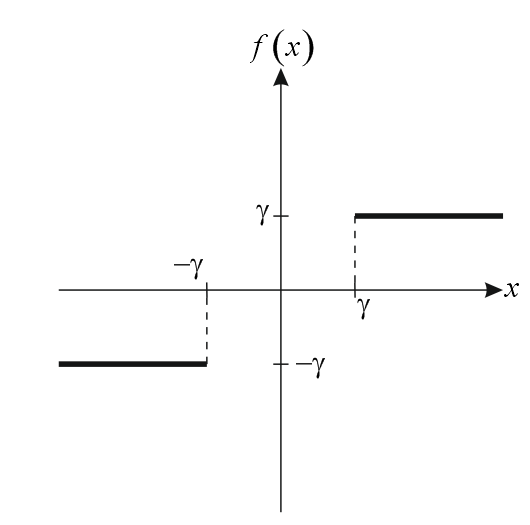

Ступенчатая (пороговая) функция

;

;

Рисунок 2 Ступенчатая (пороговая) функция активации

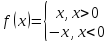

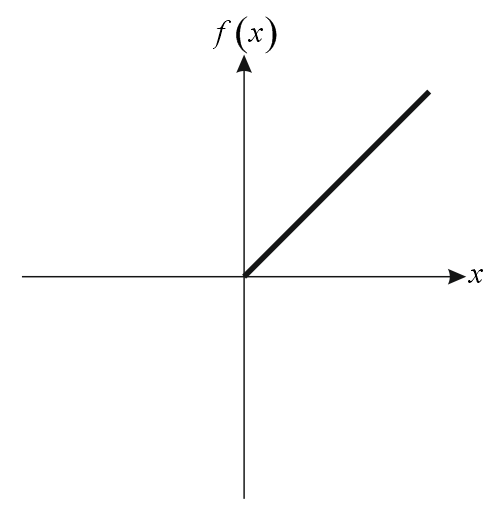

Линейная функция активации

;

;

Рисунок 3 Линейная функция активации

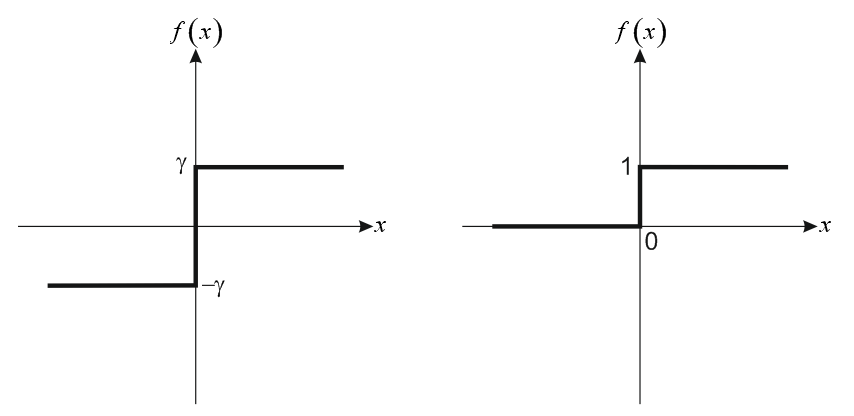

Кусочно-линейная функция;

Рисунок 4 Кусочно-линейная функция активации

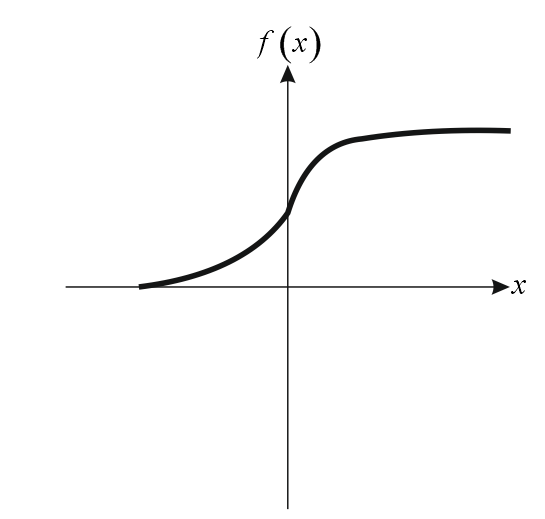

Сигмоидальная функция:

Рисунок 5 Сигмоидальная функция активации

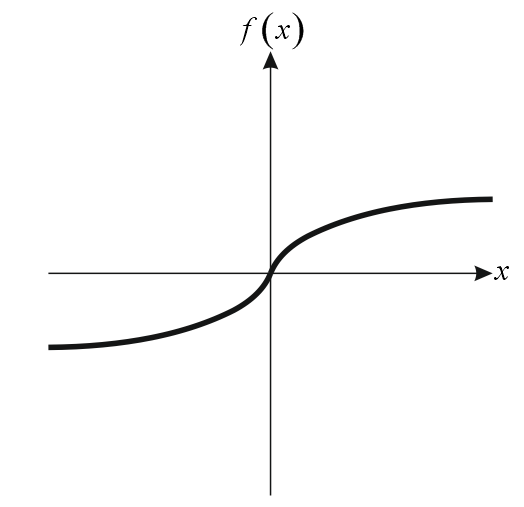

Гиперболический тангенс

Рисунок 6 Гиперболический тангенс

Существует множество способов организации искусственных нейронных сетей, которые могут содержать различное число слоев нейронов. Нейроны могут быть связаны как внутри отдельных слоев, так и между слоями. В зависимости от направления связи могут быть прямыми или обратными.

Слой нейронов непосредственно принимающий информацию из окружающей среды называется входным слоем, передающей информацию во внешнюю среду – выходным слоем. Любой слой, лежащий между ними – промежуточный.

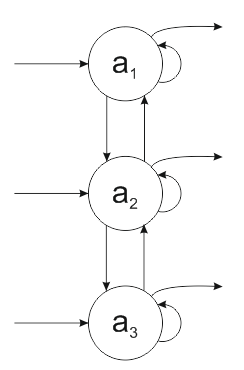

Однослойная структура с обратной связью;

Рисунок 7 Однослойная структура с обратной связью

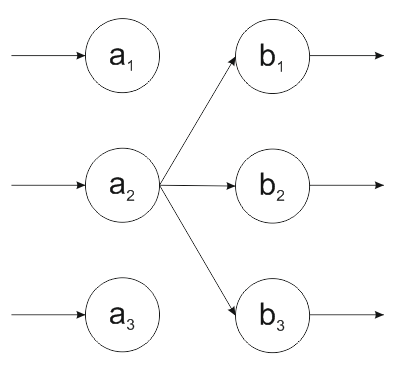

Двуслойная структура с прямыми связями;

Рисунок 8 Двуслойная структура с прямыми связями

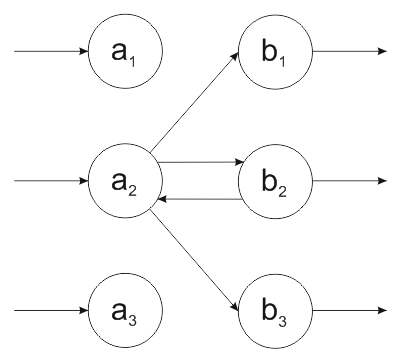

Двуслойная структура с обратной связью;

Рисунок 9 Двуслойная структура с обратной связью

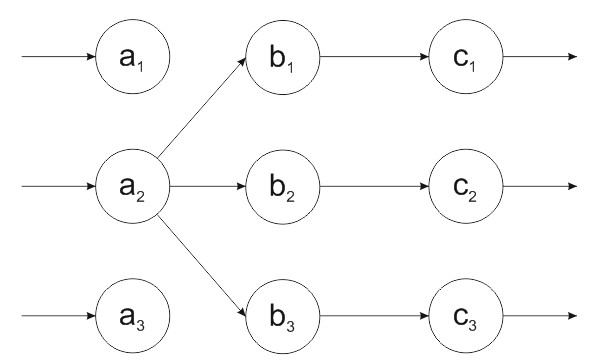

Трехслойная структура с линейной связью;

Рисунок 10 Трехслойная структура с линейной связью

Принцип обучения искусственных нейронных сетей

Цель обучения нейронной сети – состоит в её настройке на заданное поведение. Один из подходов к получению сети … он предусматривает обучение сети путем настройки значений весовых коэффициентов. Матрица весовых коэффициентов сети называется синоптической картой. Существует 2 вида обучения, обучение с учителем и без него.

Обучение

с учителем предполагает наличие обучающих

пар

и

образов, называемых обучающей

последовательностью. При этом для

каждого входного образаai

вычисляется реакция сети bi

и сравнивается с соответствующим целевым

образом di.

Полученное рассогласование используется

алгоритмом обучения для корректировки

синоптической карты таким образом,

чтобы уменьшить ошибку рассогласования.

и

образов, называемых обучающей

последовательностью. При этом для

каждого входного образаai

вычисляется реакция сети bi

и сравнивается с соответствующим целевым

образом di.

Полученное рассогласование используется

алгоритмом обучения для корректировки

синоптической карты таким образом,

чтобы уменьшить ошибку рассогласования.

Процесс обучения без учителя широко используется во многих приложениях нейронных сетей, но он не полностью соответствует реальным процессам. Мост использует поступающую информацию, сам осуществляет её обобщение и коррекцию своей деятельности путем анализа ошибок. В случае обучения без учителя обучающая последовательность состоит лишь из входных образов ai. Алгоритм обучения настраивает веса так, что близким входным векторам соответствовали одинаковые выходные, т.е. фактически осуществляется разбиение пространства входных образов на классы.

Метод обучения, предложенный Розенблаттом

Шаг 0: начальное значение весов всех нейронов случайно;

Шаг 1: сети предъявляется входной образ ai в результате формируется выходной образ di=bi;

Шаг 2: вычисляется вектор ошибки, в дальнейшем изменение вектора весовых коэффициентов должно быть пропорционально ошибке на выходе и равно 0 если ошибка равно 0;

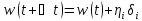

В дальнейшем изменение вектора весовых коэффициентов должно быть пропорционально ошибке на выходе и равно нулю, если ошибка равна нулю соответственно

,

где

,

где

- тем обучения.

- тем обучения.