- •Искусственный интеллект. Определения искусственного интеллекта. История развития искусственного интеллекта

- •Предпосылки развития науки искусственного интеллекта

- •Парадигмы искусственного интеллекта. Тест Тьюринга

- •Подходы к созданию интеллектуальных систем.

- •Направления развития искусственного интеллекта

- •Области применения искусственного интеллекта

- •Интеллектуальные системы. Основные понятия и определения. Структура интеллектуальной системы.

- •Модели и методы знаний. Структуры памяти эвм. Информационные структуры для хранения данных.

- •Модели представления данных.

- •Концепция знаний.

- •Модели представления знаний. Логические и сетевые модели.

- •Модели представления знаний. Продукционные и фреймовые модели.

- •Графы сетей Петри Скучная и непонятная теория из лекций

- •Наглядный пример Пример 1

- •Пример 2

- •Сети Петри: дерево достижимых разметок.

- •Оценка свойств сетей Петри на основе матричных уравнений.

- •Алгебра сетей Петри: операции над сетями Петри.

- •Расширения сетей Петри: ингибиторные, приоритетные, временные.

- •Способы описания сетей Петри.

- •Методы анализа сетей Петри. Задачи анализа.

- •Методы анализа сетей Петри. Дерево достижимых разметок.

- •Методы анализа сетей Петри. Анализ на основе матричных методов.

- •Проектирование сложных вычислительных структур. Структурный подход.

- •Матричные структуры. Преимущества матричных структур.

- •Примеры проектирование структур матричных процессоров на основе проекций процессорных элементов.

- •Построение параллельных матричных систем на примере умножения двух матриц.

- •Глубокое обучение. Принцип действия глубокого обучения. Геометрическая интерпретация глубокого обучения.

- •История машинного обучения. Вероятностное моделирование. Метод опорных векторов. Деревья решений.

- •Математические основы нейронных сетей.

- •Нейронные сети. Представление данных.

- •Нейронные сети. Представление данных. Примеры.

- •Нейронные сети. Операции с тензорами. Примеры.

- •Сверточные нейронные сети. Эффект границ. Шаг свертки.

- •Основные задачи в сфере компьютерного зрения.

- •Сверточные нейронные сети. Модульность, иерархия, многократное использование

- •Рекурентные нейронные сети. Класс задач, решаемых рекурентными нейронными сетями.

- •Рекурентные нейронные сети. Обработка естественных языков.

- •Генеративное глубокое обучение. Художественная обработка изображений.

- •Генетические алгоритмы. Основные понятия.

Матричные структуры. Преимущества матричных структур.

Оценим, в чем преимущество матричных процессоров.

Для этого определим - за сколько тактов будет выполнена операция умножения А(3,3) × В(3,3) на однопроцессорном компьютере.

Будем считать, что за один такт происходят операции умножения элементов матриц А и В (αik × bkj) , а также сложение полученного произведения с частичной суммой.

Что такое частичная сумма?

c'11 = α11×b11 и c’’11 = α11×b11 + α12×b21

-это примеры частичных сумм.

-

c11 = α11×b11 + α12×b21 + α13×b31

-полная сумма, описывающая получение элемента с11 матрицы С.

Примеры проектирование структур матричных процессоров на основе проекций процессорных элементов.

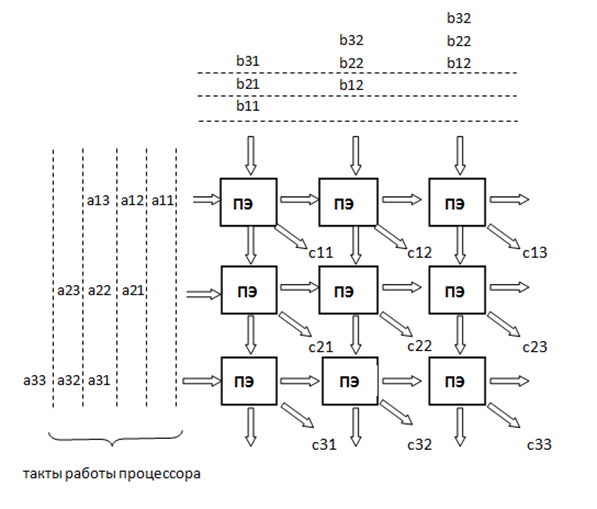

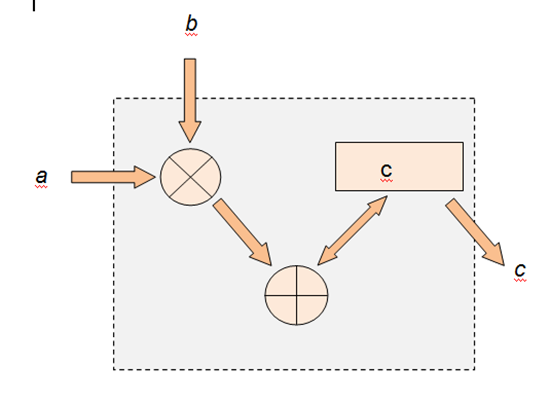

Пусть матричный процессор и соответствующий процессорный элемент (ПЭ) имеют следующий вид:

рис- Матричный процессор

Рис-Структура процессорного элемента

Построение параллельных матричных систем на примере умножения двух матриц.

С помощью матричных методов можно показать, что если СП живая и ограниченная, то она должна быть последовательной и инвариантной. Данные свойства недостаточны для утверждения живости и ограниченности СП. Однако их полезно проверить исходя из матриц инцидентности, так как если одно из этих свойств не подтверждается, то можно заключить, что описываемая система содержит некоторые недоработки.

Введем в рассмотрение матрицу С , которая поучается следующим образом:

C=HT-F, где HT - транспонированная матрица H.

Пусть размерность С равна n x m , где m и n - мощности множеств Р и Т .

Рассмотрим матричные уравнения:

y*C=0, (1)

C*x=0, (2)

где у и x - векторы, размерность которых равна n и m соответственно.

Вектор у, удовлетворяющий решению уравнения (1), все элементы которого положительны, называется р-цепью; р-цепь, все элементы которой больше нуля, называется полной р-цепью. Аналогично на основе уравнения (2) определяются понятия t-цепи и полной t-цепи. СП, для которой существует полная р-цепь, называется инвариантной. СП, для которой существует полная t-цепь, называется последовательной.

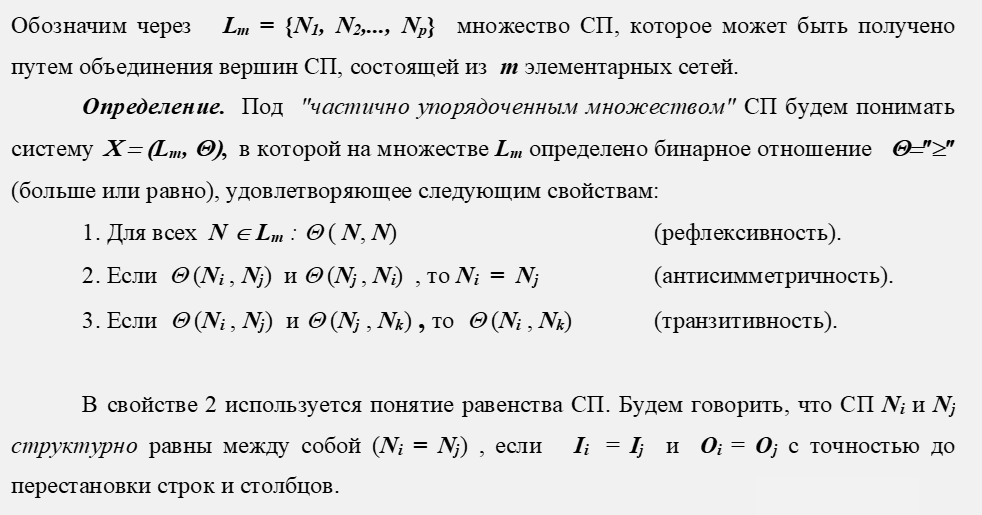

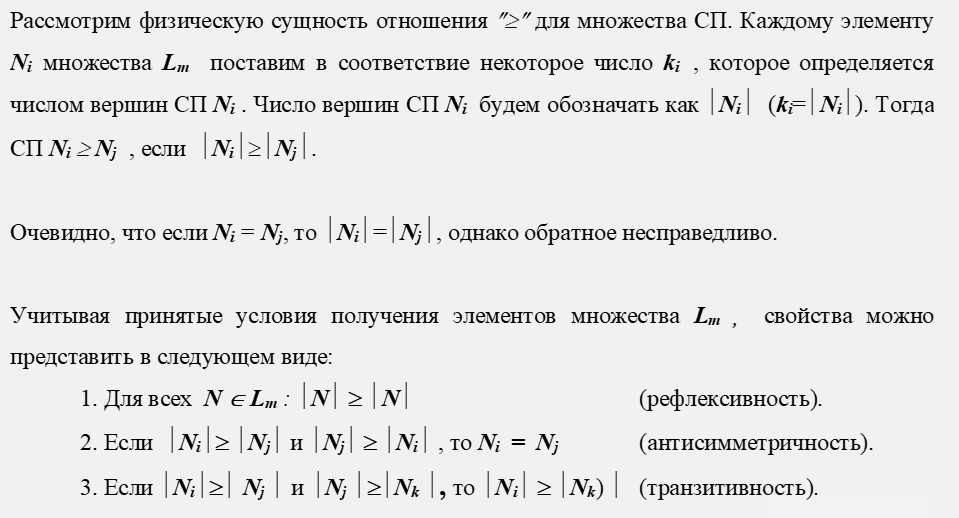

Анализ и синтез СП-моделей сложных систем. Декомпозиция моделей.

Синтез СП-моделей сложных систем. Типы геометрий.

Построение тензорных уравнений.

Синтез СП-моделей. Программы синтеза.

Синтез СП-моделей. Редукция сетей Петри.

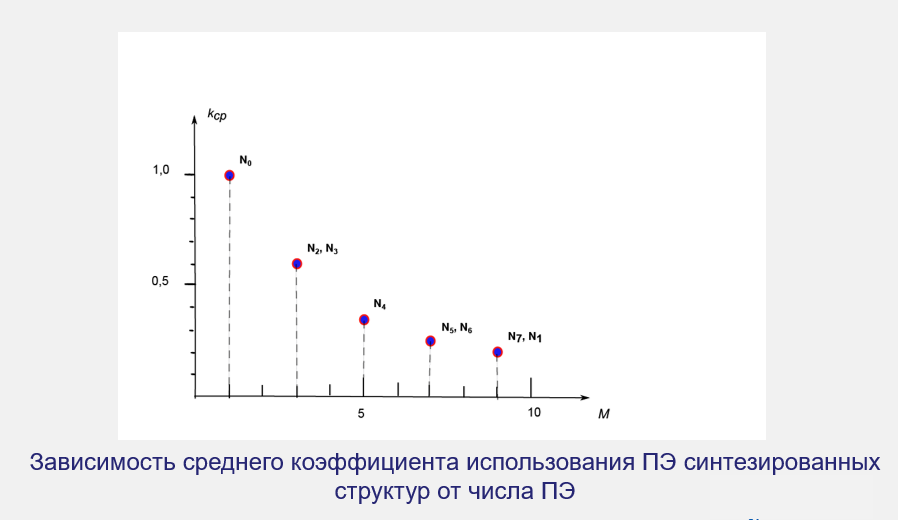

Сравнительная оценка синтезированных сетей Петри.

Машинное обучение. Основные понятия.

Машинное обучение меняет ситуацию: машина просматривает входные данные и соответствующие ответы и выясняет, какими должны быть правила. В машинном обучении система обучается, а не программируется явно. Ей передаются многочисленные примеры, имеющие отношение к данной задаче, а она находит там статистическую структуру, которая позволяет выработать соответствующие правила для решения этой задачи.

Машинное обучение выявляет правила решения задач обработки данных по примерам ожидаемых результатов. То есть при этом нужны три составляющие:

- контрольные входные данные — например, если решается задача распознавания речи, такими данными могут быть файлы с записью речи разных людей. Если нужно классифицировать изображения, понадобятся соответствующие изображения;

- примеры ожидаемых результатов — в задаче распознавания речи это обычно транскрипции звуковых файлов, составленные людьми.

- способ оценки качества работы алгоритма — необходим для определения того, как сильно отклоняются результаты, возвращаемые алгоритмом, от ожидаемых. Оценка используется в качестве сигнала обратной связи для корректировки работы алгоритма. Этот этап корректировки мы и называем обучением.

Обучение в контексте машинного обучения описывает процесс автоматического поиска преобразований, создающих полезные представления определенных данных, который управляется сигналом обратной связи — представлениями, подчиненными более простым правилам решения поставленной задачи.

Алгоритмы машинного обучения обычно не выделяются чем-то особенным: они просто выполняют поиск в предопределенном наборе операций, который называют пространством гипотез.

Технически машинное обучение — это поиск значимого представления и правил по некоторым входным данным в предопределенном пространстве возможностей с использованием сигнала обратной связи.