- •Элементы теории погрешностей.

- •1.1.Определение абсолютной и относительной погрешности численного результата.

- •1.2.Основные составляющие абсолютной погрешности.

- •1.3.Формулы для оценки абсолютной и относительной погрешности для значения функции и переменных.

- •Решение уравнений с одной неизвестной.

- •2.1.Отделение корней уравнения и отделение корней алгебраического уравнения.

- •2.2.Понятие кратного корня.

- •2.3.Методы уточнения корней простой итерации.

- •2.4.Метод Ньютона.

- •2.5.Метод хорд.

- •2.6.Достаточное условие сходимости метода простой итерации.

- •Вывод условия сходимости:

- •2.7.Оценка погрешности n-приближения.

- •Решение систем линейных уравнений.

- •3.1.2.Классификация слау

- •3.1.3.Обусловленность слау

- •3.1.Метод Гаусса.

- •3.2.Метод прогонки.

- •3.3.Метой простой итерации. Приведение системы к итерационной форме

- •Выполнение итерации

- •Проверка условия окончания решения

- •3.4.Достаточное условие сходимости простой итерации.

- •3.5.Оценка погрешности n-приближения.

- •4.1.Метод простых итераций.

- •1) Функции 1(X,y) и 2(X,y) определены и непрерывно дифференцируемы в r;

- •3) В r выполнены неравенства

- •4.2.Метод Ньютона.

- •Интерполяция функций.

- •5.1.Постановка задачи.

- •5.2.Формула Лагранжа.

- •5.3.Формула Ньютона.

- •5.4.Оценка погрешности интерполяции.

- •5.5.Интерполяция сплайнами.

- •Определение кубического сплайна.

- •Формулировка системы уравнений для коэффициентов кубического сплайна.

- •Аппроксимация функций.

- •6.1.Постановка задачи.

- •6.2.Метод наименьших квадратов.

- •6.3.Матричная формула для коэффициентов многочлена аппроксимации.

- •Численное интегрирование.

- •8.1.Формулы прямоугольников, трапеций, парабол (Симпсона). Оценки погрешностей. Методы прямоугольников

- •Метод трапеций

- •Метод парабол

- •8.2.Метод Рунге двойного счета для оценки погрешности.

- •Методы решения задачи Коши для обыкновенного дифференциального уравнения.

- •9.1.Интегральное представление задачи Коши.

- •10.1.Обусловленность задачи поиска минимума.

- •10.3.Метод золотого сечения.

- •10.4.Метод координатного спуска.

- •10.5.Метод наискорейшего спуска.

10.3.Метод золотого сечения.

На каждом шаге, за исключением первого, вычисление значения функции f(x) производится лишь один раз. Эта точка называется золотым сечением и выбирается специальным образом.

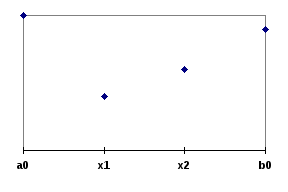

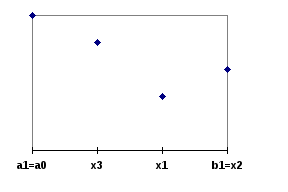

Геометрическая идея метода:

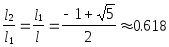

Вывод соотношения золотого сечения:

Пусть длина интервала неопределенности равна l, а точка деления делит его на части l1, l2 : l1 > l2, l = l1 + l2 .Золотое сечение интервала неопределенности выбирается так, чтобы длины большего отрезка к длине всего интервала равнялось отношению длины меньшего отрезка к длине большего отрезка:

Из этого соотношения можно найти точку деления, определив отношение l2/l1 .Для этого

l12 = l2 * l l12 = l2 * (l1 + l2)

l22 + l1 * l2 - l12 = 0

Так как интерес представляет только положительное решение, то

Отсюда l1 0.618*l, l2 0.382*l .

На первом шаге исходный интервал неопределенности равен d0 = b0 - a0 .При этом x1 - a0 = b0 - x2 = 0.382*d0 и b0 - x1 = x2 - a0 = 0.618*d0 .

После первого шага оптимизации получается новый интервал неопределенности d1 = b1 - a1 = x2 - a0 = 0.618*d0 .

После второго шага оптимизации имеем d2 = b2 - a2 = b1 - x3 = 0.618*d1 = 0.6182 * d0 .

Используя полученные соотношения, можно записать координаты точек деления y и z отрезка [ak,bk] на k+1 шаге оптимизации (y < z):

y = 0.618*ak + 0.382*bk : z = 0.382*ak + 0.618*bk .

При этом длина интервала неопределенности равна

dk = bk - ak = 0.618k * d0 .

Процесс оптимизации заканчивается при выполнении условия dk < .При этом искомая величина лежит в интервале ak < xopt < bk. В качестве оптимального значения можно принять xopt = ak (или xopt = bk или xopt = (ak + bk)/2 ).

10.4.Метод координатного спуска.

10.5.Метод наискорейшего спуска.

1.

Выбор вектора начальных приближений

![]() и вычисление значения целевой функции

в этой точке (

и вычисление значения целевой функции

в этой точке (![]() ).

Выбор величины шага.

).

Выбор величины шага.

2. Вычисление нормированного вектора-градиента в этой точке.

3. Определение направления поиска по формуле

![]()

4.

Поиск любым методом одномерного поиска

точки

![]() ,

в которой функция имеет минимальное

значение (

,

в которой функция имеет минимальное

значение (![]() ).

).

5. Если выполняется условие:

![]() ,

,

то поиск прекращается и выводят полученные результаты. В противном случае выполняют этап 6.

6.

За новое начальное приближение принимают

найденную на этапе 4 точку (![]() =

=![]() ,

,![]() =

=![]() )

и расчеты повторяют с пункта 2.

)

и расчеты повторяют с пункта 2.

Выделить особенность метода: если первый же шаг из очередной начальной точки неудачен (функция возрастает), то, как правило, уменьшают шаг, т.е. h(k+1) = h(k) /z, где z > 1 . Условие окончания поиска при этом может быть записано в виде h(k) < .