- •Лекція №1

- •1.1 Опрацювання результатів прямих вимірювань

- •1.1.1 Принципові основи оцінювання похибок вимірювань

- •1.1.2 Оцінка результату і похибки прямих вимірювань

- •1.1.3 Оцінка похибки прямих одноразових вимірювань

- •1.1.4 Оцінка результату і похибки прямих багаторазових вимірювань

- •1.1.5 Опрацювання результатів прямих одноразових вимірювань

- •1.1.6 Опрацювання результатів багаторазових прямих вимірювань

- •1.1.7 Опрацювання результатів прямих нерівноточних вимірювань

- •1.2 Опрацювання результатів опосередкованих вимірювань

- •1.2.1 Оцінка результату і похибки опосередкованих вимірювань

- •1.2.2 Опрацювання результатів опосередкованих вимірювань з лінійною залежністю

- •1.2.3 Опосередковані вимірювання при нелінійній залежності

- •1.2.4 Систематична похибка опосередкованих вимірювань при нелінійній залежності

- •1.2.5 Результат і похибка опосередкованих вимірювань

- •1.3 Оцінка результатів і похибок сумісних та сукупних вимірювань

- •Питання для самоперевірки

- •Лекція №2

- •2 Статистична перевірка гіпотез

- •2.1 Поняття статистичної гіпотези. Припустима і критична області. Статистичний критерій

- •Питання для самоперевірки

- •2.2 Гіпотези про параметри розподілу. Виникнення помилок першого та другого роду. Визначення обсягу випробувань

- •Питання для самоперевірки

- •2.3 Параметричні критерії розбіжностей для двох сукупностей. Критерії Фішера і Кохрена

- •Питання для самоперевірки

- •2.4 Критерії згоди

- •Питання для самоперевірки

- •2.5 Непараметричні критерії

- •Питання для самоперевірки

- •2.6 Перевірка гіпотез відносно частки ознаки порівняння двох вибірок

- •Питання для самоперевірки

- •Завдання планування експерименту

- •Лукція №3

- •3. Регресійний аналіз

- •3.1 Кореляційна залежність

- •3.2 Два основних завдання вимірювання зв’язків

- •3.3 Емпірична лінія регресії

- •3.4 Метод найменших квадратів

- •3.5 Множинний регресійний аналіз

- •3.6 Нелінійна регресія

- •Лекція №4

- •4. Активний експеримент

- •4.1 Ортогональні плани першого порядку

- •4.2 Повний факторний експеримент

- •4.3 Дисперсія відтворюваності

- •4.4 Оцінка адекватності апроксимуючої залежності досліджуваного

- •4.5 Оцінка значущості коефіцієнтів апроксимуючої залежності, взятій у вигляді алгебраїчного полінома, в сенсі відмінності значень цих коефіцієнтів від нуля

- •4.6 Обробка результатів експерименту

- •4.7 Дрібний факторний експеримент

- •4.8 Складання планів другого порядку

- •4.9 Ортогональні центрально-композиційні плани

- •Лекція №5

- •5. Планування експерименту при відшуканні екстремальної області

- •5.1 Класичні методи визначення екстремуму

- •5.2 Факторні методи визначення екстремуму

- •Лекція №6

- •6. Дисперсійний аналіз при експериментальному дослідженні

- •6.1 Однофакторний дисперсійний аналіз

- •Лекція №7

- •7. Приклади та завдання

- •Список літератури

Питання для самоперевірки

-

Які критерії називаються непараметричними?

-

Яка гіпотеза перевіряється за допомогою критерію Уїлкоксона?

-

Що таке інверсія і як вона визначається?

-

Як двома способами за допомогою критерію Уїлкоксона перевірити правильність гіпотези?

-

Як визначається критичне значення й критична область для критерію Уїлкоксона?

-

Що таке медіана? Як вона визначається для вибіркових значень?

-

Що таке серія знаків та як вона визначається ?

-

Як визначаються критичне значення та критична область для критерію знаків?

2.6 Перевірка гіпотез відносно частки ознаки порівняння двох вибірок

Критерії цієї групи дають змогу використовувати частку ознак і приймати рішення про властивість генеральної сукупності та відповідність нормам.

Будемо розглядати задачі: порівняння частки ознаки з нормативним значенням (стандартом) та порівняння частки ознаки у двох сукупностях.

Порівняння частки ознаки з нормативним значенням. Нехай потрібно перевірити гіпотезу, що частка р деякої ознаки у генеральній сукупності дорівнює деякому нормативному значенню α, тобто висувається нуль-гіпотеза Н0: р = α при альтернативній гіпотезі Н1: р≠α. Для перевірки гіпотези Н0 застосовують двобічний критерій, оскільки порушення гіпотези Н0 може бути як у разі р > α, так і в разі р < α. Як критерій застосовуємо статистику

![]()

де n — загальна кількість випробувань; m — кількість позитивних результатів, W — частота.

Ця статистика при будь-якому n розподілена за біноміальним (для вибірки з поверненням) або за гіпергеометричним (для вибірки без повернення) законом розподілу. Однак при достатньо великому n при розрахунках можна скористатися асимптотичними розподілами, найчастіше — нормальним.

Виходячи з нормального закону розподілу при заданому рівні значущості α значення z знаходять із таблиць нормального розподілу згідно з рівністю:

![]()

Узявши

до уваги, що для біноміального закону

![]() а

також, що q=1-р

і

для розглянутого випадку вихідним

припущенням p=α,

дістанемо

вираз

а

також, що q=1-р

і

для розглянутого випадку вихідним

припущенням p=α,

дістанемо

вираз

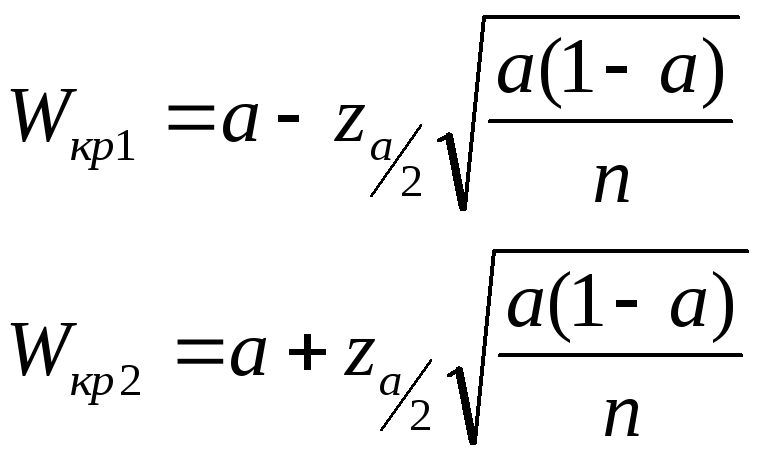

![]()

який надалі можна використати для знаходження надійних меж для W. Критичні точки в цьому випадку

Якщо вибіркова частість W буде в межах [W1, W2], гіпотеза H0 приймається.

У випадку, коли перевіряють альтернативну гіпотезу Н1: р>α, використовують однобічну критичну область із граничним значенням z згідно з рівнянням

![]()

Приклад. Перевіряється внесок деякого компонента до складу продукції.

-

Перевірити відповідність вкладу складової 10%-ному стандартному значенню, тобто перевірити гіпотезу H0: р = 0,1.

-

Перевірити, що наявність цього компонента у продукції не перевищує 10%, тобто перевірити гіпотезу Н1: р>α.

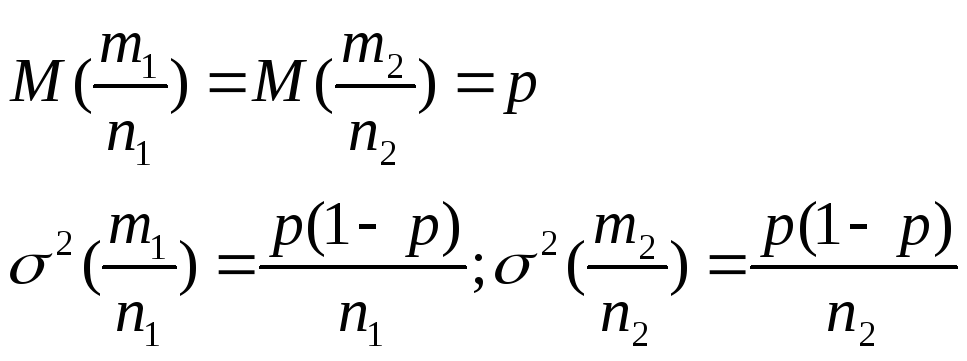

Порівняння частки ознаки у двох сукупностях. Припустимо, що маємо m1/n1 та m2/n2 частки однієї ознаки у двох сукупностях з n1 та n2 одиниць. Висувається гіпотеза H0: розбіжність між m1/n1 та m2/n2 є результатом впливу випадкових факторів та обмеженого обсягу вибірок.

Розглянемо випадок великих вибірок. Якщо n1 та n2 більші за 30, то розподіл вибіркових частостей при виконанні припущення про нульову розбіжність буде близьким до нормального з параметрами

Для перевірки гіпотези застосовують статистику

![]()

Статистика W також може бути подана за допомогою нормального закону з параметрами

Для перевірки гіпотези H0 будемо використовувати двобічний критерій. Задаючись рівнем значущості α, знаходимо z згідно з рівнянням

![]()

а потім визначимо критичні точки

де

![]() — оцінка p,

яку отримують на підставі наявних

даних двох вибірок.

— оцінка p,

яку отримують на підставі наявних

даних двох вибірок.

Якщо вибіркове значення W вміститься в інтервалі [Wкр1, Wкр2], то гіпотеза про несуттєвість розбіжності приймається.

Розглянемо

випадок малих

вибірок. Якщо

n1

та

n2

-

малі числа, то використання нормального

розподілу для статистики

![]() є

хибним. У цьому випадку необхідно

використовувати критерій χ2

за допомогою якого, як було показано

раніше, при ідентифікації законів

розподілу можна визначити розбіжність

між теоретичними і вибірковими

частками.

є

хибним. У цьому випадку необхідно

використовувати критерій χ2

за допомогою якого, як було показано

раніше, при ідентифікації законів

розподілу можна визначити розбіжність

між теоретичними і вибірковими

частками.

Для

розглянутого випадку χ2

обчислюється

в такий спосіб. Припустимо, що нас

цікавить деяка ознака А.

Беруть

дві сукупності обсягами n1

та

n2

і

результати для позитивних А

і

негативних ![]() наслідків

заносять у табл. 2.1.

наслідків

заносять у табл. 2.1.

У

таблиці ![]() 1,

і

1,

і ![]() 2

—

кількість елементів у кожній вибірці,

які це мають ознаки А.

Виходячи

з припущення, що вибірки взято з тієї

самої генеральної сукупності з часткою

ознаки р,

можна

визначити

теоретичні

частоти, які відповідають фактичним

частотам pn1,

(1-p)n1,

pn2,

(1-p)n2.

2

—

кількість елементів у кожній вибірці,

які це мають ознаки А.

Виходячи

з припущення, що вибірки взято з тієї

самої генеральної сукупності з часткою

ознаки р,

можна

визначити

теоретичні

частоти, які відповідають фактичним

частотам pn1,

(1-p)n1,

pn2,

(1-p)n2.

Таблиця 2.1

|

Сукупність |

Фактичні частоти |

Оцінки теоретичних частот |

|||

|

А |

|

Усього |

А |

|

|

|

Вибірка 1 |

m1 |

|

n1 |

pn1 |

(1-p)n1 |

|

Вибірка 2 |

m2 |

|

n2 |

pn2 |

(1-p)n2 |

|

Усього |

m1+ m2 |

|

n1+ n2 |

-- |

-- |

В

останніх двох рядках табл. 19.1 наведені

оцінки теоретичних частот, де замість

р

використовується

![]() =

(m1,

+m2)/(nІ

+

n2).

=

(m1,

+m2)/(nІ

+

n2).

На підставі даних, наведених у табл. 19.1, можна обчислити χ2 за формулою:

![]()

де у знаменниках записано оцінки відповідних дисперсій.

Беручи до уваги, що між чотирма теоретичними частотами існує три незалежні співвідношення, у розподілі χ2 необхідно враховувати тільки один ступінь свободи.

Якщо

нульова гіпотеза, відповідно до якої

обидві сукупності є вибірками з однієї

генеральної сукупності, правильна, то

розбіжність між теоретичними та

дослідними частотами можна віднести

тільки на рахунок випадкового відбору.

Тому, визначивши для рівня значущості

α

значення χ2,

приймемо рішення про відхилення гіпотези

H0,

якщо![]() ,

незначущість розбіжності при

,

незначущість розбіжності при

![]() .

.

Приклад. Проводились випробування нового методу лікування. Одна група (експериментальна) — з 50 осіб (n1 = 50) лікувалася за новим методом, а друга («традиційна»), яка складалася з 30 осіб (n2 = 30), — за традиційним методом. Після завершення лікування у першій групі залишилося 9 хворих (m1=9), а в другій — 7 (m2=7). Необхідно перевірити суттєвість ефективності нового методу.

Обчислимо оцінку теоретичної частоти хворих після лікування:

![]()

Позначимо

позитивний результат для хворого —

«вилікувалися за зазначений період»

як подію А,

тоді

— «залишилися хворими» буде ![]() .

Вихідні дані та отримані результати

наведено в табл. 2.2.

.

Вихідні дані та отримані результати

наведено в табл. 2.2.

Таблиця 2.2

|

Групи, що обстежуються |

Результати досліджень |

Усього |

Теоретичні результати |

||

|

А |

|

|

А |

|

|

|

Експериментальна |

9 |

41 |

50 |

10 |

40 |

|

«Традиційна» |

7 |

23 |

30 |

6 |

24 |

|

Усього: |

16 |

64 |

80 |

|

|

Розрахунок

теоретичної кількості позитивних

результатів будемо проводити відповідно

за виразами ![]() та

та

![]() .

Внесемо

у табл. 19.2 оцінку

.

Внесемо

у табл. 19.2 оцінку ![]() теоретичної

кількості А

та

теоретичної

кількості А

та

![]() .

Виходячи

з даних, наведених у табл. 19.2,

обчислимо значення критерію:

.

Виходячи

з даних, наведених у табл. 19.2,

обчислимо значення критерію:

![]()

Скориставшись

таблицями розподілу χ2,

для

α=

0,05 та ступеня свободи f=1,

знайдемо критичне значення χ2кр

=3,8. Таким чином,

![]() ,

тобто робимо

висновок, що розбіжність частки хворих,

які залишилися в обох групах після

закінчення терміну лікування, не значуща,

а отже, новий метод лікування дає такий

самий ефект, як і традиційний.

,

тобто робимо

висновок, що розбіжність частки хворих,

які залишилися в обох групах після

закінчення терміну лікування, не значуща,

а отже, новий метод лікування дає такий

самий ефект, як і традиційний.

Порівняння двох залежних вибірок (парні зіставлення). У практиці статистичної перевірки гіпотез часто трапляються випадки, коли дві вибірки, які порівнюються, не можуть розглядатися як незалежні.

Приклад. Перевірка ефективності нової технології за результатами роботи тієї самої бригади до і після впровадження нової технології.

Приклад. Оцінка стану хворих до і після прийняття нових ліків. Проводячи реєстрацію по кожному об'єкту спостережень до нововведення — х і після нього —у, дістаємо два ряди спостережень:

|

x1 |

x2 |

… |

xi |

… |

xn |

|

y1 |

y2 |

… |

yi |

… |

yn |

Таким чином, ідеться про парні спостереження, тобто про n зв'язаних пар (хi, уi). Якщо досліджуваний фактор впливає тільки на одну з ознак х або у, то між цими парами спостережень фіксуватиметься суттєва розбіжність. Завдання полягає в тому, щоб визначити, коли розбіжність між парами спостережень можна віднести на рахунок випадкових відхилень, а коли вона суттєва і її потрібно пов'язувати з впливом якогось фактору.

Нехай

різниця між спостереженнями в кожній

парі становить ![]() Тоді

узагальненою величиною розбіжності

пар спостережень може бути середня

різниця

Тоді

узагальненою величиною розбіжності

пар спостережень може бути середня

різниця

![]() (2.21)

(2.21)

Чим

менша різниця ![]() ,

тим більш правдоподібне припущення

щодо несуттєвості розбіжності між

рядами спостережень. Таким чином,

перевірці підлягає гіпотеза H0:

,

тим більш правдоподібне припущення

щодо несуттєвості розбіжності між

рядами спостережень. Таким чином,

перевірці підлягає гіпотеза H0:![]() .

Критерієм для перевірки може бути

статистика

.

Критерієм для перевірки може бути

статистика

![]() (2.22)

(2.22)

де

![]()

При

нормальному розподілі різниць ![]() t-статистика

має розподіл Стьюдента з кількістю

ступенів свободи n

-

1. Подальший механізм перевірки не

відрізняється від перевірки розбіжності

середніх.

t-статистика

має розподіл Стьюдента з кількістю

ступенів свободи n

-

1. Подальший механізм перевірки не

відрізняється від перевірки розбіжності

середніх.

Перевірку гіпотез широко використовують у дисперсійному аналізі та в теорії кореляції, де перевіряють гіпотези про значущість відповідних параметрів, наявність стохастичного зв'язку, суттєвість впливу випадкових величин тощо.