- •Устройство биологического нейрона и его математическая модель.

- •Детерминированная и стохастическая модели искусственного нейрона

- •Нейрон с сигмоидальной функцией активации

- •Стохастическая модель нейрона

- •Представление знаний.

- •Классы задач, решаемые нс. Примеры.

- •Классификация нс по архитектуре.

- •Однослойные сети прямого распространения

- •Многослойные сети прямого распространения

- •7.3.3.Рекуррентные сети

- •Классификация нс по парадигме обучения.

- •Обучение с учителем

- •Обучение без учителя

- •7.Понятие обучающей выборки (вектора)

- •8.Применимость различных активационных функций нейрона

- •1.1.1.1Активационные функции

- •9.Однослойные сети прямого распространения

- •10.Многослойные сети прямого распространения

- •11.Рекуррентные сети

- •12.Парадигмы обучения нс. Обучение с учителем. Применимость, примеры.

- •Обучение с учителем

- •13.Парадигмы обучения нс. Обучение без учителя. Применимость, примеры.

- •14.Парадигмы обучения нс. Смешанное обучение. Применимость, примеры.

- •15.Парадигмы обучения нс. Обучение Хебба. Математическая модель

- •16. Парадигмы обучения нс. Гипотеза ковариации. Математическая модель

- •17.Парадигмы обучения нс. Конкурентное обучение. Математическая модель

- •18.Парадигмы обучения нс. Обучение методом обратного распространения ошибки. Математическая модель

- •19. Парадигмы обучения нс. Обучение Больцмана. Математическая модель

- •20. Персептрон Розенблатта. Алгоритм обучения однослойного персептрона

- •21. Персептрон Розенблатта. Теорема о сходимости и «зацикливании» персептрона.

- •22. Персептрон Розенблатта. Дельта -правило

- •23. Многослойный персептрон. Теорема о двуслойности персептрона

- •24. Самоорганизующиеся карты Кохонена. Алгоритм обучения нс

- •Самоорганизующиеся карты Кохонена. Квантование обучающего вектора.

- •1.2Квантование обучающего вектора (Learning VectorQuantization)

- •Самоорганизующиеся карты Кохонена. Кластеризация

- •Сеть Хопфилда. Архитектура, обучение

- •1.2.1Алгоритм функционирования сети

- •1.2.2Архитектура сети

- •1.2.3Обучение сети

- •28. Сеть Хемминга. Архитектура, обучение

- •1.2.4Алгоритм функционирования сети Хемминга

- •Rbf сети. Архитектура. Применимость.

- •Rbf сети. Алгоритм обучения. Расчет опорных точек, параметра рассеяния и выходной весовой матрицы

- •Rbf сети. Аппроксимация

- •Ассоциативная сеть. Сжатие информации

- •Структура дап

8.Применимость различных активационных функций нейрона

1.1.1.1Активационные функции

Активационная функция нейрона определяет нелинейное преобразование, осуществляемое нейроном.

Существует множество видов активационных функций, но более всего распространены следующие четыре:

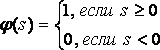

1. Пороговая функция. На рис. 7.2, априведен ее график.

.

(7.5)

.

(7.5)

Первая из введенных активационных функций, она была описана в работе Мак-Каллока и Питтса. В честь этого модель нейрона с пороговой активационной функцией называется моделью Мак-Каллока-Питтса.

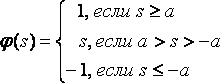

2. Кусочно-линейная функция. Она изображена на рис. 7.2, б и описывается следующей зависимостью:

.

(7.6)

.

(7.6)

В данном случае a=1, и коэффициент наклона линейного участка выбран единичным, а вся функция может интерпретироваться как аппроксимация нелинейного усилителя. При бесконечно большом коэффициенте наклона линейного участка функция вырождается в пороговую.

В

большинстве типов искусственных

нейронных сетей используются

нейроны с линейной активационной

функцией ![]() ,

представляющей собой частный

случай (7.6) с неограниченным линейным

участком.

,

представляющей собой частный

случай (7.6) с неограниченным линейным

участком.

Рис. 7.2. Типы активационных функций а), г) пороговая; б) линейная; в) сигмоидальная; д) тангенциальная; е) радиально-базисная активационные функции

3. Сигмоидальная функция. Это наиболее широко используемый тип активационной функции. Она была введена по аналогии с пороговой функцией, но везде является строго монотонно возрастающей, непрерывной и дифференцируемой (рис. 7.2, в). Дифференцируемость является важным свойством для анализа нейронной сети и некоторых методов их обучения.

В общем виде сигмоидальная активационная функция описывается зависимостью:

![]() ,

(7.7)

,

(7.7)

где a — параметр, определяющий наклон функции.

Варьированием его могут быть получены разные виды сигмоида. Наиболее часто используется a = 1. В случае бесконечно большого a сигмоидальная функция вырождается в пороговую.

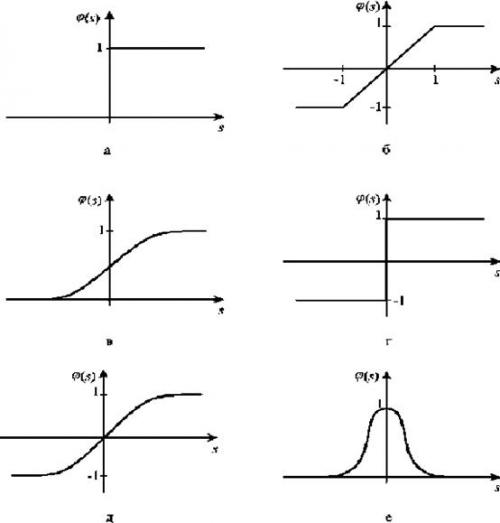

Помимо перечисленных функций, изменяющихся в диапазоне [0, 1], вводятся также их аналоги с областью значений [–1, 1]. Так, например (рис. 7.2, г), пороговая функция может быть переопределена как

.

(7.8)

.

(7.8)

То есть

![]() .

(7.9)

.

(7.9)

Вместо сигмоидальной активационной функции широко применяется гиперболический тангенс, обладающий аналогичными свойствами (рис. 11, д)

![]() .

(7.10)

.

(7.10)

Нечетность этой функции делает ее удобной для решения задач управления.

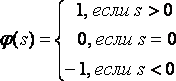

4. Во введенных Брумхеадом и Лоуе нейронных сетях в качестве активационной применяется функция Гаусса(рис. 7.2, е)

![]() .

(7.11)

.

(7.11)

Ее аргумент рассчитывается по формуле:

![]() ,

(7.12)

где

,

(7.12)

где

z — вектор входных сигналов нейрона,

c — вектор координат центра окна активационной функции,

s — ширина окна,

|| || — евклидово расстояние.

В теории нейронных сетей активационные функции типа

![]() (7.13)

(7.13)

называются радиально-базисными функциями (РБФ), а основанные на них сети — РБФ-сетями (RBF — radial basis function).