tt

.pdfОсуществляя замену переменных m+h=r, указанное

соотношение будет иметь вид Так как

|

1 |

N h 1 |

|

|

Cz (k) W kh{ |

X (r)W kr } |

|

||

N |

. |

|||

|

r h |

q |

N 1 |

|

X (m)W km X (m)W km |

||

m p |

m 0 |

, |

q |

N 1 |

|

Cx (k)W km Cx |

(k)W km |

|

m p |

m 0 |

, когда p и q удовлетворяют условию |

|p-q|=N-1, то Cz(k)=W -khCx(k). Аналогично при Z(m)=X(m-h) , Cz(k)=W khCx(k).

Можно выделить следующие области применения ДПФ:цифровой спектральный анализ

oанализаторы спектра

oобработка речи

oобработка изображений

oраспознавание образов

проектирование фильтров

oвычисление импульсной характеристики по частотной

oвычисление частотной характеристики по импульсной

быстрое преобразование Фурье (БПФ) – простой алгоритм для эффективного вычисления ДПФ.

Функция активации используется для

ограничения выхода нейрона в заданном диапазоне и для нелинейного преобразования взвешенной суммы. Последнее позволяет нейронному классификатору аппроксимировать любую нелинейную границу между классами в пространстве образов. Функция активации выбирается для конкретной задачи и является неизменной характеристикой отдельного нейрона.

Могут использоваться следующие функции активации и их гибриды:

1) линейная функция y=Ax;

|

|

|

|

|

|

|

|

|

|

|

|

1, x 0 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

y |

|

|

|

|||

2) пороговая функция |

0, x 0 ; |

|

|

|

||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

1, x 0 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

y |

|

|

3) биполярная пороговая функция |

|

1, x 0 ; |

||||||||||||||

4) сигмоидная функция (рис. 29.2) |

|

|

|

|||||||||||||

y |

|

1 |

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

e x ) ; |

|

|

|

|

|

|

|

||||||||

(1 |

|

|

|

|

|

|

|

|||||||||

(29.2) |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

1 |

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

1 exp( x) |

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

2 |

|

5 |

|

|

0 |

5 |

|

|||||||

|

|

|

|

|

|

1 |

|

|

|

|

|

|

|

|

||

|

|

|

|

1 exp( x) |

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

x |

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

Рис. 7.2. Сигмоидные функции активации

5) биполярная сигмоидная функция (см. рис. 29.2)

y |

2 |

1 ; |

|

||

(1 e x ) |

||

|

(29.3) |

|

6) гиперболический тангенс (рис. 29.3)

y th(x) ex e x ex e x .

(29.4)

1

tanh(x) |

5 |

0 |

5 |

|

1

x

Рис. 7.3. Гиперболический тангенс

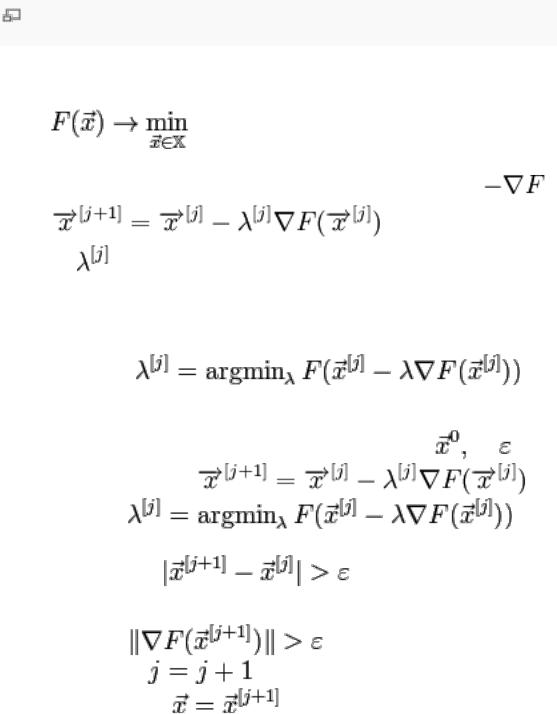

Градиентный спуск —

методнахождениялокального экстремума(минимума или максимума)функции помощью движения градиевдоль нта. Для минимизации функции в направлении градиента используютсяметоды одномерной оптимизац, например,иметод золотого

сечения. Также можно искать не наилучшую точку в направленииградиент либо лучше текущей.

Пустьцелевая функцияимеет вид:

.

.

И задача оптимизаданации следующим образом:

Основная идея метода заключается в том, чтобы идти в направлен

наискорейшего спуска, а это направлениеантиградиентом |

: |

где выбирается

постоянной, в этом случае метод может расходиться;

дробным шагом, т.е. длина шага в процессенекоеспускачисло;делится на

наискорейшим

спуском:

Алгоритм[править| править исходны]й текст

1. Задают начальное приближение и точность расчёта

2. Рассчитывают ,

где

3.Проверяют условие остановки:

Если

,  или

или

|

(выбирают одно из условий), |

то |

и переход к шагу 2. |

Иначе |

и останов. |