- •Раздел 1. Основные понятия информатики

- •Тема 1 Основные понятия информатики

- •Тема 2. Информация, ее виды и свойства

- •Структура современной информатики

- •Место информатики в системе наук

- •Тема 2: Информация, ее виды и свойства

- •5. Различные уровни представлений об информации

- •6. Информация, ее виды и свойства.

Структура современной информатики

Составные части современной информатики – это теоретическая информатика, вычислительная техника, программирование, информационные системы и искусственный интеллект.

Теоретическая информатика - часть информатики, включающая ряд математических разделов. Она опирается на математическую логику и включает такие разделы, как теория алгоритмов и автоматов, теорию информации и теорию кодирования, теорию формальных языков и грамматик, исследование операций и другие. Этот раздел информатики использует математические методы для общего изучения вопросов обработки информации.

Вычислительная техника – раздел, в котором разрабатываются общие принципы построения вычислительных систем. О разработке новых архитектур вычислительных систем, определяющий состав, назначение, функциональные возможности и принципы взаимодействия устройств. Примеры - неймановская архитектура компьютеров первых поколений, шинная архитектура ЭВМ старших поколений, архитектура параллельной (многопроцессорной) обработки информации.

Программирование – деятельность, связанная с разработкой систем программного обеспечения. Можно отметить среди системного – разработка новых языков программирования и компиляторов к ним, разработка интерфейсных систем(Windows).Среди прикладного обеспечения – системы обработки текстов, электронные табличные процессоры, графические редакторы.

Информационные системы – раздел информатики, связанный с решением по анализу потоков информации в различных сложных системах, их оптимизации, структурировании, принципах хранения и поиска информации. Информационно-справочные системы, информационно-поисковые системы, глобальные системы хранения и поиска информации Internet, WWW.

Искусственный интеллект – область информатики, в которой решаются сложнейшие проблемы, находящиеся на пересечении с медициной, психологией, физиологией, лингвистикой и другими науками.

Основные направления разработок в этой области – это моделирование рассуждений, компьютерная лингвистика, машинный перевод, создание экспертных систем, распознавание образов.

Место информатики в системе наук

Рассмотрим место науки информатики в системе наук – технических, естественных, гуманитарных. Академик Б.Н.Наумов определял информатику «как естественную науку, изучающую общие свойства информации, процессы, методы и средства ее обработки (сбор, хранение, преобразование, перемещение, выдача)».

К фундаментальным принято относить те науки, основные понятия которых носят общенаучный характер, используются во многих других науках и видах деятельности.

Естественные науки – физика, химия, биология и другие – имеют дело с объектами сущностями мира, существующими независимо от нашего сознания. Отнесение к ним информатики отражает единство законов обработки информации в системах самой разной природы – искусственных, биологических, общественных.

Рисунок 1.2 – место информатики в системе наук

Тема 2: Информация, ее виды и свойства

План:

Информация, ее виды и свойства.

Различные уровни представлений об информации.

Носители данных. Операции с данными.

Понятие информация является одним из фундаментальных в современной науке вообще и базовым для изучаемой нами информатики. Информация – это совокупность каких – либо сведений, данных, передаваемых устно (в форме речи), письменно (в виде текста, таблиц, рисунков, чертежей, схем, условных обозначений и т.д.) либо другим способом (например, с помощью звукового или светового сигналов, электрических импульсов, запахов, перепадов давления или измерения температуры). В простейшем бытовом понимании с термином "информация" обычно ассоциируются некоторые сведения, данные, знания. Информация передается в виде сообщений.

Сообщения - это совокупность знаков или первичных сигналов, отображающих ту или иную информацию. Примерами сообщений являются - телепередача, музыкальные произведения, текст письма, результаты работы на ПК.

Передача сообщений на расстояние осуществляется с помощью какого-либо материального носителя (бумаги, фотопленки, магнитной ленты , магнитного диска и т.д.) или физического процесса(звуковых, световых или электромагнитных волн и т.п.). Таким образом, информация передается путем обмена между отправителем и получателем. Физический процесс, несущий передаваемое сообщение, называется сигналом.

Источник

передатчик

КА

КА

приемник

получатель

Канал связи

Линия связи

Сообщения могут быть функциями времени (информация представляется в виде первичных сигналов - музыка, речь, показания датчиков) или не являться функциями времени (информация представляется в виде совокупности знаков).

В современных системах связи чаще всего используются электрические или оптические сигналы. Передача информации осуществляется путем изменения какого-либо параметра сигнала в соответствии с передаваемым сообщением. Например, путем изменения амплитуды, частоты, фазы гармонических колебаний или длительности прямоугольных импульсов. Процесс изменения параметров сигнала на передающей стороне, происходящий в соответствии с содержанием передаваемого сообщения, называется модуляцией. Процесс восстановления сообщения из принятого сигнала называется демодуляцией.

Линией связи называется физическая среда, используемая для транспортировки сигналов от передатчика к приемнику. В качестве примера линии связи можно назвать оптоволоконный и коаксиальный кабели связи, пространство, в котором распространяются радиоволны. Совокупность технических средств, предназначенных для передачи сообщений от отправителя к получателю, называется системой связи. В качестве составных частей в систему связи входят передающее устройство(передатчик), канал связи и приемное устройство(приемник).

Отправителями и получателями информации могут быть субъекты (пользователи, абоненты, корреспонденты) и объекты (датчики, компьютеры, факс-модемы, принтеры, устройства автоматики).

Существуют каналы проводной связи (проводные, кабельные, световодные и др.) и каналы радиосвязи (телевизионные, радио- и сотовые станции). Широкое распространение получили радиорелейные линии (РРЛ). В РРЛ радиосигнал передается от одной станции к другой (ретранслируется). Разновидностью РРЛ являются тропосферные линии, которые используют отражения радиосигнала от неоднородностей тропосферы. Существуют спутниковые сети - радио релейные линии, в которых ретранслятор располагают на искусственном спутнике земли. Применительно к глобальной сети Интернет можно сказать, что она содержит самые разнообразные каналы связи, которые соединяют между собой узлы с коммутационным оборудованием и компьютерами-серверами.

Человеку свойственно субъективное восприятие информации через некоторый набор ее свойств: важность, достоверность, своевременность, доступность и т.д. Использование терминов "больше информации" или "меньше информации" подразумевает некую возможность ее измерения.

Виды информации

Непрерывная и дискретная информация

Чтобы сообщение было передано от источника к получателю, необходима некоторая материальная субстанция - носитель информации. Сообщение, передаваемое с помощью носителя, назвали сигналом. Процесс передачи содержит различные характеристики, которые назвали параметрами сигнала.

Когда параметр сигнала принимает последовательное во времени конечное число значений (они могут быть пронумерованы), сигнал называется дискретным, а сообщение, передаваемое с помощью таких сигналов - дискретным сообщением. Информация, передаваемая источником, в этом случае также называется дискретной. Если же источник вырабатывает непрерывное сообщение (соответственно параметр сигнала - непрерывная функция от времени), соответствующая информация называется непрерывной.

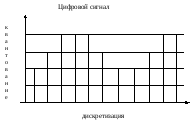

Различают две формы представления информации - непрерывную (аналоговую) и дискретную (цифровую). На рисунке 1. 3 схематично показан процесс преобразования аналогового сигнала в цифровой.

t

время t

Рисунок 1.3- Процесс преобразования аналогового сигнала в цифровой.

После преобразования непрерывный сигнал представляется последовательностью чисел: 2-3- 4 - 4 – 4 –3 – 2 –2 –3 – 4 – 4. Десятичные числа кодируются в последовательности 1 и 0. Результат представим в таблице1:

-

Время

Десятичные числа

Двоичные числа

2

0010

3

0011

4

0100

4

0100

4

0100

3

0011

2

0010

2

0010

3

0011

4

0100

4

0100

Таким образом, любое сообщение может быть представлено как дискретное, иначе говоря, последовательностью знаков некоторого алфавита. Возможность дискретизации непрерывного сигнала с любой желаемой точностью принципиально важна с точки зрения информации и ее обработки на ЭВМ, так как внутреннее представление информации в ней дискретно.

Единицы количества информации

Определить понятие "количества информации" довольно сложно. В решении этой проблемы существуют два основных подхода. Американский математик Клод Шеннон развил вероятностный подход к измерению количества информации, а работы по созданию ЭВМ привели к "объемному подходу".

Вероятностный подход. Рассмотрим в качестве примера опыт, связанный с бросанием правильной игральной кости, имеющей N граней(наиболее распространенным является случай шестигранной кости: N= 6). Результатом данного опыта могут быть следующие: выпадание грани с одним из следующих знаков-1, 2, …, N.

Введем в рассмотрение численную величину, измеряющую неопределенность - энтропию( обозначим ее H). Величины N и H связаны между собой некоторой функциональной зависимостью:

![]()

а сама функция f является возрастающей, неотрицательной и определенной для N = 1, 2, …,6.

Рассмотрим процедуру бросания кости более подробно:

1)готовимся бросить кость; исход опыта неизвестен, т.е. имеется некоторая неопределенность; обозначим ее H1;

2)кость брошена; информация об исходе данного опыта получена; обозначим количество этой информации через I;

3)обозначим неопределенность данного опыта после его осуществления через H2.

За количество информации, которое получено в ходе опыта, примем разность неопределенностей «до» и «после» опыта:

I=H1-H2

Очевидно, что когда получен конкретный результат, имеющаяся неопределенность снята(H2=0) и таким образом, количество полученной информации совпадает с первоначальной энтропией.

Следующим важным моментом является определение вида функции f в формуле. Если варьировать число граней N и число бросаний кости ( обозначим ее через M), общее число исходов будет равно N в степени M:

X = NM

Так, в случае бросаний кости с шестью гранями имеем: X = 62 = 36. Фактически каждый исход Х есть некоторая пара (Х1, Х2), где Х1 и Х2 – исходы первого и второго бросаний.

Ситуацию с бросанием М раз кости можно рассматривать как некую сложную систему, состоящую из независимых друг о друга подсистем – «однократных бросаний кости». Энтропия такой системы в М раз больше, чем энтропия одной системы (принцип аддитивности энтропии):

F(6M)= M*f(6)

Данную формулу можно применить и на случай любого N:

F(NM) = M*f(N). (1.4)

Прологарифмируем обе части формулы

![]()

Подставляем полученное для М значение в формулу (1.4):

![]()

Обозначим через К положительную

константу, получим

![]()

Обычно принимают К= 1/ln2

Таким образом

![]()

Это формула Хартли. Важным является при введении какой-либо величины, что принимать за единицу ее измерения. Очевидно, что Н будет равно единице при N = 2.

Иначе говоря, что в качестве единицы принимается количество информации, связанное с проведением опыта, состоящего в получении одного из двух равновероятностных исходов. Такая единица количества информации называется «бит». Все N исходов нашего опыта являются равновероятностными и поэтому можно считать, что на долю каждого исхода приходится одна N-я часть общей неопределенности опыта:

![]()

При этом вероятность I-го

исхода

![]() равняется 1/N.

равняется 1/N.

Таким образом,

![]() - формула Шеннона

- формула Шеннона

Объемный подход. В двоичной системе счисления знаки 0 и 1 называют битами (от английского слова Binary digiTs –двоичные цифры). В вычислительной технике бит является наименьшей возможной единицей информации. Объем информации, записанной двоичными знаками в памяти компьютера или на внешнем носителе информации, подсчитывается просто по количеству требуемых для такой записи двоичных символов.

Для удобства использования введены и более крупные, чем бит, единицы количества информации.

1024байт - Кбайт

1024Кбайт – Мбайт

1024Мбайт – Гбайт

Между вероятностным и объемным количеством информации соотношение неоднозначное.

Контрольные вопросы:

1.Какие существуют определения «информатики»?

2.Как появился термин «информатика»?

3.Перечислите структуру информатики?

4.Дайте определение информации?

5. Кто ввел впервые вероятностный подход к измерению количества информации?

Литература:

1. Могилев А.В. Информатика: Учебное пособие . - 2-е изд.., стер..- М.: Издательский центр"Академия", 2003. -816с.

2. Могилев А.В. Практикум по информатике: Учеб.пособие для студ.высш.учеб.заведений. – М.: Издательский центр «Академия», 2003.-608с.

3. Информатика. Базовый курс./ под ред. С.В. Симоновича.- СПб.: Питер, 2001. -640с.

4. Острейковский В.А. Информатика: Уч. для вузов. М.: Высш.шк., 1999.- 511 с.

5. Алексеев А.П. Информатика 2007. -М.: СОЛОН-Пресс, 2007. - 464 с.: ил.-(серия "Полное руководство пользователя") изд. 3-е

Темы рефератов:

1. История развития информатики.

2. История развития вычислительной техники.

3. Техническое обеспечение информационных систем.

4. Основные понятия кибернетики