- •Контрольные вопросы по курсу «Математическая статистика»

- •Что называют дискретным вариационным рядом? Интервальным вариационным рядом? Что называют частостями вариационного ряда? Что называют накопленной частотой и накопленной частостью?

- •Пример:

- •2. Что называют полигоном вариационного ряда? Что называют гистограммой частот (частостей) вариационного ряда? Что называют кумулятой вариационного ряда?

- •Медиана

- •Коэффициент вариации

- •Дайте определения начальных и центральных моментов вариационного ряда. Дайте определение коэффициента асимметрии вариационного ряда. Дайте определение эксцесса вариационного ряда.

- •Что понимается под генеральной совокупностью? Что понимается под случайной выборкой из генеральной совокупности?

- •6. Каковы основные задачи математической статистики?

- •7. Дайте определение выборочной функции распределения. Дайте определение выборочной средней арифметической. Дайте определение выборочной дисперсии.

- •8. Дайте определение выборочных начальных и центральных моментов.

- •Дайте определение статистического ряда выборки.

- •10. Дайте определение эмпирической функции распределения. Дайте определение эмпирической плотности распределения.

- •20. Какова цель дисперсионного анализа? Запишите модель однофакторного дисперсионного анализа.

- •21. Что понимают под уровнем фактора? (ответ в Вопросе 22)

- •22. Как ставится основная гипотеза в случае однофакторного дисперсионного анализа?

- •23. Что такое вектор входных переменных (факторов), вектор выходных переменных (откликов)?

- •24. Что называют корреляционным полем, корреляционной таблицей?

- •26. Какую функцию называют функцией регрессии? Какие переменные называют входными (факторами), выходными (откликами)? Какую регрессионную модель называют линейной?

- •27. Сформулируйте исходные предположения метода наименьших квадратов.

- •В чем состоит анализ регрессионной модели?

- •29. Какую статистику используют для проверки значимости модели регрессии?

- •30. Какую линейную регрессионную модель называют адекватной?

26. Какую функцию называют функцией регрессии? Какие переменные называют входными (факторами), выходными (откликами)? Какую регрессионную модель называют линейной?

Две (или несколько) случайных величин могут быть связаны либо функциональной, либо статистической зависимостью.

Строгая функциональная зависимость реализуется редко, так как случайные величины подвержены действию случайных факторов, причем среди них могут быть и общие для двух или нескольких величин. В этом случае возникает статистическая зависимость.

Статистической называют зависимость, при которой изменение одной из величин влечет изменение распределения другой. В частности, статистическая зависимость проявляется в том, что при изменении одной из величин изменяется среднее значение другой – в этом случае статистическая зависимость называется корреляционной.

Пример корреляционной зависимости: урожай зерна Y зависит от количества внесенных удобрений X. С одинаковых по площади участков при равных количествах внесенных удобрений снимают разные урожаи. Это связано с влиянием случайных факторов (осадки, температура воздуха и др.). Вместе с тем, средний урожай зависит от количества удобрений, т.е. Y связано с X корреляционной зависимостью.

При рассмотрении взаимосвязей, как правило, рассматривают одну из величин как независимую (объясняющую), а другую как зависимую (объясняющую). При этом изменение первой из них может служить причиной изменения другой. Например, рост дохода ведет к увеличению потребления; рост цены – к снижению спроса; снижение процентной ставки увеличивает инвестиции и т.д. Подобная зависимость не является однозначной в том смысле, что каждому конкретному значению объясняющей переменой может соответствовать не одно, а множество значений из некоторой области. Другими словами, каждому конкретному значению X соответствует некоторое вероятностное распределение зависимой переменной. Поэтому анализируют, как объясняющая переменная (или переменные) влияет (или влияют) на зависимую переменную «в среднем». Зависимость такого типа, выражаемая соотношением:

![]()

называется функцией регрессии Y на X. При рассмотрении зависимости двух случайных величин говорят о парной регрессии.

Зависимость нескольких

переменных, выражаемую функцией

![]() ,

называют множественной регрессией.

,

называют множественной регрессией.

Под регрессией понимается функциональная зависимость между объясняющими переменными и условным математическим ожиданием (средним значением) зависимой переменной Y, которая строится с целью предсказания (прогнозирования) среднего значения Y при фиксированных значениях независимых переменных.

Так как реальные значения

зависимой переменной не всегда совпадают

с ее средним значением и могут быть

различными при данном X (или

![]() ),

зависимость должна быть дополнена

некоторым слагаемым ε, которое, по

существу, является случайной величиной.

Получающиеся в результате соотношения:

),

зависимость должна быть дополнена

некоторым слагаемым ε, которое, по

существу, является случайной величиной.

Получающиеся в результате соотношения:

![]() или

или

![]()

называются регрессионными моделями (или уравнениями).

Понятие корреляции появилось в середине XIX века в работах английских статистиков Ф. Гальтона и К. Пирсона. Этот термин произошел от латинского "correlatio" - соотношение, взаимосвязь. Понятие регрессии (латинское "regressio" - движение назад) также введено Ф. Гальтоном, который, изучая связь между ростом родителей и их детей, обнаружил явление "регрессии к среднему" - рост детей очень высоких родителей имел тенденцию быть ближе к средней величине.

Теория и методы корреляционного анализа используются для выявления связи между случайными переменными и оценки ее тесноты.

Основной задачей регрессионного анализа является установление формы и изучение зависимости между переменными.

В общем случае две величины могут быть связаны функциональной зависимостью, либо зависимостью другого рода, называемой статистической, либо быть независимыми.

Статистической называется зависимость, при которой изменение одной из величин влечет изменение распределения другой.

Статистическая зависимость, при которой изменение одной из величин влечет изменение среднего значения другой, называется корреляционной.

Корреляционные зависимости занимают промежуточное положение между функциональной зависимостью и полной независимостью переменных.

Между величинами, характеризующими экономические явления, в большинстве случаев существуют зависимости, отличные от функциональных. Действительно, в экономике закономерности не проявляются также точно и неизменно, как, например, в физике, химии или астрономии.

Пусть, например, мы рассматриваем зависимость величины Y от величины x – y(x).

Невозможность выявления строгой связи между двумя переменными объясняется тем, что значение зависимой переменной Y определяется не только значением переменной x, но и другими (неконтролируемыми или неучтенными) факторами, а также тем, что измерение значений переменных неизбежно сопровождается некоторыми случайными ошибками.

Вследствие этого корреляционный анализ широко используется при установлении взаимосвязи экономических показателей.

Итак, если с увеличением x значение зависимой переменной Y в среднем увеличивается, то такая зависимость называется прямой или положительной.

Если среднее значение Y при увеличении x уменьшается, имеет место отрицательная или обратная корреляция.

Если с изменением x значения Y в среднем не изменяются, то говорят, что корреляция – нулевая.

Часто при исследовании взаимосвязи между какими-либо показателями, представляют изучаемый объект в виде так называемого "черного (кибернетического) ящика".

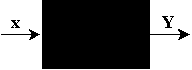

Самый простой случай – изучение связи между одной переменной x, которую называют фактором (входной переменной, независимой переменной), и переменной Y, которую называют откликом (реакцией, зависимой переменной). Ситуации соответствует рисунок 6.1.

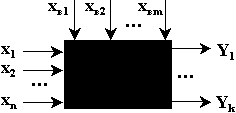

В более общем случае итогом функционирования системы является целый набор результирующих величин Ys ( ). При этом значения откликов Ys определяются, с одной стороны, совокупностью факторов xj ( ), а , с другой стороны, набором возмущений (случайных, неконтролируемых факторов) xвi ( ). Такую ситуацию иллюстрирует рисунок 6.2.

|

|

Рисунок 6.1 – Представление исследуемой системы в виде "черного ящика" (один фактор, один отклик) |

Рисунок 6.2 – Представление исследуемой системы в виде "черного ящика" (общий случай) |

Собственно говоря, на протяжении столетий ученые (особенно, естествоиспытатели) используют подобные приемы, т.е. наблюдают, что произойдет с явлением, процессом (с откликом Y), если изменять значения влияющих на процесс факторов (переменных x).

Линейная регрессия

(англ. Linear

regression)

— используемая в статистике

регрессионная

модель

зависимости одной (объясняемой, зависимой)

переменной y

от одной или нескольких других переменных

(факторов, регрессоров, независимых

переменных) x

с линейной

функцией

зависимости y =

![]() +

+

![]() x

+

x

+

![]() .

(6.1)

.

(6.1)