- •4. Основные сведения о нейронных сетях

- •4.1. Введение

- •Каждый нейрон, входящий в нейронную сеть и представленный на рис. 1 в виде кружка, участвует в преобразовании входных сигналов, так что выходной сигнал зависит от алгоритма работы всех нейронов.

- •4.2. Модель нервной клетки (нейрона)

- •Лекция 24

- •4.3. Математическая модель нейрона

- •4.4. Многослойная нейронная сеть

- •4.5. Обучение нейронной сети

- •Лекция 25

- •4.6. Обратное распространение ошибки

- •Лекция 26

- •Если q – й нейрон расположен в k–ом скрытом слое (рис. 8), то согласно (17а) при замене r на q , 2 на k, 1 на k-1 и I на r,

- •4.7. Аппроксимация функций (моделирование) с помощью нейронных сетей (персептронов)

- •Нейронная сеть с радиальными базисными функциями

- •Cтруктура нейронной сети с радиально базисными функциями (рбф сети)

- •Методы обучения рбф сети

- •Лекция 27

- •Моделирование (идентификация) нелинейных динамических процессов (объектов)

- •3. Применение нейронных сетей (нс) для управления

- •3.1. Нейросетевые адаптивные системы управления

- •3.1.1. Нейросетевая технология адаптивной линеаризации обратной связью

- •3.1.2. Нейросетевое прямое и косвенное адаптивное управление на основе желаемой (эталонной) модели

- •Лекция 28

- •5. Синтез нейронных нечетких сетей

- •5.1. Введение

- •Адаптивные нейронные нечеткие системы инференции (anfis)

- •Структура anfis

- •Алгоритм обучения anfis

- •Генетические алгоритмы

- •Лекция 29

- •Генетические нечеткие системы (Извлечение нечетких знаний с помощью генетических алгоритмов)

- •Проектирование нечетких систем

- •Классификация генетических нечетких систем

- •4.6. Обратное распространение ошибки

4.7. Аппроксимация функций (моделирование) с помощью нейронных сетей (персептронов)

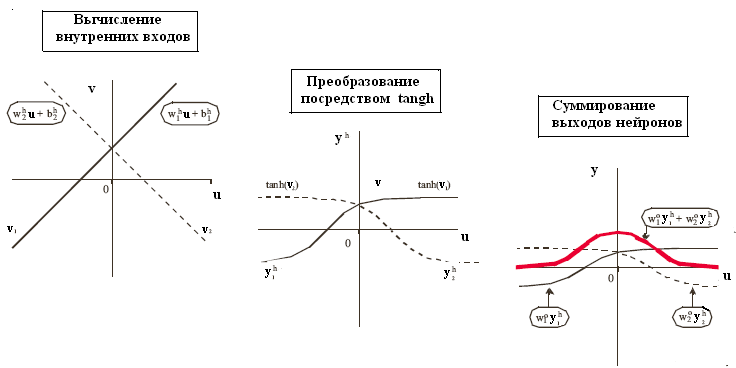

Рассмотрим задачу реализации нелинейных алгебраических зависимостей нейронными сетями. Приведенный выше персептрон может аппроксимировать произвольную гладкую функцию. В качестве примера запишем выходной сигнал сети с одним выходом y и одним входом u, состоящей из одного скрытого слоя с двумя нелинейными нейронами и выходного слоя из одного линейного нейрона (с линейной активационной функцией)

![]() .

(28)

.

(28)

Внутренние входы v1 и v2 скрытых нейронов определяются выражениями

![]() .

(29)

.

(29)

Пусть

функция активации f

(v)

скрытых нейронов является функцией

tangh(v)

(гиперболический

тангенс). При этом график зависимости

y=g(u)

при

найденных

в результате

обучения

значениях весовых коэффициентов w0

, wh

и смещений

bh

можно

построить, как показано на рис. 8. Здесь

![]() =

=![]() ,

,

![]() =

-

=

-

![]() ,

,![]() =

=![]() =1.

=1.

Рис. 8

Изменяя веса и смещения в соответствии с обучающей выборкой,

получаем гладкую кривую, аппроксимирующую вход нейронной сети.

Эффективность использования нейронных сетей устанавливается

теоремой о полноте. Смысл этой теоремы в том (Cybenko, 1989), что

персептрон, по меньшей мере, с одним скрытым слоем, способен

аппроксимировать

любую непрерывную функцию

![]() с

с

произвольной степенью точности при условии выбора достаточного числа

нейронов скрытого слоя.

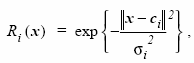

Нейронная сеть с радиальными базисными функциями

Нейронные сети с радиальными базисными (активационными) функциями (РБФ сети) обеспечивают альтернативный подход в противоположность популярному многослойному персептрону. Подобно другим архитектурам нейронных сетей РБФ сети являются универсальными аппроксиматорами.

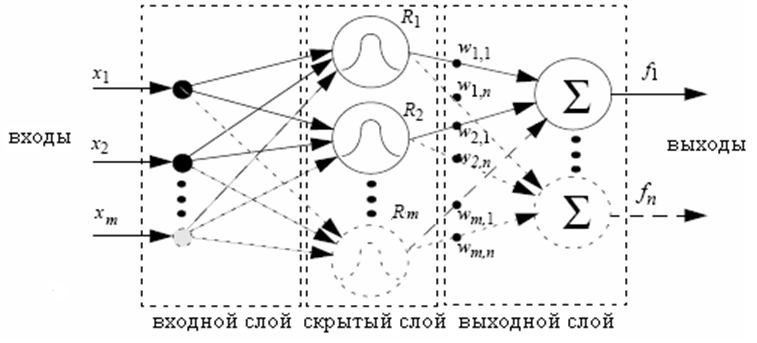

Cтруктура нейронной сети с радиально базисными функциями (рбф сети)

РБФ сеть содержит три слоя (рис. 9). Входной слой распределяет входные сигналы по нейронам скрытого слоя посредством невзвешенных связей. Скрытый слой является композицией нейронов с локальными базисными функциями (РБФ-функциями). Обычно используются гауссовская базисная функция, которая осуществляет нелинейное преобразование

Рис. 9

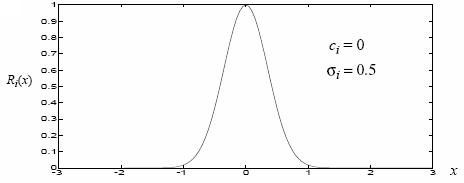

где

x

вектор входа, ci

центр i-й

базисной функции

![]() и

и

![]() характеризует ширину (радиус) i-й

базисной функции (см. рис.10 для скалярной

базисной функции).

характеризует ширину (радиус) i-й

базисной функции (см. рис.10 для скалярной

базисной функции).

Рис. 10

Норма

![]() означает евклидову норму,

означает евклидову норму,

![]()

Гауссовская

базисная функция является локальной,

т. к.

![]() когда

когда

![]()

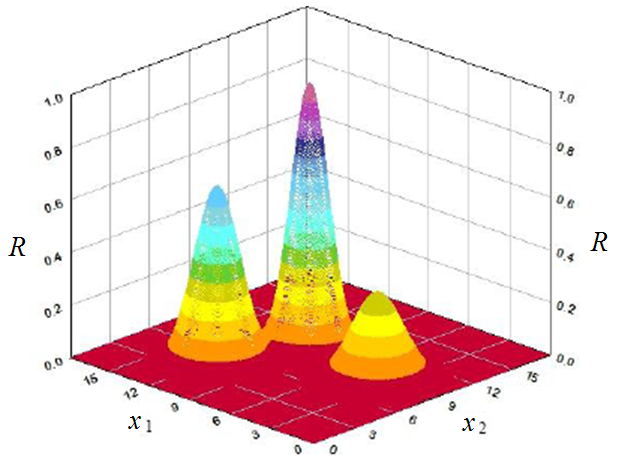

Если число входов больше единицы, то РБФ-функция является функцией всех переменных входа. На рис. ниже показан вид РБФ-функций для трех нейронов при двух входах x1 и x2.

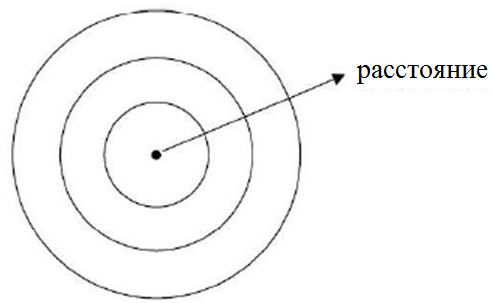

Для заданных значений входа (при двух входах значений x1 и x2) определяется расстояние от точки с координатами, определяемыми этими значениями, до центра соответствующей РБФ-функции как евклидово расстояние. РБФ-функция применяется для того, чтобы для этого расстояния вычислить вес (влияние) соответствующего нейрона. Радиальная базовая функция названа этим именем, т.к. расстояние по радиусу (см. рис.ниже) является ее аргументом,

вес= РБФ(расстояние).

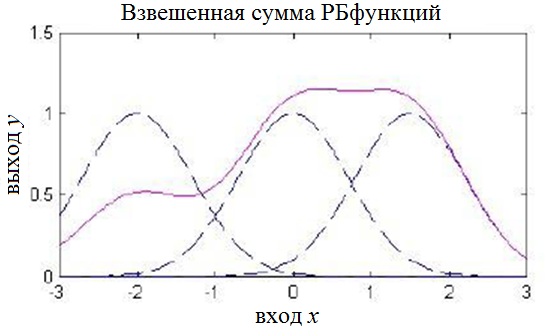

Выходной слой обычно комбинирует линейно выходные сигналы скрытого слоя (см. рис. ниже).

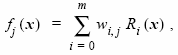

РБФ сеть может быть описана двумя путями. В первом случае РБФ сеть описывается как взвешенная сумма выходных сигналов скрытого слоя

где m число нейронов скрытого слоя. Здесь соответствие с подлежащей аппроксимации нелинейной функцией выражено более явно. Альтернативная форма описания представляет собой нормализованную реакцию

Следующие параметры определяются с помощью процесса обучения:

1.Число нейронов скрытого слоя.

2. Координаты центров каждой РБФ-функции скрытого слоя.

3. Радиусы (ширина каждой РБФ-функции скрытого слоя по каждой переменной (по каждому направлению).

4. Весовые коэффициенты, которые используются для взвешенного суммирования выходов РБФ-функций, когда они проходят через слой суммирования.