- •Организация и функции статистических служб

- •Понятие о статистической информации

- •Статистическое наблюдение

- •Принципы построения статистических группировок

- •Вариационные ряды

- •Графическое отображение вариационных рядов

- •Пример 3.1.

- •Обобщающие статистические показатели

- •1. Средние величины

- •1.1 Средние степенные величины

- •1.2 Средние структурные величины

- •2. Анализ вариационных рядов

- •2.1. Показатели вариации

- •2.1.1. Свойства дисперсии

- •2.1.2 Вариация альтернативного признака

- •2.2. Виды дисперсий в совокупности, разделенной на части. Правило сложения дисперсий

- •3. Моменты распределения Показатели формы распределения

- •3.1. Моменты распределения

- •3.2. Показатели формы распределения

- •3.3. Теоретические кривые распределения

- •4. Выборочное наблюдение в статистике

- •4.1. Закон больших чисел и предельные теоремы

- •Выборочное наблюдение

- •4.2. Ошибка выборки для альтернативного признака

- •4.3 Определение необходимой численности выборки

- •4.4 Формы организации выборочного наблюдения

- •5. Статистические методы изучения взаимосвязи социально-экономических явлений

- •5.1 Регрессионный анализ

- •5.2 Корреляционный анализ

- •6. Ряды динамики

- •6.1 Анализ динамических рядов

- •6.2 Методы анализа тенденций рядов динамики

- •6.3 Сезонные колебания

- •6.4. Статистические методы прогнозирования экономических показателей

- •6.4.1. Прогнозирование на основе экстраполяции тренда

- •8.4.2. Выбор наилучшего тренда при прогнозировании

- •7. Экономические индексы

- •7.1 Общие индексы количественных показателей

- •8.2 Общие индексы качественных показателей

- •7.3 Индексы переменного и фиксированного состава. Индекс структурных сдвигов

- •Приложение Значение критерия Пирсона χ2

- •Приложение Значение t-критерия Стьюдента

- •Приложение Значение f-критерия Фишера при уровне значимости 0,05

- •Окончание приложения

5. Статистические методы изучения взаимосвязи социально-экономических явлений

Корреляционная связь (частный случай стохастической) – связь, проявляющаяся при достаточно большом числе наблюдений в виде определенной зависимости между средним значением результативного признака и признаками-факторами.

Задача корреляционного анализа – измерение тесноты связи между варьируемыми признаками и оценка факторов, оказывающих наибольшее влияние.

Задача регрессионного анализа – выбор типа модели (формы связи), устанавливающих степени влияния независимых переменных.

Связь признаков проявляется в их согласованной вариации, при этом одни признаки выступают как факторные, а другие – как результативные. Причинно-следственная связь факторных и результативных признаков характеризуется по степени:

тесноты;

направлению;

аналитическому выражению.

5.1 Регрессионный анализ

Для

оценки параметров уравнений регрессии

наиболее часто используется метод

наименьших квадратов (МНК), суть

которого заключается в следующем

требовании: искомые теоретические

значения результативного признака

![]() должны быть такими, при которых бы

обеспечивалась минимальная сумма

квадратов их отклонений от эмпирических

(фактических) значений, т.е.

должны быть такими, при которых бы

обеспечивалась минимальная сумма

квадратов их отклонений от эмпирических

(фактических) значений, т.е.

![]() . (5.1)

. (5.1)

При изучении связей показателей применяются различного вида уравнения прямолинейной и криволинейной связи. Так, при анализе прямолинейной зависимости применяется уравнение:

![]() (5.2)

(5.2)

Это наиболее часто используемая форма связи между коррелируемыми признаками, при парной корреляции она выражается уравнением (6.2), где а0 – среднее значение в точке x=0, поэтому экономической интерпретации коэффициента нет; а1 – коэффициент регрессии, показывает, на сколько изменяется в среднем значение результативного признака при увеличении факторного на единицу собственного измерения.

При криволинейной зависимости применяется ряд математических функций:

полулогарифмическая

![]() (5.3)

(5.3)

показательная ![]() (5.4)

(5.4)

степенная ![]() (5.5)

(5.5)

параболическая ![]() (5.6)

(5.6)

гиперболическая ![]() (5.7)

(5.7)

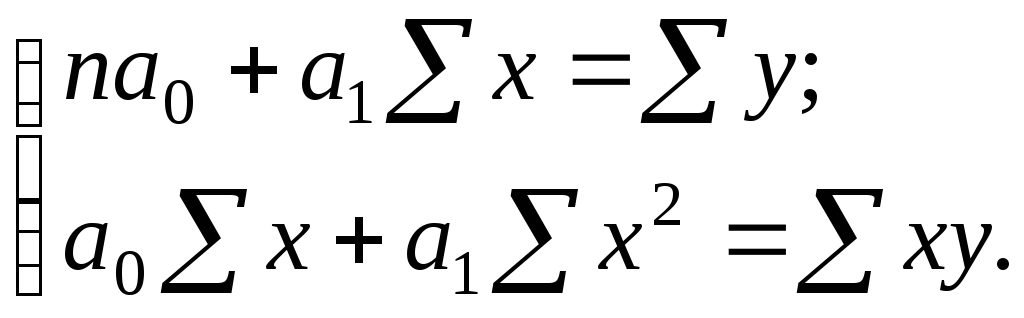

Система нормальных уравненийМНК для линейной парной регрессии имеет следующий вид:

(5.8)

(5.8)

Отсюда можно выразить коэффициенты регрессии:

![]() ;

;

![]() . (5.9)

. (5.9)

При численности объектов анализа до 30 единиц возникает необходимость проверить, насколько вычисленные параметры типичны для отображаемого комплекса условий, не являются ли полученные значения параметров результатом действия случайных причин. Значимость коэффициентов регрессии применительно к совокупности n<30 определяется с помощью t-критерия Стьюдента. При этом вычисляются фактические значения t-критерия:

для

параметра а0:

![]() ,(5.10)

,(5.10)

для

параметра а1:

![]() .(5.11)

.(5.11)

В формулах (6.10) и (6.11):

![]() –среднее

квадратическое отклонение результативного

признака

–среднее

квадратическое отклонение результативного

признака

![]() от выровненных значений

от выровненных значений![]() . (5.12)

. (5.12)

![]() –среднее

квадратическое отклонение факторного

признака

–среднее

квадратическое отклонение факторного

признака

![]() от общей средней

от общей средней![]() . (5.13)

. (5.13)

Полученные

по формулам (5.10) и (5.11) фактические

значения

![]() и

и![]() сравниваются

с критическим

сравниваются

с критическим![]() ,

который получают по таблице Стьюдента

с учетом принятого уровня значимости

,

который получают по таблице Стьюдента

с учетом принятого уровня значимости![]() и числа степеней свободыν

(ν=n-k-1,

где n

– число наблюдений, k

– число факторов, включенных в уравнение

регрессии). Рассчитанные параметры а0

и а1

уравнения регрессии признаются типичными,

если t

фактическое

больше t

критического.

и числа степеней свободыν

(ν=n-k-1,

где n

– число наблюдений, k

– число факторов, включенных в уравнение

регрессии). Рассчитанные параметры а0

и а1

уравнения регрессии признаются типичными,

если t

фактическое

больше t

критического.

На практике часто приходится исследовать зависимость результативного признака от нескольких факторных признаков. Аналитическая форма связи результативного признака от ряда факторных признаков выражается и называется многофакторным (множественным) уравнением регрессии.

Линейное уравнение множественной регрессии

![]() . (5.14)

. (5.14)

Система

нормальных линейных уравнений МНК для

оценки коэффициентов двухфакторной

регрессии

![]() имеет вид:

имеет вид:

(5.15)

(5.15)