Shpory_v_pdfe

.pdf

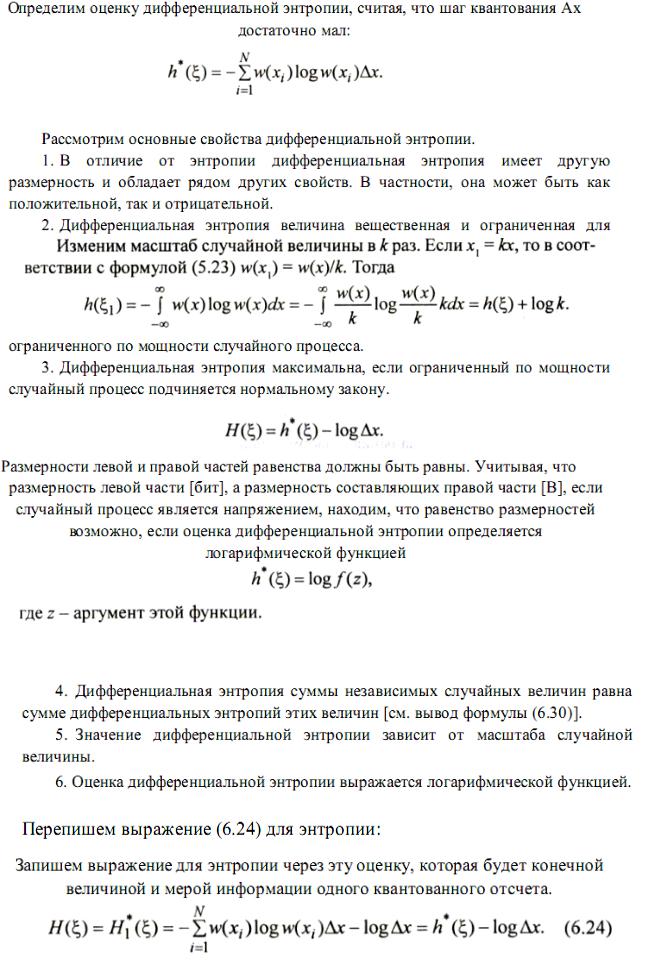

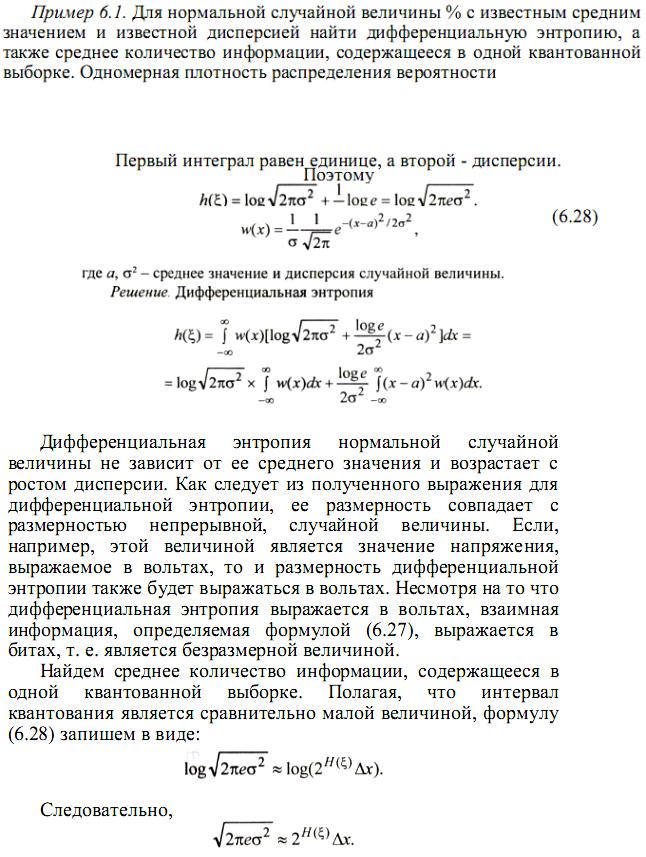

14.Дифференциальная энтропия нормальной случайной величины.

16-17. Эквивалентные первичные сигналы. Эпсилон энтропия. Формула для эпсилон энтропии.

Для передачи непрерывного сообщения или сигнала с абсолютной точностью требуется бесконечно большое количество информации. Этот вывод следует из результата, полученного выше: энтропия, определяемая формулой (6.22), равна бесконечности. Однако передача бесконечного количества информации по реальному каналу связи с ограниченной шириной полосы и за ограниченное время оказывается не только невозможной, но и ненужной. Это объясняется тем, что для восприятия точного воспроизведения информации не требуется.

Если средний квадрат разности не превышает некоторого заданного числа в0, то сигналы b'(l) и b(t) считаются эквивалентными. Это значит, что если послан один сигнал, а принят другой, эквивалентный ему, то по данному критерию переданный сигнал считается принятым верно.

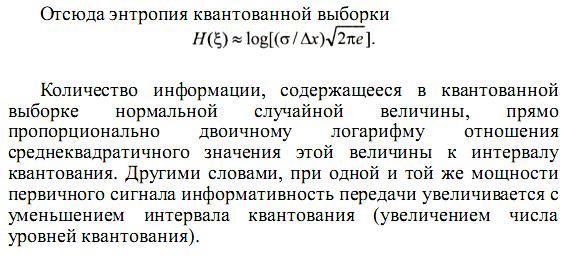

Минимальное количество информации, содержащееся в принятом сигнале b"{t) относительно bit), при котором они еще эквивалентны, называется эпсилон-энтропией.

Эпсилон-энтропия определяется минимальной взаимной информацией:

Достижение максимума условной энтропии означает, что из всех возможных условных распределений, для которых e2( t ) < е0, выбирается такое распределение, которое обеспечивает максимум условной энтропии. Вычисление эпсилон-энтропии несложно при следующих допущениях. 1. Известны плотности распределения вероятности, определяющие случайные сигналы b(i), b*(t).

Такими плотностями являются:

18. Производительность источника непрерывных сообщений.

(3.44)

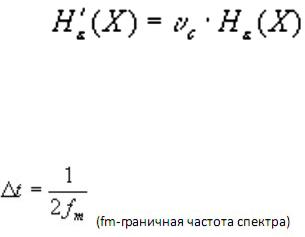

где uс – количество отсчетов сообщения, выдаваемых в единицу времени. В том случае, когда Х - непрерывный случайный процесс с ограниченным спектром, вся информация, содержащаяся в его значениях эквивалентна информации, содержащейся в отсчетах процесса, следующих друг за другом с интервалом ,

При этом e - производительность источника или процесса по-прежнему определяется выражением (3.44). В том случае, если следующие друг за другом отсчеты процесса коррелированны (взаимозависимы), величина Н(Х) должна вычисляться с учетом вероятностных связей между отсчетами.

Итак, e - производительность источника непрерывных сообщений представляет собой минимальное количество информации, которое нужно создать источнику в единицу времени, для воспроизведения его сообщений с заданной верностью.

e - производительность называют также скоростью создания

информации при заданном критерии верности. |

|

Максимально возможная e - производительность |

непрерывного |

источника Х обеспечивается при гауссовском распределении Х с дисперсией сигма^2 (при этом условии h(X) максимальна.

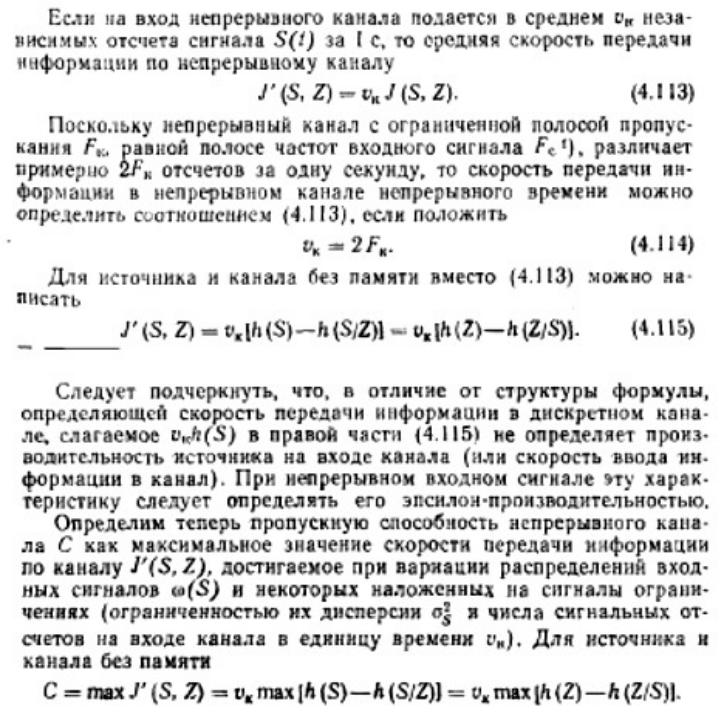

19. Скорость передачи информации по непрерывному каналу связи.

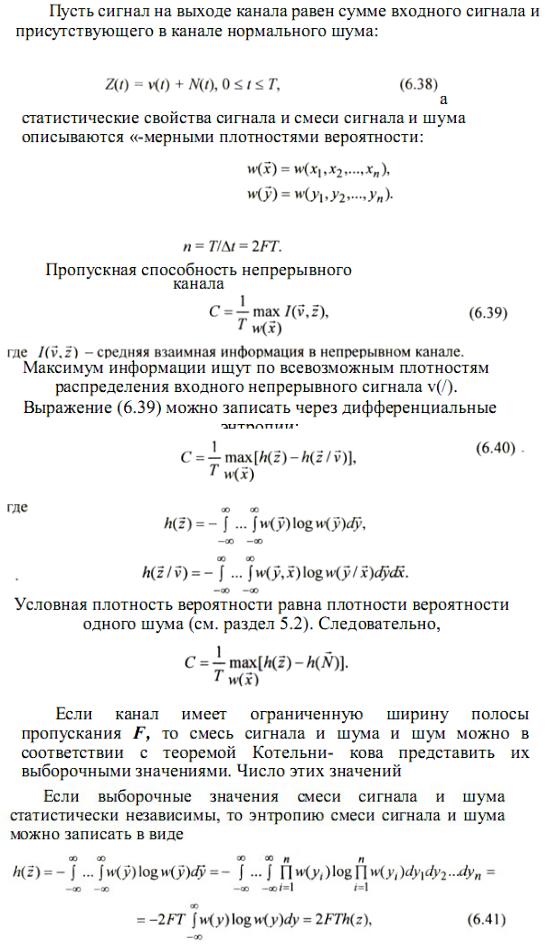

20. Пропускная способность непрерывного канала связи.

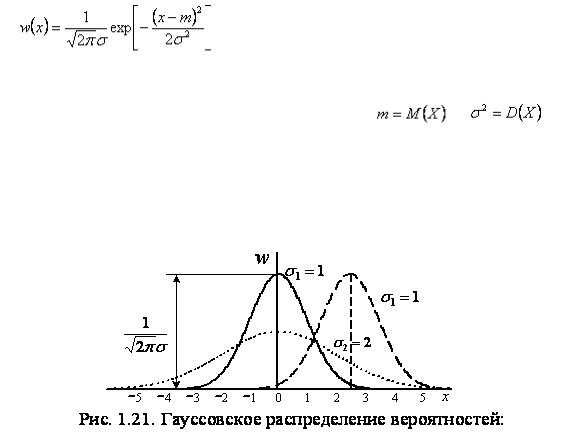

26.Плотность распределения флуктуационного шума, подчиняющегося нормальному закону.

Примером случайного процесса является флуктуационный шум, наиболее характерный для большинства каналов электросвязи. Для количественных расчетов воздействия флуктуационного шума на сигнал необходимо знать основные вероятностные характеристики. Поскольку шум образуется как сумма большого числа отдельных независимых колебаний, он, согласно центральной предельной теореме представляет собой стационарный эргодический случайный процесс с гауссовским (нормальным) распределением вероятности.

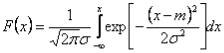

ПРВ гауссовского процесса описывается формулой [6, 32]:

(1.47)

,

в которую входят два числовых параметра  и

и  , имеющие смысл

, имеющие смысл

математического ожидания и дисперсии: |

, |

. График |

плотности вероятности  представляет собой колоколообразную кривую с единственным максимумом в точке

представляет собой колоколообразную кривую с единственным максимумом в точке  (рис. 1.21). Из графика видно, что с уменьшением

(рис. 1.21). Из графика видно, что с уменьшением  кривая все более локализуется в окрестности точки

кривая все более локализуется в окрестности точки  .

.

Для флуктуационного шума обычно  .

.

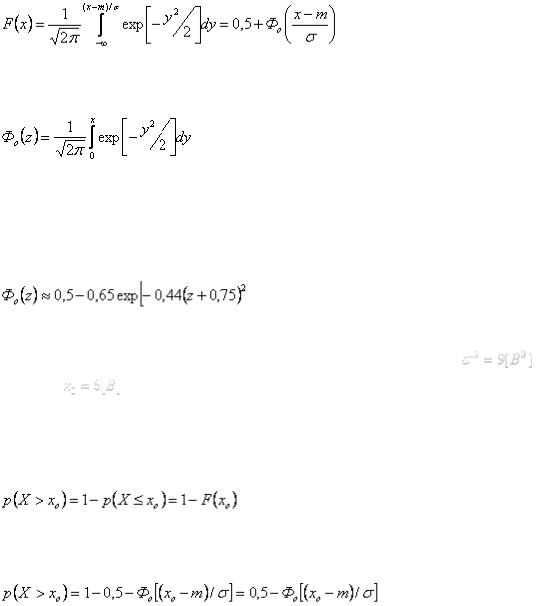

Функция распределения вероятности для гауссовского случайного процесса:

.

.

После замены переменных  эта функция приводится к виду:

эта функция приводится к виду:

(1.48)

,

где

- интеграл вероятности.

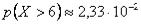

Функция  табулирована в математических справочниках. Заметим, что

табулирована в математических справочниках. Заметим, что

,

,  ,

,  . Для приближенных вычислений можно воспользоваться приближенным выражением:

. Для приближенных вычислений можно воспользоваться приближенным выражением:

(1.49)

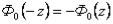

Пример 1.3. Вычислим вероятность того, что мгновенное значение

флуктуационного шума с нулевым средним и дисперсией |

превысит |

|

уровень |

. |

|

Исходя из определения функции распределения вероятности (1.43), вероятность превышения случайным процессом уровня

.

Подставляя значение  для гауссовского случайного процесса, получаем:

для гауссовского случайного процесса, получаем:

.

Для заданных числовых значений и  , воспользовавшись таблицами или приближенной формулой (1.49) для

, воспользовавшись таблицами или приближенной формулой (1.49) для  , получаем:

, получаем:

.

.

Спектральная плотность мощности  флуктуационного шума зависит от физической природы его образования, а также участка канала связи, где он

флуктуационного шума зависит от физической природы его образования, а также участка канала связи, где он

рассматривается. Обычно спектральная плотность мощности  флуктуационного шума постоянна в широком диапазоне частот, т. е. можно

флуктуационного шума постоянна в широком диапазоне частот, т. е. можно

приближенно считать, что:  при

при  . В этом случае шум называют белым. Это название дано по аналогии с белым светом, имеющим все частотные компоненты.

. В этом случае шум называют белым. Это название дано по аналогии с белым светом, имеющим все частотные компоненты.