- •МГЛУ

- •Новые информационные технологии в лингвистике

- •Автоматическое распознавание речи

- •Процесс порождения речи

- •Процесс порождения речи у человека

- •Речевая волна во временной области

- •Речевая волна во временной и частотной областях

- •Речевая волна во временной и частотной областях

- •Представление речи в виде формантных траекторий

- •Перекрытие областей формантных частот

- •Положение центроидов основных гласных

- •Процесс восприятия речи человеком

- •Процесс восприятия речи человеком

- •Процесс восприятия речи человеком

- •Процесс восприятия речи человеком

- •Процесс восприятия речи человеком

- •Процесс восприятия речи человеком

- •Процесс восприятия речи человеком

- •Процесс восприятия речи человеком

- •Колонка коры (по Батуеву А.С.)

- •Гиперколонка коры (по Батуеву А.С.)

- •Отдельные слова словарей раскладываются по

- •Процесс восприятия речи человеком

- •Процесс восприятия речи человеком

- •Процесс восприятия речи человеком

- •Процесс восприятия речи человеком

- •Процесс восприятия речи человеком

- •Коммуникационный акт

- •Структура коммуникационной системы для организации речевого поведения

- •Структура коммуникационной системы для организации речевого поведения

- •Структура коммуникационной системы для организации речевого поведения

- •Информационно-кодовая модель коммуникации Шеннона и Уивера

- •Под распознаванием речи понимается выделение информации из преобразованного сигнала, полученного адресатом от адресанта

- •Правило Байеса

- •Правило Байеса

- •Правило Байеса

- •Правило Байеса

- •Правило Байеса

- •Информационно-кодовая модель коммуникации Шеннона и Уивера, модифицированная для коммуникационного акта Якобсоном

- •Автоматическое распознавание речи

- •Автоматическое распознавание речи

- •Автоматическое распознавание речи

- •Автоматическое распознавание речи

- •Автоматическое распознавание речи

- •Автоматическое распознавание речи

- •Автоматическое распознавание речи

- •Автоматическое распознавание речи

- •Акустико-фонетический подход

- •Акустико-фонетический подход

- •Акустико-фонетический подход

- •Подход, основанный на распознавании образов

- •Подход, основанный на распознавании образов

- •Подход, основанный на распознавании образов

- •Подход, основанный на распознавании образов

- •Подход на основе искусственного интеллекта

- •Подход на основе искусственного интеллекта

- •Подход на основе искусственного интеллекта

- •Подход, основанный на искусственных нейронных сетях

- •Подход, основанный на искусственных нейронных сетях

- •Нейронные сети

- •Первичная обработка

- •Спектральный анализ

- •Спектральный анализ

- •Спектральный анализ

- •Анализ на основе линейного предсказывающего кодирования

- •Анализ на основе линейного предсказывающего кодирования

- •Анализ на основе линейного предсказывающего кодирования

- •Анализ на основе линейного предсказывающего кодирования

- •Векторное квантование

- •Векторное квантование

- •Векторное квантование

- •Векторное квантование

- •Антропоморфная модель анализа

- •Психоакустическое сглаживание спектра

- •Психоакустическое сглаживание спектра

- •Психоакустическое сглаживание спектра

- •Психоакустическое сглаживание спектра

- •Психоакустическое сглаживание спектра

- •Психоакустическое сглаживание спектра

- •Психоакустическое сглаживание спектра

- •Психоакустическое сглаживание спектра

- •Принятие решения

- •Принятие решения

- •Динамическое программирование

- •Динамическое программирование

- •Динамическое программирование

- •Динамическое программирование

- •Динамическое программирование

- •Динамическое программирование

- •Динамическое программирование

- •Динамическое программирование

- •Правило Байеса

- •Правило Байеса

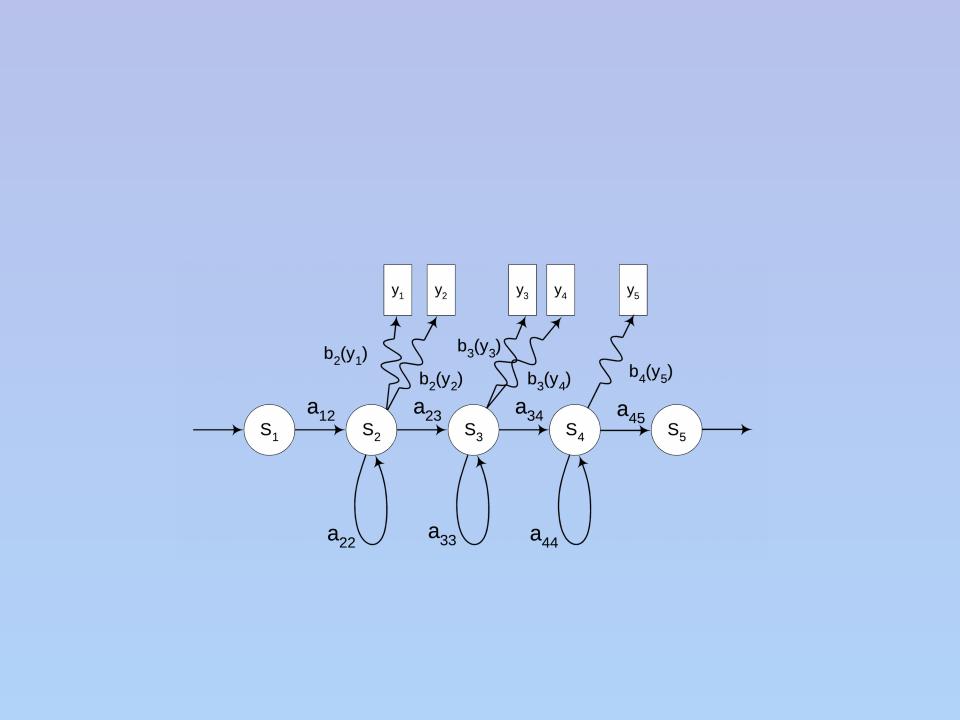

- •Скрытые Марковские модели

- •Скрытые Марковские модели

- •Скрытые Марковские модели

- •Скрытые Марковские модели

- •Скрытые Марковские модели

- •Скрытые Марковские модели

- •Скрытые Марковские модели

- •Скрытые Марковские модели

- •Скрытые Марковские модели

- •Скрытые Марковские модели

- •Скрытые Марковские модели

- •Скрытые Марковские модели

- •Скрытые Марковские модели

- •Скрытые Марковские модели

- •Стандартный СММ распознаватель

- •Скрытые Марковские модели

- •Скрытые Марковские модели

- •Скрытые Марковские модели

- •Скрытые Марковские модели

- •Скрытые Марковские модели

- •Реализация и использование систем распознавания речи

- •Реализация и использование систем распознавания речи

- •Промышленные системы распознавания речи Стандартная система распознавания речи

- •Промышленные системы распознавания речи

- •Промышленные системы распознавания речи

- •Промышленные системы распознавания речи

- •Промышленные системы распознавания речи

- •Промышленные системы распознавания речи

- •Промышленные системы распознавания речи

- •Диалог человека и машины

- •Диалог человека и машины

- •Диалог человека и машины

- •Диалог человека и машины

- •Сравнение эффективности распознавания человеком и искусственными системами

- •Сравнение эффективности распознавания человеком и искусственными системами

- •Сравнение эффективности распознавания человеком и искусственными системами в условиях шума

Динамическое программирование

Допустимый коридор сравнения

82

Динамическое программирование

Допустимый коридор сравнения

82

Правило Байеса

Адресант передает, а адресат принимает одно из группы Hсобытий1, H2 ,..., Hn

(классов, к которым относятся передаваемые и получаемые сообщения). Группа событий обладает

i H j ;i, j 1..n,i j

1) все события попарно несовместны:

;H1 H2 ...Hn

2) их объединение образует пространство элементарных исходов :

83

Правило Байеса

|

|

|

|

|

P(Hk / A) |

P(A/ Hk )P(Hk ) |

|

|

Пусть |

|

|

|

|

P(A/ Hi ) |

– |

||

|

|

|

|

|

||||

1 |

2 |

,..., H |

n |

- полная группа событий и |

||||

|

H |

, H |

|

|

|

A |

|

|

некоторое событие. Тогда по формуле Байеса исчисляется

вероятность реализации гипотезы |

при условии, что |

|

|

Hk |

|

событие А произошло. Здесь А – конкретное наблюдение |

||

(измерение). |

Hk |

|

P(Hk ) |

|

|

P(Hk | A-) априорная вероятность гипотезы |

||

P(A | Hk ) |

- апостериорная вероятность |

|

|

- функции распределения вектора признаков для |

|

каждого класса

84

Nk

Правило Байеса

P(Hk / A) |

P(A/ Hk )P(Hk ) |

|

P(A/ Hi ) |

||

|

Эти вероятности можно оценить методами математической статистики на множестве прецедентов.

P(H ) N / N |

, гдеN |

- число прецедентовk из |

|||

N ,k |

k |

k |

P(A | Hk ) |

H |

|

- |

|||||

- общее число прецедентов. |

|||||

гистограмма распределенияHk вектора

признаков для прецедентов из класса .

11

Скрытые Марковские модели

•Последовательность состояний модели, моделирующих

временную структуру речи, является функцией некоторого случайного процесса; наблюдаемый процесс, определяемый локально-стационарными свойствами речевого сигнала, также является случайным процессом

•Модель является скрытой, так как основной процесс

(последовательность состояний) непосредственно не наблюдается

•Основной процесс перехода между стационарными

состояниями является Марковским, так как статистические данные текущего состояния зависят только от его собственных характеристик и характеристик предыдущего состояния

87

Скрытые Марковские модели

Марковские процессы с дискретным временем называются Марковскими цепями. Конечной Марковской цепью 1-го порядка называется конечный стохастический процесс такой, истинность которого зависит лишь от исходов экспериментовP[qt j | qt 1 i, qtдо2 1k-,го:...] P[qt j | qt 1 i]

.

Рассматриваемaij P[qтолькоt j | qt стационарные1 i],1 i, j N процессы

(переходные вероятности не зависят от времени)

.

88

Скрытые Марковские модели

На входе системы, использующей статистические методы |

|

||

моделирования, имеется последовательность векторов |

|

||

признаковO (o ,o ,...,o |

) |

|

|

1 2 |

T |

, полученных в результате первичной |

|

|

|

} |

|

|

|

V {v1 , v2 ,...,vM |

|

обработки (например, речевой волны). Для выработки |

|

||

статистических гипотез берется некоторое множество |

|

||

классов |

|

, к которым эти гипотезы |

|

должны быть отнесены. В общем случае задача классификации может рассматриваться как статистическая задача распознавания образов, что позволяет построить

оптимальныйP(v | o ) P(v | oклассификатор, j 1..V , j k) на основеP(v | o )критерия максимума |

|||

k t |

j t |

k t |

|

апостериорной вероятности: |

vk |

– вероятность |

|

|

, где |

|

|

принадлежности заданного образа классу .

85

Скрытые Марковские модели

Речевой сигнал, являющийся нестационарным процессом, можно представить в виде кусочно-стационарного процесса. В этом случае речевому высказыванию, представленному последовательностью векторов признаков O, можно поставить в соответствие последовательность

дискретных стационарных состоянийq |

, где |

||||||

Q {q |

|

,q |

,..., q |

N |

} |

n |

|

1 |

2 |

|

|

|

|||

– состояние процесса в момент времени n . |

|

||||||

Пусть q [q , q |

,...,q ,...,q ] |

– множество состояний |

|

||||

1 2 |

|

|

t |

|

T |

|

|

модели, из которых формируются модели речевых |

|

||||||

высказываний.

86

Скрытые Марковские модели

90