- •2.Автокорреляция случайного возмущения. Причины. Последствия.

- •4.Автокорреляция. Методы устранения автокорреляции

- •5.Алгоритм проверки адекватности парной регрессионной модели

- •6.Алгоритм проверки значимости регрессора в парной регрессионной модели

- •7.Алгоритм теста Голдфелда-Квандта на наличие (отсутствие) гетероскедастичности случайных возмущений.

- •8.Выбор типа математической функции при построении уравнения регрессии

- •9 Выведите формулы вычисления коэффициентов модели парной регрессии

- •10.Выведите формулы вычисления параметров модели парной регрессии

- •11.Гетероскедастичность - понятие, проявление и меры устранения.

- •12.Гетероскедастичность случайного возмущения. Причины. Последствия. Тест gq.

- •13.Двухшаговый метод наименьших квадратов для оценки параметров структурной формы модели

- •21.Индивидуальная и интервальная оценка индивидуального значения зависимой переменной

- •22.Интервальная оценка параметров уравнения парной регрессии

- •23.Классическая парная регрессионная модель. Спецификация модели. Теорема Гаусса – Маркова.

- •24.Ковариация, коэффициент корреляции и индекс детерминации

- •25.Количественные характеристики взаимосвязи пары случайных переменных.

- •26. Косвенный метод наименьших квадратов для оценки параметров структурной формы модели

- •28. Коэффициент корреляции и индекс детерминации в регрессионной модели.

- •29. Линейная модель множественной регрессии

- •30. Метод Монте-Карло, его применение в эконометрике

- •31. Метод наименьших квадратов: алгоритм метода; условия применения. Обобщённый метод наименьших квадратов

- •32. Модели с бинарными (фиктивными) переменными.

- •33. Моделирование тенденции временных рядов (аналитическое выравнивание)

- •34. Мультиколлинеарность факторов – понятие, проявление и меры устранения

- •35. Назначение теста Голдфелда-Квандта, этапы его проведения.

- •36. Нелинейная модель множественной регрессии Кобба-Дугласа. Оценка её коэффициентов.

- •37.Нелинейная регрессия (линеаризация, оценка параметров)

- •38.Ожидаемое значение случайной переменной, её дисперсия и среднее квадратическое отклонение.

- •39.Основные числовые характеристики вектора остатков в классической множественной регрессионной модели

- •40.Отражение в модели влияния неучтённых факторов и времени.

- •42.Оценка адекватности полученной эконометрической модели (см. 5)

- •43.Оценка коэффициентов модели Самуэльсона-Хикса

- •44.Оценка параметров множественной регрессионной модели методом наименьших квадратов.

- •45. Оценка параметров парной регрессионной модели методом наименьших квадратов.

- •46.Оценка параметров эконометрической модели

- •47.Оценка статистической значимости коэффициентов модели множественной регрессии. (см. 6)

- •48.Подбор объясняющих переменных множественной линейной модели. Алгоритм исключения квазинеизменных переменных

- •49.Подбор объясняющих переменных множественной линейной модели. Метод анализа матрицы коэффициентов корреляции.

- •50.Подбор переменных в модели множественной регрессии на основе метода оценки информационной ёмкости.

- •51.Понятие гомоскедастичности и гетероскедастичности случайных возмущений, их графическая интерпретация.

- •52.Порядок оценивания линейной модели множественной регрессии методом наименьших квадратов (мнк) в Excel

- •53.Последствия гетероскедастичности. Тест Голдфелда-Квандта.

- •54.Предпосылки метода наименьших квадратов

- •55.Применение обобщенного метода наименьших квадратов (омнк) для случая гетероскедастичности остатков.

- •56.Применение теста Стьюдента в процедуре подбора переменных в модели множественной регрессии.

- •57.Применение фиктивных переменных при исследовании сезонных колебаний: спецификация модели, экономический смысл параметров при фиктивных переменных.

- •58 Принципы спецификации эконометрических моделей и их формы

- •59.Проблема мультиколлинеарности в моделях множественной регрессии. Признаки мультиколлинеарности.

- •60.Проверка качества эконометрической модели См.5

- •61.Прогнозирование экономических переменных. Проверка адекватности модели. См.5

- •62 Простейшие модели временных рядов. Их свойства

- •63.Регрессионные модели с фиктивными переменными.

- •64.Роль вектора и матрицы корреляции множественной линейной модели при подборе объясняющих переменных.

- •65.Свойства дисперсии случайной переменной

- •66.Случайные переменные и их характеристики.

- •67.Смысл и значение множественной регрессии в эконометрических исследованиях. Выбор формы уравнения множественной регрессии.

- •68 Составление спецификации модели временного ряда

- •69.Спецификация и оценивание мнк эконометрических моделей нелинейных по параметрам

- •70 Спецификация моделей со случайными возмущениями и преобразование их к системе нормальных уравнений

- •71.Способы корректировки гетероскедастичности. Метод взвешенных наименьших квадратов.

- •72.Статистические свойства оценок параметров парной регрессионной модели.

- •73.Статистические характеристики выборки и генеральной совокупности статистических данных. Их соотношения.

- •74.Суть метода наименьших квадратов. Его графическое пояснение

- •75.Схема Гаусса – Маркова.

- •76.Схема построения эконометрической модели.

- •77.Теорема Гаусса – Маркова.

- •78.Тест Дарбина – Уотсона, последовательность его выполнения.

- •79.Тест Стьюдента.

- •80. Типы переменных в эконометрических моделях. Структурная и приведённая формы спецификации эконометрических моделей.

- •81. Устранение автокорреляции в парной регрессии. (см. 4)

- •82. Функция регрессии как оптимальный прогноз.

- •83. Цели и задачи эконометрики. Этапы процесса эконометрического моделирования. Классификация эконометрических моделей.

- •84. Эконометрика, её задача и метод.

- •85. Эконометрическая инвестиционная модель Самуэльсона-Хикса.

- •87. Этапы исследования зависимостей между экономическими явлениями при помощи эконометрической модели. Принципы спецификации модели. Формы эконометрических моделей.

- •88. Этапы построения эконометрических моделей

77.Теорема Гаусса – Маркова.

Пусть

матрица Х уравнений наблюдений

имеет размер nx(k+1),

где n>k+1,

и обладает линейно-независимыми

столбцами, а случайные возмущения(

имеет размер nx(k+1),

где n>k+1,

и обладает линейно-независимыми

столбцами, а случайные возмущения( =

= ) удовлетворяют четырем условиям:

) удовлетворяют четырем условиям:

E(u1)=…=E(un)=0

Var(u1)=…=Var(un)=

Cov(ui,uj)=0 , i≠j

Cov(xmi,uj)=0 при всех значениях m,i,j.

Тогда:

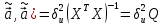

а)

наилучшая линейная процедура

имеет вид:

имеет вид:

б)

эффективная линейная несмещенная оценка

обладает свойством наименьших квадратов:

ESS=

в)

ковариационная матрица оценки

вычисляется по правилу: Cov(

вычисляется по правилу: Cov(

г)

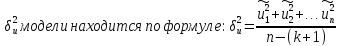

несмещенная оценка параметра

,

где n –число уравнений

наблюдений, k+1 – количество

неизвестных коэффициентов функции

регрессии модели.

,

где n –число уравнений

наблюдений, k+1 – количество

неизвестных коэффициентов функции

регрессии модели.

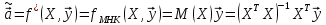

Следствие.

Оценка

,

доставляемая процедурой :

,

доставляемая процедурой :

метода

наименьших квадратов, может быть

вычислена в процессе решения системы

двух линейных алгебраических уравнений:

метода

наименьших квадратов, может быть

вычислена в процессе решения системы

двух линейных алгебраических уравнений:

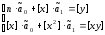

именуемой системой

нормальных уравнений. Ее коэф-ты и

свободные члены вычисляются по правилам:

именуемой системой

нормальных уравнений. Ее коэф-ты и

свободные члены вычисляются по правилам:

[x] = x1 + x2 +…+ xn,

[y] = y1 + y2 +…+ yn,

[x2] = x12 + x22 +…+ xn2,

[xy] = x1*y1 + x2*y2 + … + xn*yn .

Вот явный вид решения системы:

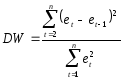

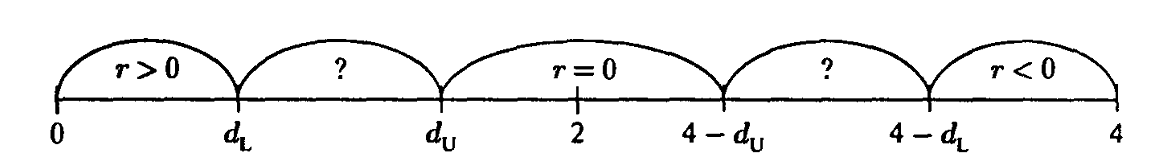

78.Тест Дарбина – Уотсона, последовательность его выполнения.

В классической регрессионной модели выполнение третьего условия Гаусса-Маркова (Соv(εt εS) = 0,при t ≠ s) гарантирует некоррелированность значений случайных членов в различные моменты наблюдений и это позволяет получить несмещенные МНК-оценки с минимальной дисперсией. Зависимость значений случайных членов в различные моменты времени называется автокорреляцией (сериальной корреляцией).

Формальной причиной автокорреляции в регрессионных моделях является нарушение третьего условия теоремы Гаусса-Маркова, действительной же причиной может быть: неправильная спецификация переменных (пропуск важной объясняющей переменной); использование ошибочной функциональной зависимости, а иногда и характер наблюдений (например, временные ряды).

Для проверки на автокорреляцию используется ряд критериев, из которых наиболее широкое применение получил тест Дарбина-Уотсона.

Последовательность его выполнения:

1.оценка модели и вычисление остатков;

2. вычисление статистики DW:

3.выбор табличных значений границ критического значения статистики: du, dL ( по параметрам n, k, α);

4.определение интервала, в который попадает вычисленное значение статистики DW.

При этом возможны следующие случаи:

Наличие положительной автокорреляции: DW<dL.

Наличие отрицательной автокорреляции: DW >4-dL.

Автокорреляция отсутствует: dU ≤ DW≤ 4-dU.

Зоны неопределенности: dL<DW< dU или 4- dU <DW<4-dL.

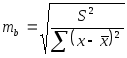

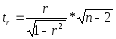

79.Тест Стьюдента.

Для оценки статистической значимости коэффициентов регрессии и корреляции рассчитываются t-критерий Стьюдента и доверительные интервалы каждого из показателей.

Для оценки значимости коэффициента регрессии его величину сравнивают с его стандартной ошибкой, т.е. определяют фактическое значение t-критерия Стьюдента

где mb

– стандартная

ошибка параметра

где mb

– стандартная

ошибка параметра

,

,

где S остаточная дисперсия на одну степень свободы

Данный критерий

затем сравнивается с табличным значением

при

определенном уровне значимости α и

числе степеней свободы (n-2).

Этот же результат можно получить после

извлечения корня из F-критерия,

т.е. tb= .

Аналогично для параметра а.

.

Аналогично для параметра а.

Фактическое значение t-критерия Стьюдента определяется как

Данная формула свидетельствует о том, что в парной линейной регрессии t2r=F. Кроме того t2b=F, следовательно, t2r= t2b. Таким образом проверка гипотез о значимости коэффициентов регрессии и корреляции равносильна проверке гипотезы о значимости линейного уравнения регрессии.

Сравнивая фактическое и критическое (табличное) значения t-статистики – tтабл и tфакт - принимаем или отвергаем гипотезу H0.

Если tтабл < tфакт, то H0 отклоняется, т.е. a и b не случайно отличаются от нуля и сформировались под влиянием систематически действующего фактора х. Если tтабл > tфакт, то гипотеза Но не отклоняется и признается случайная природа формирования a и b.