- •Глава 3 оценка параметров и обучение с учителем

- •3.1. Оценка параметров и обучение с учителем

- •3.2. Оценка по максимуму правдоподобия

- •3.2.1. Общая идея метода

- •3.2.2. Случай многомерного нормального распределения: неизвестно среднее значение

- •3.2.3. Общий многомерный нормальный случай

- •3.3. Байесовский классификатор

- •3.3.1. Плотности, условные по классу

- •3.3.2. Распределение параметров

- •3.4. Обучение при восстановлении среднего значения нормальной плотности

- •3.4.1. Случай одной переменной: p(|)

- •3.4.2. Случай одной переменной: p(X|)

- •3.4.3. Случай многих переменных

- •3.5. Байесовское обучение в общем случае

- •3.6. Достаточные статистики

- •3.7. Достаточные статистики и семейство экспоненциальных функций

- •3.8. Проблемы размерности

- •3.8.1. Неожиданная трудность

- •3.8.2. Оценка ковариационной матрицы

- •3.8.3. Емкость разделяющей плоскости

- •3.8.4. Уровень ошибки усредненный по задачам

- •3.9. Оценка уровня ошибки

- •3.10. Библиографические и исторические сведения

3.7. Достаточные статистики и семейство экспоненциальных функций

Рассмотрим

применение теоремы факторизации для

получения достаточных статистик на

примере хорошо знакомого случая

нормального распределения при

p(x|![]() )~N(

)~N(![]() ,

,![]() ).

Имеем

).

Имеем

![]()

В

этом разложении первый множитель

выделяет зависимость p(![]() |

|![]() )

от

)

от

![]() ,

а согласно

теореме факторизации, видно, что

статистика

,

а согласно

теореме факторизации, видно, что

статистика

![]() достаточна для

достаточна для

![]() .

Конечно, любая взаимно однозначная

функция этой статистики также достаточна

для

.

Конечно, любая взаимно однозначная

функция этой статистики также достаточна

для

![]() ,

в частности и выборочное среднее

,

в частности и выборочное среднее

![]()

также

достаточно для

![]() .

Исходя из этой статистики, можно написать

.

Исходя из этой статистики, можно написать

g(mn,

![]() )=

)=![]() .

.

Воспользовавшись формулой (38) или непосредственной подстановкой, можно получить ядро плотности

Из

этого выражения сразу же выясняется,

что mn

и есть оценка по максимуму правдоподобия

для

![]() .

Байесовскую апостериорную плотность

можно получить из

.

Байесовскую апостериорную плотность

можно получить из

![]() (mn,

(mn,

![]() ),

выполняя интегрирование согласно

(39). Если

априорная плотность близка к равномерной,

то р

(

),

выполняя интегрирование согласно

(39). Если

априорная плотность близка к равномерной,

то р

(![]() |

|![]() )

=

)

=![]() (mn,

(mn,

![]() ).

).

Такой же общий подход возможен и при определении достаточных статистик для других функций плотности. В частности, он применим к любому из членов экспоненциального семейства, группы функций распределения и плотностей, имеющих простые достаточные статистики. В число членов экспоненциального семейства входят нормальное, экспоненциальное, релеевское, пуассоновское и многие другие известные распределения. Все они могут быть записаны в виде

р(х|![]() )

=

)

=![]() (x)exp[a(

(x)exp[a(![]() )+b(

)+b(![]() )tc(x)]

(40)

)tc(x)]

(40)

Таким образом, получаем

(41)

(41)

где можно принять

![]() (42)

(42)

g(s,

![]() )=exp[n{a(

)=exp[n{a(![]() )+b(

)+b(![]() )ts}]

(43)

)ts}]

(43)

и

![]() .

(44)

.

(44)

Выражения функций распределения, достаточных статистик и ненормированных ядер для некоторых обычно встречающихся членов экспоненциального семейства приведены в табл. 3.1.Вывод из этих выражений оценок по максимуму правдоподобия и байесовских апостериорных распределений вполне обычная вещь. Выражения, за исключением двух, приведены для случая одной переменной, хотя и могут быть использованы для случаев с многими переменными, если можно допустить статистическую независимость11.

|

Общий вид распределений из экспоненциального семейства | |||||

|

Наименование |

Распределение |

Область определения |

s |

[g (S,

| |

|

Нормальное, с одной переменной |

|

|

|

| |

|

Нормальное, с многими переменны-ми |

|

|

|

| |

|

Экспоненциальное |

|

|

|

| |

|

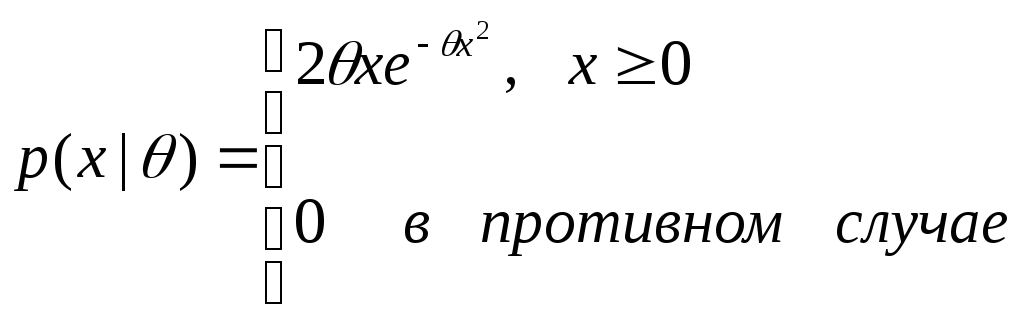

Релея |

|

|

|

| |

|

Максвелла |

|

|

|

| |

|

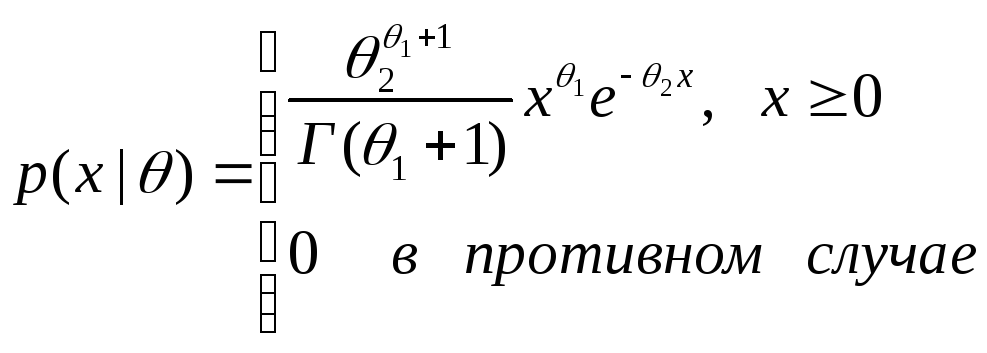

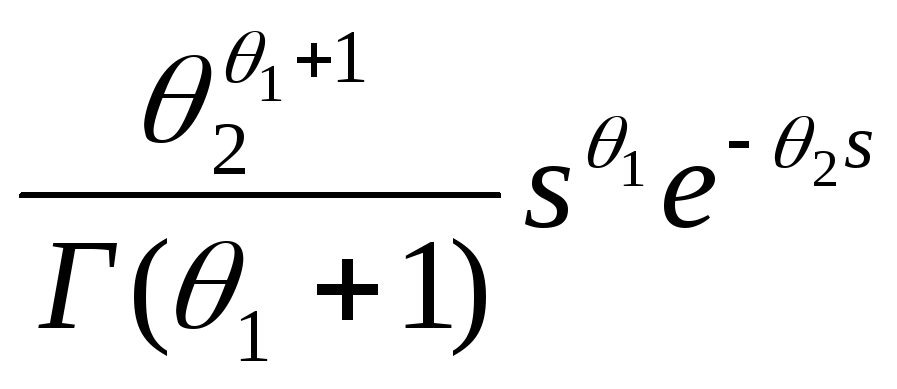

Гамма |

|

|

|

| |

|

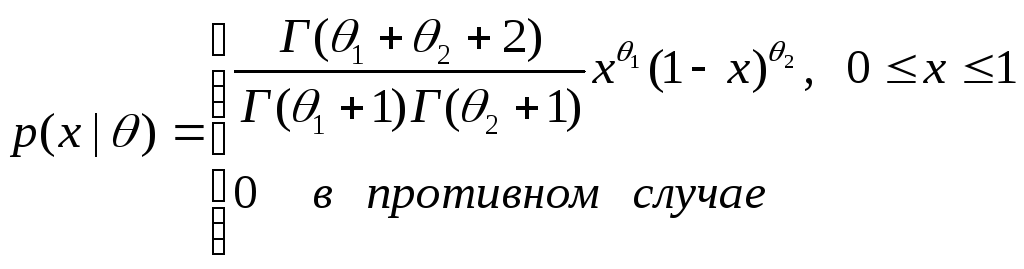

Бета |

|

|

|

| |

|

Пуассона |

|

|

|

| |

|

Бернулли |

|

0< |

|

| |

|

Биномиальное |

x=0,1,. . .,m |

0< |

|

| |

|

Полино-миальное |

|

0<

|

|

| |

Было бы приятно отметить в заключение, что полученные результаты составляют набор средств, достаточный для решения большинства задач из области классификации образов. К сожалению, все обстоит иначе. В применении ко многим случаям указанные члены экспоненциального семейства с их плавным изменением и однообразием формы не представляют хорошего приближения реально встречающихся плотностей. Часто применяемое упрощающее предположение о статистической независимости далеко не всегда оказывается справедливым. В случае, когда применение функции из экспоненциального семейства и дает хорошее приближение неизвестной плотности, обычно бывает необходимо оценивать множество неизвестных параметров, а в распоряжении имеется только ограниченное число выборок. Как мы увидим, это может привести к тому, что оптимальные оценки дадут малоудовлетворительные результаты, и даже к тому, что «оптимальные» системы будут выполнять свои функции хуже, нежели «почти оптимальные».