- •1) Информационную производительность символа a ;

- •1) Информационную производительность символа a ;

- •Пропускная способность двоичного канала с определяется следующей формулой:

- •4) Кодовой комбинацией

- •86. На рисунке:

- •88. На рисунке:

- •89. На рисунке:

- •102. На рисунке:

- •103. На рисунке

- •108. На рисунке:

- •109. На рисунке:

- •2) Сообщения

- •1) Фильтра верхних частот

- •2) Полосового фильтра

- •4) Фильтра нижних частот

- •Идеального фильтра

- •Полосового фильтра

Системы Документальной Электро Связи.

Объектом передачи в сети связи является:

1) Сигнал;

2) Коды;

3) Сообщения;

4) Энергия.

Сообщения, поступающие через телефонную трубку, являются:

1) Цифровыми;

2) Дискретными;

3) Аналоговыми;

4) Кодовыми.

Физический процесс, отображающий передаваемое сообщение, называется:

1) Кодовой комбинацией;

2) Сигналом;

3) Помехой;

4) Колебаниями.

Цифровой сигнал – это сигнал, дискретизированный:

1) По времени;

2) По времени и по уровню;

3) По мгновенному значению;

4) Только по уровню.

На рисунке № 1 показаны:

Рисунок № 1.

1) Аналоговый сигнал;

2) Цифровой сигнал;

3) Сигнал, дискретизированный только по времени;

4) Сигнал, дискретизированный только по уровню.

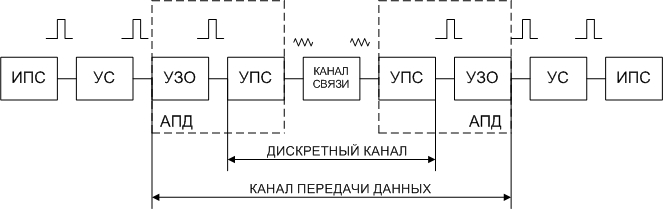

На рисунке № 2 модем изображен в виде:

Рис. 2 Структурная схема канала ПДС.

1) УЗО; 2) УПС; 3) УС; 4) ИПС.

На рисунке № 3

Рисунок

№ 3. Структурная схема канала ПДС.

Рисунок

№ 3. Структурная схема канала ПДС.

Устройство, повышающее правильность передачи:

1) Входит в дискретный канал;

2) Входит в канал передачи данных;

3) Входит в аппаратуру передачи данных АПД;

4) Является устройством УС.

Если P (a/b) и P (b/a) условные вероятности появления зависимых событий «a» и «b» , то вероятность совместного появления P (a, b) равна:

1) P (a, b) = P (a/b) * P (b);

2) P (a, b) = P (a) * P (b);

3) P (a, b) = P (a) + P (b);

4) P (a, b) = P (b/a) * P (a).

Если события «a» и «b» взаимно независимые, вероятность их совместного появления P (a, b) равна:

1) P (a) + P (b) ;

2) P (a) – P (b) ;

3) P (a) * P (b) ;

4) P (a) \ P (b).

Какие значения вероятностей не могут иметь место:

1) 0, 75;

2) 1,5 ;

3) -0,25 ;

4) 0.

Имеются 4 равновероятных символа. Сколько единиц информации содержится в каждом из них? :

1) Одна ;

2) Две ;

3) Три ;

4) Четыре.

В двоичном коде вероятность появления единицы равна 0, 25. Сколько бит информации приносит появление единицы:

1) 1 ;

2) 2 ;

3) 0,5 ;

4) 1,5.

В алфавите имеются 4 символа. Вероятности появления

P

(a![]() )

= 0,1 ; P (a

)

= 0,1 ; P (a![]() )

= 0,2 ; P

(a

)

= 0,2 ; P

(a![]() )

= 0,3 ; P (a

)

= 0,3 ; P (a![]() )

= 0,4.

)

= 0,4.

Какой из символов имеет большее количество информации? :

1) a ;

2) a ;

3) a ;

4) a .

Определить энтропию алфавита из четырёх символов - --a , a , a , a с вероятностями P (a ) = 0,5 ; P (a ) = 0,25 ; P (a ) = 0,125 ; P (a ) = 0,125 :

1) 1, 25 ; 2) 1, 5 ; 3) 1, 75 ; 4) 1, 85.

Имеются четыре двоичных источника – И1, И2, И3, И4, генерирующих единичные символы с вероятностями-- P

(1)=0,2

; P

(1)=0,2

; P (1)

= 0,5 ; P

(1)

= 0,5 ; P (1) = 0,6 ; P

(1) = 0,6 ; P (1)

= 0,8.

(1)

= 0,8.

Какой из источников имеет наибольшую энтропию? :

1) 1;

2) 2;

3) 3;

4) 4.

Имеются четыре двоичных источника - И1, И2, И3, И4, генерирующих единичные символы с вероятностями -- P (1)=0,2 ; P (1) = 0,5 ; P (1) = 0,6 ; P (1) = 0,8.

Укажите номера источников, имеющих равные энтропии:

1) 1 ;

2) 2 ;

3) 3 ;

4) 4 .

Алфавит источника имеет 32 символа с равными вероятностями появления. Какое количество бит информации несет каждый символ:

1) Два бита ;

2) Три бита ;

3) Четыре бита ;

4) Пять бит.

Выражение I(a

)=-log

P(a

)

определяет :

)=-log

P(a

)

определяет :

1) Информационную производительность символа a ;

2) Вероятность появления символа a ;

3) Энтропию алфавита, содержащего символ a ;

4) Скорость модуляции символов.

Выражение M*{I*(a )} = -

P(a

)*loq

P(a

)*loq P(a

)

определяет :

P(a

)

определяет :

1) Информационную производительность символа a ;

2) Вероятность появления символа a ;

3) Энтропию алфавита, содержащего символ a ;

4) Скорость модуляции символов.

Выражение B =

определяет

:

определяет

:

1) Информационную производительность символа a ;

2) Вероятность появления символа a ;

3) Энтропию алфавита, содержащего символ a ;

4) Скорость модуляции символов.

Двоичный алфавит состоит из двух символов : единиц – «1» и нулей «0» с вероятностями появления P(1) и P(0). При каких значениях P (1) и P (0) передаваемая символами информация будет равна нулю?

1) P(1) = 0 ;

2) P(1) = 1 ;

3) P(1) = 1 ;

4) P(1) = 0,5.

Двоичный алфавит состоит из двух символов : единиц – «1» и нулей «0» с вероятностями появления P(1) и P(0). При каких значениях P (1) и P (0) будет передаваться символам наибольшее количество информации?

1) P(1) = 0,2 ;

2) P(1) = 0,3 ;

3) P(1) = 0,5 ;

4) P(1) = 1.

Избыточность источника

= 1 -

= 1 -

.

.

Чему равна избыточность источника, содержащего 32 равновероятных символа, если его энтропия равна 2 ?

1) 0,2

2) 0,4

3) 0,6

4) 0,8.

Сколько двоичных разрядов содержит код Бодо?

4 б) 5 в) 7 г) 8.

Сколько информационных разрядов содержит код

МТК-2 ?

1) 5 ; 2) 6 ; 3) 7 ; 4) 8 .

Алфавит содержит 4 символа a,b,c и d с вероятностями появления P(a) = 0,5 ; P(b) = 0,25 ; P(c) = 0,125 и P(d) = 0,125.

Какой из кодов Хаффмена соответствует символу «c»?

1) 1 ;

2) 000 ;

3) 001 ;

4) 01.

Алфавит содержит 4 символа a,b,c и d с вероятностями появления P(a) = 0,5 ; P(b) = 0,25 ; P(c) = 0,125 и P(d) = 0,125.

Какой из кодов Хаффмена соответствует символу «b»?

1) 1 ;

2) 000 ;

3) 001 ;

4) 01.

На рисунке № 4 представлена амплитудно-частотная характеристика:

1) Фильтра верхних частот ;

2) Полосового фильтра ;

3) Идеального фильтра ;

4) Фильтра нижних частот.

Рис. 4. Амплитудно-частотная характеристика.

Пропускная способность двоичного канала С

определяется следующей формулой:

определяется следующей формулой:

С

=

![]()

При каких значениях вероятности P ошибки происходит «обрыв» канала ?

1) P = 0 ; 2) P = 1 ; 3) P = 0,5 ; 4) P = 0,125.

Пропускная способность двоичного канала с определяется следующей формулой:

С

=

![]()

При каких значениях вероятности P ошибки пропускная способность канала имеет максимальное значение ?

1) P = 0 ;

2) P = 1 ;

3) P = 0,5 ;

4) P = 0,125.

Канал называется симметричным если:

1) Вероятности неправильного и правильного приёма символов равны;

2) Вероятности правильного приёма больше вероятностей неправильного приёма;

3) Все вероятности неправильного приёма символов равны между собой;

4) Все вероятности правильного приема символов равны между собой.

Двоичный канал называется симметричным, если :

![]()

1)

P![]() = P

= P![]() ;

;

2)

P

= P![]() ;

;

3)

P

= P![]() ;

;

4) P = P

Аддитивные помехи – это помехи, которые:

1) Умножаются ;

2) Суммируются ;

3) Делятся ;

4) Вычитаются.

При каких видах краевых искажений нельзя применять метод стробирования? :

1) Преобладания ;

2) Случайные краевые искажения ;

3) Характеристические искажения ;

4) Дробления.

На рисунке № 5 изображена схема :

Рис. 5. Схема устройства регистрации методом интегрирования.

На какую точку поступают стробирующие импульсы? :

1) На 1 ; 2) На 2.; 3) На 3 ; 4) На 4 .

Формула P(t, n) = C

P

P (1-P)

(1-P)

определяет :

определяет :

1) Число ошибочно принятых кодовых комбинаций;

2) Вероятность получения в кодовой комбинации n ошибок;

3) Вероятность получения в кодовой комбинации t ошибок;

4) Вероятность получения P ошибок в кодовой комбинации.

Вероятность появления искаженной кодовой комбинации P (

1,

n)

определяется

формулой :

1,

n)

определяется

формулой :

1)

P

(![]() 1,

n)

= 1- P (0, n)

;

1,

n)

= 1- P (0, n)

;

2) P ( 1, n) = 1- P (1, n) ;

3) P ( 1, n) = 1- P (n, n) ;

4) P ( 1, n) = 1+ P (1, n) .

При каких значениях справедливо выражение для биноминального распределения ?

P

(

1,

n)

![]() n

P

n

P

1) При больших значениях n ;

2) При больших значениях P ;

3) При малых значениях n ;

4) При малых значениях P .

Формула Пуртова для группирующихся ошибок имеет вид :

1)

P

(

1,

n)

= n![]() P

P![]() ;

;

2)

P

(![]() 0,

n)

= n

P

;

0,

n)

= n

P

;

3) P ( 0, n) = n P ;

4) P ( α, n) = n P .

В формуле Пуртова коэффициент группирования ошибок α :

1) Больше нуля ;

2) Меньше нуля ;

3) Больше единицы ;

4) Меньше единицы .

В формуле Пуртова

P

(

t,

n)

= (![]() )

P

)

P

1) P - вероятность ошибочной кодовой комбинации ;

2) P - вероятность ошибочного единичного элемента ;

3) t - число ошибок в кодовой комбинации ;

4) n - число ошибок в кодовой комбинации .

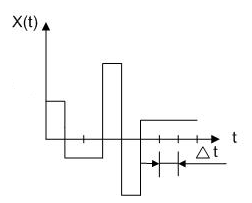

В

методе наложения , представленном на

рисунке № 6,

методе наложения , представленном на

рисунке № 6,

Рис. 6. Метод наложения.

Δ

t![]() и

Δ t

и

Δ t![]() - краевые искажения ;

- краевые искажения ;

а

![]()

![]() - интервал времени несущей .

- интервал времени несущей .

Какие условия удовлетворяются ?

1) Δ t ≤ ;

2) Δ t > ;

3) Δ t + ;

4)

Δ

t

+

Δ

t![]() .

.

Метод скользящего импульса с подтверждением :

1) Точнее метода наложения ;

2) Хуже метода наложения ;

3) Одинаков по точности с методом наложения ;

4) Намного уступает по точности методу наложения .

На рисунке № 7 изображена структурная схема устройства синхронизации с делителем частоты.

Рис. 7. Структурная схема устройства синхронизации с делителем частоты.

Каким признакам классификации она удовлетворяет ?

1) С постоянной частотой задающего генератора ;

2) С переменной частотой задающего генератора ;

3) С замкнутым циклом управления ;

4) С разомкнутым циклом управления .

Коды Хемминга удовлетворяют утверждению :

а) Блочные, неравномерные, линейные ;

б) Блочные, разделимые, нелинейные ;

в) Блочные, разделимые, линейные ;

г) Непрерывные, не разделимые, линейные .

Коды Хаффмена удовлетворяют условию :

1) Блочные, равномерные ;

2) Непрерывные, неравномерные ;

3) Блочные, неравномерные ;

4) Непрерывные, равномерные .

Циклические коды удовлетворяют условию :

1) Блочные, неравномерные, линейные ;

2) Блочные, разделимые, нелинейные ;

3) Блочные, разделимые, линейные ;

4) Непрерывные, не разделимые, линейные .

Итеративные коды удовлетворяют условию :

1) Блочные, неравномерные, линейные ;

2) Блочные, разделимые, нелинейные ;

3) Блочные, разделимые, линейные ;

4) Непрерывные, не разделимые, линейные .

Сколько проверочных разрядов имеет вид код (7, 4) :

1) 7 ; 2) 4 ; 3) 11 ; 4) 3 .

Сколько информационных разрядов имеет код (8, 7) :

1) 8 ; 2) 7 ; 3) 15 ; 4) 1 .

Избыточность кода определяется соотношением :

1)

![]() =

=

![]() ;

;

2)

=

![]() ;

;

3) = 1 - ;

4)

=

![]() .

.

Код с кодовым расстоянием d

=

6

обнаруживает :

=

6

обнаруживает :

1) 2 ошибки ;

2) 4 ошибки ;

3) 5 ошибок ;

4) 6 ошибок .

Код с кодовым расстоянием d = 6 исправляет :

1) Одну ошибку ;

2) Две ошибки ;

3) Три ошибки ;

4) Четыре ошибки .

Для исправления всех одиночных ошибок в кодовой комбинации с количеством разрядов n = 17 минимальное число проверочных разрядов должно быть равно :

1) 3 ; 2) 4 ; 3) 5 ; 4) 6 .

Дан код Хемминга.

ā

= (a![]() a

a![]() a

a![]() a

a![]() b

b

b

b![]() b

)

, причем

:

b

)

, причем

:

b

= a

![]() a

a

;

a

a

;

b = a a a ;

b = a a a .

Чему равен код b b b проверочных разрядов для исходного кода 1101 ?

1) 100 ; 2) 010 ; 3) 001 ; 4) 011 .

Дан код Хемминга.

ā = (a a a a b b b ) , причем :

b = a a a ;

b = a a a ;

b = a a a .

В каком разряде произошла одиночная ошибка , если синдром кода С = 010 ?

1) a ; 2) b ; 3) b ; 4) a .

Дан код Хемминга.

ā = (a a a a b b b ) , причем :

b = a a a ;

b = a a a ;

b = a a a .

В каком разряде произошла одиночная ошибка, если синдром кода С = 101 ?

1) a ; 2) b ; 3) a ; 4) b .

Сведения, являющиеся объектом передачи, распределения, хранения, преобразования:

1) Электрические сигналы

2) Информация

3) Модуляция

4) Элементы памяти

59. Переносчиком информации в электросвязи являются:

1) Электрические линии

2) Электромагнитные колебания

3) Акустические волны

4) Оптические сигналы

60. Среднее количество информации, приходящееся на один символ:

1) Производительность источника

2) Скорость модуляции

3) Энтропия источника

4) Пропускная способность

61. Количество единичных элементов, передаваемых в единицу времени:

1) Информационная производительность

2) Скорость модуляции

3) Количество информации

4) Пропускная способность

62. Формула

![]() определяет:

определяет:

1) Вероятность передачи символа «а»

2) Скорость передачи символа «а»

3) Информацию, содержащуюся в символе «а»

4) Число единичных элементов в символе «а»

63. Формула

![]() определяет:

определяет:

1) Вероятность появления символа «а»

2) Энтропию символа «а»

3) Количество символов «а»

4) Число единичных элементов в символе «а»

64. В

формуле скорости модуляции

![]() означает:

означает:

1) Длительность кодовой комбинации

2) Длительность единичного элемента

3) Длительность одного бита информации

4) Длительность одного кадра

65. На структурной схеме ПДС:

устройство, которое обеспечивает преобразование сведений пользователя к виду, удобному для передачи:

1) УЗО 2) УПС 3)ИПС 4) УС

66. На структурной схеме ПДС:

устройство, выполняющее алгоритм повышения верности передачи:

1) УС 2) УЗО 3) УПС 4) ИПС

67. На структурной схеме ПДС:

устройство, обеспечивающее создание дискретного канала связи, осуществляющее модуляцию сигнала:

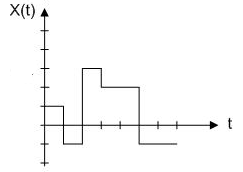

1) УЗО 2) УПС 3) ИПС 4) УС

68. Рисунок представляет график:

1) Дискретная функция дискретного аргумента

2) Непрерывная функция дискретного аргумента

3) Дискретная функция непрерывного аргумента

4) Непрерывная функция непрерывного аргумента

69. Рисунок

представляет график:

1) Дискретная функция дискретного аргумента

2) Непрерывная функция дискретного аргумента

3) Дискретная функция непрерывного аргумента

4) Непрерывная функция непрерывного аргумента

70. Электрический сигнал, соответствующий одному разряду кодового слова называется:

1) Значащим моментом

2) Значащей позицией

3) Единичным элементом