- •Интеллектуальный анализ данных

- •Изучение алгоритмов построения деревьев решений с целью выявления закономерностей

- •Типа «Если – То»

- •(Системы see5/c5 и tree analyzer)

- •Интеллектуальный анализ данных Изучение алгоритмов построения деревьев решений с целью выявления закономерностей типа «Если – То»

- •1 Теоретическая часть

- •1.1 Деревья решений

- •2 Построение деревьев решений — система See5/c5.0

- •Подготовка данных для See5

- •Файл имен переменных

- •Файл данных

- •Файлы тестовых данных (необязательные)

- •Файл стоимости

- •Интерфейс пользователя

- •Построение дерева решений

- •Преобразование дерева решений в набор правил

- •Усиление решения (Boosting)

- •Использование правил для принятия решений

- •Смягчение порогов

- •Дополнительные настройки алгоритма

- •Перекрестная проверка

- •Выборка из больших наборов данных

- •Учет стоимости различных ошибок классификации

- •Предсказанный класс, истинный класс: стоимость ошибки,

- •Детальная проверка и сохранение результатов

- •3 Задание на лабораторную работу

- •Правила подготовки данных для работы в системе See-5 Вариант 1

- •Правила подготовки данных для работы в системе See Вариант 2

- •Подготовка данных в системе Tree_Analyser

- •4 Отчет должен содержать

- •5 Вопросы для защиты

- •Список литературы

Выборка из больших наборов данных

Несмотря на высокое быстродействие системы See5, конструирование классификаторов на полном наборе исходных данных при их большом количестве может занимать довольно много времени. Это становится особенно заметно при использовании дополнительных параметров алгоритма, например параметра для усиления решения (boosting).

See5 имеет возможность работы не с полным набором данных, а с некоторой выборкой из исходного набора. Для этого предусмотрен специальный параметр Use sample of X % (см. рис. 2). При использовании указанного параметра осуществляются две операции. Во-первых, из исходного набора случайным образом извлекается Х % объектов и на их основе конструируется классификатор. И, во-вторых, производится тестирование построенного классификатора на другой непересекающейся выборке объема Х % (если Х < 50 %) либо на всех оставшихся объектах (если Х > 50 %).

При очередном обращении к параметру Use sample of X % будет сделана новая случайная выборка из исходных данных, построен и протестирован новый классификатор. Но в системе See5 имеется также возможность зафиксировать выборку. Для этого необходимо поставить флажок в поле Lock sample.

Н

Рис.

8. Результаты классификации данных

ультразвуковой диагностики на обучающей

и контрольной выборках

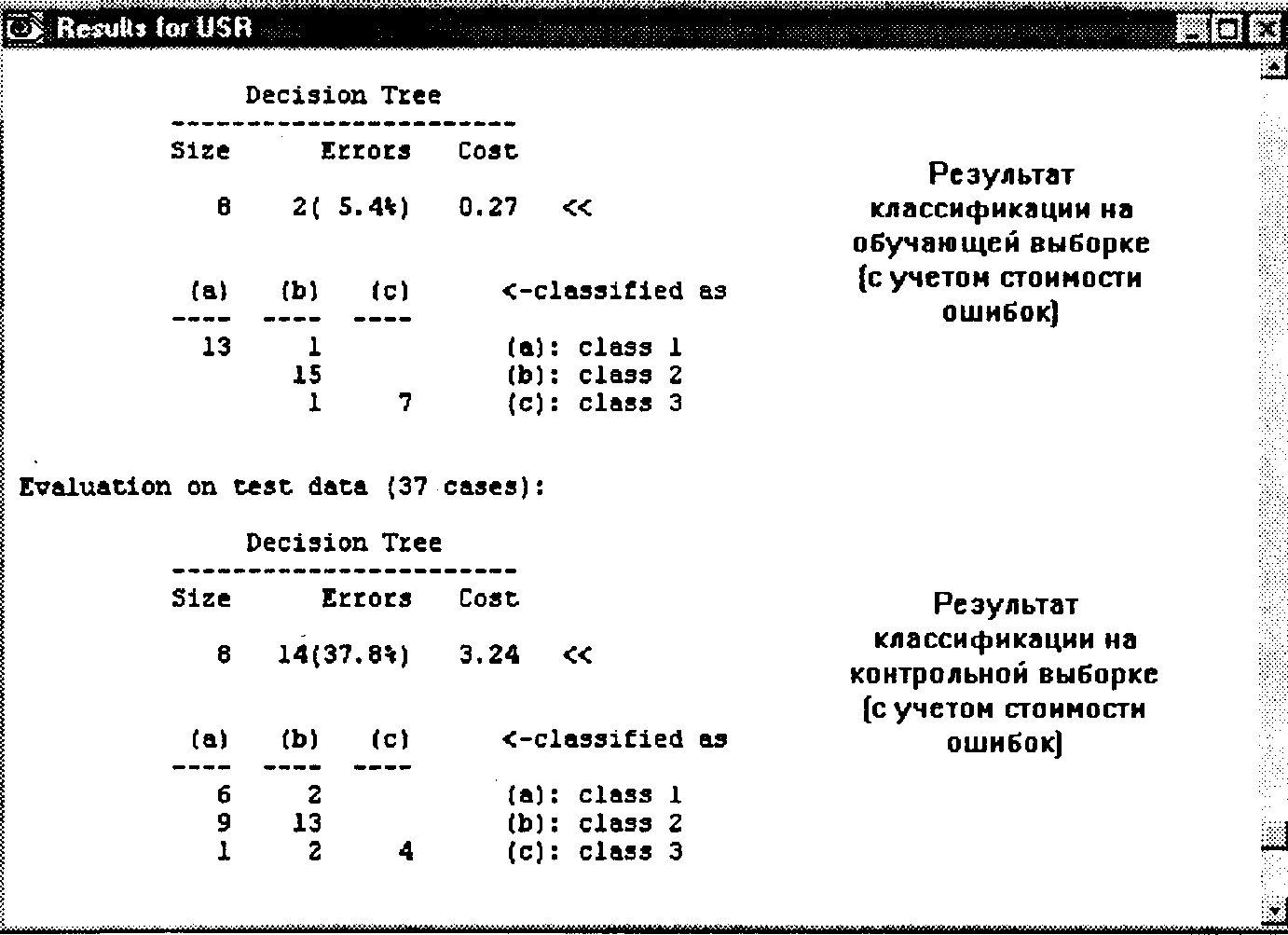

Учет стоимости различных ошибок классификации

До сего момента, анализируя данные по ультразвуковой диагностике заболеваний, мы считали все виды ошибок классификации эквивалентными. Мы давали оценку качества построенного классификатора, просто подсчитывая общее число ошибок. Но в реальной жизни стоимость различных ошибок может быть разной. Например, если мы ошибочно сочтем здорового человека больным и направим его на дополнительное обследование, это будет не так страшно, как в случае ошибочного отнесения больного к группе здоровых. Соответственно, при оценке качества построенного дерева решений часто бывает необходимо вводить в анализ веса различных ошибок.

В системе See5 для учета стоимости различных ошибок классификации создается специальный файл *. costs. Он содержит строки следующего вида:

Предсказанный класс, истинный класс: стоимость ошибки,

где «стоимость ошибки» — неотрицательное действительное число.

Число строк, характеризующих комбинации «предсказанный класс — истинный класс», в этом файле может быть любым. Если стоимость какой-либо ошибки не определена явно, то система назначает эту стоимость равной 1.

Предположим, что стоимость ошибочного отнесения больных почек к классу здоровых в нашем случае будет равна 10, а стоимость всех остальных видов ошибок равна 5. Тогда файл для учета различной стоимости ошибок USR.costs может выглядеть следующим образом:

| costsfileforUSR

1. 2: 10 стоимость ошибочного отнесения класса 2 к классу 1

1. 3: 10 стоимость ошибочного отнесения класса 3 к классу 1

2. 1: 5 стоимость ошибочного отнесения класса 1 к классу 2

2. 3: 5 стоимость ошибочного отнесения класса 3 к классу 2

3. 1: 5 стоимость ошибочного отнесения класса 1 к классу 3

3,.2: 5 стоимость ошибочного отнесения класса 2 к классу 3

Результаты обработки данных с разделением на обучающую и контрольную выборки (по 50 %) и с учетом стоимости различных ошибок приведены на рис. 9,

Д

Рис.

9. Результаты классификации с учетом

стоимости различных ошибок ля

редактирования файла стоимости различных

ошибок классификации следует его вызвать

из менюEdit

> costs

file

и внести необходимые изменения в

автоматически инициализированном

редакторе WordPad.

Можно исключить учет стоимости ошибок,

если поставить флажок Ignore

costs

file

в окне диалога для задания параметров

алгоритма построения деревьев решений

(см. рис. 2).

ля

редактирования файла стоимости различных

ошибок классификации следует его вызвать

из менюEdit

> costs

file

и внести необходимые изменения в

автоматически инициализированном

редакторе WordPad.

Можно исключить учет стоимости ошибок,

если поставить флажок Ignore

costs

file

в окне диалога для задания параметров

алгоритма построения деревьев решений

(см. рис. 2).

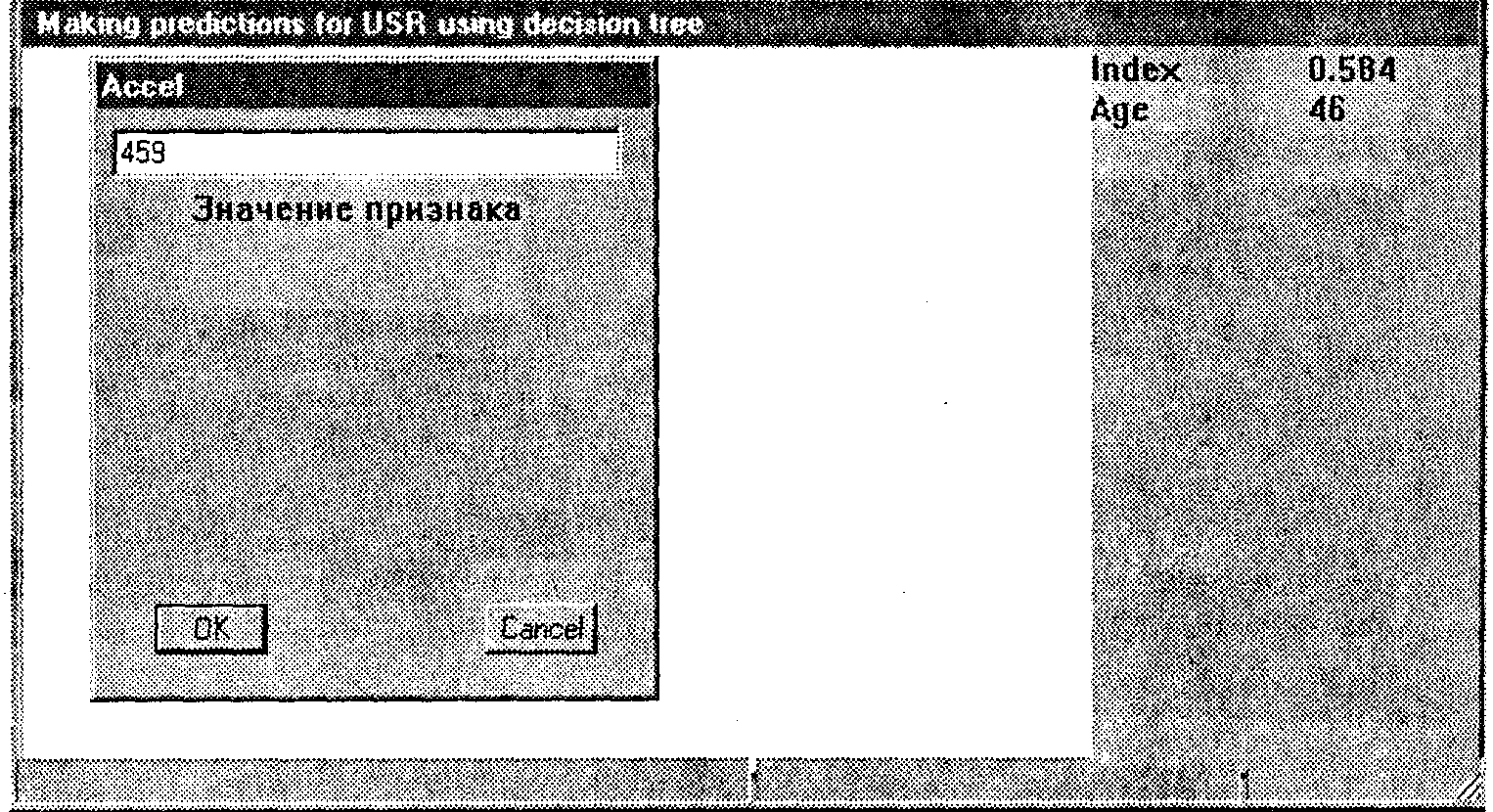

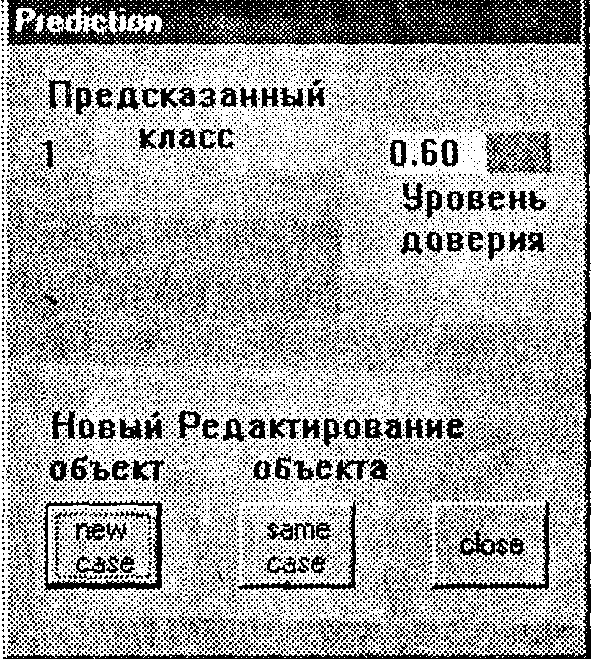

Использование классификаторов

П

Рис. 10 Интерактивный

режим классификации данных

Рис.

11. Результат интерактивной классификации