- •Лекция 1. Общие сведения об интеллектуальных системах.

- •Лекция 2. Основные понятия нейробиологии. Нейроны. Нейронные сети.

- •Модель Маккаллока—Питтса

- •Другие модели.

- •Лекция 3. Конечные автоматы и нейронные сети.

- •Лекция 4. Машины Тьюринга.

- •Лекция 5. Рекурсивные множества и тезис Тьюринга. Идея эффективной процедуры.

- •Лекция 6. Регулярные и представимые события

- •Лекция 7. Нейронные сети. Методы обучения нейронных сетей

- •Обучение однослойного персептрона

- •Обучение многослойного персептрона

- •Обучение без учителя

- •Нейронные сети Хопфилда и Хэмминга

- •Лекция 8. Персептрон Розенблатта

- •Лекция 9. Теорема Новикова

- •Лекция 10. Постановка задач распознавания.

- •1. Принцип перечисления членов класса

- •2. Принцип общности свойств

- •3. Принцип кластеризации

- •1. Эвристические методы

- •2. Математические методы

- •3. Лингвистические (синтаксические) методы

- •Простая модель распознавания образов.

- •Лекция 11. Структура знания. Представление знаний об окружающей среде

- •Модель окружающей среды. Исходные понятия

- •Формальные и неформальные отношения.

- •Природа времени.

- •Лекция 12. Представление знаний и вывод на знаниях Данные и знания

- •Модели представления знаний

- •Вывод на знаниях

- •Нечеткие знания

- •Лекция 13. Введение в основы нечеткой логики

- •Лекция 14. Экспертные системы, базовые понятия

- •Лекция 15. Машинная эволюция

- •Лекция 16. Игровые программы.

- •Конец повторять

- •Лекция 17. Интеллектуальные системы в Интернет

- •Машины поиска.

- •Неспециализированные и специализированные поисковые агенты

- •Системы интеллектуальных поисковых агентов

- •Система marri

- •Оглавление.

Простая модель распознавания образов.

Простая схема распознавания содержит два основных блока: датчик и классификатор.

Датчик представляет

собой устройство, преобразующее

физические характеристики объекта,

подлежащего распознаванию, в набор

признаков

![]() ,

которые характеризуют данный объект.

Классификатор представляет собой

устройство, относящее каждый

поступающий на его вход допустимый

набор значений к одному из конечного

числа классов (категорий), вычислив

множество значений решающих функций.

,

которые характеризуют данный объект.

Классификатор представляет собой

устройство, относящее каждый

поступающий на его вход допустимый

набор значений к одному из конечного

числа классов (категорий), вычислив

множество значений решающих функций.

Считается, что

система распознавания допускает ошибку

в том случае, если она относит к классу

wjобъект, на самом деле принадлежащий

отличному отwjклассу. Считается, что система распознаванияR1лучше

системы распознаванияR2,

если вероятность совершить ошибку для

системыR1меньше, чем для системыR2.Датчик выдает информацию в виде вектора![]() ,гдеп—число измеренных характеристик

каждого физического объекта. Предполагается,

что вектор измеренийхпринадлежит

одному изМклассов образовw1,

w2, . . . ,

wm.

,гдеп—число измеренных характеристик

каждого физического объекта. Предполагается,

что вектор измеренийхпринадлежит

одному изМклассов образовw1,

w2, . . . ,

wm.

Принимаем допущение о том, что априорныевероятности появления объектов каждого класса одинаковы, т. е. векторхможет с равной вероятностью относиться как к одному, так и к другому классу. Пустьр(х | wi)=pi(х)есть плотность распределения для векторахпри условии, что он принадлежит классуwi. В таком случае вероятность того, что на самом деле векторхпринадлежит классуwj, определяется выражением

.

.

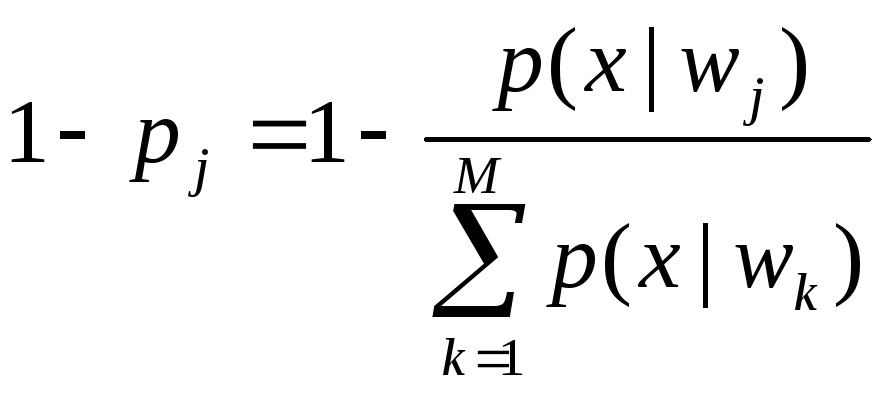

Вероятность того, что вектор хне принадлежит классуwj, определяется выражением

,

,

задающим вероятность ошибки.

Решающая функция представляет собой функцию d(x),относящуюхточно к одному изМзаданных классов. Оптимальной считается решающая функцияd°(x), которая дает наименьшую вероятность ошибки при всех допустимых значениях х, Значениеj, при котором величина1 – рj, будет наименьшей, совпадает с тем значениемj, которому соответствует наибольшее значение вероятностир(х|wj). Итак, оптимальная решающая функция d°(x)относит набор х к классуwiв том и только том случае, если выполняются неравенства

![]()

или

![]() .

.

При р(х|wi)=р(х|wk)ир(х|wi)>р(х|wj), j=1, 2, .... M, jik,оптимальная решающая функцияd°(х)может отнести векторхкак к классуwi, так и к классуwk. Для заданного значенияхклассификатор определяет оптимальную решающую функцию.

Допустим, наконец, что измеренные значения распределены нормально и соответствующие ковариационные матрицы имеют вид

,

,

где cij– ковариацияi-й иj-й компонент вектора измеренийx, а cij – дисперсияi-й компоненты измеренийx. Поскольку в случае нормального распределения имеем

![]() ,

,

где mi–вектор математического ожидания, отношение двух плотностейp(x|wi)иp(x|wj)определяется выражением

![]()

Так как ковариационная матрица симметрична, данное отношение условных вероятностей сводится к следующему:

![]() .

.

Введем величину

![]() ;

;

тогда получим выражения для разделяющей функции

![]() .

.

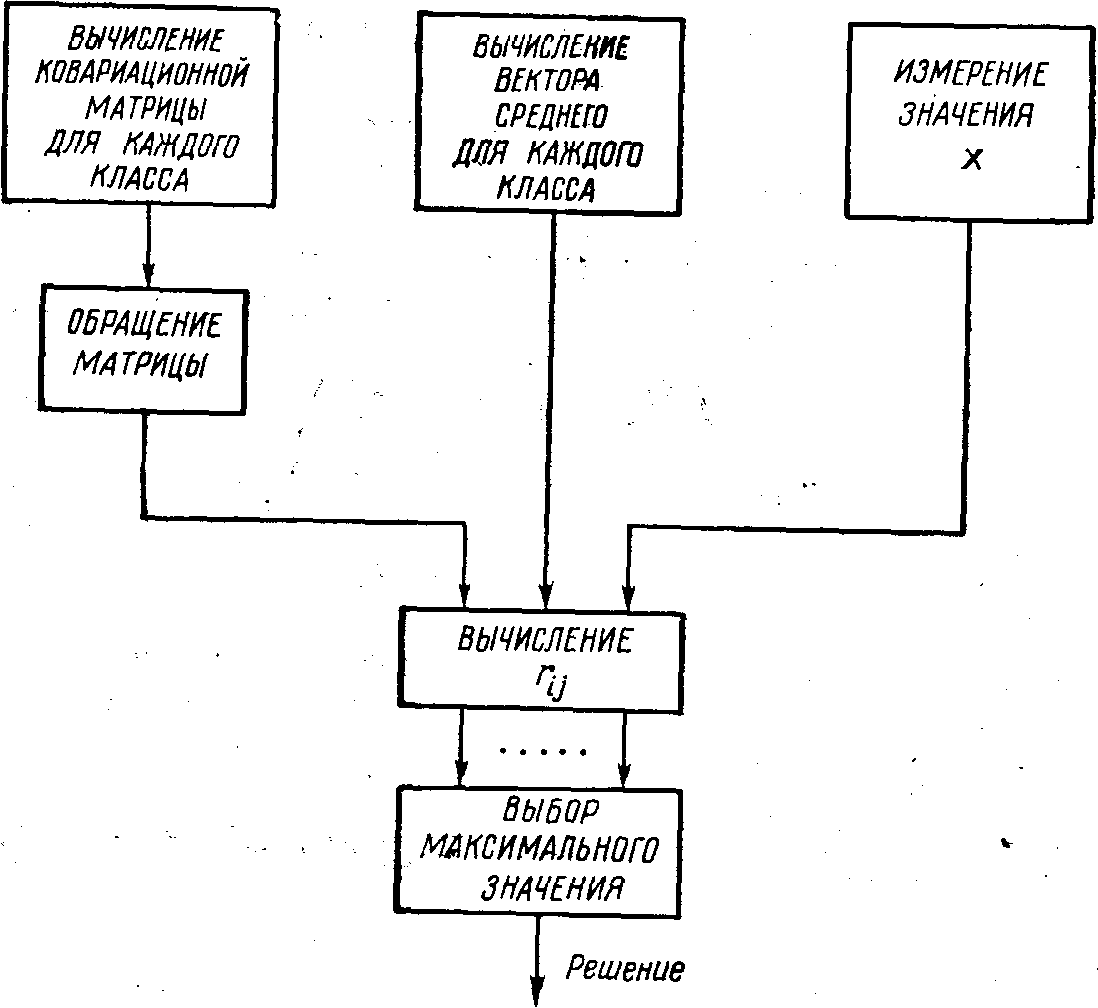

Для определения оптимальной разделяющей функции следует вычислить М(М–1) значений функцийrij(х)для всехi, j, ij и выбрать наибольшее из полученных значений. Если окажется что этот максимум равенrkj, то относимхк классуwk. Схема оптимального распознавания, воспроизводящая описанный метод, приведена на рис. 10.6.

Отметим, что

уравнение![]() описывает гиперплоскость, проведенную

вn-мерном пространстве

и разделяющую его в случае наличия двух

классов на две части:

описывает гиперплоскость, проведенную

вn-мерном пространстве

и разделяющую его в случае наличия двух

классов на две части:

![]()

Следовательно, уравнение rij=0определяет разделяющую поверхность дляi-го иj-го классов образов.

Рис. 10.6. Пример простой схемы распознавания образов.