8.Приклади використання економетричних моделей

Модель Клейна-Гольдбергера розроблена для вивчення економіки.

Модель Уартона є похідною моделі Клейна-Гольдбергера. Особливості моделі. Найчастіше розраховується на основі квартальних показників. Призначена для складання короткострокових прогнозів. Висока точність статистичного обліку.

Модель MPS -- спільна економетрична розробка Федерального резервного бюро, Міністерства зовнішньої торгівлі США та Пенсильванського університету. Призначена для щоквартальної оцінки економічного впливу альтернативних варіантів монетарної політики. Складається з більш ніж 100 рівнянь. Має шість блоків: кінцевого попиту, розподілу доходу, податків і трансфертних виплат, ринку праці, цін і фінансового сектора.

Модель DRI -- наймасштабніша американська економетрична модель. Розроблена на основі Брукінгської моделі та моделі Уартона. Останній варіант моделі розроблений під впливом кількох течій: кейнсіанської, неокласичної та монетарної. Модель структурована на кількох рівнях і має 10 секторів: внутрішні приватні витрати; виробництво і доходи; урядові надходження і витрати; міжнародні потоки; фінанси; ціна, заробітна плата, продуктивність праці; пропозиція; очікування; населення; інші агрегати та показники.

9. Ряди динаміки та їх характеристика

Ряд динаміки - це ряд розміщених у хронологічній послідовності статистичних показників.Ряд динаміки складається з двох елементів: рівнів ряду - статистичних показників; моментів (періодів) часу, до яких належать ці рівні. Показники завжди записуються під періодами часу.

Аналіз рядів динаміки -- найефективніший спосіб оцінки тенденцій і закономірностей розвитку явищ. Основними елементами динамічного ряду є рівень (окремий показник ряду) і час, до якого належить відповідний рівень. Рівнями можуть бути абсолютні, середні і відносні величини.

Розрахунок характеристик динаміки ґрунтується на порівнянні рівнів ряду. При порівнянні певної множини послідовних рядів база порівняння може бути постійною чи змінною. За постійну базу беруть або початковий рівень ряду, або рівень, який вважається вихідним для розвитку явища, що вивчається.

Характеристики динаміки, обчислені відносно постійної бази, називають базисними. Якщо кожний рівень ряду yt порівнюється з попереднім yі-і, характеристики динаміки називають ланцюговими.

Види рядів динаміки: абсолютних, відносних і середніх величин ряд динаміка коливання

Моментні та періодичні ряди динаміки. Розрізняють такі види рядів динаміки: * одновимірні -- характеризують зміну одного показника; * багатовимірні -- характеризують зміну двох і більше показників; * паралельні -- характеризують динаміку одного показника щодо різних об'єктів або різних показників щодо одного об'єкта; * взаємопов'язаних показників.

Зв'язок між показниками багатовимірного динамічного ряду може бути функціональний або кореляційний. Залежно від статистичної природи показника (рівня) розрізняють динамічні ряди первинні та похідні, ряди абсолютних, середніхі відносних величин.

За ознакою часу ряди динаміки поділяють на такі: * моментні -- рівень фіксує стан явища на певний момент часу (t); * інтервальні -- рівень є агрегованим результатом процесу і залежить від тривалості часового інтервалу.

14. Метод найменших квадратів — метод знаходження наближеного розв'язку надлишково-визначеної системи. Часто застосовується в регресійному аналізі. На практиці найчастіше використовується лінійний метод найменших квадратів, що використовується у випадку системи лінійних рівнянь. Зокрема важливим застосуванням у цьому випадку є оцінка параметрів у лінійній регресії, що широко застосовується у математичній статистиці і економетриці.

Одна незалежна змінна

Нехай маємо лінійну регресію зі скалярною змінною x:

![]()

а також вибірку

початкових даних

![]() розміру

M. Тоді

розміру

M. Тоді

![]()

Множинна регресія (випадок багатьох незалежних змінних)

Для надлишково-визначеної

системи m лінійних рівнянь з n невідомими

![]()

![]()

чи в матричній формі запису:

![]()

зазвичай не існує точного розв'язку, і потрібно знайти такі β, які мінімізують наступну норму:

![]()

Такий розв'язок завжди існує і він є єдиним:

![]()

хоч дана формула не є ефективною через необхідність знаходити обернену матрицю.

15. Метод найменших квадратів — метод знаходження наближеного розв'язку надлишково-визначеної системи. Часто застосовується в регресійному аналізі. На практиці найчастіше використовується лінійний метод найменших квадратів, що використовується у випадку системи лінійних рівнянь. Зокрема важливим застосуванням у цьому випадку є оцінка параметрів у лінійній регресії, що широко застосовується у математичній статистиці і економетриці в матричній формі:

![]()

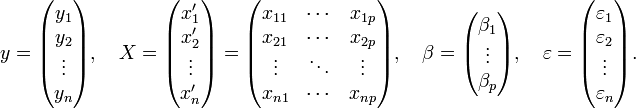

де:

В цих формулах

![]() —

вектор параметрів, які оцінюються,

наприклад, за допомогою методу найменших

квадратів, а

—

вектор параметрів, які оцінюються,

наприклад, за допомогою методу найменших

квадратів, а

![]() —

вектор випадкових змінних.

—

вектор випадкових змінних.

У класичній моделі множинної лінійної регресії приймаються такі умови:

![]()

![]()

![]()

тобто випадкові змінні є гомоскедастичними і між ними відсутня будь-яка залежність.

Ранг матриці X рівний p + 1, тобто між пояснюючими змінними відсутня лінійна залежність.

Для такої моделі

оцінка

![]() одержана

методом найменших квадратів володіє

властивостями:

одержана

методом найменших квадратів володіє

властивостями:

Незміщеність.

Оцінка

є

незміщеною, тобто

![]() Справді:

Справді:

![]()

Коваріаційна матриця оцінки рівна:

![]()

Це випливає з того,

що

![]() і

і

![]()

![]()

Ефективність. Згідно з теоремою Гауса — Маркова оцінка, що одержана МНК, є найкращою лінійною незміщеною оцінкою.

Змістовність. При

доволі слабких обмеженнях на матрицю

X метод найменших квадратів є змістовним,

тобто при збільшенні розміру вибірки,

оцінка за імовірністю прямує до точного

значення параметру. Однією з достатніх

умов є наприклад прямування найменшого

власного значення матриці

![]() до

безмежності при збільшенні розміру

вибірки.

до

безмежності при збільшенні розміру

вибірки.

Якщо додатково

припустити нормальність змінних

![]() то

оцінка МНК має розподіл:

то

оцінка МНК має розподіл:

![]()

10-11 Якщо дано сукупність показників y, що залежать від факторів х, то постає завдання знайти таку економетричну модель, яка б найкраще описувала існуючу залежність. Одним з методів є лінійна регресія. Лінійна регресія передбачає побудову такої прямої лінії, при якій значення показників, що лежать на ній будуть максимально наближені до фактичних, і продовжуючи цю пряму одержуємо значення прогнозу. Процес продовження прямої називається екстраполяцією. Відповідно до цього постає задача визначити цю пряму, тобто рівняння цієї прямої. В загальному вигляді рівняння прямої виглядає:

![]() =а+bх, (1.1)

=а+bх, (1.1)

де - вирівняне значення у для відповідного значення х.

Константи а і b - константи, які передбачають зменшення суми квадратів відхилень між фактичним значенням у і вирівняним значенням .

(у - )2 min (1.2)

Коефіцієнт а характеризує точку перетину прямої регресії з лінією координат.

Коефіцієнт b характеризує кут нахилу цієї прямої до осі абсцис, а також на яку величину зміниться при зміні х на одиницю.

Коефіцієнти а і b знаходять із системи рівнянь (1.3), що випливає з формули (1.2).

![]() (1.3)

(1.3)

Знайшовши значення параметрів розраховують ряд вирівняних значень для відповідних факторів і проводять дослідження знайденої економетричної моделі.

Щоб зробити висновок про доцільність використання знайденої моделі проводять аналіз за наступними напрямками:

1) Розраховують критерій Фішера та перевіряють знайдену модель на адекватність вихідним даним;

2) Розраховують і аналізують дисперсію показників;

3) Розраховують і аналізують коефіцієнт кореляції;

4) Розраховують та аналізують коефіцієнт еластичності;

5) Розраховують довірчий інтервал для прогнозованих показників.

16.

У статистиці різницю

![]() прийнято

називати загальним відхиленням. Різницю

прийнято

називати загальним відхиленням. Різницю

![]() називають

відхиленням, яке можна пояснити, виходячи

з регресійної прямої. Різницю

називають

відхиленням, яке можна пояснити, виходячи

з регресійної прямої. Різницю

![]() називають

відхиленням, яке не можна пояснити,

виходячи з регресійної прямої, або не

пояснюваним відхиленням. Загальне

відхилення розкладається на дві складові:

називають

відхиленням, яке не можна пояснити,

виходячи з регресійної прямої, або не

пояснюваним відхиленням. Загальне

відхилення розкладається на дві складові:

= +

Піднесемо ці різниці до квадрату і просумуємо для всіх одиниць спостереження. Одержимо:

![]() -

загальна сума квадратів

-

загальна сума квадратів

![]() -

сума квадратів, що пояснює регресію;

-

сума квадратів, що пояснює регресію;

![]() -

сума квадратів помилок.

-

сума квадратів помилок.

Справедливий такий вираз:

= + .

Поділивши цей вираз на п, отримаємо вираз для дисперсій:

![]()

![]() +

+![]() ,

,

де

![]() -

загальна дисперсія ознаки у;

-

загальна дисперсія ознаки у;

![]() -

дисперсія, що пояснює регресію;

-

дисперсія, що пояснює регресію;

![]() -

дисперсія помилок.

-

дисперсія помилок.

Таким чином ми здійснили декомпозицію дисперсії, тобто розклали загальну дисперсію на дві частини: дисперсію, що пояснює регресію, та дисперсію помилок (або дисперсію випадкової величини). Запишемо це у такому вигляді:

![]() .

.

Поділимо обидві частини на загальну дисперсію і отримаємо:

![]()

У цьому виразі перша частина – це частка дисперсії, що пояснюється регресією, а друга – частка помилок в загальній дисперсії.