- •Федеральное агентство по образованию

- •1.2. Измерение информации

- •1.2.1. Структурные меры информации

- •1.2.2. Статистическая мера информации.

- •2. Кодирование информации

- •2.1. Контрольная работа – часть 1

- •2.1.1. Позиционные системы счисления

- •2.1.2. Смешанные системы счисления

- •2.1.3. Перевод числа из одной системы счисления в другую

- •2.1.4. Код Грея

- •2.1.5. Форма постановки задания

- •2.1.6. Рекомендации по решению задач

- •2.1.7. Примеры решения задач

- •2.1.8. Пример задания по контрольной работе – часть 1

- •2.2. Контрольная работа – часть 2

- •2.2.1. Избыточность сообщений

- •2.2.2. Теоретические основы эффективного кодирования

- •2.2.3. Построение эффективного кода по методам Шеннона-Фано и Хаффмена

- •2.2.4. Теоретические основы помехоустойчивого кодирования

- •2.2.5. Классификация помехоустойчивых кодов

- •2.2.6. Общие принципы использования избыточности при построении корректирующих кодов

- •2.2.7. Коды, обнаруживающие ошибки

- •2.2.8. Примеры решения задач

- •2.2.9. Пример задания по контрольной работе – часть 2

- •2.3. Контрольная работа – часть 3

- •Краткие теоретические сведения

- •2.3.1. Линейные коды, обнаруживающие и исправляющие ошибки

- •2.3.2. Построение двоичного линейного кода

- •2.3.3. Кодирование

- •2.3.4. Синдромный метод декодирования

- •2.3.5. Кодирующее и декодирующее устройства

- •2.3.6. Матричное представление линейных кодов

- •2.3.7. Циклические коды

- •2.3.8. Выбор образующего многочлена

- •2.3.9. Формирование разрешенных кодовых комбинаций

- •2.3.10. Декодирование циклических кодов

- •2.3.11. Схемы деления на образующий многочлен

- •2.3.12. Примеры решения задач

- •2.3.13. Пример задания по контрольной работе – часть 3

- •3. Оформление контрольной работы

- •3.1. Пример оформления отчета по контрольной работе

- •4. Варианты заданий

2.1.7. Примеры решения задач

=

=

10 8

Задача поставлена некорректно, так как

в десятичной системе коэффициент

![]() быть не может

быть не может![]() .

.

![]()

5 6 68

|

|

1 |

|

2 |

|

3 |

|

|

|

– |

|

– |

|

– |

|

|

|

59 |

2 |

|

|

|

|

|

|

-58 |

29 |

2 |

|

|

|

|

|

1 |

-28 |

14 |

2 |

|

|

|

|

|

1 |

-14 |

7 |

2 |

|

|

|

|

|

0 |

-6 |

3 |

2 |

|

|

|

|

|

1 |

-2 |

1 |

|

|

|

|

|

|

1 |

|

![]()

3).

А=10,

В=11.

А=10,

В=11.

![]()

|

|

1 |

|

2 |

|

|

|

– |

|

– |

|

![]()

Задача

поставлена некорректно, так как в

троичной системе коэффициента

Задача

поставлена некорректно, так как в

троичной системе коэффициента быть не может

быть не может .

.

|

|

1 |

|

2 |

|

|

|

– |

|

– |

|

1). По схеме Горнера:

![]()

2). ![]()

![]()

1

2

3

–

–

–

Схема:

Схема:

1). ![]()

2 ).

). – по схеме Горнера

– по схеме Горнера

3). ![]()

![]()

2.1.8. Пример задания по контрольной работе – часть 1

2.2. Контрольная работа – часть 2

В контрольную работу включены задачи из следующих разделов теории информации и кодирования:

измерение информации (аддитивная мера Хартли);

избыточность сообщений (абсолютная и информационная);

эффективное кодирование по методам Шеннона-Фано и Хаффмена;

кодирование и декодирование кодов, обнаруживающих ошибки (коды: с проверкой на четность; с числом единиц, кратным 3; корреляционный; комбинированный инверсный).

Краткие теоретические сведения

Информация по мере Хартли приведена в разделе 1.2 настоящих методических указаний (1.4).

2.2.1. Избыточность сообщений

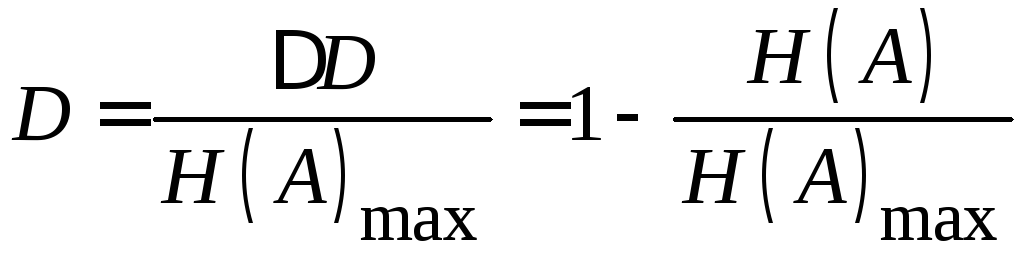

Величина, показывающая, какая часть сообщения при данных условиях может быть устранена без потери информации, называется избыточностью.

Абсолютная величина избыточности определяется выражением:

![]() ,

(2.1)

,

(2.1)

где

![]() – максимальная энтропия сообщения,

определяемая при равновероятных и

статистически независимых знаках в

сообщении;

– максимальная энтропия сообщения,

определяемая при равновероятных и

статистически независимых знаках в

сообщении;![]() – реальная энтропия сообщения.

– реальная энтропия сообщения.

Относительная избыточность, называемая информационной, определяется выражением:

(2.2)

(2.2)

Информационная избыточность показывает

относительную недогруженность одного

знака алфавита и является безразмерной

величиной, изменяющейся в пределах:

![]() .

.

В соответствии с (2.2), избыточность, обусловленная неравновероятным появлением знаков в сообщении, будет равна:

(2.3)

(2.3)

где

![]() – объем используемого алфавита;

– объем используемого алфавита;![]() .

.

2.2.2. Теоретические основы эффективного кодирования

Пусть требуется передать достаточно

длинное сообщение, составленное из

ансамбля знаков

![]() ,

,![]() ,

где

,

где![]() – объем первичного алфавита:

– объем первичного алфавита: .

.

При кодировании каждому знаку первичного

алфавита ставится в соответствие своя

кодовая комбинация во вторичном алфавите,

содержащем

![]() символов. Обозначим через

символов. Обозначим через![]() длину кодовой комбинации, соответствующей

знаку

длину кодовой комбинации, соответствующей

знаку![]() ,

а через

,

а через![]() – среднюю длину кодовой комбинации при

выбранном способе кодирования. Тогда:

– среднюю длину кодовой комбинации при

выбранном способе кодирования. Тогда:

(2.4)

(2.4)

При эффективном кодировании стремятся

к тому, чтобы

![]() .

Это значит, что при определенном объеме

передаваемой информации необходимо

увеличивать ее количество на каждый

символ сигнала, т.е. повышать, как обычно

говорят, «плотность» упаковки информации.

.

Это значит, что при определенном объеме

передаваемой информации необходимо

увеличивать ее количество на каждый

символ сигнала, т.е. повышать, как обычно

говорят, «плотность» упаковки информации.

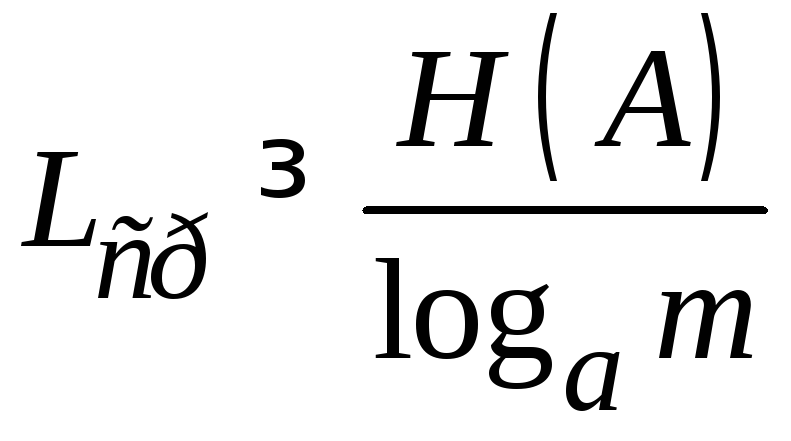

Теоретической основой для определения

минимально возможной средней длины

кодовых комбинаций служит теорема

Шеннона о кодировании при отсутствии

помех. Теорема читается так: при

кодировании множества сигналов с

энтропией

![]() в алфавите, насчитывающем

в алфавите, насчитывающем![]() символов, при условии отсутствия помех,

средняя длина кодовых комбинаций не

может быть меньше частного от деления

указанной энтропии на количество

информации в одном символе, т.е.

символов, при условии отсутствия помех,

средняя длина кодовых комбинаций не

может быть меньше частного от деления

указанной энтропии на количество

информации в одном символе, т.е.

(2.5)

(2.5)

Справедливость теоремы Шеннона можно видеть из следующих рассуждений.

Очевидно, что кодирование будет тем

эффективнее, чем большее количество

информации будет приходиться на каждый

символ кодовой комбинации. Так как во

вторичном алфавите

![]() символов, а максимальное количество

информации в символе будет в случае,

когда вероятности появления символов

одинаковы, то максимально возможное

количество информации, приходящееся

на

символов, а максимальное количество

информации в символе будет в случае,

когда вероятности появления символов

одинаковы, то максимально возможное

количество информации, приходящееся

на

![]() символ кодовой комбинации, будет равно

символ кодовой комбинации, будет равно

![]() .

.

Дополнительное сокращение времени, затрачиваемого на передачу сообщения, можно достигнуть с помощью специального кода, позволяющего вести передачу без промежутков между кодовыми комбинациями. Чтобы на приемной стороне можно было отличить одну комбинацию от другой, т.е. чтобы код был разделимым (однозначно декодируемым), он должен строиться так, чтобы ни одна более длинная кодовая комбинация не являлась продолжением более короткой. Например, при указанном кодировании нельзя применять комбинации 110 и 11010, так как вторая комбинация получена из первой путем добавления 10.