- •МИНИСТЕРСТВО ОБРАЗОВАНИЯ И НАУКИ РЕСПУБЛИКИ КАЗАХСТАН

- •Е.Ж. Айтхожаева

- •Учебно-методический комплекс дисциплины

- •Алматы 2010

- •Таблица 1

- •Выписка из учебного плана

- •Академических часов в неделю

- •Наименование темы

- •Дополнительная литература: 5[8:11], 6[18:60],7[17:36].

- •Тема 7.

- •Логические основы ЦУ.

- •где Аi - число ФАЛ , существенно зависящих от i – аргументов, Сin – число сочетаний из n – элементов по i.

- •Например, необходимо определить А3 для трех аргументов:

- •Предварительно необходимо определить А0, А1, А2. А0=2 и А1=2. Зная А0 и А1 можно вычислить А2:

- •Отсюда:

- •Таким образом из 256 ФАЛ, которые можно определить на наборах из трех переменных х1 , х2 , х3 только 218 ФАЛ существенно зависят от всех трех аргументов.

- •Дополнительная литература: 4[67:70, 87:89], 7[278:306].

- •Контрольные вопросы:

- •Рекомендуемая литература

- •2.7 Тестовые задания для самоконтроля с указанием ключей правильных ответов

- •2.8 Перечень экзаменационных вопросов по пройденному курсу

- •Евгения Жамалхановна Айтхожаева

нарушающий порядок проведения контрольной работы, удаляется из учебной аудитории без права пересдачи.

Повторное проведение контрольной работы исключается. В случае отсутствия студента на занятии по уважительной причине (подтвержденной документально) возможна сдача пропущенного вида контроля в более поздние сроки. При несдаче очередного контроля по неуважительной причине, сдача контроля в более поздние сроки запрещается.

2 Содержание активного раздаточного материала

2.1 Тематический план курса составляется в виде таблицы, где указываются наименование темы и количество академических часов, предусмотренных для каждой темы.

Тематический план курса

|

|

|

|

Количество |

|

||

|

|

Наименование темы |

академических часов |

|

|||

|

|

Лекция |

Лаборат |

|

|

|

|

|

|

|

|

орные |

СРСП |

СРС |

|

|

|

|

|

|

|

||

Введение. |

|

|

|

|

|

||

1. |

|

Информационные основы цифровых устройств. |

2 |

1 |

3 |

|

3 |

2. |

Представление числовой информации в ЦУ. |

2 |

1 |

3 |

|

3 |

|

3. |

|

Алгебраическое сложение в двоичной системе |

2 |

1 |

3 |

|

3 |

счисления. |

|

|

|

|

|

||

4. |

Двоично – кодированные десятичные числа. |

2 |

1 |

3 |

|

3 |

|

5. |

Умножение чисел в двоичной системе счисления |

2 |

1 |

3 |

|

3 |

|

6. |

|

Деление чисел в двоичной системе счисления. |

2 |

1 |

3 |

|

3 |

7. |

Логические основы ЦУ. |

2 |

1 |

3 |

|

3 |

|

8. |

Минимизация ФАЛ. |

2 |

1 |

3 |

|

3 |

|

9. |

|

Анализ и синтез комбинационных логических |

2 |

1 |

3 |

|

3 |

схем. |

|

|

|

|

|

||

10. |

Математические модели цифровых устройств с |

2 |

1 |

3 |

|

3 |

|

памятью. Абстрактный автомат. |

|

|

|

|

|

||

11. |

Структурный автомат. |

2 |

1 |

3 |

|

3 |

|

12. |

Элементарные цифровые автоматы с памятью. |

2 |

1 |

3 |

|

3 |

|

13. |

Цифровые операционные устройства. |

2 |

1 |

3 |

|

3 |

|

14. |

Контроль и диагностика ЦУ. |

2 |

1 |

3 |

|

3 |

|

15. |

Управляющие устройства с программируемой |

2 |

1 |

3 |

|

3 |

|

логикой. |

|

|

|

|

|

||

Заключение. |

|

|

|

|

|

||

Всего (часов) |

30 |

15 |

45 |

|

45 |

||

10

2.2 Конспект лекционных занятий

Тема 1.

Информационные основы цифровых устройств

Имеется множество определений понятия информации. Применительно к ЦУ можно использовать следующее определение информации: информация есть все сведения, являющиеся объектом хранения, передачи и преобразования.

Информация может быть непрерывная или дискретная. Непрерывная информация создается непрерывным источником информации, дискретная – дискретным источником информации. Информация, воплощенная и зафиксированная в материальной форме называется сообщением.

Непрерывное сообщение создается непрерывным источником информации и представляется какой-либо физической величиной (электрическим напряжением, током и т.п.), изменения которой отображают протекание рассматриваемого процесса. Физическая величина, передающее непрерывное сообщение, может в определенном интервале принимать любые значения и изменяться в произвольные моменты времени. Поэтому непрерывное сообщение конечной длины, созданное непрерывным источником в конечное время, содержит бесконечное количество информации.

Математической моделью непрерывного сообщения является непрерывная математическая функция F=F(t), в то время как для описания дискретного сообщения можно использовать дискретную функцию f=f(t) , где t - время.

Дискретный источник информации создает дискретные сообщения, которые слагаются из фиксированного набора отдельных элементов (знаков). Набор элементов конечен и называется "алфавитом" источника информации. Совокупность знаков, имеющая смысловое значение, называется словом. Типичными дискретными сообщениями являются текст, записанный с помощью какого-либо алфавита, или последовательность чисел, представленных знаками.

Непрерывность и дискретность информации может иметь место либо по времени, либо по состоянию (величине), либо и по времени и по состоянию. Непрерывную информацию можно преобразовать в дискретную путем дискретизации (квантования) по времени и по состоянию.

Вид информации, являющейся объектом преобразования, определяет одну из классификаций ЭВМ: аналоговые вычислительные машины работают с непрерывными сообщениями, цифровые вычислительные машины (ЦВМ) - с дискретными сообщениями.

Дискретные сообщения находят наиболее широкое применение, чем непрерывные, так как их проще хранить и обрабатывать, они в меньшей степени подвержены искажениям под влиянием помех, эти искажения легче обнаруживаются.

Алфавитное представление информации является универсальным. Универсальность алфавитного задания информации основывается на том, что любая непрерывная информация воспринимается устройством, как дискретная.

11

Преобразование информации - это есть отображение одного класса явлений в другой класс явлений.

Если подобное отображение осуществляется объектом, то этот объект называется преобразователем информации. В общем виде преобразование алфавитной информации может быть задано следующим образом. Пусть даны два конечных алфавита Х=(х1, х2, ... , хm ) и У=(у1, у2, ... , уn ). И тогда количество различных слов конечной длины в алфавитах Х и У конечно. Можно через F и G обозначить их совокупность(соответственно для алфавитов Х и У). Если исходная информация записана в алфавите Х, а конечная - в алфавите У, то произвольное преобразование информации ϕ - это отображение множества F в множество G.

Существует детерминированное преобразование - входное слово полностью определяет слово на выходе ( выполняет требование однозначности отображения ϕ ). Если отображение ϕ задано лишь на части множества F , то оно называется частичным преобразованием. При частичном отображении можно рассматривать отображение части {F} в себя.

Преобразование (отображение) {F} в {G} или части {F} в себя называют алфавитным оператором. Алфавитные операторы, задаваемые с помощью конечных систем правил называются алгоритмами. Выделяют следующие свойства алгоритмов: массовость, детерминированность, результативность, дискретность. Но свойство детерминированности присуще только детерминированным алгоритмам. Кроме них существуют вероятностные алгоритмы.

Известен большой класс алгоритмов, получивших название нормальных алгоритмов Маркова (А.А.Марков - известный советский ученый - алгоритмист). Они преобразуют слова заданные в любом конечном алфавите А=(а1, а2, ... , аm) в слова в этом же самом алфавите (частичное отображение).

Нормальный алгоритм задается конечной таблицей подстановок слов в данном алфавите. Например, заданы алфавит А= ( x, y, z ) и нормальный алгоритм таблицей подстановок:

1)xy = yx

2)zxz = x

3)zz = zx

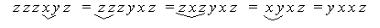

Необходимо применить этот нормальный алгоритм к слову zzzxyz. Слово zzzxyz просматривается на применение правил подстановок, начиная каждый раз с первого:

- процесс окончен.

При применении правил подстановок возможны варианты : а) процесс бесконечен (алгоритм к данному слову неприменим) ; б) процесс оканчивается за конечное число шагов.

12

Любой алгоритм эквивалентен некоторому нормальному алгоритму. Поэтому, говоря о произвольном алгоритме, можно иметь ввиду только алгоритмы Маркова (нормальные).

Алфавитное представление информации является универсальным. Универсальность алфавитного задания информации основывается на том, что любая непрерывная информация воспринимается устройством, как дискретная.

Дискретные сообщения находят наиболее широкое применение, чем непрерывные, так как их проще хранить и обрабатывать, они в меньшей степени подвержены искажениям под влиянием помех, эти искажения легче обнаруживаются.

Устройство, служащее для преобразования дискретной информации, является дискретным автоматом. Буквами при представлении дискретной информации в дискретном автомате служат цифры, поэтому автомат называют цифровым (ЦА) или цифровым устройством (ЦУ). Чаще всего в цифровых автоматах используется стандартный двоичный алфавит (0 или 1).

Цифровые автоматы преобразовывают дискретную информацию, представленную в виде слов. При этом в ЦА используются сигналы – материально − энергетическая форма представления информации.

Двоичная цифра в ЦА отображается состоянием составляющих его элементов, а при передаче информации от элемента к элементу - электрическими сигналами в линиях связи. Состояние элементов определяется уровнем напряжения или тока на выходе элемента, либо наличием или отсутствием электрического импульса, либо фазой или частотой электрических колебаний. При этом одно из состояний элемента принимается за единицу, другое за нуль.

Среди ЦУ можно выделить несколько классов, причем классификация ЦУ может быть проведена по нескольким признакам:

1)по наличию памяти (ЦУ с памятью, ЦУ без памяти);

2)по степени абстракции (абстрактные ЦА, в которых не рассматривается структура автомата, а входные и выходные сигналы трактуются как буквы некоторого абстрактного алфавита, и структурные ЦА);

3)по функциональному назначению (операционные автоматы - ОА, управляющие автоматы - УА);

4)по аппаратурной реализации (реализованные на интегральных схемах различной степени интеграции и реализованные на однородных и регулярных структурах).

ЦУ без памяти являются более простыми устройствами, называемыми комбинационными схемами. Комбинационные схемы представляются в виде совокупности связанных между собой определенных элементов схем, все сигналы имеют конкретное значение (0 или 1). Поэтому комбинационные схемы можно отнести к структурным автоматам без памяти. Классификация по аппаратурной реализации применима как к комбинационным схемам, так и к структурным автоматам с памятью.

Ввиде ЦА (с памятью или без памяти) можно представить любое цифровое устройство.

13

Дискретные сообщения содержат всегда конечное количество информации, поэтому ее можно измерить. Существуют структурные, статистические и семантические меры информации.

Статистические меры учитывают конкретные условия применения информационных систем, вероятность появления и информативность сообщения.

Структурные меры учитывают строение, структуру информационного массива, применяются для оценки возможности информационных систем вне зависимости их применения.

Семантические меры позволяют определить полезность и ценность информационного сообщения.

В качестве статистической меры информации используется мера, предложенная К. Шенноном в 1948г. (мера по Шеннону), в основе которой лежит вероятный подход.

Вероятность − величина, которая может принимать значения в диапазоне от 0 до 1. Она может рассматриваться как мера возможности наступления какого-то события. Если событие всегда происходит, то его вероятность равна 1. Если событие никогда не может произойти, то его вероятность равна 0. Информативность сообщения о том, что событие не произошло (во втором случае) равна 0. Чем больше вероятность того, что событие произойдет, тем меньше информации несет сообщение о нем и наоборот.

Следовательно, количество информации зависит от степени неопределенности событий (энтропии), которая характеризуется их вероятностями. К. Шеннон предложил использовать для выражения этой зависимости двоичный логарифм (log2). Если объект может находится в одном из n − допустимых состояний с вероятностью pi, то количество информации I, характеризующей состояние, в котором пребывает объект

I = ∑n |

pi log 2 |

1 |

= −∑ pi log 2 pi , |

|

|||

i =1 |

|

pi |

|

т.к. 0 ≤ pi ≤ 1, то -1 ≤ log2 pi ≤0 (pi log2 pi=0, если pi=0).

Формула Шеннона универсальна, из нее может быть выведена структурная аддитивная логарифмическая мера, полученная Хартли еще в 1928г. При условии p1=p2=…pn = 1/n мера по Шеннону превращается в меру Хартли I=log2n, где n – количество возможных равновероятных состояний, в которых может находится объект.

Если n=2, то I=log22=1. Эта единица информации получила название “бит” и соответствует одному элементарному событию, которое может произойти, а может и не произойти (pi =0,5). При этом количество информации эквивалентно количеству информации, содержащемуся в двоичном символе.

Мера Хартли удобна тем, что она обеспечивает возможность оперировать мерой как числом. Мера является аддитивной, т.е. при наличии нескольких

источников информации (1,2,…k) общее количество информации I = ∑k |

I i , |

i = 1 |

|

где Ii – количество информации от i-го источника. |

|

14