- •Основи системотехніки

- •Еволюція розвитку системних уявлень Системність та «фізикалізм»

- •Основні етапи становлення системного підходу

- •Прикладні дисципліни системних наук

- •Поняття системотехніки

- •Визначення системи

- •Поняття, що характеризують системи

- •Елементи загальної теорії систем

- •Класифікація систем

- •Основні види відомих систем

- •Приклади систем

- •Інформаційна система

- •Загальні властивості систем

- •Основні закономірності систем

- •Поняття ентропії

- •Соотношение открытых и закрытых систем

- •Закономерность самоорганизации

- •Закон необхідності різноманіття

- •Закономерность историчности

- •Системний підхід та системний аналіз

- •Основні принципи системного аналізу

- •Методи системного аналізу

- •Експертні методи

- •Индивидуальные экспертные методы

- •Колективні експертні методи

- •Метод комісій

- •Метод мозкової атаки

- •Метод Дельфі

- •Метод дерева цілей

- •Морфологічний метод

- •Відображення морфології у вигляді дерев, графів, таблиць

- •Метод морфологічного ящика

- •Метод заперечення та конструювання

- •Метод систематичного покриття поля

- •Моделювання та аналіз систем

- •Модель чорного ящика

- •Регресійний аналіз

- •Кореляційний аналіз

- •Методи прогнозування

- •Стандарти системотехніки

- •Література

Основні закономірності систем

Надамо спочатку деякі закономірності систем у викладі Б.Флейшмана [3].

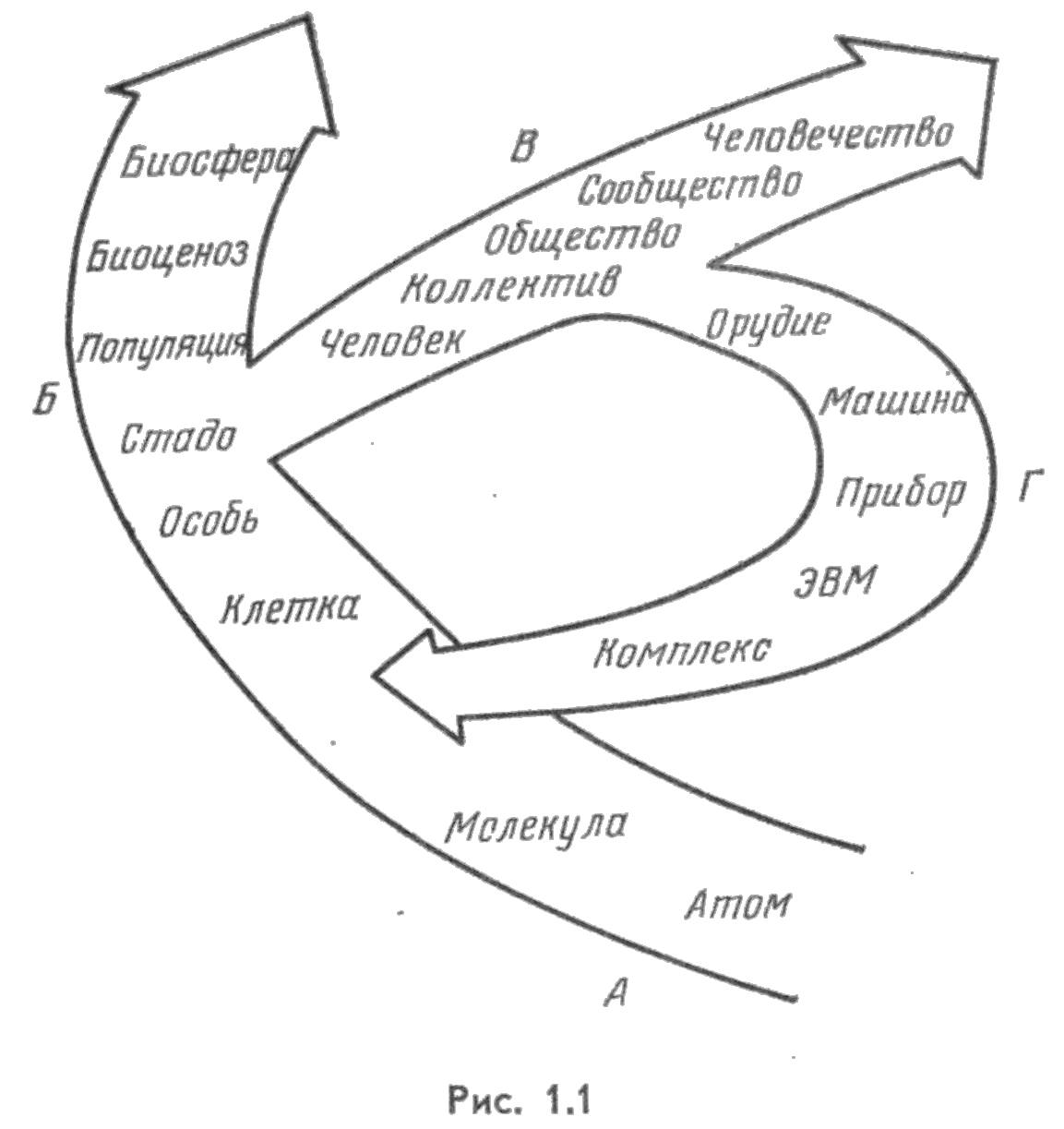

«Лишь иерархическая упорядоченность мира позволяет обозреть его многообразие. В его части, известной нам, сосуществуют, взаимодействуя, три последовательно возникшие иерархии (рис. 1.1). Это естественно возникшие иерархии: физико-биологическая (А, Б) и социальная (В) – и искусственно возникшая техническая иерархия (Г). На рис.1.1 приведены лишь бесспорно выделяемые классы систем, составляющие иерархии, а промежуточные классы опущены».

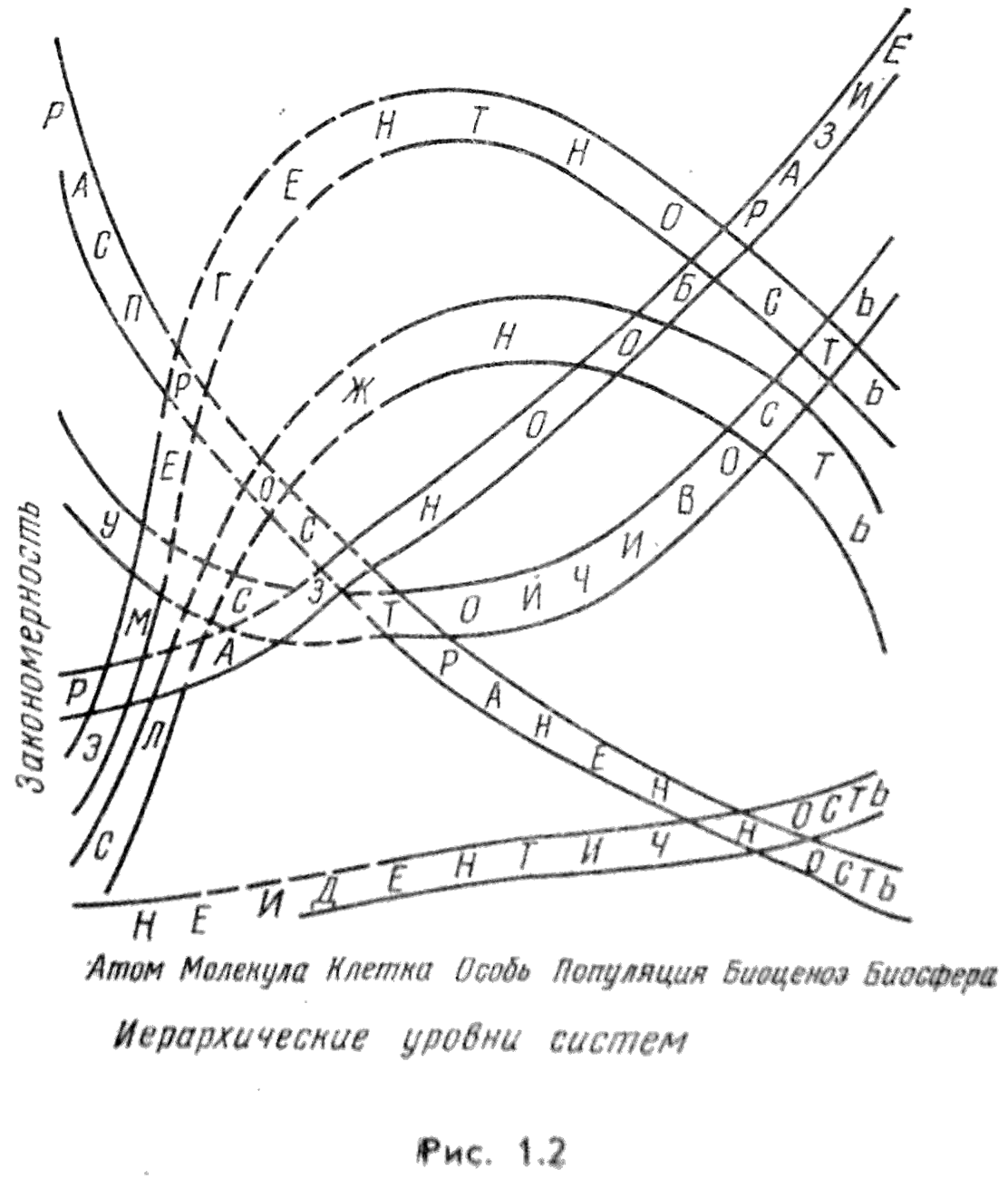

Эмпирические закономерности классов систем данных иерархий.

С повышением уровня системы:

-

Разнообразие (число различных типов систем данного класса) возрастает.

-

Обилие или распространенность (число N однотипных систем данного типа (вида) в заданном пространстве (например, на Земле или в известной нам части Вселенной) убывает, что связано с возрастанием их размеров.

-

Сложность (для структуры системы определяется числом ее элементов и числом связей между ними, для поведения системы определяется характером и разнообразием реакций на внешние воздействия) возрастает до уровня особи.

-

Устойчивость (способность системы противостоять возмущающим воздействиям для самосохранения). От нее зависит продолжительность жизни системы, а от последней и их распространенность. Возрастает начиная с некоторого уровня

-

Эмергентность (степень несводимости свойств системы к свойствам отдельных элементов, из которых она состоит) возрастает в физико-биологической иерархии по крайней мере до уровня особи. Богданов А.А. отметил, что организация системы тем выше, чем сильнее свойства целого отличаются от простой суммы его частей.

-

Неидентичность (степень отличия систем одного и того же типа (вида) друг от друга возрастает. Так, однотипные атомы или молекулы более идентичны, чем одновидовые клетки.

Поняття ентропії

Ентропія – це ступінь невпорядковоності (невизначеності). Це поняття запозичене з термодинаміки, де ентропія пов’язана із вірогідністю певного розташування молекул. У кібернетиці та загальній теорії систем ентропія означає величину невизначеності, яка виникає при виборі з великої кількості можливих варіантів. Для зменшення ентропії необхідно зменшувати існуючу невизначеність, що досягається шляхом отримання інформації. Інформація, згідно теорії інформації, характеризується величиною, яка пов’язана із кількістю можливих варіантів вибору у системі.

Наприклад, якщо можливі 8 варіантів, то ентропія становить 3 біти. Після чотирьох виборів варіантів невизначеність залишається як решта 4 варіанти – ентропія 2 біти. Дві наступні виборки залишають два варіанти – ентропія 1 біт. Якщо зробити ще один вибір з двох варіантів, то залишається тільки один можливий варіант – невизначеність зникає, ентропія дорівнюватиме нулю.

Поняття ентропії та кількості інформації можна використовувати для характеристики живих та неживих систем. Неживі системи (які зазвичай розглядаються як закриті) мають тенденцію розвитку у напрямку до стану максимальної невпорядкованості, тобто до максимальної ентропії. Відмінністю живих (а значить, відкритих) систем є протидія процесу невпорядкованості та розвиток у напрямку більш високої організованості. Загальна теорія систем пояснює ці тенденції у такий спосіб:

а) обробка інформації призводить до зменшення позитивної ентропії

б) отримання енергії з навколишнього середовища (збільшення від’ємної ентропії, яке зветься негентропійним процесом) протидіє тенденції невідворотного природного процесу збільшення позитивної ентропії.