УМК по ТВ и МС

.pdf

Таблица 11.5

yi |

74 |

47 |

92 |

48 |

93 |

72 |

42 |

50 |

64 |

78 |

39 |

96 |

74 |

88 |

55 |

80 |

99 |

85 |

zi |

44 |

69 |

27 |

78 |

30 |

48 |

79 |

65 |

56 |

43 |

80 |

30 |

43 |

29 |

64 |

43 |

19 |

37 |

ri |

9,5 |

3 |

15 |

4 |

16 |

8 |

2 |

5 |

7 |

11 |

1 |

17 |

9,5 |

14 |

6 |

12 |

18 |

13 |

si |

10 |

15 |

2 |

16 |

4,5 |

11 |

17 |

14 |

12 |

8 |

18 |

4,5 |

8 |

3 |

13 |

8 |

1 |

6 |

ri−si |

-0,5 |

-12 |

13 |

-12 |

11,5 |

-3 |

-15 |

-9 |

-5 |

3 |

-17 |

12,5 |

1,5 |

11 |

-7 |

4 |

17 |

7 |

(ri−si)2 |

0,25 |

144 |

169 |

144 |

132,3 |

9 |

225 |

81 |

25 |

9 |

289 |

156,3 |

2,25 |

121 |

49 |

16 |

289 |

49 |

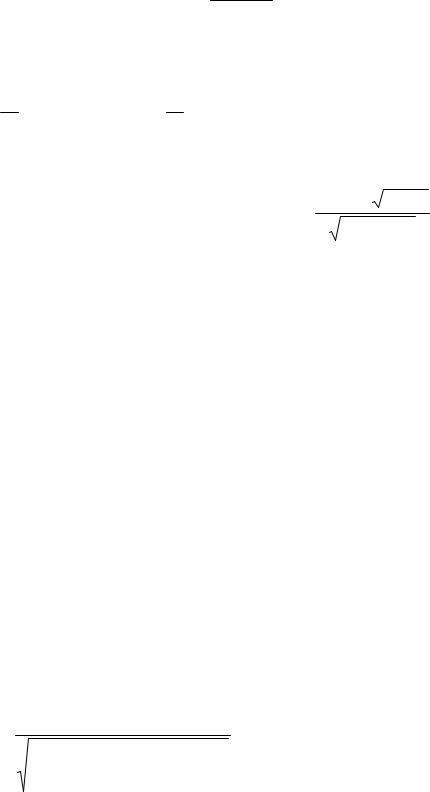

По формуле (11.15) ρy / z =1 − 183 6−18 1910 = −0,971. Однако при этом не

учтены связные ранги. По переменной Y имеем mr = 1 – одну группу неразличимых рангов с tr1 = 2 рангами. По переменной Z имеем ms = 2 – две группы неразличимых рангов с ts1 = 2 ранга и ts2 = 3 ранга. Поэтому по формуле (11.17):

Tr =121 (23 − 2) = 0,5, Ts = 121 [(23 −2) +(33 −3)] = 2,5 .

Отсюда находим по формуле (11.16) ρy / z =1 − |

1910 |

|

= −0,977 . |

|||

|

|

|

||||

|

|

|

|

(183 −18) / 6 − (0,5 + 2,5) |

||

Для проверки значимости ρy/z вычислим tcalc = − 0,977 18 − 2 |

= −18,327 . Далее |

|||||

|

|

|

|

1 − 0,9772 |

|

|

найдем tcr.u = t0,025 (16) = 2,473. Поскольку |

|

tcalc |

|

> t2,5% (16) , то коэффициент ρy/z |

||

|

|

|||||

для данных переменных значим на 5%-ном уровне. |

|

|

||||

11.5.2. Коэффициент ранговой корреляции Кендалла

Коэффициент ранговой корреляции Кендалла между переменными X и Y

находится по формуле:

τx / y =1 − |

4K |

, |

(11.19) |

|

n(n −1) |

||||

|

|

|

где K – статистика Кендалла, представляющая собой минимальное число обменов между элементами последовательности s, необходимое для приведения ее к упорядочиванию, аналогичному последовательности r.

Для определения статистики K необходимо ранжировать объекты по одной переменной (пусть, для определенности по X) в порядке возрастания (при этом ее ранги будут упорядочены ( r1 ≤ r2 ≤K≤ rn ) и определить соответствующие

им ранги si, (i = 1, … , n), переменной Y. Статистика K равна общему числу инверсий (нарушений порядка, когда большее число стоит слева от меньшего), в ранговой последовательности s1, … , sn.

Формула (11.19) справедлива при отсутствии в ранжировках связных рангов. Если они имеются, то коэффициент Кендалла определяют в виде:

|

|

τx / y − |

|

2(Vr |

+Vs ) |

|

|

|

|

||||

τx / y = |

|

|

|

n(n −1) |

|

, |

(11.20) |

||||||

|

|

|

2V |

r |

|

|

|

|

2V |

s |

|

|

|

1 |

− |

|

|

|

|

1 |

− |

|

|

|

|

||

|

n(n − |

1) |

n(n −1) |

|

|||||||||

|

|

|

|

|

|

|

|||||||

151

|

1 |

m |

|

1 |

m |

|

где Vr = |

∑r (tri2 |

−tri ) , Vs = |

∑s (tsi2 −tsi ) , |

(11.21) |

||

|

2 i=1 |

|

2 i=1 |

|

||

my, ms, tri, tsi − те же, что и при расчете коэффициента Спирмена.

Отметим, что в данном случае группы связных рангов не требуется приравнивать их средней арифметической по всей данной группе.

Свойства коэффициента Кендалла аналогичны свойствам коэффициента Спирмена. При проверке значимости τx/y исходят из того, что в случае справедливости гипотезы H0 об отсутствии корреляционной связи между переменными (при n > 10) критическая статистика

ucr = τ |

9n(n −1) |

|

2(2n + 5) |

имеет стандартное нормальное распределение N(0, 1). Поэтому τx/y доверительном уровне α, если расчетное значение ucalc > u1−α/ 2 .

(11.22)

значим на

Пример 11.11. Для данных примера 11.2 определить с помощью коэффициента Кендалла зависимость между стоимостью квартиры и ее удаленностью от областного центра. Проверить значимость коэффициента с α = 0,05.

Решение. Составим таблицу, предварительно выполнив упорядочение всех пар (yi, zi) по возрастанию значений yi:

Таблица 11.6

yi |

|

39 |

42 |

47 |

48 |

50 |

55 |

64 |

72 |

74 |

74 |

78 |

80 |

85 |

88 |

92 |

93 |

96 |

99 |

||

zi |

|

80 |

79 |

69 |

78 |

65 |

64 |

56 |

48 |

44 |

43 |

43 |

43 |

37 |

29 |

27 |

30 |

30 |

19 |

||

ri |

|

1 |

|

2 |

3 |

4 |

5 |

6 |

7 |

8 |

9 |

9 |

11 |

12 |

13 |

14 |

15 |

16 |

17 |

18 |

|

si |

|

18 |

17 |

15 |

16 |

14 |

13 |

12 |

11 |

10 |

7 |

7 |

7 |

6 |

3 |

2 |

4 |

4 |

1 |

||

Число ин- |

17 |

16 |

14 |

14 |

13 |

12 |

11 |

10 |

9 |

6 |

6 |

6 |

5 |

2 |

1 |

1 |

1 |

0 |

|||

версий |

|

||||||||||||||||||||

Сумма всех инверсий: K = 17 + 16 + … + 1 + 0 = 144. Теперь по (11.19) |

|

||||||||||||||||||||

τy / z |

=1 − |

|

4 144 |

|

= −0,882 . |

|

|

|

|

|

|

|

|

|

|

|

|

||||

18(18 −1) |

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

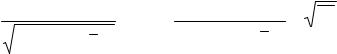

Поскольку имеются связные ранги, то определим из (11.21) поправочные коэф-

фициенты: Vr = 12 (22 − 2) =1, Vs = 12[(32 − 3) + (22 − 2)] = 4 . Получим из (11.20)

−0,882 − |

2(1+ 4) |

|

|

||||||||

|

|

||||||||||

|

|

|

|

18 17 |

|

|

= −0,930. |

||||

τy / z = |

|

2 1 |

|

|

2 |

4 |

|||||

|

− |

− |

|

||||||||

1 |

|

1 |

|

|

|

|

|

||||

18 17 |

18 |

17 |

|||||||||

|

|

|

|

|

|||||||

Оценим значимость τx / y . Расчетное значение статистики согласно (11.22)

u |

calc |

= −0,93 |

9 18(18 −1) = −5,39 , u |

= u |

0,975 |

=1,96 . |

|

|

|

2(2 18 + 5) |

1−α/ 2 |

|

|

||

|

|

|

|

|

|

|

|

Поскольку ucalc > u0,975 , то коэффициент Кендалла значим на 5%-ном уровне.

152

Замечание 11.6. Вычисление коэффициента Кендалла более трудоемкое по сравнению с коэффициентом Спирмена. Однако коэффициент τx/y обладает некоторыми преимуществами перед ρx/y при исследовании его статистических свойств и большим удобством его пересчета при добавлении к уже обследованным объектам новых, т.е. при удлинении ранжировок.

11.5.3.Анализ множественных ранговых связей

Впрактике статистических исследований встречаются случаи, когда совокупность объектов характеризуется более чем двумя ранжировками и необходимо установить статистическую связь между несколькими переменными. В качестве такого измерителя используют коэффициент конкордации рангов Кендалла W, определяемый по формуле

|

|

12 |

|

n |

m(n +1) |

m |

( j) |

2 |

|

|||

W (m) = |

|

|

|

|

∑ |

|

− ∑xi |

|

, |

(11.23) |

||

2 |

(n |

3 |

|

2 |

||||||||

|

m |

|

− n) i=1 |

|

j=1 |

|

|

|

|

|||

где m − число анализируемых порядковых переменных; n − объем выборки; xi( j)

− i-й ранг j-й порядковой переменной. Выражение (11.23) справедливо для случая отсутствия групп связных рангов. В противном случае используем формулу

|

|

|

|

n |

m(n +1) |

m |

( j) |

2 |

|

|

|||

|

|

|

∑ |

|

|

− ∑xi |

|

|

|

||||

|

|

|

|

2 |

|

|

|||||||

W |

|

(m) = |

i=1 |

|

j=1 |

|

|

, |

(11.24) |

||||

|

|

1 |

|

|

|

|

|

m |

|

||||

|

|

|

|

m2 |

(n3 − n) − m∑Tj |

|

|

||||||

|

|

|

12 |

|

|

||||||||

|

|

|

|

|

|

|

j=1 |

|

|

|

|||

где Tj − поправочный коэффициент, определяемый по (11.17).

Коэффициент конкордации обладает следующими свойствами:

1)0 ≤ W(m) ≤ 1;

2)W(m) = 1 при совпадении всех m анализируемых упорядочений;

3)Для случая m = 2 W (x, y) = (ρx / y +1) / 2 .

Проверка значимости коэффициента конкордации основана на том, что в случае справедливости гипотезы об отсутствии корреляционной связи при n > 7 статистика ψ = m(n −1)W имеет приближенно χ2−распределение с (n − 1) сте-

пенями свободы. Поэтому коэффициент W значим на уровне α, если

m(n −1)W > χα2 100%

(n −1) . |

(11.25) |

Пример 11.12. Для данных примера 11.2 определить с помощью коэффициента конкордации тесноту множественной статистической связи между стоимостью квартир, их площадью и удаленностью от областного центра. Проверить значимость найденного коэффициента с α = 0,05.

Решение. Сформируем ранжировки для всех трех компонентов (m = 3) и

определим для всех i суммы ∑3j=1 xi( j) . Результаты приведены в табл. 11.7.

153

Таблица 11.7

xi(Y ) |

9 |

3 |

15 |

4 |

16 |

8 |

2 |

5 |

7 |

11 |

1 |

17 |

9 |

14 |

6 |

12 |

18 |

13 |

xi(U ) |

9 |

17 |

4 |

16 |

3 |

11 |

18 |

15 |

14 |

7 |

12 |

2 |

10 |

5 |

13 |

7 |

1 |

6 |

xi( Z ) |

10 |

15 |

2 |

16 |

4 |

11 |

17 |

14 |

12 |

7 |

18 |

4 |

7 |

3 |

13 |

7 |

1 |

6 |

∑3j=1 xi( j) |

28 |

35 |

21 |

36 |

23 |

30 |

37 |

34 |

33 |

25 |

31 |

23 |

26 |

22 |

32 |

26 |

20 |

25 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В каждой ранжировке есть группы связных рангов: в x(Y ) и |

x(U ) − по одной |

|||||||||

|

|

|

|

|

|

|

|

|

i |

i |

группе из двух элементов, в |

x(Z ) |

− две группы из трех и двух элементов. |

||||||||

|

|

|

|

|

i |

|

|

|

|

|

Вычислим поправочные коэффициенты: |

|

|||||||||

T |

=T = |

|

1 |

(23 − 2) = 0,5 |

, T |

= |

1 |

[(23 − 2) + (33 −3)] = 2,5 . |

|

|

|

|

|

|

|||||||

Y |

U |

12 |

|

Z |

12 |

|

|

|

||

|

|

|

|

|

|

|

||||

Далее, m(n +1) / 2 = 3 19 / 2 = 28,5 . Числитель в (11.24) равен: |

|

|||||||||

(28−28,5)2 + (35−28,5)2 + … + (20−28,5)2 + (25−28,5)2 = 510,5. |

|

|||||||||

Теперь подставляем в (11.24) полученные значения: |

|

|||||||||

W (m) = |

510,5 |

|

= 0,117 . |

|

||||||

|

|

|

|

|

|

|||||

|

|

32 (183 −18) /12 − 3(0,5 + 0,5 + 2,5) |

|

|||||||

Полученный результат свидетельствует об отсутствии одновременной тесной зависимости между рассматриваемыми признаками.

Оценим значимость полученного значения W(m). Расчетное значение статистики: ψcalc = m(n −1)W =3 17 0,117 =5,967 . Верхняя критическая точка:

χα2 100% (n −1) = χ52% (17) = 27,587. Неравенство (11.25) не выполняется, поэтому одновременная статистическая связь между признаками не значимая.

Глава 12. Регрессионный анализ

Рассмотренный выше корреляционный анализ позволяет устанавливать связь между случайными переменными и оценить ее тесноту. Регрессионный анализ представляет собой следующий этап статистического анализа.

Задачами регрессионного анализа являются установление формы зависимости между переменными, оценка функции регрессии и оценка неизвестных значений (прогноз) зависимой переменной.

12.1. Основные положения регрессионного анализа

Определение 12.1. Регрессионный анализ – совокупность методов, позволяющих исследовать вид односторонней зависимости объясняемой (зависимой) переменной Y от одной или нескольких объясняющих (независимых) переменных X = (X1, … , Xp) и подбирать ее параметры.

Такие зависимости имеют вид модельного уравнения регрессии. Частным случаем для одной объясняющей переменной является модель (11.1).

154

12.1.1.Задачи регрессионного анализа

Врегрессионном анализе определяются точные количественные характеристики изменения Y. Статистическая связь Y и X сводится к строгим (неслучайным) соотношениям. На данном этапе статистического анализа решаются следующие основные задачи:

1)Выбор общего вида функции регрессии ϕ(x ,Θ) ;

2)Отбор, если необходимо, наиболее информативных факторов;

3)Оценивание параметров уравнения регрессии Θ = (θ1,θ2 ,K,θl ) ;

4)Анализ точности полученного уравнения регрессии путем построения доверительных интервалов для коэффициентов регрессии, т.е. компонент вектора Θ, для условного среднего отклика y(x) и для прогнозов наблюдений отклика

y(x ) при значениях факторов x = (x1 , K, x p ) .

12.1.2. Многомерная нормальная регрессионная модель

Напомним, что при корреляционной связи между переменными, т.е. когда условное математическое ожидание одной случайной переменной является функцией значения, принимаемого другой случайной переменной, M[Y / x] = M x[Y ] = ϕ(x) , где ϕ(x) − функция регрессии Y относительно X. В об-

щем случае функция регрессии ϕ(x) = M [Y / X = x] описывает условное мате-

матическое ожидание от заданных значений факторов.

Практическое значение знания регрессионной зависимости заключается в возможности прогнозирования значения зависимой случайной переменной Y, когда независимая случайная переменная X принимает определенное значение.

Определение 12.2. Многомерная нормальная регрессионная модель описывается уравнением Y = ϕ( X1,K, X p ) + ε, где функция регрессии ϕ(x) представ-

ляет закономерную часть одномерного отклика Y, ε − случайную часть отклика.

Определение 12.3. Регрессионную модель, удовлетворяющую основным пред-

посылкам 10−50 называют гауссовской регрессионной моделью:

10. Зависимая переменная Y есть величина случайная, а независимые переменные Xi – неслучайные.

20. Математическое ожидание остатка равно нулю, т.е. M[ε] = 0 . 30. Дисперсия остатка постоянна, т.е. D[ε] = const .

40. Остатки εi и εj – не коррелированны, т.е. cov(εi , εj ) = 0 .

50. Остатки εi, i = 1, … , n распределены по нормальному закону.

Замечание 12.1. Для получения уравнения регрессии достаточно предпосылок 10−40. Требование выполнения предпосылки 5 необходимо для оценки точности уравнения регрессии и его параметров.

155

12.1.3. Выбор общего вида функции регрессии

Зависимость Y от X характеризуется формой и теснотой связи. Форма связи выявляет механизм получения зависимой случайной переменной Y. Она может быть линейной ϕ(x) = β0 + β1x или нелинейной. Функция регрессии ищется в одном из классов – параметрическом семействе. Среди нелинейных моделей регрессии обычно рассматриваются следующие зависимости: квадратичная, полиномиальная, экспоненциальная, мультипликативная, обратная по Y, гиперболическая и т.д. Вид зависимости выбирают исходя из визуальной оценки диаграммы рассеяния; опыта предыдущих исследований; знания сущности процесса. В ходе регрессионного анализа вид функции ϕ(x) может уточняться.

12.1.4. Оценивание параметров функции регрессии

Предложение 12.1. (Теорема Гаусса–Маркова). Если линейная регресси-

онная модель является гауссовской, то МНК−оценки ее параметров имеют наименьшую дисперсию в классе всех линейных несмещенных оценок. #

Данное утверждение означает, что при введенных допущениях полученные оценки обладают свойством эффективности. Если истинная модель регрессии нелинейная или закон распределения величин εi неизвестен, то могут существовать методы, дающие лучшие оценки параметров регрессии.

Параметры Θ оцениваются по исходным данным таким образом, чтобы величины ei = yi − ϕ(xi , Θ) , которые называются остатками, в совокупности бы-

ли близки к нулю. В МНК подбор параметров функции регрессии осуществляется минимизацией суммы квадратов остатков:

) |

n |

(12.1) |

Θ = arg min∑[yi − ϕ(xi ,Θ)]2 . |

||

|

Θ i= |

|

|

14424443 |

|

Qε

Найденная по (12.1) функция ϕ(x, Θ) дает наименьшую среднюю квадратическую погрешность прогноза величины Y по X. Для нахождения оценок параметров θ1 = b0 , θ2 = b1 , … , доставляющих минимум функции Qε, приравни-

ваются к нулю все ее частные производные

∑yi |

∂ϕ(xi ) |

− ∑ϕ(xi ) |

∂ϕ(xi ) |

= 0, |

|

i |

∂b |

i |

∂b |

|

|

|

|

0 |

|

0 |

|

∑yi |

∂ϕ(xi ) |

− ∑ϕ(xi ) |

∂ϕ(xi ) |

= 0, |

|

|

i |

∂b |

i |

∂b |

|

|

|

1 |

... |

1 |

. |

|

|

|

|

||

∂Qε = 0, ∂Qε = 0, K, откуда

∂b0 ∂b1

(12.2)

Систему (12.2) называют системой нормальных уравнений.

Величина Qε неотрицательна при любых b0, b1, … , и у нее должен существовать хотя бы один минимум. Поэтому, если система нормальных уравнений

156

имеет единственное решение, то оно доставляет глобальный минимум для Qε и никаких дополнительных исследований на экстремум проводить не нужно.

12.2. Парная линейная регрессионная модель

Проиллюстрируем основные идеи регрессионного анализа на примере парной линейной модели.

12.2.1. Линейная одномерная модель регрессии

Функция регрессии ищем в виде ϕ(x) = y(x) = b0 + b1x . Сумма квадратов остатков равна Qε = ∑in=1( yi − b0 − b1xi )2 . Система (12.2) принимает вид

|

n |

|

|

|

|

|

|

n |

|

|

|

+ b1xi ) = 0, |

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||

∑i=1 yi − |

∑i=1(b0 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||||

|

n |

|

y |

x |

|

− |

|

n |

(b + b x |

)x |

|

|

= 0. |

|

|

|

|

|

|

|

|

|

||||||||||||

|

|

i |

|

i |

|

|

|

|

|

|

|

|

|

|||||||||||||||||||||

∑i=1 |

i |

|

|

|

∑i=1 |

|

|

0 |

|

|

1 i |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

После простых преобразований получим |

|

|

|

|

|

|||||||||||||||||||||||||||||

|

|

+ b1 ∑ |

n |

xi = |

∑ |

n |

|

yi , |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||

nb0 |

|

=1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

(12.3) |

||||||||||||

|

∑n |

|

|

|

i |

|

|

|

i=1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||

xi |

+ b1 ∑n |

|

xi2 |

= ∑n |

|

xi yi . |

|

|

|

|

|

|

|

|

||||||||||||||||||||

b0 |

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||||||||

|

|

|

i=1 |

|

|

|

|

|

i=1 |

|

|

|

|

i=1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

Тогда коэффициент наклона регрессии и свободный член регрессии равны |

||||||||||||||||||||||||||||||||||

|

|

n∑n |

|

xi yi − (∑n |

|

xi ) (∑n |

|

|

yi ) |

|

|

|

|

∑n |

yi −b1 ∑n |

xi |

|

|

||||||||||||||||

b = |

|

|

i=1 |

|

|

|

|

|

|

i=1 |

|

|

|

|

|

i=1 |

|

|

, b |

= |

i=1 |

i=1 |

|

. |

(12.4) |

|||||||||

1 |

|

|

|

|

n∑in=1 xi2 |

− (∑in=1 xi )2 |

|

|

|

|

|

|

|

0 |

|

|

n |

|

|

|

||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||

Для свободного члена равенство (12.4) можно переписать в виде |

|

|||||||||||||||||||||||||||||||||

b0 = |

1 ∑n |

|

yi |

−b1 |

1 ∑n |

xi |

|

= |

|

−b1 |

|

, |

откуда y =b0 + b1x . |

|

||||||||||||||||||||

|

|

y |

x |

|

||||||||||||||||||||||||||||||

|

|

n |

i=1 |

|

|

|

|

n |

|

i=1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

Это означает, что средняя точка (x, y) совместного распределения величин X, Y всегда лежит на линии регрессии ϕ(x). Поэтому при замене x на x − x получим

ϕ(x) − y = b1 (x − x) . |

(12.5) |

Отсюда следует, что для определения линии регрессии достаточно знать лишь ее коэффициент наклона b1. Равенство для b1 можно упростить, если использовать найденное значение выборочного коэффициента корреляции rxy:

b |

= r |

sy |

, |

(12.6) |

|

||||

1 |

xy |

sx |

|

|

где sy и sx − оценки стандартных отклонений yi и xi вокруг своих средних y и x .

Из последнего выражения для b1 видна роль коэффициента корреляции:

чем меньше rxy, тем ближе линия регрессии к горизонтальному положению, т.е.

тем ближе к состоянию неизменности будут средние значения наблюдений yi.

Пример 12.1. Для анализа зависимости объема потребления Y (у. е.) домохозяйства от располагаемого дохода X (у. е.) отобрана выборка объема n = 12 (помесячно в течение года), результаты которой приведены в таблице 12.1.

Таблица 12.1

157

i |

1 |

2 |

3 |

4 |

5 |

6 |

7 |

8 |

9 |

10 |

11 |

12 |

xi |

107 |

109 |

110 |

113 |

120 |

122 |

123 |

128 |

136 |

140 |

145 |

150 |

yi |

102 |

105 |

108 |

110 |

115 |

117 |

119 |

125 |

132 |

130 |

141 |

144 |

Необходимо определить вид зависимости и оценить по МНК параметры уравнения регрессии.

Решение. Построим диаграмму рассеяния (рис. 12.1).

Рис. 12.1. Диаграмма рассеяния.

По расположению точек на диаграмме рассеяния полагаем, что зависимость между Y и X линейная: y = ϕ(x) = b0 + b1 x .

Для наглядности вычислений по МНК построим таблицу 12.2. Таблица 12.2

i |

xi |

yi |

xi2 |

xiyi |

yi2 |

yi |

ei |

ei2 |

1 |

107 |

102 |

11449 |

10914 |

10404 |

103,5832 |

-1,583 |

2,507 |

2 |

109 |

105 |

11881 |

11445 |

11025 |

105,4554 |

-0,455 |

0,207 |

3 |

110 |

108 |

12100 |

11880 |

11664 |

106,3914 |

1,609 |

2,587 |

4 |

113 |

110 |

12769 |

12430 |

12100 |

109,1997 |

0,800 |

0,641 |

5 |

120 |

115 |

14400 |

13800 |

13225 |

115,7522 |

-0,752 |

0,566 |

6 |

122 |

117 |

14884 |

14274 |

13689 |

117,6244 |

-0,624 |

0,390 |

7 |

123 |

119 |

15129 |

14637 |

14161 |

118,5605 |

0,440 |

0,193 |

8 |

128 |

125 |

16384 |

16000 |

15625 |

123,2409 |

1,759 |

3,094 |

9 |

136 |

132 |

18496 |

17952 |

17424 |

130,7295 |

1,270 |

1,614 |

10 |

140 |

130 |

19600 |

18200 |

16900 |

134,4739 |

-4,474 |

20,015 |

11 |

145 |

141 |

21025 |

20445 |

19881 |

139,1543 |

1,846 |

3,407 |

12 |

150 |

144 |

22500 |

21600 |

20736 |

143,8347 |

0,165 |

0,027 |

Сумма |

1503 |

1448 |

190617 |

183577 |

176834 |

- |

1,4 10-14 |

35,249 |

Среднее |

125,25 |

120,6667 |

15884,75 |

15298,08 |

14736,17 |

- |

- |

- |

Согласно МНК имеем:

b |

= |

n∑12i =1 xi yi −(∑12i =1 xi ) (∑12i =1 yi )= 12 183577 −1503 1448 = 0,9361, |

||||

1 |

n∑12i =1 xi2 − |

(∑12i =1 xi )2 |

|

12 190617 −15032 |

||

|

|

|

||||

b |

= ∑12i =1 yi −b1 ∑12i =1 xi |

= 1448 −0,9361 1503 = 3,423 . |

||||

0 |

n |

|

|

12 |

||

|

|

|

|

|||

Таким образом, имеем уравнение парной регрессии y = 3,423 +0,9361x .

158

12.2.2. Оценка точности регрессионной модели

Построим доверительные интервалы для коэффициентов регрессии и зависимой переменной Y.

Интервальные оценки коэффициентов регрессии.

Доверительные интервалы позволяют проверить значимое отличие коэффициентов от нуля. Пусть β0, β1 − коэффициенты истинной регрессии. Важной является гипотеза H0 о коэффициенте наклона, H0: β1 = 0. В этом случае переменная Y изменяется чисто случайно, не завися от значений X. Гипотезу H0 следует отвергнуть против двусторонних альтернатив β1 ≠ 0 на уровне значимости α, если число 0 не входит в доверительный интервал для β1.

Построение доверительных интервалов для параметров β0, β1 основано на том, что отношения (b0 −β0 ) / sb0 и (b1 −β1 ) / sb1 имеют распределение Стьюден-

та с (n−2) степенями свободы, где b0, b1 − оценки коэффициентов регрессии, полученные при решении системы (12.4), sb0 , sb1 − оценки стандартных откло-

нений коэффициентов регрессии. Тогда доверительные интервалы для параметров β0, β1 при надежности оценки (1−α) равны:

b0 ±tα / 2 |

(n − 2) sb |

0 |

и b1 |

± tα / 2 |

(n − 2) sb |

, |

(12.7) |

|

Для s b |

|

|

|

|

1 |

|

||

0 |

, sb выполняются свойства: |

|

|

|||||

|

1 |

|

|

|

|

|

|

|

sb = |

|

|

s |

|

|

|

, sb = |

sε ∑n |

xi2 |

= |

x2 sb . |

|

|

|

ε |

− x)2 |

i=1 |

|

|||||

1 |

n |

|

(x |

i |

0 |

n∑n= (xi − x)2 |

|

1 |

|||

|

∑i=1 |

|

|

|

|

i 1 |

|

|

|

||

Число связей (коэффициентов) для линейной модели l = 2, поэтому |

|||||||||||

|

1 |

n |

|

|

|

|

|

|

|

|

|

sε2 = |

∑( yi − b0 |

− b1xi )2 . |

|

|

(12.8) |

||||||

|

|

|

|||||||||

|

n − 2 i=1 |

|

|

|

|

|

|

|

|

||

Из (12.7) можно получить условия для проверки значимости (в смысле отличия от нуля) оценок коэффициентов регрессии. Действительно, учитывая, что при выполнении гипотезы H0 теоретические коэффициенты регрессии β0 = β1 = 0, получим соотношения для критических статистик

tb |

= |

b0 |

, |

tb |

= |

b1 |

. |

|

|||||||

|

|

||||||

0 |

|

sb |

1 |

|

sb |

||

|

|

|

|

|

|

||

|

0 |

|

|

1 |

|

||

Эти статистики при справедливости H0 имеют распределение Стьюдента с числом степеней свободы (n–2). Отсюда условиями, при которых оценки b0, b1 будут значимыми с надежностью (1−α), являются:

tb |

≥ tα/ 2 100% (n − 2) , |

tb |

≥ tα/ 2 100% (n − 2) . |

0 |

|

1 |

|

Доверительные области для зависимой переменной.

Одной из центральных задач регрессионного анализа является прогнозирование значений зависимой переменной при определенных значениях объясняющих переменных. Здесь возможны два варианта:

1. Предсказать условное математическое ожидание зависимой переменной при определенных значениях объясняющих переменных (предсказание средне-

го значения).

159

2. Предсказать некоторое конкретное значение зависимой переменной

(предсказание конкретного значения).

Построим вначале доверительную область для условного математического ожидания зависимой переменной (для модели регрессии M[Y/X = xp]. Пусть построено уравнение регрессии y(xi ) = b0 + b1xi на основе которого нужно пред-

сказать условное математическое ожидание M[Y/X = xp] = β0 + β1xp переменной Y при X = xp. Возникает вопрос: как сильно может уклониться значение y(x p )

от |

M[Y/X = xp]. Можно |

показать, что статистика T = |

y(xp ) − M x [Y ] |

, где |

||||||||||||||

sy( xp ) |

|

|||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

s2 |

|

= s2 |

|

1 |

|

(xp − x)2 |

|

|

s2 |

|

∑n |

ei2 |

|

|

|

|

||

|

|

|

+ |

|

|

|

, |

= |

i=1 |

|

, имеет t−распределение Стьюдента с |

|||||||

|

|

∑n |

(xi − x)2 |

|

|

|||||||||||||

y |

( xp ) |

ε |

n |

|

|

ε |

|

n − |

2 |

|

|

|

|

|||||

|

|

|

|

|

|

i=1 |

|

|

|

|

|

|

|

|

|

|

|

|

(n−2) степенями свободы, и построить доверительную область для условного математического ожидания M[Y/X = xp]:

b0 + b1xp − tα/ 2 (n − 2) sy( xp ) < β0 + β1xp < b0 + b1xp + tα/ 2 (n − 2) sy( xp ) .

(12.9)Величина доверительной области (12.10) зависит от значения объясняющей переменной xp: при xp = x она минимальна, и увеличивается по мере уда-

ления xp от x (рис. 12.2).

Рис. 12.2.

Построенная доверительная область для Mx[Y] определяет местоположение модельной линии регрессии (условного математического ожидания), а не отдельных возможных значений зависимой переменной, которые отклоняются от среднего x . Получим теперь доверительную область для индивидуальных значений зависимой переменной.

Оценка дисперсии индивидуальных значений yp при x = xp равна

|

2 |

|

2 |

|

|

1 |

|

(xp − x)2 |

|

|||

s |

y p |

= s |

ε |

1 |

+ |

|

+ |

|

|

|

|

, |

n |

n |

(x |

|

− x)2 |

||||||||

|

|

|

|

|

i |

|

||||||

|

|

|

|

|

|

|

|

∑i=1 |

|

|

|

|

а доверительная область для прогнозов индивидуальных значений yp определяется по формуле

b0 + b1xp − tα/ 2 (n − 2) syp < y p < b0 + b1xp + tα/ 2 (n − 2) syp . |

(12.10) |

160