- •И математической статистики

- •Владивосток

- •Основные положения теории вероятностей

- •§ 1. Случайные события.

- •Решение задач типового варианта

- •§ 2. Случайные величины

- •Гипергеометрическое распределение

- •2.2. Числовые характеристики случайных величин.

- •2.4. Случайные векторы; совместная функция и совместная плотность распределения; формула композиции.

- •2.5. Числовые характеристики случайных векторов; характеристики

- •2.6 Характеристические и производящие функции и их свойства.

- •2.7 Распределение величин функций нескольких случайных величин; распределения хи-квадрат, Стьюдента и Фишера

- •Моменты: . (2.48.B)

- •Решение. 1) Так как , то, во-первых, из условия нормировки находим значение коэффициента μ:

- •Б) Функция распределения вероятностей

- •Так как . По свойствам функции распределения должны выполнятся условия:

- •В) Математическое ожидание и дисперсия данной случайной величины ξ равны:

- •Таким образом

- •Примечания: 1) функция Лапласа и интеграл ошибоксвязаны соотношением; 2)и.

- •Список литературы

- •Оглавление

- •Глава I. Основные положения теории вероятностей . . . . . . . . 4

- •§ 1. Случайные события . . . . . . . . . . . . . . . . . . . . . 4

- •§ 2. Случайные величины . . . . . . . . . . . . . . . . . . . . 33

2.4. Случайные векторы; совместная функция и совместная плотность распределения; формула композиции.

Пусть одновременно рассматриваются п случайных величин (ξ1,ξ2, …,ξп). Они образуют п-мерную случайную величину или п-мерный случайный вектор (или случайную точку в п-мерном пространстве), если задана п-мерная функция распределения F(x1, x2, …, xn) = P{x1< ξ1, x2 < ξ2, …, xn < ξп }.

Свойства п-мерной функция распределения:

1. Если среди чисел x1, x2, …, xn есть хотя бы одно равное – ∞ (все остальные - любые), то F(x1, x2, …, – ∞, …, xn) = 0, т.к. { ξk < – ∞} – невозможное событие.

2. F(∞,∞, …, ∞) = 1, т.к " k события { ξk < ∞} – достоверные.

3. F(x1, x2, …, ∞, …, xn) = F(x1, x2, …, xk–1, xk+1 , …, xn); …; F(∞, ∞, …, ∞, xk, ∞, ∞) = Fk(xk) = P{ ξk < xk } – частные функции распределения (п – 1), (п – 2), ..., 2, 1 – мерных случайных векторов.

4. F(x1, x2, …, xn) – неубывающая функция каждого из своих аргументов.

5. F(x1, x2, …, xn) – непрерывна справа по каждому аргументу.

Геометрически функция F(x1, x2, …, xn) определяет вероятность попадания точки в область в п-мерном пространстве, ограниченную плоскостями ξk < xk , k = 1, 2, …, n. Поэтому, если G – любое измеримое множество n-мерного пространства, то

P{ξ1,

ξ2 ,

…,

ξп Î

G }=![]() .

.

Если существует

т.е.

т.е.

то f(x1, …, xn) называется п-мерной плотностью вектора (ξ1,ξ2, …,ξп). Очевидно

![]()

,

,

где

все индексы jν

отличны от

i1,

…,

ik,

а

![]() – плотность вероятности вектора

– плотность вероятности вектора![]() .

.

Если для всего п-мерного векторного пространства F(x1, x2, …, xn) = F1(x1)·F2(x2)· …·Fп(xn), где Fk(xk) – функции распределения случайных величин – компонент п-мерного случайного вектора, то эти компоненты ξ1,ξ2, …,ξп называются независимыми случайными величинами. Если существует плотность вероятности п-мерного случайного вектора, то для независимых величин f(x1, x2, …, xn) = f1(x1)· f2(x2)·…· fп(xn) во всём пространстве, причём {fk(xk)}, k = 1, 2, …, п – маргинальные плотности случайных величин { ξk }.

Плотность

вероятности

![]() суммы независимых случайных величин

называетсякомпозицией

(свёрткой)

плотностей

суммы независимых случайных величин

называетсякомпозицией

(свёрткой)

плотностей

![]() ,

,![]() этих величин, что в частном случае двух

случайных величин имеет вид:

этих величин, что в частном случае двух

случайных величин имеет вид:

,

(2.12.a)

,

(2.12.a)

для непрерывных случайных величин и

![]() (2.12.b)

(2.12.b)

2.5. Числовые характеристики случайных векторов; характеристики

статистической связи случайных величин

a) Числовые характеристики случайных векторов. Математическим ожиданием случайного вектора (ξ1,ξ2, …,ξп) называется неслучайный вектор (μ1,μ2, …, μп), где μk = Мξk , k = 1, 2, …, п, причём

.

.

Ковариационной

матрицей

случайного

вектора

(ξ1,ξ2,

…,ξп)

называется квадратная матрица п-го

порядка

![]()

,

элементы которой

,

элементы которой

![]() –смешанные

центральные моменты 2-го порядка двумерных

случайных величин (

–смешанные

центральные моменты 2-го порядка двумерных

случайных величин (![]() ),i,

j

= 1, 2, …,

п,

называемах ковариациями

пар случайных величин

),i,

j

= 1, 2, …,

п,

называемах ковариациями

пар случайных величин

![]() и

и![]() при i

≠

j, а при

i = j

представ-ляющих собой дисперсии случайных

величин

при i

≠

j, а при

i = j

представ-ляющих собой дисперсии случайных

величин

![]() :

:![]() =D

=D![]() ,i

= 1, 2, …,

п;

очевидно

,i

= 1, 2, …,

п;

очевидно

![]() .

Эти величины надо понимать как:

.

Эти величины надо понимать как:

;

;

![]()

Многомерное

распределение называется собственным

или

невырожденным,

если ранг

распределения,

понимаемый как ранг r

матрицы

![]() удовлетворяет условиюr

= n; при r

< n

распределение называется несобственным.

удовлетворяет условиюr

= n; при r

< n

распределение называется несобственным.

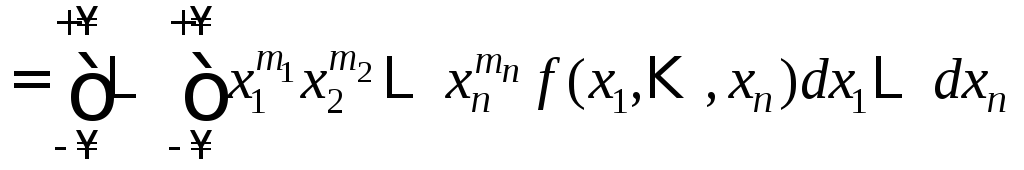

Совершенно очевидно, что можно ввести в рассмотрение любые смешанные моменты, как начальные так и центральные, например число

–смешанный

начальный момент (m1

+

m2 +

… + mn)-го

порядка, а

–смешанный

начальный момент (m1

+

m2 +

… + mn)-го

порядка, а

![]() ––смешанный

центральный момент (m1

+

m2 +

… + mn)

– го порядка.

––смешанный

центральный момент (m1

+

m2 +

… + mn)

– го порядка.

Наряду с центральным смешанным моментом порядка (1+1) двумерного случайного вектора, называемого ковариацией, важной групповой числовой характеристикой, отражающей свойства совокупности двух случайных величин, является корреляция :

.

(2.13)

.

(2.13)

для непрерывных и дискретных совокупностей соответственно.

Если

случайные величины ξ и η – независимы,

то

![]()

![]() .

Так как при этом

.

Так как при этом

![]() ,

(2.14)

,

(2.14)

то ковариация и корреляция случайных величин ξ и η связаны соотношением

cov(ξ,η) = cor(ξ,η) – μξ·μη . (2.15)

Очевидно,

для независимых величин ξ и η ковариация

![]() .

.

Обратное утверждение в общем случае неверно, т.е. из равенства cov(ξ,η) = 0 в общем не следует независимость случайных величин ξ и η. Такое утверждение, в частности, верно, если случайные величины ξ и η имеют гауссовские распределения.

Легко получить следующие неравенства, задающие верхние и нижние границы корреляции и ковариации:

![]()

Если случайные величины ξ и η связаны функциональной линейной зависимостью

η

= cξ

+ b,

где c и

b – числа,

то среднеквадратичное отклонение

![]() ,

а ковариация этих величин

,

а ковариация этих величин что соответствует граничным значениям

её допустимого интервала. Таким образом,

ковариация являетсямерой

статистической связи

между случайными величинами ξ и η,

достигая максимального (по модулю)

значения при их функциональной линейной

зависимости и равной 0 при их независимости.

Однако для нелинейной

связи между случайными величинами их

ковариация не может использоваться как

мера статистической связи, поскольку

значение ковариации не отражает степень

этой связи.

что соответствует граничным значениям

её допустимого интервала. Таким образом,

ковариация являетсямерой

статистической связи

между случайными величинами ξ и η,

достигая максимального (по модулю)

значения при их функциональной линейной

зависимости и равной 0 при их независимости.

Однако для нелинейной

связи между случайными величинами их

ковариация не может использоваться как

мера статистической связи, поскольку

значение ковариации не отражает степень

этой связи.

Для характеристики степени статистической связи двух случайных величин ξ и η обычно используют не саму их ковариацию, а коэффициент корреляции этих величин:

ρ(ξ,η)

,

(2.16)

,

(2.16)

где случайные величины ξ0 и η0 – безразмерные имеют нулевые математические ожидания (Мξ0 = 0; Мη0 = 0) и единичные дисперсии (Dξ0 = 1; Dη0 = 1) так как получены из исходных величин преобразованием нормировки:

.

.

Коэффициент корреляции является безразмерной величиной, принимает значения на интервале [-1, 1], и используется как мера статистической связи линейного типа между случайными величинами ξ и η.

Пусть

{ ξ1,ξ2,

…,ξп

} –

множество случайных величин. Для каждой

пары элементов (ξi,

ξj),

i

≠

j, этого

множества можно ввести «расстояние»

d2(![]() )

=М(

)

=М(![]() –

–![]() )2

между этими

элементами, представляющего собой

псевдометрику,

что следует из выполнения трёх аксиом,

определяющих любую метрику:

)2

между этими

элементами, представляющего собой

псевдометрику,

что следует из выполнения трёх аксиом,

определяющих любую метрику:

1. d(ξi, ξj) ≥ 0 т.к. М(ξi – ξj)2 ≥ 0, причём из условия (ξi – ξj) = 0 следует М(ξi – ξj)2 = 0 (если бы было справедливо и обратное то d(ξi, ξj) было бы метрикой).

2.

![]() =

=![]() ,

т.к.

,

т.к.![]() =

=![]() .

.

3.

![]() ≤

≤

![]() +

+

![]() т.к.

т.к.![]() .

.

Для нормированных случайных величин справедливо равенство

![]()

Для определения характера статистической зависимости между случайными величинами ξ и η рассматриваются линии регрессии, определяемые равенствами

![]() (2.17)

(2.17)

и представляющие собой средние для y-сечения и x-сечения соответственно. Разумеется, y-сечение представляет собой условное распределение η при заданном ξ = x и его среднее определяет регрессию η по ξ. Аналогично, среднее условного распределения ξ при заданном η = y (x-сечения) определяет регрессию ξ по η.

Если регрессии ξ по η и η по ξ в точности линейны, т. е. имеют место уравнения

![]() ,

откуда следуют соотношения:

,

откуда следуют соотношения:

![]() т.е.

т.е.

(2.18)

(2.18)

– линейные коэффициенты регрессии ξ по η и η по ξ, соответственно. Равенства

(2.19)

(2.19)

называются уравнениями линейной регрессии.

Отношения дисперсий средних значений для x-сечения и y-сечения к дисперсиям величин ξ и η, соответственно, определяют корреляционные отношения ξ по η и η по ξ:

![]() .

(2.20)

.

(2.20)

Так как при строгой линейности одной или обеих регрессий

![]() и/или

и/или

![]() ,

то

,

то

![]() ,

когда обе регрессии линейны;

,

когда обе регрессии линейны;

![]() ,

когда регрессия ξ по η линейна, а η по

ξ – нелинейна; аналогично,

,

когда регрессия ξ по η линейна, а η по

ξ – нелинейна; аналогично,![]() ,

когда регрессия η по ξ линейна, а ξ по

η – нелинейна. В общем случае

,

когда регрессия η по ξ линейна, а ξ по

η – нелинейна. В общем случае![]() ,

причём корреляционные отношенияне

являются мерой ни для какого либо

конкретного вида зависимостей

случайных величин ξ и η. Лишь значения

величин

,

причём корреляционные отношенияне

являются мерой ни для какого либо

конкретного вида зависимостей

случайных величин ξ и η. Лишь значения

величин

![]() и

и

![]() могут

служить индикаторами

(но не мерой) нелинейности.

могут

служить индикаторами

(но не мерой) нелинейности.

b) Частная корреляция и регрессия. На практике нередки ситуации, когда корреляция двух случайных величин может быть всего лишь отражением того факта, что они обе коррелированы с некоторой третьей величиной или совокупностью величин. Это приводит к необходимости рассмотрения условных корреляций между двумя величинами при фиксированных значениях остальных величин. Это так называемые частные корреляции.

Пусть{

ξ1,ξ2,

…,ξп

} – множество случайных величин; f(x1,

x2,

…,

xn)

– их совместная плотность и f(x1,

...,

xk

| xk+1,

…,

xn)

– совместная условная плотность

распределения, а g(xk+1,

…,

xn)

– совместное маргинальное распределение

величин{![]() ,…,

,…,![]() }.

Если

}.

Если![]() обозначает ковариацию между

обозначает ковариацию между![]() и

и![]() в условном распределении величин {ξ1,

…,

в условном распределении величин {ξ1,

…,![]() },

а

},

а![]() – их безусловную ковариацию, то

– их безусловную ковариацию, то ,

где

,

где![]() – корреляционная матрица размера (n

– k)× (n

– k) величин

ξ k +1,

…,ξп.

– корреляционная матрица размера (n

– k)× (n

– k) величин

ξ k +1,

…,ξп.

Если

зафиксировать все переменные, кроме

двух, скажем

![]() и

и![]() , точастный

коэффициент корреляции между

этими величинами равен

, точастный

коэффициент корреляции между

этими величинами равен

,

(2.21)

,

(2.21)

где

Cij

– алгебраическое дополнение (i,

j)-го

элемента в полном (размера n×n)

корреляционном определителе

![]() ,

элементы которого связаны с элементами

матрицы ковариаций соотношением

,

элементы которого связаны с элементами

матрицы ковариаций соотношением ;

величина

;

величина![]() = {ξ1,

…,

= {ξ1,

…,

![]() ,

,![]() ,…,

,…,

![]() ,

,

![]() ,…,

,…,

![]() }

символизирует совокупность фиксированных

величин, а указанныепервичные

индексы i, j

у q

служит для различения таких совокупностей.

Частный коэффициент корреляции

симметричен относительно переменных,

указанными первичными индексами и не

зависит явно от фиксированных значений.

}

символизирует совокупность фиксированных

величин, а указанныепервичные

индексы i, j

у q

служит для различения таких совокупностей.

Частный коэффициент корреляции

симметричен относительно переменных,

указанными первичными индексами и не

зависит явно от фиксированных значений.

В

частности, если зафиксировать только

одну переменную, например

![]() ,

то

,

то

![]() =

1 и

=

1 и

![]() ;

приu=

v получаем

условную дисперсию u:

;

приu=

v получаем

условную дисперсию u:

![]() ,

где

,

где![]() и т.п. Тогда частный коэффициент корреляции

и т.п. Тогда частный коэффициент корреляции

.

(2.22)

.

(2.22)

Обобщая

понятие линейной регрессии, при

рассмотрении п

случайных величин

следует

записать

![]()

,

где коэффициенты

,

где коэффициенты

![]() называютсячастными

коэффици-ентами регрессии;

qj

= (1, 2, …,

j–1,

j+1,

…,

n)

– набор индексов, определя-ющих

совокупность фиксированных переменных.

Для многомерного нор-мального

распределения

называютсячастными

коэффици-ентами регрессии;

qj

= (1, 2, …,

j–1,

j+1,

…,

n)

– набор индексов, определя-ющих

совокупность фиксированных переменных.

Для многомерного нор-мального

распределения и т.к.

и т.к.![]() ,

то

,

то

.

(2.23)

.

(2.23)

Величину

![]()

называют ошибкой (остатком) порядка (п–1)величины xj относительно регрессии. Её дисперсия

.

(2.24)

.

(2.24)

Для

многомерного нормального случая

.

В более общем случае

.

В более общем случае ,

что применимо и в том случае, когда

вторичные индексы одной величины

включают в себя первичные индексы

другой. Если же оба множества вторичных

признаков не содержатl

и

m, то, обозначив

через q

общее множество вторичных признаков,

получаем

,

что применимо и в том случае, когда

вторичные индексы одной величины

включают в себя первичные индексы

другой. Если же оба множества вторичных

признаков не содержатl

и

m, то, обозначив

через q

общее множество вторичных признаков,

получаем

![]()

Дисперсию ошибки порядка s можно выразить через дисперсию ошибки порядка (s – 1) и коэффициент корреляции порядка (s – 2) и т.д., вплоть до дисперсии ошибки нулевого порядка и s коэффициентов корреляции, порядок которых принимает значения от нуля до (s – 1):

![]()

=

![]() (2.25)

(2.25)

где

![]() – множество вторичных индексов.

– множество вторичных индексов.

Замечание: порядок вторых первичных и вторичных индексов в приведённом выражении произволен и не влияет на результат.

Формулы для выражения коэффициента регрессии через некоторые коэффициенты следующего, более низкого, порядка и соответствующего частного коэффициента корреляции можно представить в виде:

(2.26)

(2.26)

.

(2.27)

.

(2.27)

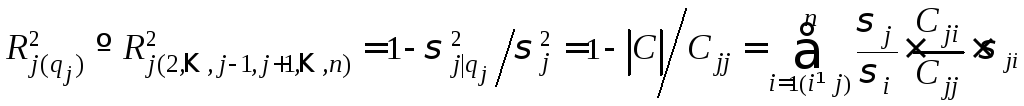

c)

Множественная корреляция. Используя

задаваемую (2.24) дисперсию ошибки

![]() случайной величины

случайной величины![]() относительно её регрессии, можно ввестимножественный

коэффициент корреляции

относительно её регрессии, можно ввестимножественный

коэффициент корреляции

![]() между

между

![]() и совокупностью остальных переменных,

множество индексов которых обозначено

какqj:

и совокупностью остальных переменных,

множество индексов которых обозначено

какqj:

.

(2.28)

.

(2.28)

Учитывая (2.23), справедливо выражение

![]()

![]() (2.29)

(2.29)

С

учётом приведённых соотношений 0 ≤ R2

≤ 1, а сам

коэффициент множественной корреляции

определяется как корень квадратный из

R2

и всегда

неотрицателен.

Коэффициент R,

очевидно, несимметричен относительно

своих индексов и представляет собой на

самом деле меру

зависимости

![]() от

(ξ1,

…,

от

(ξ1,

…,

![]() ,

,![]() ,…,

,…,

![]() ),

т.е. являетсяобычным

коэффициентом

корреляции

между

),

т.е. являетсяобычным

коэффициентом

корреляции

между

![]() и условным

математическим ожиданием

и условным

математическим ожиданием

![]() .

.

Поскольку в (2.24) допустима перестановка индексов, то из (2.28) следует:

![]() ,

(2.30)

,

(2.30)

где

![]() – произвольный частный или нулевого

порядка (т.е. обычный) коэффициент

корреляции (это означает, что множество

вторичных индексов (qj

– p)

может содержать любое их число от 0 до

(n

– 2)), содержащий j

среди первичных индексов. Таким образом

множественный коэффициент корреляции

не меньше,

чем абсолютная величина любого

коэффициента корреляции с таким же

первичным индексом, а точнее не

меньше наибольшей из корреляций любого

порядка.

– произвольный частный или нулевого

порядка (т.е. обычный) коэффициент

корреляции (это означает, что множество

вторичных индексов (qj

– p)

может содержать любое их число от 0 до

(n

– 2)), содержащий j

среди первичных индексов. Таким образом

множественный коэффициент корреляции

не меньше,

чем абсолютная величина любого

коэффициента корреляции с таким же

первичным индексом, а точнее не

меньше наибольшей из корреляций любого

порядка.

Пусть

q

и s

– два подмножества вторичных индексов,

так что s Í

q ( т.е.

s – подмножество

q).

Тогда из (2.24) следует

![]() ,

а с учётом (2.28) справедливы соотношения

вида:

,

а с учётом (2.28) справедливы соотношения

вида:

![]() ,

выражающие то, что коэффициент

множественной корреляции нельзя

уменьшить путём расширения множества

величин, относительно которых измеряется

зависимость ξj.

Если множество индексов q

=

k, т.е. состоит

всего из одного индекса то

,

выражающие то, что коэффициент

множественной корреляции нельзя

уменьшить путём расширения множества

величин, относительно которых измеряется

зависимость ξj.

Если множество индексов q

=

k, т.е. состоит

всего из одного индекса то

![]() – обычный коэффициент корреляции.

– обычный коэффициент корреляции.