- •2.Автокорреляция случайного возмущения. Причины. Последствия.

- •4.Автокорреляция. Методы устранения автокорреляции

- •5.Алгоритм проверки адекватности парной регрессионной модели

- •6.Алгоритм проверки значимости регрессора в парной регрессионной модели

- •7.Алгоритм теста Голдфелда-Квандта на наличие (отсутствие) гетероскедастичности случайных возмущений.

- •8.Выбор типа математической функции при построении уравнения регрессии

- •9.Выведите формулы вычисления параметров модели парной регрессии

- •10.Гетероскедастичность - понятие, проявление и меры устранения.

- •11.Гетероскедастичность случайного возмущения. Причины. Последствия. Тест gq.

- •12.Двухшаговый метод наименьших квадратов для оценки параметров структурной формы модели

- •15.Индивидуальная и интервальная оценка индивидуального значения зависимой переменной

- •16.Интервальная оценка параметров уравнения парной регрессии

- •17.Классическая парная регрессионная модель. Спецификация модели. Теорема Гаусса – Маркова.

- •18.Ковариация, коэффициент корреляции и индекс детерминации

- •19.Количественные характеристики взаимосвязи пары случайных переменных.

- •20. Косвенный метод наименьших квадратов для оценки параметров структурной формы модели

- •21. Коэффициент корреляции и индекс детерминации в регрессионной модели.

- •22. Линейная модель множественной регрессии

- •23. Метод Монте-Карло, его применение в эконометрике

- •24. Метод наименьших квадратов: алгоритм метода; условия применения. Обобщённый метод наименьших квадратов

- •25. Модели с бинарными (фиктивными) переменными.

- •26. Моделирование тенденции временных рядов (аналитическое выравнивание)

- •27. Мультиколлинеарность факторов – понятие, проявление и меры устранения

- •28. Назначение теста Голдфелда-Квандта, этапы его проведения.

- •Нелинейная модель множественной регрессии Кобба-Дугласа. Оценка её коэффициентов.

- •30.Нелинейная регрессия (линеаризация, оценка параметров)

- •31.Ожидаемое значение случайной переменной, её дисперсия и среднее квадратическое отклонение.

- •32.Основные числовые характеристики вектора остатков в классической множественной регрессионной модели

- •33.Отражение в модели влияния неучтённых факторов и времени.

- •35.Оценка адекватности полученной эконометрической модели (см. 5)

- •36.Оценка коэффициентов модели Самуэльсона-Хикса

- •37.Оценка параметров множественной регрессионной модели методом наименьших квадратов.

- •38. Оценка параметров парной регрессионной модели методом наименьших квадратов.

- •39.Оценка параметров эконометрической модели

- •40.Оценка статистической значимости коэффициентов модели множественной регрессии. (см. 6)

- •41.Подбор объясняющих переменных множественной линейной модели. Алгоритм исключения квазинеизменных переменных

- •42.Подбор объясняющих переменных множественной линейной модели. Метод анализа матрицы коэффициентов корреляции.

- •43.Подбор переменных в модели множественной регрессии на основе метода оценки информационной ёмкости.

- •44.Понятие гомоскедастичности и гетероскедастичности случайных возмущений, их графическая интерпретация.

- •45.Порядок оценивания линейной модели множественной регрессии методом наименьших квадратов (мнк) в Excel

- •46.Последствия гетероскедастичности. Тест Голдфелда-Квандта.

- •47.Предпосылки метода наименьших квадратов

- •48.Применение обобщенного метода наименьших квадратов (омнк) для случая гетероскедастичности остатков.

- •49.Применение теста Стьюдента в процедуре подбора переменных в модели множественной регрессии.

- •50.Применение фиктивных переменных при исследовании сезонных колебаний: спецификация модели, экономический смысл параметров при фиктивных переменных.

- •52.Проблема мультиколлинеарности в моделях множественной регрессии. Признаки мультиколлинеарности.

- •53.Проверка качества эконометрической модели См.5

- •54.Прогнозирование экономических переменных. Проверка адекватности модели. См.5

- •56.Регрессионные модели с фиктивными переменными.

- •57.Роль вектора и матрицы корреляции множественной линейной модели при подборе объясняющих переменных.

- •58.Свойства дисперсии случайной переменной

- •59.Случайные переменные и их характеристики.

- •60.Смысл и значение множественной регрессии в эконометрических исследованиях. Выбор формы уравнения множественной регрессии.

- •62.Спецификация и оценивание мнк эконометрических моделей нелинейных по параметрам

- •64.Способы корректировки гетероскедастичности. Метод взвешенных наименьших квадратов.

- •65.Статистические свойства оценок параметров парной регрессионной модели.

- •66.Статистические характеристики выборки и генеральной совокупности статистических данных. Их соотношения.

- •67.Суть метода наименьших квадратов. Его графическое пояснение

- •68.Схема Гаусса – Маркова.

- •69.Схема построения эконометрической модели.

- •70.Теорема Гаусса – Маркова.

- •71.Тест Дарбина – Уотсона, последовательность его выполнения.

- •72.Тест Стьюдента.

- •73. Типы переменных в эконометрических моделях. Структурная и приведённая формы спецификации эконометрических моделей.

- •74. Устранение автокорреляции в парной регрессии. (см. 4)

- •75. Функция регрессии как оптимальный прогноз.

- •76. Цели и задачи эконометрики. Этапы процесса эконометрического моделирования. Классификация эконометрических моделей.

- •77. Эконометрика, её задача и метод.

- •78. Эконометрическая инвестиционная модель Самуэльсона-Хикса.

- •80. Этапы исследования зависимостей между экономическими явлениями при помощи эконометрической модели. Принципы спецификации модели. Формы эконометрических моделей.

- •81. Этапы построения эконометрических моделей

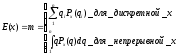

31.Ожидаемое значение случайной переменной, её дисперсия и среднее квадратическое отклонение.

Математическое

ожидание (ожидаемое или среднее значение)

Е(х) находится по формуле:

Где Px(qi) – это вероятность появления в опыте значения qi случайной переменной х.

Е(х) – это константа, вокруг которой рассеяны возможные значения q случайной переменной х.

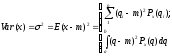

Дисперсия Var (x) – это средний квадрат разброса возможных значений случайной переменной х относительно ее ожидаемого значения:

Либо по формуле: σ2 = Е(х2) – m2

Так что Var (x) – это тоже константа, физическая размерность которой равна квадрату физической размерности значений х.

Положительный квадратный корень из дисперсии именуется средним квадратическим отклонением (СКО): σ = (Var (x))^(1/2). Размерность σ и х совпадают. Константа σ (как и σ2) служит характеристикой неопределенности (изменчивости) х.

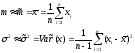

Для отыскания величин σ2, m нужно знать закон распределения Px(q) случайной переменной х. Часто этот закон неизвестен, и тогда можно оценить (приближенно определить) характеристики σ2, m по результатам n независимых наблюдений (опытов) над х (х1, х2,…, хn), где xi – это случайная переменная с одним и тем же законом распределения Px(q), при этом величины xi – независимы. Кроме того, с ростом количества наблюдений n точность следующих формул, используемых в данном случае, возрастает:

32.Основные числовые характеристики вектора остатков в классической множественной регрессионной модели

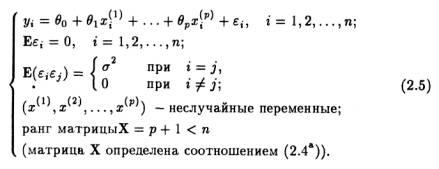

Классическая линейная модель множественной регрессии (КЛММР) представляет собой простейшую версию конкретизации требований к общему виду функции регрессии f(X), природе объясняющих переменных X и статистических регрессионных остатков (Х) в общих уравнениях регрессионной связи. В рамках КЛММР эти требования формулируются следующим образом:

Из (2.5) следует, что

в рамках КЛММР рассматриваются только

линейные

функции регрессии, т.е.

![]()

где объясняющие переменные x(1), x(2),…, x(p) играют роль неслучайных параметров, от которых зависит закон распределения вероятностей результирующей переменной y. Это, в частности, означает, что в повторяющихся выборочных наблюдениях (xi(1), xi(2),..., хi(p); yi) единственным источником случайных возмущений значений yi являются случайные возмущения регрессионных остатков i.

Кроме того, постулируется взаимная некоррелированность случайных регрессионных остатков (E(ij) = 0 для i j). Это требование к регрессионным остаткам 1,...,n относится к основным предположениям классической модели и оказывается вполне естественным в широком классе реальных ситуаций, особенно, если речь идет о пространственных выборках (2.4а)-(2.4б), т.е. о ситуациях, когда значения анализируемых переменных регистрируются на различных объектах (индивидуумах, семьях, предприятиях, банках, регионах и т. п.). В этом случае данное предположение означает, что «возмущения» (регрессионные остатки), получающиеся при наблюдении одного какого-либо обследуемого объекта, не влияют на «возмущения», характеризующие наблюдения над другими объектами, и наоборот.

Тот факт, что для всех остатков 1,2,...,n выполняется соотношение Ei2; =2 , где величина 2 от номера наблюдения i не зависит, означает неизменность (постоянство, независимость от того, при каких значениях объясняющих переменных производятся наблюдения) дисперсий регрессионных остатков. Последнее свойство принято называть гомоскедастичностью регрессионных остатков.