- •1. Предмет эконометрики. Измеренияния в экономике. Типы шкал.

- •2. Линейность и аддитивность связей в функции

- •3. Типы данных. Выбор вида функции парной регрессии.

- •4. Смысл и оценка параметров линейной регрессии. Мнк.

- •5. Уравнение парной линейной регрессии в отклонениях

- •6. Геометрическая интерпретация мнк. Матричная форма записи мнк.

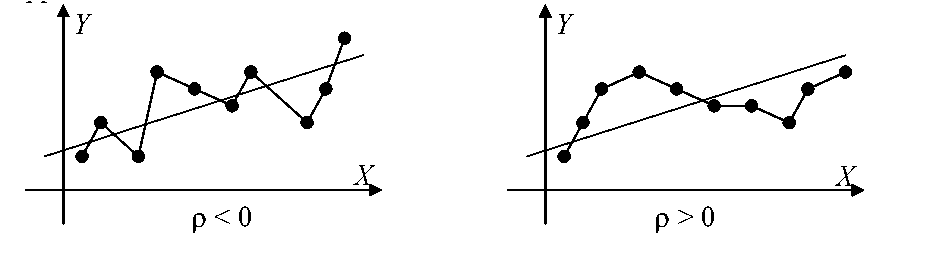

- •7. Линейный коэффициент корреляции. Коэффициент детерминации и его связь с коэффициентом корриляции.

- •8. Оценка существенности (значимости) линейной регрессии

- •9. Природа ошибок регрессии. Основные гипотезы для обоснования парной линейной регрессионной модели

- •10. Теорема Гаусса-Маркова для парной линейной регрессии.

8. Оценка существенности (значимости) линейной регрессии

После того как найдено уравнение лин. регрессии, проводится оценка значимости как уравнения в целом, так и отдельных его параметров.

Оценка значимости ур-я регрессии дается с пом. F- критерия Фишера. При этом выдвигается нулевая гипотеза, что коэффициент регрессии равен 0, т.е. b =0, и, фактор X не оказывает влияния на результат y.

Непосредственному расчету F- критерия предшествует анализ дисперсии. Центральное место в нем занимает разложение общей суммы квадратов отклонений переменной Y от среднего значения на две части — «объясненную» и «необъясненную».Если фактор не оказывает влияния на рез-т, то Ŷ=Y дисперсия рез-та не зависит от регрессора, т.е. остаточная дисперсия=0.

Любая сумма

квадратов отклонений связана с числом

степеней свободы, кот. показывает сколько

независимых отклонений из n

возможных [(Yl-Y),(Y2-Y),...,(Yn-Y)]

требуется для образования данной суммы

квадратов. Для общей суммы квадратов

![]() требуется (n-1)

независимых отклонений. При расчете

объясненной или факторной суммы квадратов

требуется (n-1)

независимых отклонений. При расчете

объясненной или факторной суммы квадратов

![]() используются теоретические (расчетные)

значения результативного признака

используются теоретические (расчетные)

значения результативного признака

![]() ,

найденные по линии регрессии

,

найденные по линии регрессии

![]() .

В линейной регрессии

.

В линейной регрессии

![]() (1).

Это следует из ф-лы лин. Коэффициента

корреляции

(1).

Это следует из ф-лы лин. Коэффициента

корреляции

из которой получим: r2=b2σx2/σy2, т.е. сумма квадр. отклонений, обусловленных лин. регрессией, запишется как (1). Поскольку при заданном объеме наблюдений по X и по Y факторная сумма квадратов при линейной регрессии зависит только от одной константы коэффициента регрессии b, то данная сумма квадратов имеет одну степень свободы.

Существует рав-но между числом степеней свободы общей , факторной, остаточной суммами квадратов. Число степеней свободы остаточной суммы квадратов при линейной регрессии сост. n-2. Число степеней свободы для общей суммы квадратов определяется числом единиц, т.е. dfобщ=n-1.

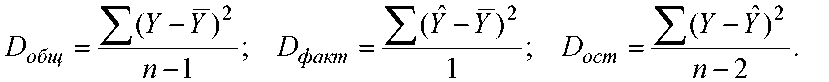

Если поделить каждую сумму кв. отклонений на соот-ее ей число степеней свободы, получим средний квадрат отклонений, т.е. дисперсию на одну степень свободы.

Эти дисперсии явл. сравнимыми. Величина F=Dфакт/Dост наз. критерием Фишера. Если нулевая гипотеза H0 справедлива, то факторная и остаточные дисперсии не отличаются друг от друга. Альтернативная гипотеза H1 будет справедлива , если факторная дисперсия превышает остаточную в несколько раз. Для оценки исп. Табл. Критических значений F-отношений при различных уровнях значимости и различном числе степеней свободы. Если полученная в результате числовой обработки результатов эксперимента Fфакт>Fтабл, то гипотеза H0 отклоняется. В противном случае уравнение регрессии считается статистически незначимым.

9. Природа ошибок регрессии. Основные гипотезы для обоснования парной линейной регрессионной модели

1 ° Yt=а+bXt+εt, t=l,...,n — спецификация модели. εt – ошибка измерения

2° Xt — детерминированная величина; вектор х=(Х1,...,Хn)' не коллинеарен вектору i=(1,...,1), т.е. не все х одинаковы.

За° E(εt)=0; 3b° Е(εt2)=σ2 — не зависит от t.

4° E(εt*εs)=0 при t≠s, некоррелированность ошибок для различных наблюдений

Часто добавляется условие

5° Ошибки εt имеют совместное норм. распределение с мат. ожиданием=0 и дисперсией= σ2.

В этом случае модель называется классической нормальной линейной регрессионной.

Зам. В случае норм. Линейной регрессионной модели условие 4° эквивалентно условию статистической независимости ошибок εt и εs.

Реальные модели не «обязаны» соблюдать эти условия, обсудим условия 1° - 4° и их возможные нарушения.

Условие 1° указывает на спецификацию модели, как парной лин. регрессии. Возможно, что на результативный признак оказывает не одна, а несколько переменных. В этом случае получаем модель множественной регрессии. Если же хоть один из регрессоров входит в заданную модель нелинейно, то имеем модель нелинейной регрессии

Условие 2° означает, что не все регрессоры одинаковы. При невыполнении этого условия никакой реальной регрессионной модели построить невозможно.

Условие За° E(Yt)=a+bXt т.е. при фиксированном Xt среднее ожидаемое значене Yt =а+bXt.

Условие 3б° (гов. о независимости дисперсии ошибки от номера наблюдения) гомоскедастичность. Отклонение от этого условия наз. гетероскедастичностью.

Условие 4° указывает на некоррелированность ошибок, для простых величин выполняется практически всегда; но для временных рядов это условие часто нарушается, т.е. имеет место автокорреляции ошибок.