- •Федеральное агентство по образованию

- •Оглавление

- •Глава 1. Основные понятия искусственного интеллекта

- •§ 1.1. Основные термины и определения

- •§ 1.2. История развития систем ии

- •§ 1.3. Направления развития искусственного интеллекта

- •§ 1.4. Основные направления развития и применения

- •Вопросы для самоконтроля

- •Глава 2. Положения теории нечетких множеств

- •§ 2.1. Нечеткое множество. Операции над нечеткими множествами

- •§ 2.1.1. Основные операции над нечеткими множествами.

- •§ 2.2. Построение функции принадлежности

- •§ 2.2.1. Некоторые методы построения функции принадлежности.

- •§ 2.3. Нечеткие числа

- •§ 2.4. Операции с нечеткими числами (l-r)-типа

- •§ 2.5. Нечеткая и лингвистическая переменные

- •§ 2.6. Нечеткие отношения

- •§ 2.7. Нечеткая логика

- •§ 2.8. Нечеткие выводы

- •§ 2.9. Автоматизация обработки информации с использованием

- •Вопросы для самоконтроля

- •Глава 3. Основные интеллектуальные системы

- •§ 3.1. Данные и знания

- •§ 3.2. Модели представления знаний

- •Представление знаний

- •Классификация знаний

- •§ 3.3.1. Продукционные правила.

- •§ 3.3.2. Фреймы.

- •§ 3.3.3. Семантические сети.

- •Вопросы для самоконтроля

- •§ 3.4. Экспертные системы. Предметные области

- •§ 3.5. Назначение и область применения экспертных систем

- •§ 3.6. Методология разработки экспертных систем

- •§ 3.7. Основные экспертные системы

- •§ 3.8. Трудности в разработке экспертных систем и пути их

- •Вопросы для самоконтроля

- •§ 3.9. Назначение, классификация роботов

- •§ 3.10. Примеры роботов и робототехнических систем

- •§ 3.10.1. Домашние (бытовые) роботы.

- •§ 3.10.2. Роботы спасатели и исследовательские роботы.

- •§ 3.10.3. Роботы для промышленности и медицины.

- •§ 3.10.4. Военные роботы и робототехнические системы.

- •§ 3.10.5. Мозг как аналого-цифровое устройство.

- •§ 3.10.6. Роботы – игрушки.

- •§ 3.11. Проблемы технической реализации роботов

- •Вопросы для самоконтроля

- •§ 3.12. Адаптивные промышленные роботы

- •§ 3.12.1. Адаптация и обучение.

- •§ 3.12.2. Классификация адаптивных систем управления

- •§ 3.12.3. Примеры адаптивных систем управления роботами.

- •§ 3.12.4. Проблемы в создании промышленных роботов.

- •Вопросы для самоконтроля

- •§ 3.13. Нейросетевые и нейрокомпьютерные технологии

- •§ 3.13.1. Общая характеристика направления.

- •§ 3.13.2. Нейропакеты.

- •Вопросы для самоконтроля

- •§ 3.14. Нейронные сети

- •§ 3.14.1. Персептрон и его развитие.

- •3.14.1.1. Математический нейрон Мак-Каллока-Питтса.

- •3.14.1.2. Персептрон Розенблатта и правило Хебба.

- •3.14.1.3. Дельта-правило и распознавание букв.

- •3.14.1.4. Адалайн, мадалайн и обобщенное дельта-правило.

- •§ 3.14.2. Многослойный персептрон и алгоритм обратного

- •§ 3.14.3. Виды активационных функций.

- •Вопросы для самоконтроля

- •Список литературы

- •Основы искусственного интеллекта

3.14.1.3. Дельта-правило и распознавание букв.

Рассмотренный алгоритм обучения персептрона можно представить в более общей форме. Если через d обозначить требуемый выходной сигнал, то на каждой итерации можно рассчитывать разницу между требуемым ответом персептрона d и реальным значением у, вычисляемым на его выходе:

ε=(d-y). (3.4)

Тогда случай ε=0 соответствует шагу 2,а, когда выход правилен; случай ε>0 — шагу 2,б; случай ε< 0 — шагу 2,в.

Идея алгоритма обучения персептрона с помощью правил Хебба сохранится, если итерационный процесс вести по формулам:

wj(t + l)=wj(t) + Δwj; (3.5)

Δwj = εxj, (3.6)

где wj(t) и wj(t + 1) - соответственно старое и новое значения весовых коэффициентов персептрона; j - номер входного сигнала. Кроме того, можно получить аналогичную итерационную формулу для подстройки порогового значения нейрона θ, если учесть, что его можно интерпретировать как вес дополнительного входа х0, значение которого равно -1:

θ(t+1)=θ(t)+Δθ, (3.7)

Δθ=-ε. (3.8)

В итерационные формулы можно ввести коэффициент скорости обучения η, с помощью которого можно управлять величиной коррекции весов:

Δwj = ηεxj, (3.9)

Δθ=-ηε. (3.10)

Алгоритм обучения персептрона с использованием этих формул известен под названием дельта-правила. Дальнейшее развитие идеи персептрона и алгоритмов обучения связано с усложнением его структуры и развитием функциональных свойств.

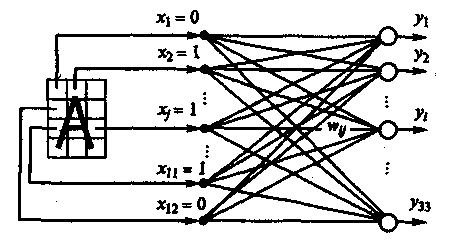

На рис.3.23 приведена схема персептрона, предназначенного для распознавания букв русского алфавита. Такой персептрон имеет 33 нейрона, таким образом, каждой букве алфавита соответствует свой нейрон. Полагается, что выход первого нейрона у1 должен быть равен единице, если персептрону предъявлена буква «А», и нулю для всех остальных букв. Выход второго нейрона у2 должен быть равен единице, если персептрону предъявлена буква «Б», и нулю во всех остальных случаях. И так далее до буквы «Я».

Рис.3.23. Персептрон, предназначенный для распознавания букв

русского алфавита

Алгоритм обучения данного персептрона выглядит следующим образом.

Шаг 1. Датчиком случайных чисел всем весовым коэффициентам wij и пороговым значениям нейронов θi (i= 1,...,33, j=1,...,12) присваиваются некоторые малые значения.

Шаг 2. Персептрону предъявляется какая-либо буква алфавита, и системой фотоэлементов вырабатывается входной вектор хj (j= 1,...,12).

Шаг 3. Каждый нейрон выполняет взвешенное суммирование входных сигналов:

![]()

и вырабатывает выходной сигнал yi= 1, если Si >θi; yi= 0, если Si<θi.

Шаг 4. Для каждого нейрона вычисляется ошибка: εi= (di-yi),

где di - вектор правильных ответов персептрона (например, для буквы «A» d1 =1, d2 = 0, ..., d33 =0 и т.д.).

Шаг 5. Производится корректировка весовых коэффициентов персептрона и пороговых значений нейронов:

wij(t+1) = wij(t) + Δwij; Δwij = ηεixj;

θi(t+1) = θi(t) + Δθi; Δθi=-ηεi,

где t - номер итерации, или эпохи.

Шаг 6. Повторение шагов 2 - 5 необходимое число раз.