- •Информатика Информатика: Учебник / Под ред. Проф. Н.В. Макаровой - м.: Финансы и статистика -2006. - 768 с. Www.Stu.Ru/inform/ Содержание

- •1. Основы информационной культуры

- •1.1. Информатизация общества

- •1.1.1. Представление об информационном обществе Роль и значение информационных революций

- •Как понимают ученые информационное общество

- •1.1.2. Роль информатизации в развитии общества Что такое процесс информатизации общества

- •1.1.3. Опыт информатизации и перспективные идеи

- •1.1.4. Об информационной культуре

- •1.2. Информационный потенциал общества

- •1.2.1 Информационные ресурсы

- •1.2.2. Информационные продукты и услуги

- •Рынок информационных продуктов и услуг

- •История развития рынка информационных услуг

- •1.2.3. Правовое регулирование на информационном рынке

- •1.3. Информатика – предмет и задачи

- •Структура информатики

- •2. Измерение и представление информации

- •2.1. Информация и ее свойства

- •2.1.1. Информация и данные

- •2.1.2. Формы адекватности информации

- •2.1.3. Меры информации Классификация мер

- •Синтаксическая мера информации

- •Семантическая мера информация

- •Прагматическая мера информации

- •Мера информации Единицы измерения

- •Качество информации

- •2.2. Классификация и кодирование информации

- •2.2.1. Система классификации Общие сведения

- •Иерархическая система классификации

- •Фасетная система классификации

- •Дескрипторная система классификации

- •Система кодирования

- •Классификационное кодирование

- •Классификация информации по разным признакам

- •3.Информационные системы и технологии

- •3.1. Информационные системы

- •Общее представление Понятие информационной системы

- •Этапы развития информационных систем

- •Период времени

- •Процессы в информационной системе

- •Что можно ожидать от внедрения информационных систем

- •Роль структуры управления в информационной системе Общие положения

- •Структура управления организацией

- •Персонал организации

- •Прочие элементы организации

- •Примеры информационных систем

- •3.2. Структура и классификация информационных систем

- •Информационное обеспечение

- •Техническое обеспечение

- •Математическое и программное обеспечение

- •Организационное обеспечение

- •Правовое обеспечение

- •Классификация информационных систем по признаку структурированности задач Понятие структурированности задач

- •Классификация информационных систем по функциональному признаку и уровням управления Что означает функциональный признак

- •Типы информационных систем

- •Информационные системы оперативного (операционного) уровня

- •Информационные системы специалистов

- •Информационные системы для менеджеров среднего звена

- •Стратегические информационные системы

- •Прочие классификации информационных систем

- •3.3. Информационные технологии

- •Новая информационная технология

- •Инструментарий информационной технологии

- •Как соотносятся информационная технология и информационная система

- •Составляющие информационной технологии

- •Этапы развития информационных технологий

- •Проблемы использования информационных технологий Устаревание информационной технологии

- •Методология использования информационной технологии

- •Выбор вариантов внедрения информационной технологии в фирме

- •3.4. Виды информационных технологий

- •Основные компоненты

- •Информационная технология управления Характеристика и назначение

- •Основные компоненты

- •Автоматизация офиса Характеристика и назначение

- •Основные компоненты

- •Характеристика и назначение

- •Основные компоненты

- •Характеристика и назначение

- •Основные компоненты

- •4.1. Информационно-логические основы построения

- •4.2. Функционально-cтруктурная организация

- •Основные блоки пк и их назначение

- •Внутримашинный системный интерфейс

- •Функциональные характеристики пк

- •4.3. Микропроцессоры

- •4.4. Запоминающие устройства пк

- •4.5. Основные внешние устройства пк

- •5. Состояние и тенденции развития эвм

- •5.1. Классификация эвм Классификация эвм по принципу действия

- •5.2. Большие эвм

- •5.3. Малые эвм

- •5.4. Персональные компьютеры

- •5.5. Суперэвм

- •5.6. Серверы

- •5.7. Переносные компьютеры

- •5.8. Тенденции развития вычислительных систем

- •6.1. Коммуникационная среда и передача данных назначение и классификация компьютерных сетей

- •Аппаратная реализация передачи данных

- •Звенья данных

- •6.2. Архитектура компьютерных сетей

- •Эталонные модели взаимодействия систем

- •Протоколы компьютерной сети эталонные модели взаимодействия систем

- •Протоколы компьютерной сети

- •6.3. Локальные вычислительные сети

- •Типовые топологии и методы доступа лвс

- •Объединение лвс

- •6.4. Глобальная сеть internet

- •Представление о структуре и системе адресации

- •7. Офисная техника

- •7.1. Классификация офисной техники

- •7.2. Средства изготовления, хранения, транспортирования и обработки документов

- •Организационные автоматы

- •Диктофонная техника

- •Средства хранения документов

- •Средства транспортирования документов

- •Средства обработки документов

- •7.3. Средства копированияи размножения документов

- •Средства копирования документов

- •Средства оперативной полиграфии

- •7.4. Средства административно-управленческой связи

- •Каналы связи

- •Классификация систем административно-управленческой связи

- •Системы передачи недокументированной информации

- •Радиотелефонная связь

- •Системы передачи документированной информации

- •7.5. Компьютерные системы в оргтехнике

- •Системы управления электронными документами

- •Компьютерные системы административно-управленческой связи системы управления электронными документами

- •Компьютерные системы административно-управленческой связи

- •8. Состояние и тенденции развития программного обеспечения

- •Характеристика программного продукта

- •Жизненный цикл программного продукта.

- •Защита программных продуктов. Основные понятия о защите программных продуктов.

- •8.2. Классификация программных продуктов.

- •Системное программное обеспечение.

- •Минимальный состав системного программного обеспечения современных персональных компьютеров.

- •Инструментарий технологии программирования.

- •Средства для создания приложений.

- •Пакеты прикладных программ.

- •Проблемно-ориентированные ппп.

- •Ппп автоматизированного проектирования.

- •Офисные ппп.

- •Операционные системы windows 95 и windows 98

- •Требования к аппаратной части

- •32-Разрядная архитектура

- •Вытесняющая многозадачность и многопоточность

- •Графический пользовательский интерфейс

- •Подключение новых периферийных устройств по технологии Plug and Play

- •Использование виртуальной памяти

- •Совместимость с ранее созданным программным обеспечением

- •Наличие коммуникационных программных средств

- •Сетевые средства операционной системы Windows 95 позволяют:

- •Наличие средств мультимедиа

- •Концепция операционной системы windows 98

- •Интеграция с глобальной сетью Интернет

- •Повышение надежности и качества управления

- •Повышение производительности

- •12.2. Объектно - ориентированная платформа windows

- •Объекты файловой системы - файл и папка Объект - файл

- •Объект - папка

- •Назначение ярлыка

- •Иерархическая структура подчиненности папок

- •Объекты пользовательского уровня - приложение и документ

- •Пользовательский графический интерфейс windows Основные понятия

- •Формы указателя мыши при работе с объектами

- •Окна приложения и документа

- •Диалоговое окно

- •Назначение Рабочего стола

- •12.3. Организация обмена данными

- •Понятие составного документа

- •Обмен данными перетаскиванием объекта мышью

- •Обмен данными через буфер Роль буфера обмена

- •Технология обмена данными через буфер

- •Технология внедрения и связывания объектов ole

- •Внедрение объекта

- •Связывание объекта

- •Программа работы с изображениями Imaging.

- •Комплекс программ мультимедиа Развлечения

- •Комплекс программ Связь

- •Стандартные приложения служебного назначения

- •Очистка диска

- •Проверка диска

- •Дефрагментация диска

- •Мастер обслуживания дисков

2.1.2. Формы адекватности информации

Адекватность информации может выражаться в трех формах: семантической, синтаксической, прагматической.

Синтаксическая адекватность.Она отображает формально-структурные характеристики информации и не затрагивает ее смыслового содержания. На синтаксическом уровне учитываются тип носителя и способ представления информации, скорость передачи и обработки, размеры кодов представления информации, надежность и точность преобразования этих кодов и т.п. Информацию, рассматриваемую только с синтаксических позиций, обычно называют данными, так как при этом не имеет значения смысловая сторона. Эта форма способствует восприятию внешних структурных характеристик, т.е. синтаксической стороны информации.

Семантическая (смысловая) адекватность.Эта форма определяет степень соответствия образа объекта и самого объекта. Семантический аспект предполагает учет смыслового содержания информации. На этом уровне анализируются те сведения, которые отражает информация, рассматриваются смысловые связи. В информатике устанавливаются смысловые связи между кодами представления информации. Эта форма служит для формирования понятий и представлений, выявления смысла, содержания информации и ее обобщения.

Прагматическая (потребительская) адекватность.Она отражает отношение информации и ее потребителя, соответствие информации цели управления, которая на ее основе реализуется. Проявляются прагматические свойства информации только при наличии единства информации (объекта), пользователя и цели управления. Прагматический аспект рассмотрения связан с ценностью, полезностью использования информации при выработке потребителем решения для достижения своей цели. С этой точки зрения анализируются потребительские свойства информации. Эта форма адекватности непосредственно связана с практическим использованием информации, с соответствием ее целевой функции деятельности системы.

2.1.3. Меры информации Классификация мер

Для измерения информации вводятся два параметра: количество информации Iи объем данныхVд.

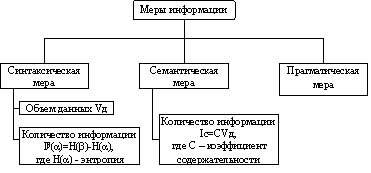

Эти параметры имеют разные выражения и интерпретацию в зависимости от рассматриваемой формы адекватности. Каждой форме адекватности соответствует своя мера количества информации и объема данных (рис. 2.1).

Рис. 2.1. Меры информации

Синтаксическая мера информации

Эта мера количества информации оперирует с обезличенной информацией, не выражающей смыслового отношения к объекту.

Объем данных Vд.в сообщении измеряется количеством символов (разрядов) в этом сообщении. В различных системах счисления один разряд имеет различный вес и соответственно меняется единица измерения данных:

в двоичной системе счисления единица измерения - бит (bit - binary digit -двоичный разряд);

Примечание.В современных ЭВМ наряду с минимальной единицей измерения данных "бит" широко используется укрупненная единица измерения "байт", равная 8 бит.

в десятичной системе счисления единица измерения -дит (десятичный разряд).

Пример 2.3.Сообщение в двоичной системе в виде восьмиразрядного двоичного кода 10111011 имеет объем данныхVд=8 бит.

Сообщение в десятичной системе в виде шестиразрядного числа 275903 имеет объем данных Vд=6 дит.

Количество информации -на синтаксическом уровне невозможно определить без рассмотрения понятия неопределенности состояния системы (энтропии системы). Действительно, получение информации о какой-либо системе всегда связано с изменением степени неосведомленности получателя о состоянии этой системы. Рассмотрим это понятие.

Пусть до получения информации потребитель имеет некоторые предварительные (априорные) сведения о системе a. Мерой его неосведомленности о системе является функция H(a), которая в то же время служит и мерой неопределенности состояния системы.

После получения некоторого сообщения b получатель приобрел некоторую дополнительную информацию Ib(a), уменьшившую его априорную неосведомленность так, что апостериорная (после получения сообщения b) неопределенность состояния системы стала Hb(a).

Тогда количество информации Ib(a) о системе, полученной в сообщении b, определится как

Ib(a)=H(a)-Hb(a),

т.е. количество информации измеряется изменением (уменьшением) неопределенности состояния системы.

Если конечная неопределенность Hb(a) обратится в нуль, то первоначальное неполное знание заменится полным знанием и количество информации Ib(a)=H(a). Иными словами, энтропия системы H(a) может рассматриваться как мера недостающей информации.

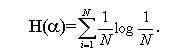

Энтропия системы H(a), имеющая N возможных состояний, согласно формуле Шеннона, равна:

где Рi -вероятность того, что система находится в i-м состоянии.

Для случая, когда все состояния системы равновероятны, т.е. их вероятности равны Pi=1/N, ее энтропия определяется соотношением

Часто информация кодируется числовыми кодами в той или иной системе счисления, особенно это актуально при представлении информации в компьютере. Естественно, что одно и то же количество разрядов в разных системах счисления может передать разное число состояний отображаемого объекта, что можно представить в виде соотношения

N=mn,

где N-число всевозможных отображаемых состояний;

т -основание системы счисления (разнообразие символов, применяемых в алфавите);

п -число разрядов (символов) в сообщении.

Пример 2.4.Но каналу связи передается n-разрядное сообщение, использующеет различных символов. Так как количество всевозможных кодовых комбинаций будетN=mn,то при равновероятности появления любой из них количество информации, приобретенной абонентом в результате получения сообщения, будетI=logN=logm - формула Хартли.

Если в качестве основания логарифма принять т,тоI=n.В данном случае количество информации (при условии полного априорного незнания абонентом содержания сообщения) будет равно объему данныхI=Vд,полученных по каналу связи. Для неравновероятных состояний системы всегдаI<Vд=n.

Наиболее часто используются двоичные и десятичные логарифмы. Единицами измерения в этих случаях будут соответственно бит и дит.

Коэффициент (степень) информативности(лаконичность) сообщения определяется отношением количества информации к объему данных, т.е.

причем

0<Y<1

причем

0<Y<1

С увеличением Yуменьшаются объемы работы по преобразованию информации (данных) в системе. Поэтому стремятся к повышению информативности, для чего разрабатываются специальные методы оптимального кодирования информации.