- •ВВЕДЕНИЕ. ОБЩИЕ СРЕДСТВА МАТЕМАТИЧЕСКОГО ОПИСАНИЯ СИСТЕМ

- •ТЕМА 1. ОСНОВЫ ТЕОРИИ МНОЖЕСТВ

- •1.1. Основные понятия и определения

- •1.2. Операции над множествами

- •1.3. Законы и тождества алгебры множеств

- •1.4. Принцип двойственности

- •1.5. Уравнение с множествами

- •1.6. Упорядоченное множество. Прямое произведение множеств

- •1.7. Соответствия

- •1.8. Отображения и их виды

- •1.9. Отношения и их свойства

- •1.10. Виды отношений

- •1.11. Нечёткие множества. Способы задания. Понятие лингвистической переменной

- •1.12. Операции над нечёткими множествами

- •1.13. Параметры нечётких множеств

- •1.14. Методы дефаззификации нечётких множеств

- •ТЕМА 2. ЭЛЕМЕНТЫ ТЕОРИИ ГРАФОВ И ЕЕ ПРИЛОЖЕНИЯ

- •2.1. Основные понятия и определения. Способы задания графов

- •2.2. Типы графов

- •2.4. Числовая функция на графе. Сигнальные графы

- •2.5. Правило Мэзона

- •2.6. Операции над графами

- •2.7. Задача о кратчайшем пути связного неориентированного графа

- •2.8. Деревья. Символ дерева

- •2.9. Покрывающее дерево связного графа. Экстремальное дерево

- •2.10. Корневые деревья. Код дерева

- •ТЕМА 3. ТРАНСПОРТНЫЕ СЕТИ

- •3.1. Основные понятия и определения

- •3.2. Задача о максимальном потоке. Алгоритм Форда-Фалкерсона

- •3.3. Транспортная задача

- •ТЕМА 4. СЕТИ ПЕТРИ

- •4.1. Особенности сетей Петри и области их применения

- •4.2. Основные определения. Способы задания сетей Петри

- •4.3. Функционирование сетей Петри

- •4.4. Свойства сетей Петри

- •4.5. Анализ сетей Петри

- •4.6. Подклассы и расширения сетей Петри

- •5.1. Основные понятия алгебры логики

- •5.2. Элементарные булевы функции

- •5.3. Полнота системы булевых функций

- •5.4. Законы и тождества алгебры логики

- •5.6. Минимизация функций алгебры логики

- •5.8. Синтез комбинационных схем

- •5.9. Понятие о конечных автоматах и способы их задания

- •5.10. Синтез конечных автоматов

- •6.1. Временное представление сигналов. Классификация сигналов

- •6.2. Спектральное представление сигналов. Разложение произвольного сигнала по заданной системе функций

- •6.3. Гармонический анализ периодических сигналов

- •6.4. Комплексная форма ряда Фурье

- •6.6. Свойства преобразование Фурье

- •6.7. Представление сигналов в виде ряда Котельникова

- •6.8. Корреляционный анализ детерминированных сигналов

- •6.10. Частотный спектр АМ сигнала

- •6.11. Основные вероятностные характеристики случайных сигналов

- •6.12. Спектральные плотности стационарных случайных процессов

- •ТЕМА 7. МАТЕМАТИЧЕСКОЕ ОПИСАНИЕ ЛИНЕЙНЫХ СИСТЕМ И ИХ ЭЛЕМЕНТОВ С ПОСТОЯННЫМИ ПАРАМЕТРАМИ

- •7.1. Классификация элементов

- •7.2. Уравнения динамики и статики

- •7.3. Понятие передаточной функции

- •7.4. Передаточные функции различных соединений звеньев

- •7.5. Временные характеристики систем и их элементов

- •7.6. Понятие о частотных характеристиках систем и их элементов

- •7.7. Понятие о логарифмических частотных характеристиках

- •7.8. Построение логарифмических частотных характеристик разомкнутых одноконтурных систем

- •7.9. Математические модели элементов в параметрах пространства состояний

- •7.10. Решение уравнений состояния первого порядка

- •7.11. Представление уравнений состояния при помощи матриц

- •7.14. Каноническая форма уравнений состояния

- •7.15. Понятие об устойчивости линейных систем

- •7.16. Математическое описание дискретных систем и их элементов

- •7.17. Уравнения состояния и моделирование дискретных систем

- •ЛИТЕРАТУРА

В соответствии с изменением амплитуды изменяется и средняя за период высокой частоты мощность модулированного сигнала, которая пропорциональна среднему квадрату амплитуды

Произведено усреднение по времени. Эта мощность в (1+0,5m2) раз превышает мощность несущего сигнала. При 100% модуляции

средняя

средняя

мощность составит 1,5P0 , где

– мощность несущего сигнала.

– мощность несущего сигнала.

Среднее значение

за период модулирующей функции равно нулю, с среднее значение

за период модулирующей функции равно нулю, с среднее значение

равно 0,5.

равно 0,5.

При передаче дискретных сообщений модулированный сигнал имеет вид, показанный на рис. 6.29.

S (t) |

|

|

|

|

t |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

T

a (t )

Рис. 6.29

Такие сигналы называются радиоимпульсами. Фазы высокочастотного заполнения от импульса к импульсу не изменяются.

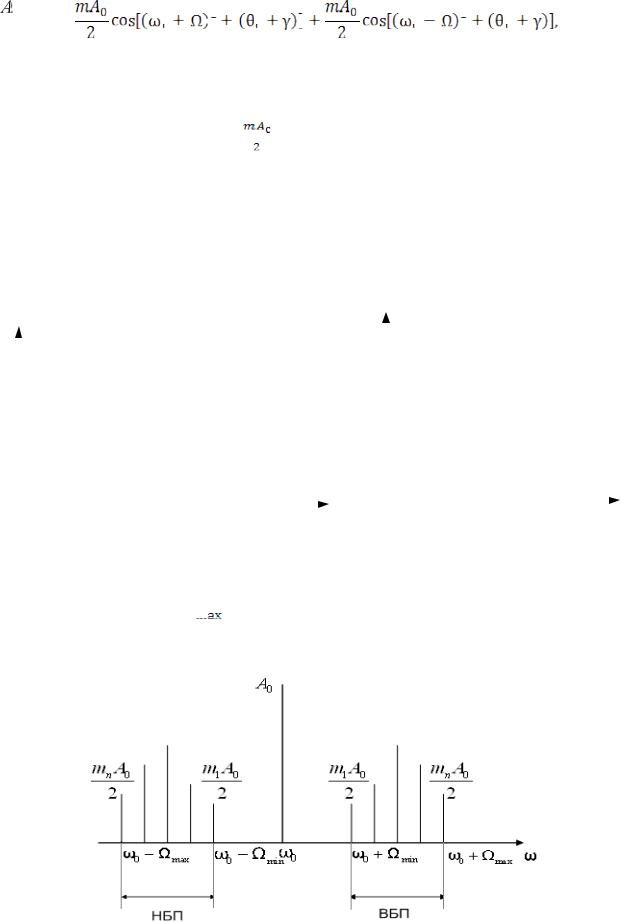

6.10. Частотный спектр АМ сигнала

Установим связь между спектром АМ сигнала и спектром модулирующей функции S(t). Подставим (6.24) в (6.23), тогда

Первое слагаемое в (6.25) – это исходный высокочастотный немодулированный сигнал с частотой  . Второе слагаемое, являющееся продуктом модуляции, можно представить в виде суммы

. Второе слагаемое, являющееся продуктом модуляции, можно представить в виде суммы

121

где слагаемые соответствуют новым гармоническим колебаниям, появляющимся в процессе модуляции амплитуды.

Частоты

и

и

называют верхней и нижней боковыми часто-

называют верхней и нижней боковыми часто-

тами модуляции. Амплитуды |

|

этих колебаний одинаковы, а их фазы сим- |

|

метричны относительно фазы несущего сигнала. Спектр показан на рис. 6.30. Ширина спектра равна удвоенной частоте модуляции

, а амплитуды не превышают половины амплитуды

, а амплитуды не превышают половины амплитуды  .

.

Аналогичные результаты можно получить при модуляции любым сложным сигналом.

Пусть модулирующая функция

имеет спектр, представленный на рис. 6.31.

имеет спектр, представленный на рис. 6.31.

|

|

|

|

|

|

|

|

S(Ω) |

|

|

|

S3 |

|||

|

|

|

|

|

|

|

|

||||||||

|

mA |

|

|

mA0 |

|

|

S2 |

|

Sn |

||||||

|

|

|

|

|

|

||||||||||

|

|

|

|

|

|

||||||||||

|

|

|

|

S1 |

|

|

|||||||||

|

|

|

|

|

|

||||||||||

|

0 |

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

2 |

|

|

|

|

|

|

|

|

|

|

|

2 |

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Ωmin |

Ωmax |

Ω |

Рис. 6.30 |

Рис. 6.31 |

|

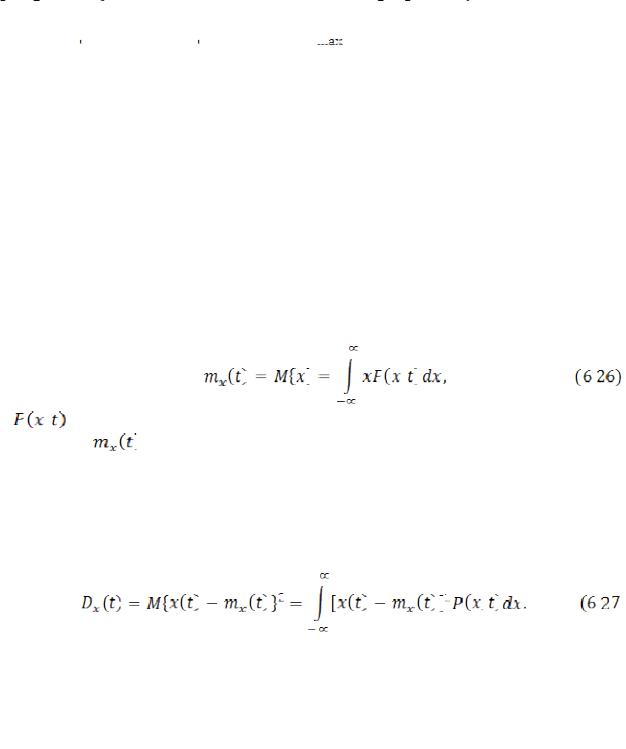

Здесь  – амплитуды гармонических составляющих, входящих в спектр сигнала

– амплитуды гармонических составляющих, входящих в спектр сигнала

;

;  и

и  – граничные частоты спектра. Для определения спектра АМ сигнала достаточно сместить на

– граничные частоты спектра. Для определения спектра АМ сигнала достаточно сместить на спектр огибающей амплитуд, как показано на рис. 6.32.

спектр огибающей амплитуд, как показано на рис. 6.32.

Рис. 6.32

122

Спектр сигнала содержит кроме основной составляющей верхнюю и нижнюю боковые полосы частот(ВБП и НБП). Коэффициенты модуляции  ,

,  , …,

, …,  пропорциональны амплитудам

пропорциональны амплитудам  ,

,  , …,

, …,  соответствующих гармоник, входящих в состав функции

соответствующих гармоник, входящих в состав функции

. Ширина спектра определяется величиной

. Ширина спектра определяется величиной

.

.

6.11. Основные вероятностные характеристики случайных сигналов

Случайными называются сигналы, значения которых не могут быть предсказаны с вероятностью единица в каждый момент времени. Это могут быть различные помехи и возмущения, такие как колебания параметров источников питания, шумы элементов устройств, внешние помехи и т. д. Будем рассматривать случайные сигналы, как случайные функции времени

. Их называют стохастическими процессами.

. Их называют стохастическими процессами.

Существует ряд вероятностных характеристик, по которым можно отличить один случайный процесс от другого.

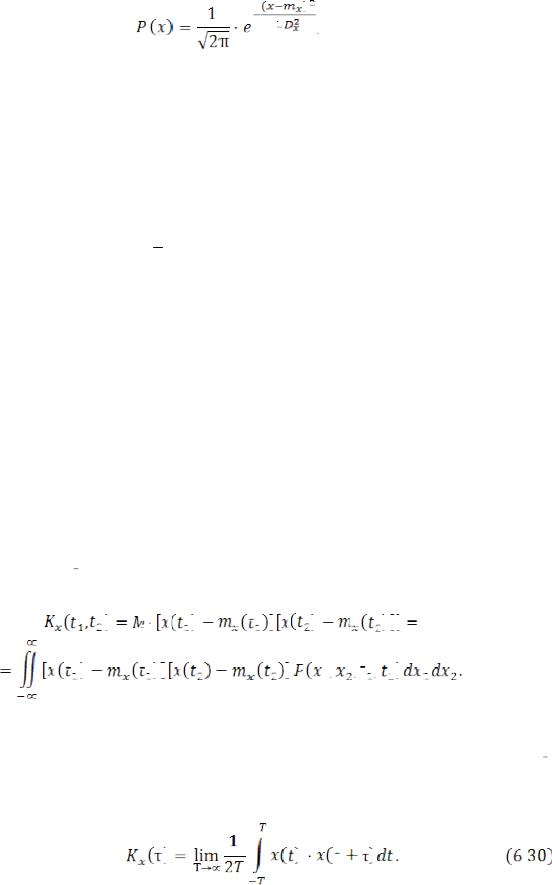

1. Математическое ожидание (первый момент М) случайного процесса это неслучайная функция, определяемая выражением

где |

– закон распределения случайного процесса. |

|

|

Кривая |

является некоторой средней кривой, относительно которой |

колеблются значения случайной функции. Математическое ожидание служит теоретической оценкой среднего по множеству значения случайной величины, которое определяется на основании множества наблюдений над множеством однотипных систем, находящихся в одинаковых условиях.

2. Дисперсия случайной функции Dx определяется выражением

Это неслучайная функция, равная математическому ожиданию от квадрата отклонения случайной функции от её среднего значения.

– усреднённая мера отклонения случайной функции от её математического ожидания. Дисперсия определяет полосу рассеяния для реализации случайной функции. Величина

– усреднённая мера отклонения случайной функции от её математического ожидания. Дисперсия определяет полосу рассеяния для реализации случайной функции. Величина

носит название среднеквадратического отклонения.

носит название среднеквадратического отклонения.

Случайные процессы делят настационарные и нестационарные. Случайный процесс называется стационарным, если его вероятностные характеристики не изменяются во времени. Математическое ожидание и дисперсия стационарного случайного процесса равны постоянным величинам.

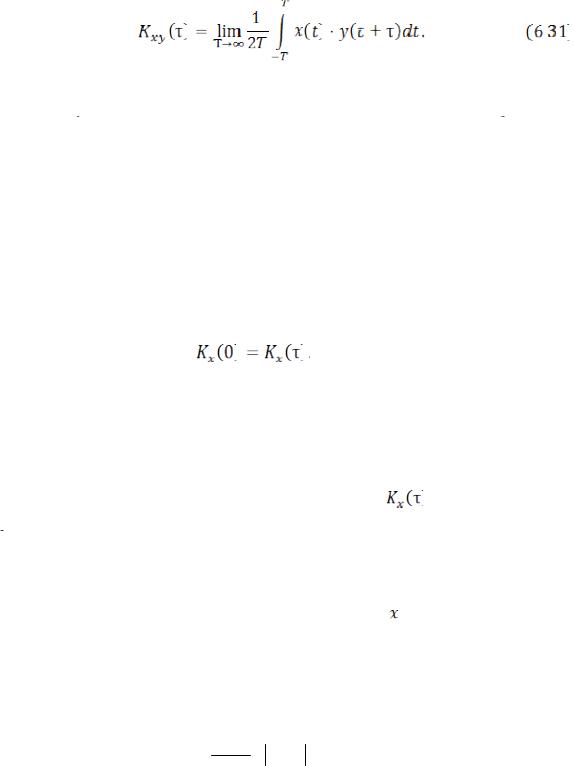

Встречающиеся в большинстве практических задач случайные функции имеют нормальный или Гауссов закон распределения, для которого

123

(6.28)

где  – математическое ожидание;

– математическое ожидание;  – дисперсия случайной функции. Математическое ожидание

– дисперсия случайной функции. Математическое ожидание

было определено как среднее по мно-

было определено как среднее по мно-

жеству значение случайной функции

.

.

Существует также понятие среднего по времени значения случайной функции. Оно определяется на основании наблюдения за одной и той же системой на протяжении достаточно длительного времени Т. Эти средние обозначаются прямой чертой и определяются выражением:

|

|

|

1 |

T |

|

x |

= |

lim |

ò x(t)dt . |

||

|

|||||

|

|||||

|

|

T ®¥ 2T |

-T |

||

Вообще величины средние по множеству и по времени различны, но существуют случайные процессы, для которых доказана эргодическая теорема:

Любая статистическая характеристика, полученная усреднением по множеству с вероятностью сколь угодно близкой к единице, совпадает с характеристикой, усреднённой по времени.

Эта теорема доказана не для всех стационарных процессов, однако её применяют к большинству стационарных процессов с нормальным или гауссовым законом распределения.

3. Корреляционные функции случайных процессов. Корреляционная функция характеризует степень взаимосвязи значений случайной функции в различные моменты времени. Корреляционная функция связывает между собой отклонения случайной функции от её математического ожидания при двух значениях аргумента

и

и  и равна математическому ожиданию произведения этих отклонений.

и равна математическому ожиданию произведения этих отклонений.

(6.29)

Корреляционная функция стационарного случайного процесса зависит только от одной переменной– разности двух моментов времени

. Формула (6.29) определена на основании понятия среднего по множеству. В соответствии с эргодической теоремой корреляционная функция может быть определена как среднее по времени

. Формула (6.29) определена на основании понятия среднего по множеству. В соответствии с эргодической теоремой корреляционная функция может быть определена как среднее по времени

Это выражение используется наиболее часто. Для оценки связи двух случайных процессов

и

и

вводится взаимная корреляционная функция

вводится взаимная корреляционная функция

124

Для статистически независимых процессовx и  взаимно-корреляци- онная функция

взаимно-корреляци- онная функция

. Однако обратный вывод о том, что если

. Однако обратный вывод о том, что если

, то процессы независимы, справедлив лишь в отдельных случаях, например для процессов с нормальным законом распределения. Общей силы обратный вывод не имеет.

, то процессы независимы, справедлив лишь в отдельных случаях, например для процессов с нормальным законом распределения. Общей силы обратный вывод не имеет.

Основные свойства автокорреляционных функций

1. Автокорреляционная функция

|

|

1 |

T |

Kx (t) = |

lim |

|

ò x(t) × x(t + t)dt |

|

|||

|

T ®¥ 2T |

-T |

|

является убывающей функцией, значение которой при любом  не может превышать её начального значения.

не может превышать её начального значения.

2. Начальное значение автокорреляционной функции равно дисперсии случайного процесса

и характеризует мощность флуктуационной составляющей эргодического процесса.

и характеризует мощность флуктуационной составляющей эргодического процесса.

3.Автокорреляционная функция является чётной, т. е.

.

.

4.Типичная корреляционная функция стационарного случайного процес-

са может быть аппроксимирована выражением

, где

, где

– параметр затухания.

– параметр затухания.

5. Если случайная функция имеет периодическую составляющую, то корреляционная функция также содержит периодическую составляющую той же частоты.

6. Чем слабее взаимосвязь между предыдущими  и последующими

и последующими

значениями случайного процесса, тем быстрее убывает корреляционная функция.

значениями случайного процесса, тем быстрее убывает корреляционная функция.

Числовой характеристикой, служащей для оценки скорости изменения реализаций случайного процесса, является интервал корреляции

1 ¥

tk = K (0) ò0 K (t) dt.

Вероятностный прогноз случайного процесса возможен на время  (если известна информация о поведении какой-либо реализации в прошлом). Осуществлять прогноз на время, большее, чем

(если известна информация о поведении какой-либо реализации в прошлом). Осуществлять прогноз на время, большее, чем  нельзя, так как мгновенные значения, столь далеко отстоящие во времени

нельзя, так как мгновенные значения, столь далеко отстоящие во времени

практически некоррелированы, т. е. среднее значение произведения

практически некоррелированы, т. е. среднее значение произведения

стремится к нулю.

стремится к нулю.

125