- •Этапы формирования сигнала в аналоговой системе радиосвязи

- •Кодирование канала:

- •Цифровая модуляция (манипуляция)

- •Спектр периодического сигнала

- •Спектр последовательности прямоугольных импульсов

- •Спектр периодического сигнала линейчатый, состоит из отдельных гармоник Спектр непериодического сигнала конечной длительности

- •Спектр произведения сигналов

- •Примеры плотностей распределения вероятностей

- •Понятие белого шума

- •Понятие модуляции

- •Импульсная модуляция

- •Импульсно-кодовая модуляция (икм)

- •Примеры кодов канала

- •Коды 4, 5, 6 с возвратом к нулю (rz).

- •Аналоговая амплитудная модуляция

- •Угловая модуляция

- •Примеры сигналов с угловой модуляцией

- •Примеры частотных детекторов

- •Квадратурный детектор сигналов с угловой модуляцией

- •Примеры противоположных и ортогональных сигналов

- •Понятие согласованного фильтра

- •Фильтр, согласованный с прямоугольным импульсом

- •Некогерентная демодуляция в системе с двоичной частотной манипуляцией

- •Частотная манипуляция с минимальным частотным сдвигом

- •Модулятор системы с минимальным частотным сдвигом

- •Когерентная демодуляция сигналов с мчс

- •Оценка частотной полосы сигнала в системах bpsk, qpsk, msk, fsk по ширине первого лепестка спектра

- •Модуляция с минимальным частотным сдвигом и гауссовой фильтрацией (gmsk)

- •Теорема Котельникова

- •Синусоида как сумма функций Котельникова при двух отсчетах на периоде:

- •Требования к частотной характеристике цифрового канала связи

- •Основные показатели эффективности цифровой системы связи

- •Вероятность битовой ошибки рb

- •Максимальная пропускная способность канала

- •Расширение спектра прямой последовательностью

- •Оценка корректирующей способности кода

- •Перемешивание символов

- •Пример блочного перемешивания

- •Принцип формирования линейного блокового кода Порождающая и проверочная матрицы

- •Принцип формирования циклического кода Представление двоичного слова многочленом

- •Порождающая матрица циклического кода:

- •Формирование сигналов в системе сотовой связи gsm

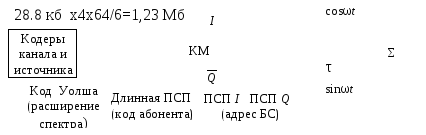

- •Формирование сигналов системы связи стандарта is-95

- •Теоремы Шеннона о кодировании

- •Эффективное кодирование

- •Кодируем блоки из трех знаков

- •Кодирование звуковых сигналов

- •Кодирование спектра сигнала

- •Основные причины искажения сигналов

- •Основные проявления замираний

- •Временное рассеяние делает ачх неравномерной:

- •Характеристики замираний

- •Средства борьбы с замираниями

Формирование сигналов системы связи стандарта is-95

Прямой канал (БС– МС)

Модуляция – квадратурная

Обратный канал (МС– БС)

Модуляция – квадратурная со сдвигом

Последовательности Уолша – ортогональные сигналы

Сигналы обратного канала трафика системы связи стандарта IS-95

Управление доступом к каналу связи

В системах с предоставлением канала по требованию возникает конфликтная ситуация при одновременном обращении нескольких абонентов к каналу связи. Сигналы, поступающие от разных источников, искажаются вследствие взаимного наложения.

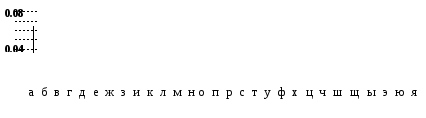

Оценка эффективности системы АЛОХА (доступ не контролируется)

Предполагается, что сообщения передаются пакетами

Вероятность появления k пакетов за интервал времени τ

![]()

λ– средняя частота поступления пакетов.

Пакет будет успешно передан, если на периоде уязвимости 2 τ не будет других обращений к каналу. Вероятность успешной передачи,

![]() где

где

G = λτ – среднее число пакетов, поступающих за интервал времени τ,

S

– среднее число успешных передач за τ.

![]()

maxS

= 1/(2e)

≈ 0,187 при

![]() т.е. приG

= 0,5.

т.е. приG

= 0,5.

Пропускная способность систем с управляемым доступом

Управление доступом в системе IS-95

Передачу начинают: в синхронной системае сразу после синхросигнала, в синхронной с контролем несущей–при свободном эфире, в ненастойчивой – через случайное время.

Понятие количества информации

Характеристика источника информации

x1, x2,…, xm – набор знаков (алфавит Х объема m),

pi – вероятности появления знаков (i =1,..., m).

Количество информации, приходящейся в среднем на один знак алфавита источника:

![]() .

.

Единицей информации считается «бит» – энтропия источника с двумя равновероятными знаками x1, x2 :

![]() (бит).

(бит).

При равных вероятностях знаков энтропия источника максимальна

![]()

Если 32 буквы русского алфавита считать равновероятными, Н = log232= 5.

Если учесть частоту появления букв в тексте, Н » 4,42.

Если учесть корреляцию соседних букв, Н » 3,53.

Если учесть дальние связи букв между словами, Н » 1,5.

Производительность источника, выдающего знаки со скоростью Vи= 1/τи (τи – длительность одного знака) – это количество информации, выдаваемое в единицу времени:

![]()

Теоремы Шеннона о кодировании

Существует способ кодирования, позволяющий передать всю информацию источника по каналу без помех, если выполняется условие:

Vslog2m > VbH(X)

(пропускная способность канала выше производительности источника).

Vs – скорость передачи канальных символов,

m – объем алфавита символов,

Vb– скорость выдачи знаков источником,

H(X)–энтропия источника (количество информации на один знак).

При высокой скорости выдачи знаков источником в них может быть мало информации. Надо кодировать канальными символами равновероятные последовательности знаков источника. Тогда на каждый символ будет приходиться максимальное количество информации.

Существует способ кодирования, позволяющий передать всю информацию источника по каналу с помехами со сколь угодно малой вероятностью ошибок, если пропускная способность канала С выше производительности источника: С > VbH(X)

Согласно теореме Шеннона – Хартли, пропускная способность канала

![]()

F – ширина полосы пропускания канала (F = 1/Vs),

S – средняя мощность сигнала,

N – средняя мощность шума,

Eb– энергия, приходящаяся на один бит,

Rb– битовая скорость,

N0 – спектральная плотность мощности шума.

При m = 1 + S/N «расстояние» между сигналами, соответствующими разным символам, сравнимо с уровнем шума, так что вероятность символьной ошибки очень велика. Однако, применяя помехоустойчивое кодирование, можно исправить большинство ошибок.

Есть ограничение на скорость, но не на точность передачи информации.