- •Методы обработки экспериментальных данных

- •Введение

- •1.1. Введение

- •Области применения анализа экспериментальных данных

- •1.2. Основные этапы анализа данных

- •1.3. Структуры данных

- •1.3. Структуры данных

- •1.3. Структуры данных

- •1.4. Что такое переменная?

- •1.4. Что такое переменная?

- •1.4. Что такое переменная?

- •1.5. Основные законы распределения случайных величин и их назначение

- •1.5. Основные законы распределения случайных величин и их назначение

- •1.5. Основные законы распределения случайных величин и их назначение

- •1.5. Основные законы распределения случайных величин и их назначение

- •1.5. Основные законы распределения случайных величин и их назначение

- •1.5. Основные законы распределения случайных величин и их назначение

- •1.5. Основные законы распределения случайных величин и их назначение

- •1.6. Краткий обзор современных программных средств для проведения анализа данных.

- •1.6. Краткий обзор современных программных средств для проведения анализа данных.

- •1.6. Краткий обзор современных программных средств для проведения анализа данных.

- •1.6. Краткий обзор современных программных средств для проведения анализа данных.

- •1.6. Краткий обзор современных программных средств для проведения анализа данных.

- •Вопросы ?

- •КЛАССИФИКАЦИЯ В РАСПОЗНАВАНИИ ОБРАЗОВ

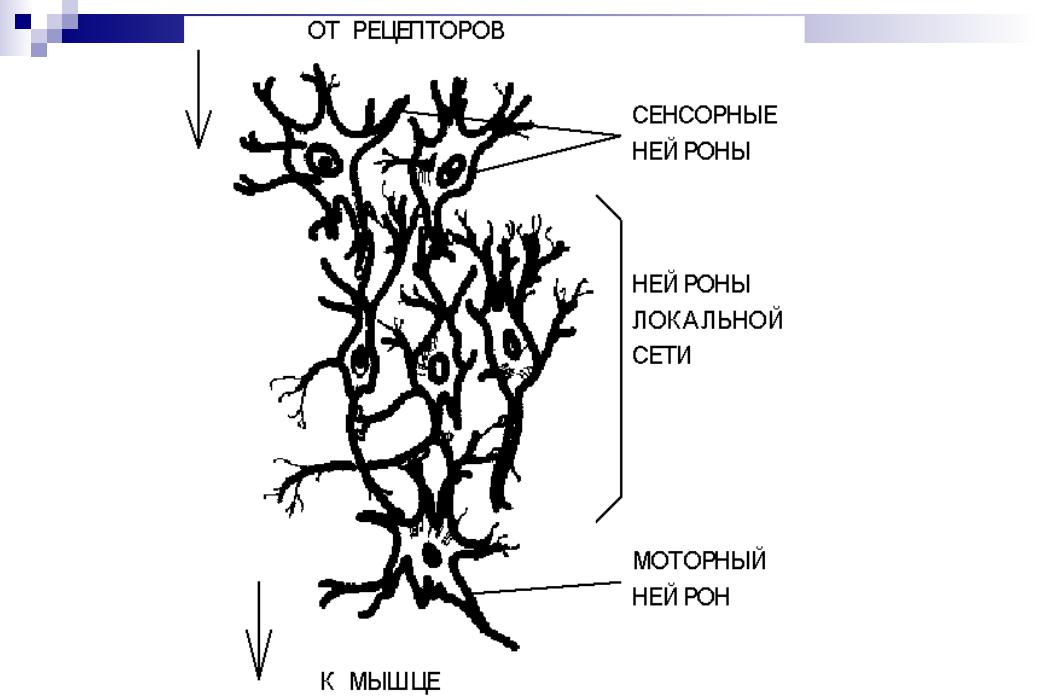

- •Схема системы распознавания

- •Байесовская теория принятия решений при дискретных признаках

- •Байесовская теория принятия решений при дискретных признаках

- •Байесовская теория принятия решений при дискретных признаках

- •Байесовская теория принятия решений при непрерывных признаках

- •Байесовская теория принятия решений при непрерывных признаках

- •Идеи классификации

- •Идеи классификации

- •Идеи классификации

- •Идеи классификации

- •Прямые методы восстановления решающей функции

- •НЕЙРОННЫЕ СЕТИ: еще один подход к классификации

- •Интересные данные

- •Персептроны

- •Формальный нейрон

- •Нелинейное преобразование

- •Перцептрон Розенблата

- •Обучение сети

- •Обучение перцептрона

- •STATISTICA Neural Networks

- •ВОПРОСЫ ?

- •ПЛАНИРОВАНИЕ

- •Что такое планирование эксперимента

- •Эксперименты в науке и промышленности

- •Общие идеи

- •Общие идеи

- •Общие идеи

- •Общие идеи

- •Что такое планирование эксперимента

- •Построение линейной статической модели объекта

- •Построение линейной статической модели объекта

- •Построение линейной статической модели объекта

- •Крутое восхождение по поверхности

- •Полный факторный эксперимент

- •Полный факторный эксперимент

- •Дробные реплики

- •Насыщенные планы. Симплекс

- •Насыщенные планы. Симплекс

- •Насыщенные планы. Планы Плаккета – Бермана

- •Разбиение матрицы планирования на блоки

- •Разбиение матрицы планирования на блоки

- •Разбиение матрицы планирования на блоки

- •Обработка результатов эксперимента

- •Обработка результатов эксперимента

- •Обработка результатов эксперимента

- •Обработка результатов эксперимента

- •Ортогональное планирование второго порядка

- •Ортогональное планирование второго порядка

- •Ортогональное планирование второго порядка

- •Ротатабельное планирование

- •Метод случайного баланса

- •Метод случайного баланса

- •ВОПРОСЫ ?

- •МЕТОДЫ

- •Оценивание функционалов

- •Оценивание функционалов

- •Простейшие оценки функции и плотности распределения вероятности

- •Простейшие оценки функции и плотности распределения вероятности

- •Простейшие оценки функции и плотности распределения вероятности

- •Простейшие оценки функции и плотности распределения вероятности

- •Полиграммы

- •Полиграммы

- •Метод "К ближайших соседей"

- •Оценка Розенблатта – Парзена

- •Оценка Розенблатта – Парзена

- •Оценка Розенблатта – Парзена

- •Оценка условной плотности вероятности

- •Оценка регрессии

- •Оценка регрессии

- •Оценка регрессии

- •Оценка регрессии

- •Оценка регрессии

- •Робастные оценки регрессии

- •Робастные оценки регрессии

- •Робастные оценки регрессии

- •Адаптивное управление при априорной неопределенности

- •ВОПРОСЫ ?

- •ДИСПЕРСИОННЫЙ

- •Постановка проблемы

- •Однофакторный дисперсионный анализ

- •Однофакторный дисперсионный анализ

- •Однофакторный дисперсионный анализ

- •Двухфакторный дисперсионный анализ

- •Двухфакторный дисперсионный анализ

- •Двухфакторный дисперсионный анализ

- •Двухфакторный дисперсионный анализ

- •Планирование эксперимента при дисперсионном анализе

- •Планирование эксперимента при дисперсионном анализе

- •Планирование эксперимента при

- •Планирование эксперимента при дисперсионном анализе

- •ВОПРОСЫ ?

- •АНАЛИЗ ТРЕНДОВ И ВРЕМЕННЫХ РЯДОВ

- •Введение

- •Введение

- •Анализ трендов и сезонности

- •Анализ трендов и сезонности

- •Анализ трендов и сезонности

- •Анализ трендов и сезонности

- •Анализ трендов и сезонности

- •Анализ трендов и сезонности

- •Анализ трендов и сезонности

- •Анализ трендов и сезонности

- •Моделирование циклического поведения с помощью ARIMA-процессов Бокса-Дженкинса

- •Моделирование циклического поведения с помощью ARIMA-процессов Бокса-Дженкинса

- •Моделирование циклического поведения с помощью ARIMA-процессов Бокса-Дженкинса

- •Моделирование циклического поведения с помощью ARIMA-процессов Бокса-Дженкинса

- •Моделирование циклического поведения с помощью ARIMA-процессов Бокса-Дженкинса

- •Моделирование циклического поведения с помощью ARIMA-процессов Бокса-Дженкинса

- •Моделирование циклического поведения с помощью ARIMA-процессов Бокса-Дженкинса

- •ВОПРОСЫ ?

- •ИДЕНТИФИКАЦИЯ СТАТИЧЕСКИХ МОДЕЛЕЙ

- •Общие понятия

- •Постановка задачи подстройки параметров нелинейных моделей

- •Критерий наименьших квадратов

- •Критерий наименьших квадратов

- •Метод наименьших квадратов при линейной параметризации модели

- •Метод наименьших квадратов при линейной параметризации модели

- •Метод последовательной линеаризации при подстройке параметров на основе критерия

- •Робастные оценки параметров

- •Простейший адаптивный алгоритм подстройки параметров

- •Простейший адаптивный алгоритм подстройки параметров

- •ВОПРОСЫ ?

- •ИДЕНТИФИКАЦИЯ И АДАПТИВНОЕ УПРАВЛЕНИЕ ДИНАМИЧЕСКИМИ ОБЪЕКТАМИ

- •Дискретные динамические модели стохастических объектов

- •Дискретные динамические модели стохастических объектов

- •Дискретные динамические модели стохастических объектов

- •Подстройка параметров с использованием функций чувствительности

- •Подстройка параметров с использованием функций чувствительности

- •Применение простейшего адаптивного алгоритма

- •Применение простейшего адаптивного алгоритма

- •Применение простейшего адаптивного алгоритма

- •Адаптивные системы обработки информации

- •Постановка задачи адаптивного управления

- •Примеры синтеза устройств управления

- •Примеры синтеза устройств управления для простейших линейных систем

- •Синтез алгоритмов управления для линейных систем

- •Алгоритмы адаптивного управления для нелинейных систем

- •Управление динамическими системами с чистыми запаздываниями

- •Управление динамическими системами

- •ВОПРОСЫ ?

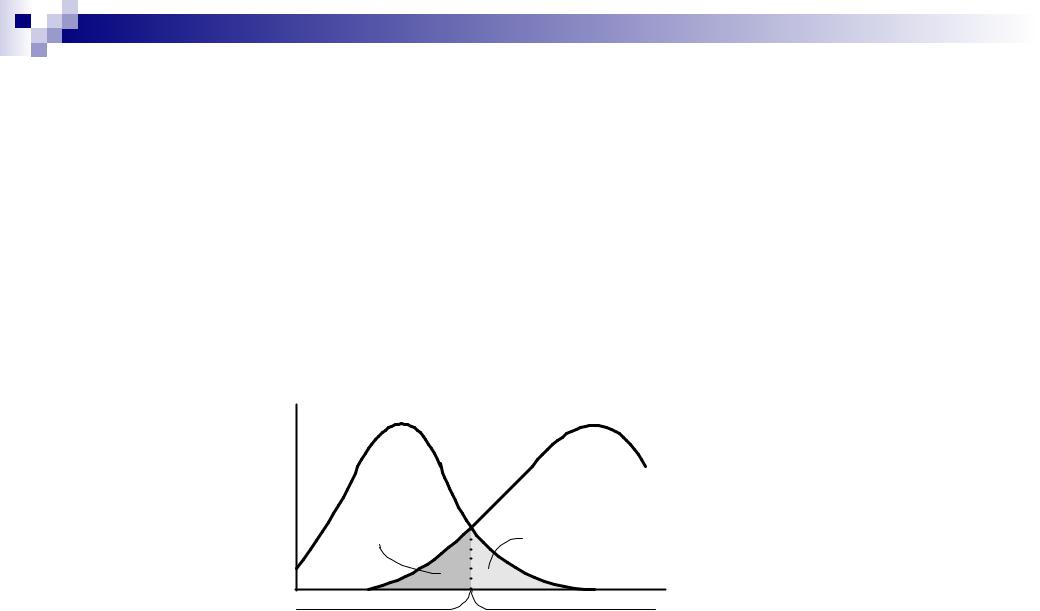

Байесовская теория принятия решений при непрерывных признаках

Вероятность ошибки классификации при двух классах:

P |

f (x |1)P(1)dx |

|

Pîø2 |

f (x | 2)P(2)dx |

|

îø1 |

|

|

|

|

|

|

G |

|

|

|

G1 |

|

2 |

|

|

|

|

|

f (x|1) P(1) |

f (x|2) P(2) |

|||

|

P |

ош.2 |

P |

ош.1 |

|

|

|

|

|

x |

|

|

|

c |

|

|

|

|

|

|

G2 |

|

|

|

G1 |

|

|

||

Идеи классификации

Случай 1. Известны полностью условные плотности распределения вероятности для признаков:

f (x |1), , f (x | m)

f (x|i) |

|

|

f (x|1) |

|

f (x|2) |

|

|

|

|

|

x |

|

|

|

G1 |

c |

G2 |

Одномерный случай |

||

x2 |

(x1, x2 ) 0 |

|

|

(x1 |

, x2 ) 0 |

|

(x1, x2 ) 0 |

|

x1 |

Двумерный случай |

|

Идеи классификации

Случай 2. Условные плотности распределения вероятности для признаков известны не полностью, а с точностью до параметров:

|

1 |

|1), |

|

2 |

| 2) |

f (x, |

f (x, |

|

|||

Неизвестные параметры θ1 и θ2 доопределяются с помощью одного из методов математической статистики, например с помощью метода максимального правдоподобия, на основе обучающей выборки.

Дальнейшая классификация проводится, как и в случае 1.

По обучающей выборке доопределяются и априорные вероятности:

|

n1 |

|

|

|

|

n2 |

|

P(1) |

|

|

, |

P(2) |

|

|

|

n |

n |

n n |

|||||

1 |

2 |

|

|

1 |

2 |

||

Идеи классификации

Случай 3. Условные плотности распределения вероятности неизвестны, но известна обучающая выборка. Здесь возможны два варианта.

Вариант 1. Восстанавливается решающая функция.

Вариант 2. По обучающей выборке восстанавливаются условные плотности

Идеи классификации

Случай 4. Число классов неизвестно и нет обучающей выборки. Вернее, нет учителя, который мог бы измерения признаков разбить на группы, соответствующие своим классам. Это самая сложная и распространенная на практике ситуация. Приходится строить самообучающиеся системы классификации.

1) По количеству максимумов определяем кол-во классов

2) Минимум позволяет разбить выборку на две части – точка c0 (нулевое приближение).

3) |

Далее |

строится |

процедура |

|

последовательного |

(итерационного) |

|

|

расчета порога c. |

|

|

4) |

В итоге получаем случай 3. |

||

Прямые методы восстановления решающей функции

|

1, если истинным является класс 1, |

yi |

1, если истинным является класс 2. |

|

y |

1 |

(x) |

x |

-1 |

НЕЙРОННЫЕ СЕТИ: еще один подход к классификации

Идея взята из биологии:

•Клетка - элементарный процессор, способный к простейшей обработке информации

•Нейрон - элемент клеточной структуры мозга

•Нейрон осуществляет прием и передачу информации в виде импульсов нервной активности

•Природа импульсов - электрохимическая

Интересные данные

Тело клетки имеет размер 3 - 100 микрон

Гигантский аксон кальмара имеет толщину 1 миллиметр и длину несколько метров

Потенциал, превышающий 50 мВ изменяет проводимость мембраны аксона

Общее число нейронов в ЦНС человека порядка 100.000.000.000

Каждая клетка связана в среднем с 10.000 других нейроновСовокупность в объеме 1 мм*3 - независимая локальная сеть