Инфа

.pdf

∙правило Рунге

∙метод Сильвестра

∙метод Гаусса

∙метод покоординатного спуска

Условие окончания итерационного процесса по отысканию точки минимума в методах спуска - это

∙модули частных производных по всем переменным больше заданной точности

∙в списке нет правильного ответа

∙частные производные по всем переменным равны нулю

∙модули частных производных по всем переменным меньше заданной точности

Выпуклыми матрицами Гесса являются следующие

∙

∙

∙

∙

∙

Метод, позволяющий избежать «овражного» эффекта при решении задачи многомерной оптимизации - это

∙метод ГДШ

∙метод наискорейшего спуска

∙метод НСА

∙метод покоординатного спуска

Вектор антиградиента направлен

∙в сторону наискорейшего возрастания целевой функции

∙в сторону наискорейшего изменения целевой функции

∙в сторону наискорейшего убывания целевой функции

∙в списке нет правильного ответа

Вектор градиента - это

∙вектор, состоящий из первых частных производных целевой функции

∙вектор, позволяющий определить направление убывания функции

∙вектор, состоящий из вторых частных производных целевой функции

∙в списке нет правильного ответа

Из перечисленных методов какой НЕ относится в методам многомерной оптимизации

∙Рунге-Кутты

∙НСЧ

∙ГДШ

∙НСА

Линия уровня - это

∙множество точек, для которых целевая функция f(x1,x2) принимает постоянное

значение

∙последовательность точек

, получаемых методом спуска

, получаемых методом спуска

∙в списке нет правильного ответа

∙последовательность значений целевой функции, получаемых методом спуска

Количество итераций, необходимых для того чтобы обеспечить заданную точность  по методу дихотомии при решении задачи одномерной оптимизации, если

по методу дихотомии при решении задачи одномерной оптимизации, если  , равно

, равно

∙нет правильного ответа

∙ 2

2

∙ 3

3

∙ 4

4

Величина шага спуска в аналитическом методе наискорейшего спуска при решении задачи многомерной оптимизации выбирается из условия

∙

∙

∙в списке нет правильного ответа

∙

∙

На каждой итерации в методе ГДШ при решении задачи многомерной оптимизации шаг уменьшается

∙в 1000 раз

∙в 3 раза

∙в 2 раза

∙в 31 раз

За начальное значение шага ( ) в методе ГДШ при решении задачи многомерной оптимизации принимается

) в методе ГДШ при решении задачи многомерной оптимизации принимается

∙

>0

>0

∙ <(b-a)/2

<(b-a)/2

∙0< <1

<1

∙

<0

<0

Модуль вектора антиградиента в точке минимума равен

∙ 0

0

∙в списке нет правильного ответа

∙ 1

1

∙ -1

-1

Кметодам многомерной оптимизации относится метод

∙Гаусса

∙Симпсона

∙наискорейшего спуска

∙Рунге-Кутта

Вектор первых частных производных целевой функции - это

∙градиент

∙ совокупность точек, для которых

∙в списке нет правильного ответа

∙прямая, соединяющая точки с одинаковыми значениями целевой функции

Точкой стационарности называется точка, в которой

∙матрица вторых производных равна нулю

∙градиент функции отрицателен

∙матрица вторых производных отрицательно определена

∙градиент функции равен нулю

Матрица  называется

называется

∙матрица братьев Вачовски

∙матрица Грама

∙матрица Гессе

∙матрица элементарных исходов

Из перечисленных понятий не относится к методам многомерной оптимизации

∙правило Рунге

∙безусловная оптимизация

∙матрица Гессе

∙критерий Сильвестра

Чтобы повысить точность определения точки минимума в методах многомерной оптимизации надо

∙увеличить количество итераций по поиску минимума

∙выбрать начальное приближение как можно ближе к точке минимума

∙уменьшить допустимую погрешность

∙в списке нет правильного ответа

Если на значения параметров оптимизации существуют ограничения, то задача оптимизации называется

∙векторной

∙условной

∙ограниченной

∙сложной

Модуль (длина) вектора градиента указывает на

∙направление убывания функции

∙направление возрастания функции

∙скорость возрастания функции

∙скорость убывания функции

Достаточное условия минимума заключаются в том, что -:вторые производные функции равны 0

∙первые производные функции равны 0

∙угловые миноры матрицы Гессе функции положительны

∙частные производные функции равны 0

Точкой минимума функции  является точка

является точка

∙(1;-3/8)

∙(1/2;1)

∙(-3/5;1)

∙(3/5;-0.2)

Методы спуска при решении задачи многомерной оптимизации – это такие методы, в которых на каждой итерации выполняется условие

∙ |

|

< |

|

∙

∙

∙ |

|

> |

|

Величину  на каждой итерации при решении задачи многомерной оптимизации находят так, чтобы выполнялось условие

на каждой итерации при решении задачи многомерной оптимизации находят так, чтобы выполнялось условие

∙

∙

∙

∙

Вградиентном методе с дроблением шага при решении задачи многомерной оптимизации

∙

∙

∙

∙

Начальная точка при решении задачи многомерной оптимизации выбирается

∙на линии уровня

∙из области существования функции

∙на поверхности уровня

∙в списке нет правильного ответа

Вектор первых частных производных целевой функции - это

∙в списке нет правильного ответа

∙прямая, соединяющая точки с одинаковыми значениями целевой функции

∙градиент

∙ совокупность точек, для которых

По количеству параметров задачи оптимизации делятся на

∙одномерные и многомерные

∙никак не делятся

∙дискретные и непрерывные

∙одномерные и дискретные

Группа методов, в которых точка минимума (максимума) функции находится путем получения вложенных отрезков, называется

∙в списке нет правильного ответа

∙методами одномерного поиска

∙методами спуска

∙градиентными методами

В методе ГДШ при решении задачи многомерной оптимизации начальный шаг  в большинстве случаев берется равным

в большинстве случаев берется равным

∙ =0.5

=0.5

∙

=0

=0

∙ =0.1

=0.1

∙

=1

=1

Длина интервала неопределенности после 3 итерации по методу золотого сечения при решении задачи одномерной оптимизации, если  , равна

, равна

∙0.617934

∙ 1

1

∙0.381924

∙ 2

2

Погрешность, обусловленная выполнением действий над данными, полученными с ограниченной точностью, это

∙погрешность метода

∙в списке нет правильного ответа

∙погрешность округления

∙неустранимая погрешность

На этапе уточнения корней нелинейных уравнений определяют

∙значение корня с заданной степенью точности

∙значение функции, соответствующее корню уравнения

∙отрезок, содержащий единственный корень

∙совокупность корней уравнения

Процесс решения нелинейного уравнения состоит из

∙трех этапов

∙двух этапов

∙четырех этапов

∙семи этапов

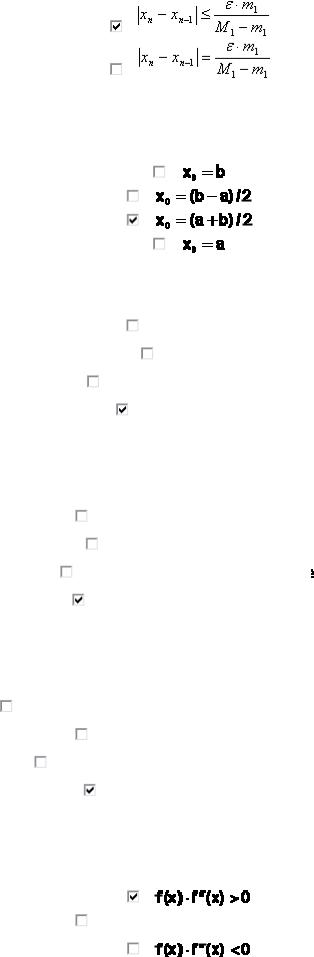

Правилом выбора неподвижной точки при решении нелинейного уравнения метода хорд является

∙в списке нет правильного ответа

∙

∙

∙

За начальное приближения при решении нелинейного уравнения методом итераций принимают

∙ |

|

|

|

|

|

|

|

|

|

|

|

|

|

, если |

||

|

|

|

|

|

|

|

|

|

|

|

||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

|

|

|

|

|

|

|

|

∙ |

||||

∙ |

|

|

|

|

|

|

|

|

|

|

|

|

|

, если |

||

|

|

|

|

|

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

∙в списке нет правильного ответа

Необходимым условием существования корня нелинейного уравненения на отрезке [a;b] является

∙ ∙ ∙

∙

Метод половинного деления при решении нелинейного уравнения всегда находит корень уравнения f(x)=0, если

∙корень совпадает с одной из границ отрезка

∙выполнено условие существования и единственности корня на отрезке

∙в списке нет правильного ответа

∙корень находится в середине отрезка

Корень нелинейного уравнения f(x)=0 - это

∙значение переменной х, обращающее уравнение в тождество

∙значение х, при котором функция принимает максимальное значение

∙значение х, при котором функция существует

∙значение х, при котором функция принимает минимальное значение

Ф-ия сходится к корня, если

∙

∙

∙

∙

Чтобы выбрать x0 в качестве начального приближения при решении нелинейных уравнений в методе Ньютона, необходимо, чтобы в этой точке

∙функция и вторая производная имели одинаковые знаки

∙функция и первая производная имели одинаковые знаки

∙первая и вторая производная имели одинаковые знаки

∙функция и первая производная имели разные знаки

Метод решения нелинейного уравнения, который требует более близкого к корню начального значения это

∙метод Ньютона

∙метод итерации

∙метод хорд

∙в списке нет правильного ответа

∙метод половинного деления

При решении нелинейного уравнения целесообразно выбирать отрезок, на котором отделен корень, небольшой длины в методе

∙метод хорд

∙касательных

∙метод Ньютона

∙метод итерации

Метод решения нелинейного уравнения, в результате которого получается последовательность вложенных отрезков это

∙метод половинного деления

∙метод хорд

∙в списке нет правильного ответа

∙метод Ньютона

∙метод итерации

Условием окончания процесса итерации при решении нелинейного уравнения по методу хорд служит выражение

∙

∙

∙

∙

Первым приближением к корню, отделенному на отрезке [a;b], при решении нелинейного уравнения методом половинного деления служит

∙

∙

∙

∙

Кметодам уточнения корней нелинейных уравнений не относится

∙метод итераций

∙метод хорд

∙метод половинного деления

∙графический метод

Кспособам улучшения сходимости метода простой итерации при решении нелинейного уравнения не относятся

∙в списке нет правильного ответа

∙переход к обратной функции

∙ввод поправочного коэффициента

∙увеличение количества итераций

В процессе решения уравнения методом простой итерации приближение к корню может осуществляться

∙только монотонно со стороны начального приближения

∙в списке нет правильного ответа

∙только колебательно справа и слева от корня

∙монотонно или колебательно

За неподвижный конец отрезка [a;b] в методе хорд при решении нелинейного уравнения выбирают конец отрезка, для которого

∙

∙в списке нет правильного ответа

∙