- •Учебно-методический комплекс Учебной дисциплины «Теория вероятностей и математическая статистика» Цикла ен по специальности

- •080107 «Налоги и налогообложение»

- •Рабочая учебная программа утверждаю:

- •Основание

- •Раздел 1. Элементы теории вероятностей

- •Раздел 2. Математическая статистика

- •2. Краткое изложение материала (сокращенный курс лекций)

- •Тема 1.Элементы комбинаторики

- •1.1. Размещения

- •1.2. Понятие факториала

- •1.3. Размещения с повторениями

- •1.4. Сочетания

- •Сочетания с повторениями

- •1.6. Перестановки

- •1.7. Перестановки с повторениями

- •1.8. Правила комбинаторики

- •Тема 2.Элементы теории вероятностей

- •2.1. Определение вероятности и свойства, вытекающие из её определения. Классификация событий. Диаграммы Венна

- •Полную группу можно определить так: если

- •2.2. Правила сложения и умножения вероятностей. Зависимые и независимые события

- •Тема 3. Формулы полной вероятности и байеса

- •Необходимо определить вероятность события а и переоценить вероятности событий Hi с учетом полной информации о событии а.

- •Тема 4. Дискретные случайные величины.

- •4.1. Определение дискретной случайной величины.

- •4.2.Числовые характеристики.

- •4.3. Математические операции над случайными величинами.

- •4.4. Распределения Бернулли и Пуассона.

- •4.5. Гипергеометрическое распределение.

- •5. Непрерывные случайные величины.

- •5.1. Функция распределения и плотность распределения непрерывной случайной величины.

- •5.2. Нормальное распределение

- •6. Вариационные ряды и их характеристики

- •6.1.Понятие вариационного ряда. Виды вариационных рядов.

- •6.2. Числовые характеристики вариационного ряда

- •7. Выборочный метод и статистическое оценивание

- •7.1. Основные понятия и определения выборочного метода

- •7.2. Статистическое оценивание

- •7.3. Ошибки выборки

- •Формулы расчёта ошибки выборки для собственно-случайного отбора

- •7.4. Определение численности (объема) выборки

- •Формулы расчёта необходимой численности выборки для собственно-случайного отбора

- •7.5. Интервальное оценивание

- •Тема 8. Проверка статистических гипотез

- •Статистическая проверка гипотез

- •3. Методические указания к выполнению курсовой работы, а также методические указания в целом

- •Задачи к теме 1 «Комбинаторика».

- •Задачи к теме 2 «Основные теоремы теории вероятностей».

- •Задачи к теме 3 «Формулы полной вероятности и Байеса».

- •Задачи к теме 4 «Законы распределения дискретных случайных величин».

- •Задачи к теме 5 «Законы распределения непрерывных случайных величин».

- •Задачи к теме 6 «Вариационные ряды и их характеристики».

- •Задачи к теме 7 «Выборочный метод и статистическое оценивание».

- •Задачи к теме 8 «Статистическая проверка гипотезы».

- •5. Контроль знаний (тесты, билеты, вопросы для экзамена, зачета) тесты

- •Тема 1. Комбинаторика

- •Тема 2. Основные определения, понятия и теоремы теории вероятностей

- •Тема 3. Формулы полной вероятности и Байеса

- •Тема 4. Случайные величины

- •Тема 5 . Закон больших чисел

- •Тема 6. Вариационный ряд и его числовые характеристики

- •Тема 7. Выборочный метод и его значение в экономических исследованиях

- •Тема 8. Статистическая проверка гипотез

- •Экзаменационные билеты

- •Вопросы к экзамену (зачету)

- •Раздел 1. Элементы теории вероятностей

- •Раздел 2. Математическая статистика

- •6. Сведения о ппс

- •7. Деловые игры и хозяйственные ситуации, используемые при проведении практических занятий

- •Дополнительный материал Глоссарий

- •Статистические таблицы

Полную группу можно определить так: если

![]() для

любой пары (i

j),

тогда A1,

A2,

… , An

- полная группа событий.

для

любой пары (i

j),

тогда A1,

A2,

… , An

- полная группа событий.

Вероятностью появления события А называют отношение числа исходов, благоприятствующих наступлению этого события, к общему числу всех единственно возможных и несовместных элементарных исходов.

Обозначим число благоприятствующих событию А исходов через М, а число всех исходов - N.

-

(2.1)

где M - целое неотрицательное число,

0

M

M

N

N

Другой тип объективной вероятности определяется исходя из относительной частоты (частости) появления события. Если, к примеру, некоторая фирма в течение времени провела опрос 1000 покупателей нового сорта напитка и 20 из них оценили его как вкусный, то мы можем оценить вероятность того, что потребителям понравится новый напиток как 20/1000=0,02. В этом примере 20 - это частота наступления события, а 20/1000=0,02 - это относительная частота.

Относительной частотой события называется отношение числа испытаний m, при которых событие появилось, к общему числу проведенных испытаний n.

-

(2.2)

где m - целое неотрицательное число,

0

m

m

n

n

Статистической

вероятностью события А называется

относительная частота (частость) этого

события, вычисленная по результатам

большого числа испытаний.

Будем обозначать её Р*(А).

Следовательно,![]() .

При очень большом числе испытаний

статистическая вероятность приближенно

равна классической вероятности, т.е. Р*

(A)

Р(A)

.

При очень большом числе испытаний

статистическая вероятность приближенно

равна классической вероятности, т.е. Р*

(A)

Р(A)

Для определения вероятности выпадения 1 или 2 при подбрасывании кости нам необходимо только знать “модель игры “, в данном случае - кость с 6 гранями. Мы можем определить наши шансы теоретически, без подбрасывания кости, это - априорная (доопытная) вероятность. Во втором примере мы можем определить вероятность только по результатам опыта, это - апостериорная (послеопытная) вероятность. То есть классическая вероятность - априорная, а статистическая - апостериорная.

Какой бы вид вероятности не был выбран для их вычисления и анализа используется один и тот же набор математических правил.

Свойства вероятности, вытекающие из классического определения.

1.

Вероятность достоверного события равна

1, то есть Р(![]() )

= 1.

)

= 1.

Действительно,

если событие А =

![]() ,

то M = N, значит Р(

,

то M = N, значит Р(![]() )

= N/N = 1.

)

= N/N = 1.

2.Если событие невозможное, то его вероятность равна 0, то есть Р()= 0.

Если А = , то оно не осуществится ни при одном испытании, то есть M = 0 и Р() = 0/N = 0.

3.Вероятность случайного события есть положительное число, заключенное между 0 и 1.

В

самом деле, та к как 0

![]() M

M

![]() N , то 0

N , то 0

![]() M/ N

M/ N

![]() 1, то есть 0

1, то есть 0

![]() Р(А)

Р(А)

![]() 1.

1.

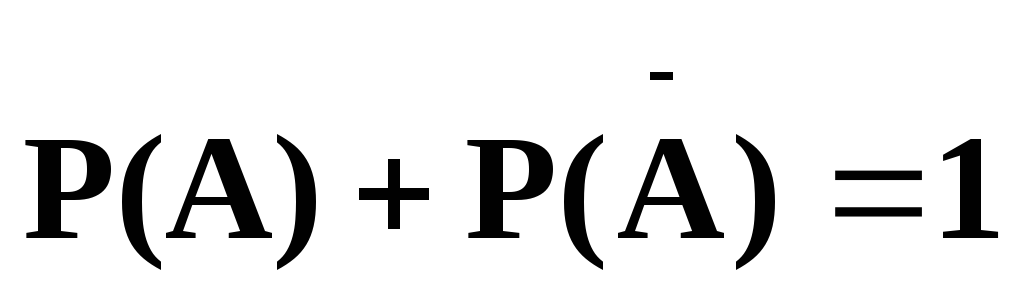

4.

Сумма вероятностей противоположных

событий равна 1, то есть

![]() .

В самом деле,

.

В самом деле,![]()

А отсюда:

-

(2.3)

2.2. Правила сложения и умножения вероятностей. Зависимые и независимые события

Вероятность суммы двух событий равна сумме вероятностей этих событий без вероятности их совместного наступления, то есть:

Р (А+В) = Р(А) + Р(В) - Р(АВ)

или (2.4)

![]()

Для несовместных событий их совместное наступление есть невозможное событие , а вероятность его равна нулю. Следовательно, для несовместных событий правило сложения вероятностей принимает следующий вид:

Вероятность суммы двух несовместных событий равна сумме вероятностей этих событий.

-

Для несовместных событий A, B:

или

(2.5)

Правило сложения вероятностей справедливо и для конечного числа n попарно несовместных событий, то есть:

P(A1+A2+A3+...+An)=P(A1)+P(A2)+P(A3)+...P(An)

или

|

|

(2.6)

|

В случае нескольких совместных событий необходимо по аналогии с рассуждениями о пересечении двух совместных событий исключить повторный учет областей пересечения событий. Рассмотрим три совместных события.

-

A

AB

B

ABC

AC

C

CB

Рис. 2.3

Для случая трех совместных событий можно записать:

Р(А + В + С) = Р(А) + Р(В) + Р(С) - Р(АВ) - Р(АС) - Р(ВС) + Р(АВС).

Сумма вероятностей событий А1, А2, А3, ... , Аn, образующих полную группу, равна 1, то есть:

P(A1) + P(A2) + P(A3) + ... + P(An) = 1

или

-

(2.7)

Вероятность произведения двух независимых событий А и В равна произведению их вероятностей:

|

P(AB) = P(A) P(B), |

|

|

P(A

|

(2.8) |

или

События А1, А2, ..., An (n > 2) называются независимыми в совокупности, если вероятность каждого из них не зависит от того, произошли или нет любые события из числа остальных.

Распространим теоремы умножения на случаи n независимых и зависимых в совокупности событий.

Вероятность совместного появления нескольких событий, независимых в совокупности, равна произведению вероятностей этих событий.

P(A1 A2A3…An) = P(A1) P(A2) P(A3) … P(An) (2.9)

Вероятность произведения двух зависимых событий А и В равна произведению вероятности одного из них на условную вероятность другого:

-

Р(АВ) = P(B) Р(А/В)

(2.10)

Р(А

В)

= P(B)

Р(А/В)

В)

= P(B)

Р(А/В) или Р(АВ) = P(A)Р(В/А)

Р(А

В)

= Р(A)(В/А)

В)

= Р(A)(В/А)Вероятность события В при условии появления события А:

P(B/A) =

или P(B/A)

=

или P(B/A)

=

(2.11)

.

.

Вероятность совместного наступления конечного числа n зависимых событий равна произведению вероятности одного из них на условные вероятности всех остальных, причем условная вероятность каждого последующего события вычисляется в предположении, что все предыдущие уже наступили, т.е.

|

P(A1 A2 A3 ... Аn) = Р(A1) P(A2 / A1) P(A3 / A1 A2). . . . P(An / A1 A2 A3 … An-1) ( 2.12) |

|

Если события А1, А2, ... An - зависимые в совокупности, то вероятность наступления хотя бы одного из них соответственно равна:

![]() (2.13)

(2.13)

В![]() ероятность

появления хотя бы одного события из n

независимых в совокупности, равна

разности между 1 и произведением

вероятностей событий, противоположных

данным,

то есть:

ероятность

появления хотя бы одного события из n

независимых в совокупности, равна

разности между 1 и произведением

вероятностей событий, противоположных

данным,

то есть:

![]() (2.14)

(2.14)