- •Економетрика конспект лекцій

- •Зауваження................................................................................................118

- •1. Регресійний аналіз. Регресійний аналіз для двох змінних: основні ідеї

- •1.1. Гіпотетичний приклад

- •1.2. Концепція регресійної функції популяції (prf роpulation regression function)

- •1.3. Значення терміна “лінійність”

- •1.4. Стохастичні властивості prf

- •1.5. Важливість урахування складової стохастичного збурення

- •1.6. Вибіркова регресійна функція (srf)

- •2. Двовимірна регресійна модель. Задача оцінки

- •2.1. Метод найменших квадратів

- •Експериментальне визначення srf

- •2.2. Властивості оцінок за мнк

- •Дійсна й оцінена ціна будинку і його житлова площа у кв. Футах

- •Припущення 4 гомоскедастичність або рівність дисперсій

- •Це припущення не таке нешкідливе, як здається. Розглянемо рівняння

- •2.3. Точність або стандартна похибка оцінювачів за мнк

- •2.4. Властивості оцінювачів за мнк: теорія Гаусса-Маркова

- •2.5. Коефіцієнт детермінації : міра «якості підгонки»

- •2.6. Числовий приклад

- •2.7. Ілюстративні приклади

- •3. Інтервальні оцінки і перевірка гіпотез

- •3.1. Інтервальні оцінки: основні ідеї

- •3.2 Довірчі інтервали для регресійних коефіцієнтів і

- •Отже, наприклад, змінна

- •3.3. Довірчий інтервал для

- •3.4. Перевірка гіпотез: загальні зауваження

- •3.5. Перевірка гіпотез: підхід на основі довірчого інтервалу

- •3.6. Перевірка гіпотез: підхід, оснований на перевірці значимості

- •3.7. Перевірка значимості : хі-квадрат тест

- •3.8. Регресійний аналіз і аналіз дисперсії

- •Розглянемо таку змінну:

- •3.9. Застосування регресійного аналізу: проблема прогнозу

- •3.10. Форма звіту за результатами регресійного аналізу

- •3.11. Обчислення результатів регресійного аналізу

- •Залишки для проведення -тесту

- •4. Розвиток двовимірної лінійної моделі регресії

- •4.1. Регресія, що проходить через початок координат

- •4.2. Масштабування й одиниці вимірювання

- •Валові внутрішні приватні інвестиції (gpdi) і валовий національний продукт (gnp) у цінах 1972 р. У доларах сша, 1974–1983 рр.

- •4.3. Функціональний вид регресійної моделі

- •4.4. Вимірювання еластичності. Лінійно-логарифмічна модель

- •4.5. Напівлогарифмічні моделі. Визначення темпів зростання.

- •4.6. Обернені моделі

- •4.7. Зауваження щодо стохастичної складової

- •5. Множинний регресійний аналіз. Задача оцінювання

- •5.1. Модель із трьома змінними. Позначення і гіпотези

- •5.2. Інтерпретація рівняння множинної регресії

- •5.3. Значення частинних коефіцієнтів регресії

- •5.4. Оцінка частинних коефіцієнтів регресії за мнк

- •5.6. Проста регресія в контексті множинної регресії

- •5.7. R2 і скорегований r2

- •5.8. Частинні коефіцієнти кореляції

- •5.9. Виробнича функція Коба – Дугласа

- •5.10. Поліноміальная модель регресії

- •6. Припущення нормальності розподілу залишків

- •Витрати на споживання і особистий дохід у сша за 1956–1970 рр.

- •7. Перевірка гіпотез множинної регресії. Загальні зауваження

- •7.1. Перевірка гіпотези про частинний коефіцієнт регресії

- •7.2. Перевірка вибіркової регресії на загальну значущість

- •7.3. Перевірка на рівність двох коефіцієнтів регресії

- •7.4. Перевірка лінійних обмежень

- •Обчислимо

- •7.5. Перевірка структурної стабільності моделей регресії

- •Можна показати, що при виконанні згаданих припущень

- •7.6. Перевірка функціонального виду регресії. Вибір між лінійною моделлю регресії і лінійно-логарифмічною моделлю

- •8. Прогнозування в разі множинної регресії

- •9. Множинна регресія. Матричний метод

- •9.1. Лінійна модель регресії з k змінними

- •9.2. Припущення класичної лінійної моделі регресії в матричній формі

- •Припущення класичної лінійної моделі регресії

- •9.3. Оцінювання за мнк

- •9.4. Коефіцієнт детермінації r2 у матричному позначенні

- •9.5. Кореляційна матриця

- •9.6. Перевірка гіпотез про індивідуальні коефіцієнти регресії в матричному позначенні

- •9.7. Загальна перевірка регресії на значущість. Аналіз дисперсії в матричному позначенні

- •Матричне формулювання anova-таблиці

- •9.8. Перевірка лінійних обмежень. Загальний f-тест у матричних позначеннях

- •9.9. Прогнозування в множинній регресії. Матричне формулювання

- •9.10. Ілюстративний приклад у матричних позначеннях

- •Витрати на споживання на душу населення (ppce) і дохід на душу населення (ppdi) в сша за 1956–1970 рр.

- •Anova-таблиця для даних з таблиці 9.4.

2.4. Властивості оцінювачів за мнк: теорія Гаусса-Маркова

Як було відзначено раніше, оцінювачі, отримані за МНК при зроблених припущеннях CLRM, мають деякі ідеальні або оптимальні властивості. Вони зазначені в добре відомій теоремі Гаусса-Маркова. Для того щоб зрозуміти її значення, необхідно розглянути властивість найкращого лінійного незміщеного оцінювача (best linear unbiasedness property an estimator). Оцінювач, скажімо за МНК, вважається найкращим лінійним незміщеним оцінювачем BLUE (best linear unbiased estimator) , якщо він має такі властивості:

Він лінійний, тобто являє собою лінійну функцію випадкової змінної, таку як залежна змінна Y в регресійній моделі.

Він є незміщеним оцінювачем, тобто

.

.Він має найменшу дисперсію в класі всіх лінійних незміщених оцінювачів; незміщений оцінювач з найменшою дисперсією відомий як ефективний оцінювач.

Можна довести, що оцінювачі, отримані за МНК, мають властивості найкращого лінійного незміщеного оцінювача BLUE. Це є висновком відомої теореми Гаусса-Маркова, яка може бути сформульована таким чином: при прийнятих гіпотезах класичної регресійної лінійної моделі отримані за методом найменших квадратів оцінювачі в класі лінійних незміщених оцінювачів мають найменшу дисперсію, тобто вони є найкращими лінійними незміщеними оцінювачами.

Дана теорема дуже важлива при регресійному аналізі, оскільки стосується як теорії, так і практики.

Пояснимо значення теореми за допомогою рис. 2.10.

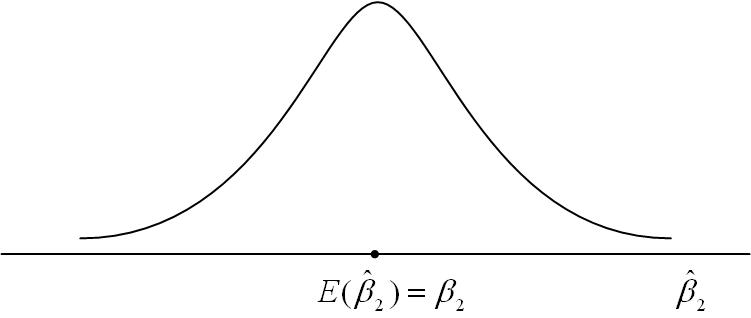

На

рис. 2.10, а

показаний розподіл за вибірками оцінювача

,

отриманого за МНК, у вибірках, що

повторюються. Для зручності ми припустимо,

що розподіл

розташований симетрично. Як бачимо з

рисунка,

математичне

сподівання

дорівнює істинному значенню

,

тобто

.

Це і є значення, яке ми вкладаємо в термін

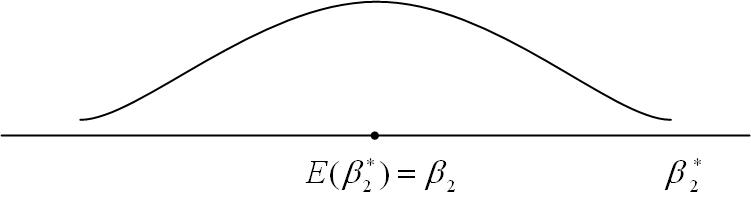

“незміщена оцінка”. На рис. 2.10, б

показаний розподіл оцінювача

![]() ,

отриманого за альтернативним методом.

Для зручності ми припустили, що

,

як і

,

має властивість незміщеності. Припустимо,

що і

і

є лінійними оцінювачами, тобто вони є

лінійними функціями від Y.

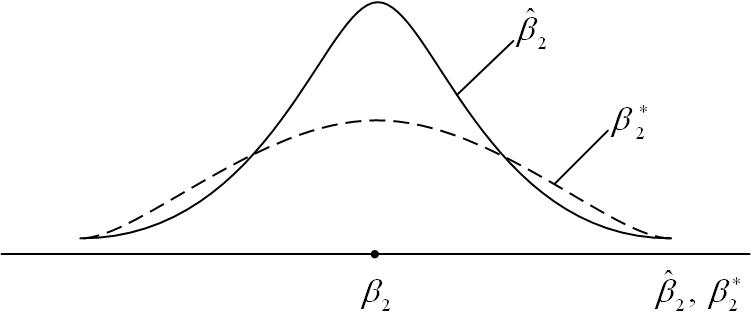

Який із оцінювачів

або

слід вибрати?

,

отриманого за альтернативним методом.

Для зручності ми припустили, що

,

як і

,

має властивість незміщеності. Припустимо,

що і

і

є лінійними оцінювачами, тобто вони є

лінійними функціями від Y.

Який із оцінювачів

або

слід вибрати?

а

б

в

Рис. 2.10. Розподіл за вибіркою за МНК і альтернативного оцінювача : а розподіл ; б розподіл ; в розподіл і

Щоб відповісти на це запитання накладемо два рисунки, як показано на рис. 2.8, в. Із рис. 2.10, в бачимо, що хоча обидва розподіли незміщені, для ми маємо більш розмитий розподіл біля середнього значення в порівнянні з розподілом . Іншими словами, дисперсія більша, ніж дисперсія . Зрозуміло, що з двох даних оцінювачів, які мають властивості лінійності і незміщеності, слід вибрати оцінювач із меншою дисперсією, оскільки він ближче до , ніж альтернативний оцінювач. Отже, завжди слід вибирати найкращий лінійний незміщений оцінювач (BLUE).

Розглянуті нами статистичні властивості відомі як властивості кінцевих вибірок. Ці властивості зберігаються незалежно від розміру вибірки, за даними якої отримані оцінювачі. Пізніше ми матимемо нагоду розглянути асимптотичні властивості, тобто властивості, які зберігаються тільки у випадку, коли вибірка дуже велика (нескінченна).