- •Введение

- •Глава 1. Случайная величина. Законы распределения случайных величин

- •1.1. Понятие случайной величины

- •1.1.1. Виды измерений

- •1.1.2. Единицы измерений, используемые в маркшейдерском деле

- •1.1.3. Случайная величина

- •1.1.4. Вероятность события

- •1.2. Вариационные ряды

- •1.3. Характеристики вариационных рядов

- •1.3.1. Средние значения признака

- •1.3.2. Дисперсия и среднее квадратическое отклонение

- •1.3.3. Показатели вариации

- •1.3.4. Медиана и мода

- •1.3.5. Асимметрия и эксцесс

- •1.3.6. Условные моменты q-го порядка

- •1.4. Графическое изображение вариационных рядов

- •1.4.1. Гистограмма распределения

- •1.4.2. Полигон распределения

- •1.4.3. Кумулята

- •1.4.4. Огива

- •1.5. Сглаживание эмпирических данных

- •1.5.1. Графическое сглаживание

- •1.5.2. Аналитическое сглаживание

- •1.5.2.1. Сглаживание линейной функцией

- •1.5.2.2. Сглаживание показательной функцией

- •1.5.2.3. Сглаживание степенной функцией

- •1.5.2.4. Сглаживание параболической функцией

- •1.5.2.5. Сопоставление результатов сглаживания

- •1.5.2.6. Краткие рекомендации к подбору сглаживающих функций

- •1.6. Законы распределения случайных величин

- •1.6.1. Задание закона распределения

- •1.6.2. Равномерное распределение

- •1.6.3. Нормальное распределение

- •1.6.4. Распределение Стьюдента

- •1.6.5. Распределение Шарлье

- •1.6.6. Биномиальный закон распределения

- •1.6.7. Распределение Пуассона

- •1.6.8. Распределение

- •1.6.9. Показательное распределение

- •1.7. Проверка согласования эмпирического распределения с теоретическим

- •1.7.1. Критерии согласия

- •1.7.2. Критерий согласия к.Пирсона

- •1.7.3. Критерий согласия в.И.Романовского

- •1.7.4. Критерий согласия а.Н.Колмогорова

- •1.7.5. Сопоставление эмпирических распределений с нормальным распределением упрощенными способами

- •1.7.5.1. Использование показателей асимметрии и эксцесса

- •1.7.5.2. Критерий Шарлье

- •1.7.5.3. Критерий Шовенэ

- •1.7.5.4. Способ Линдеберга

- •1.7.5.5. Критерий знаков

- •1.7.6. Сопоставление эффективности критериев

- •Глава 2. Статистический анализ выборочных совокупностей случайной величины

- •2.1. Понятие генеральной и выборочной совокупностей

- •2.2. Оценивание параметров распределения

- •2.2.1. Понятие оценки параметра распределения

- •2.2.2. Интервальная оценка математического ожидания

- •2.2.3. Оценка эмпирического значения дисперсии

- •2.2.4. Сравнение средних двух или нескольких выборок

- •2.2.5. Определение необходимого объема выборок

- •2.3. Дисперсионный анализ

- •2.3.1. Однофакторный дисперсионный анализ

- •2.3.2. Двухфакторный дисперсионный анализ

- •2.4. Корреляционный анализ

- •2.5. Регрессионный анализ

- •2.5.1. Метод наименьших квадратов

- •2.5.2. Линейная регрессия

- •2.5.3. Нелинейная регрессия

- •2.5.4. Понятие о множественной регрессии

- •Глава 3. Обработка результатов многократных измерений одной величины

- •3.1. Общие замечания

- •3.1.1. Задачи обработки результатов многократных измерений

- •3.1.2. Классификация погрешностей измерений

- •3.1.3. Свойства случайных погрешностей

- •3.1.4. Среднее арифметическое

- •3.2. Оценка точности ряда равноточных однородных измерений

- •3.2.1. Средняя квадратическая погрешность

- •3.2.2. Средние квадратические погрешности функций измеренных величин

- •3.2.3. Порядок обработки ряда равноточных измерений

- •3.2.4. Порядок обработки ряда двойных равноточных измерений

- •С учетом (3.26) и (3.27) получим

- •3.3. Об учете систематических погрешностей в измерениях

- •3.4. Обработка ряда неравноточных однородных измерений

- •3.4.1. Понятие о весе результата измерения

- •3.4.2. Погрешность единицы веса

- •3.4.3. Порядок обработки ряда неравноточных измерений

- •3.4.4. Порядок обработки ряда двойных неравноточных измерений

- •3.5. Допуски результатов измерений и их функций

- •Глава 4. Уравнивание геодезических построений

- •4.1. Задачи уравнительных вычислений

- •4.2. Коррелатный способ уравнивания

- •4.3. Параметрический способ уравнивания

- •4.4. Приемы решения систем линейных уравнений

- •4.4.1. Способ последовательной подстановки

- •4.4.2. Способ матричных преобразований

- •4.4.3. Решение систем линейных уравнений по алгоритму Гаусса

- •4.4.4. Способ краковянов

- •4.5. Геометрические условия в геодезических построениях

- •4.5.1. Условие фигуры

- •4.5.2. Условие горизонта

- •4.5.3. Условие суммы углов

- •4.5.4. Условие дирекционных углов

- •4.5.5. Условие сторон

- •4.5.6. Условие полюса

- •4.5.7. Условие координат

- •4.6. Примеры коррелатного способа уравнивания

- •4.6.1. Уравнивание углов в полигоне

- •4.6.2. Уравнивание системы нивелирных ходов с несколькими узловыми точками

- •4.6.3. Уравнивание полигонометрического хода

- •4.6.4. Уравнивание системы полигонометрических ходов с одной узловой точкой

- •4.6.5. Уравнивание системы полигонометрических ходов с двумя узловыми точками

- •4.6.6. Уравнивание триангуляции

- •4.6.7.Уравнивание триангуляции по условию координат

- •4.6.8. Уравнивание линейно-угловой сети

- •4.7. Примеры уравнивания параметрическим способом

- •4.7.1. Уравнивание углов в полигоне

- •4.7.2. Система нивелирных ходов с несколькими узловыми точками

- •4.7.3. Уравнивание полигонометрического хода

- •4.7.4. Система полигонометрических ходов с двумя узловыми точками

- •4.7.5. Уравнивание направлений в триангуляции

- •4.8. Нестрогие способы уравнивания

- •4.8.1. Примеры раздельного уравнивания

- •4.8.1.1. Полигонометрический ход

- •4.8.2. Способ эквивалентной замены

- •4.8.3. Способ полигонов в.В.Попова

- •4.8.4. Способ последовательных приближений

- •4.9. Оценка точности уравненных элементов и их функций

- •4.9.1. Общие положения

- •4.9.2. Оценка точности при уравнивании коррелатным способом

- •4.9.3. Оценка точности при уравнивании параметрическим способом

- •Списоклитературы

- •Предметный указатель

2.5. Регрессионный анализ

Первоначально понятие регрессия было использовано в биологии для описания процессов изменения биологических объектов. Затем оно было применено К.Паскалем в математической статистике, используя общий его смысл – упрощение.

Регрессионный анализ – это метод моделирования измеряемых данных и метод исследования их свойств. Парметры модели подбираются так, что модель наилучшим образом описывает закономерные связи между переменными.

В математической статистике регрессия характеризует зависимость математического ожидания случайной величины от одной или нескольких случайных величин (свободных переменных). При этом, в основном, математическое ожидание не является, например, математическим ожиданием всей выборочной совокупности, а в качестве него могут выступать и выступают средние значения параметра в классах вариационного ряда.

Известно, что между различными измеряемыми параметрами существуют такие связи, как корреляционная, функциональная и стохастическая.

Корреляционная связь или корреляционная зависимость характеризуется, как это было установлено в п. 2.4, теснотой связи. Кроме этого корреляционная зависимость предусматривает и установление формы связи.

Если каждому значению одной переменной ставится вполне определенное значение другой переменной, то такая их взаимосвязь называется функциональной зависимостью.

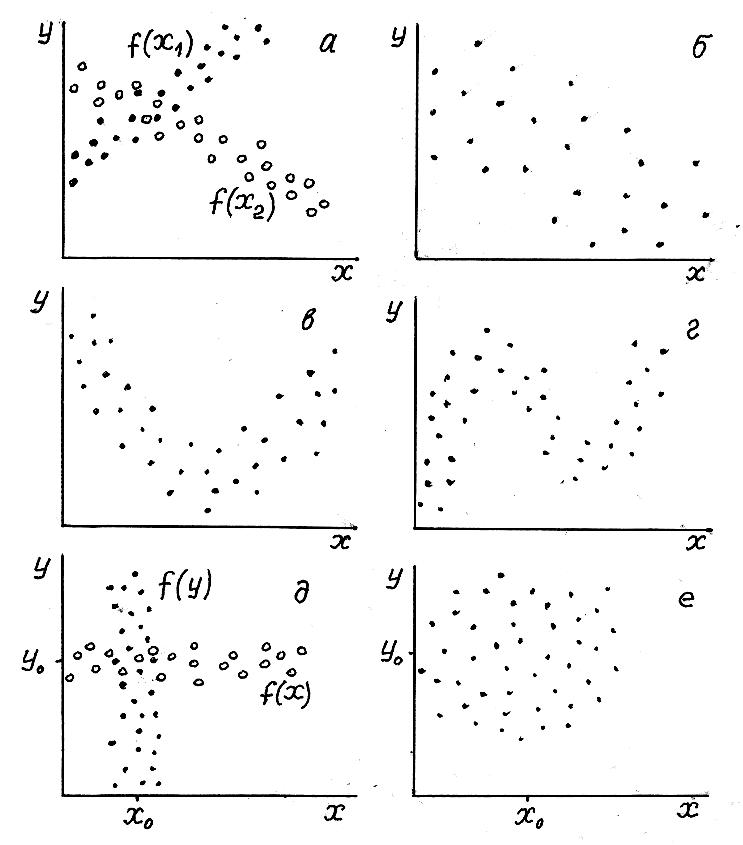

Рис. 2.1. Связи между случайными величинами

а – сравнительно четкая линейная зависимость; б – слабая линейная зависимость;

в – нелинейная зависимость сравнительно простого вида;

г – нелинейная зависимость сложного вида; д – связь между случайными величинами отсутствует; е – связь между случайными величинами не определяется

К достаточно сложной связи относится стохастическая связь, при которой случайная величина реагирует на изменение другой случайной величины изменением своего закона распределения. Это вид причинной зависимости, которая проявляется не в каждом отдельном случае, а в среднем, при большом числе измерений. Эта связь отличается приближенностью и неопределенностью. Стохастические связи невозможно свести к функциональной зависимости.

При исследовании вариационных рядов, случайных величин используют т.н. линейную регрессию, нелинейную регрессию и множественную регрессию.

Линейная регрессия определяет линейную зависимость между случайными величинами, определяемую формулой (1.77). Нелинейная регрессия может быть представлена, в частности зависимостями, представляемыми выражениями (1.82), (1.89), (1.96) и др.

На рис. 2.1 представлены некоторые виды связей между случайными величинами, представленные в виде т.н. «роев».

На рис. 2.1а показана сравнительно четкая зависимость между случайными величинами х и у. Положительный коэффициент корреляции для функции f(x1) и отрицательный – для функции f(x2).

Линейная зависимость прослеживается и на рис. 2.1б (отрицательный коэффициент корреляции), но эта зависимость выражена сравнительно слабее, чем рассмотренная выше.

Нелинейные зависимости представлены на рис. 2.1в и 2.1г. На рис. 2.1в возможно предположение о зависимости параболического вида, на рис. 2.1г нелинейная зависимость сложная, выявление такой связи представляет уже некоторые трудности.

На рис. 2.1д показаны два вида возможной связи (принято определять, что связь такого вида между случайными величинами является не закономерной). Первая – при любых значениях случайной величины х случайная величина у равна своему математическому ожиданию (постоянной величине). В этом случае график зависимости параллелен оси Ох. Вторая закономерность – обратная: для одного и того же постоянного значения случайной величины (изменяющейся в весьма малых пределах) вторая случайная величина может принимать любые значения (в пределах вероятного диапазона ее изменения). В этом случае график параллелен оси Оу.

На рис. 2.1е связь меджу случайными величинами не устанавливается: для любого изменения случайной величины в вероятных пределах ее существования вторая случайная величина может принимать любые значения в вероятных пределах ее существования.